📖Chapter 05

📌결정 트리

▪ 예/아니오에 대한 질문을 이어나가면서 정답을 찾아 학습하는 알고리즘.

▪ 결정 트리는 제한 없이 성장하면 훈련 세트에 과적합되기 쉬움.

- 가지치기: 결정 트리의 성장을 제한하는 방법

📌불순도

▪ 결정 트리가 최적의 질문을 찾기 위한 기준.

📌정보 이득

▪ 부모 노드와 자식 노드의 불순도 차이.

▪ 결정 트리 알고리즘은 정보 이득이 최대화되도록 학습.

📌특성 중요도

▪ 결정 트리에 사용된 특성이 불순도를 감소하는데 기여한 정도릉 나타내는 값.

▪ 특성 중요도를 계산할 수 있는것이 결정 트리의 장점.

📌검증 세트

▪ 하이퍼파라미터 튜닝을 위해 모델을 평가할 때, 테스트 세트를 사용하지 않기 위해 훈련 세트에서 다시 떼어 낸 데이터 세트.

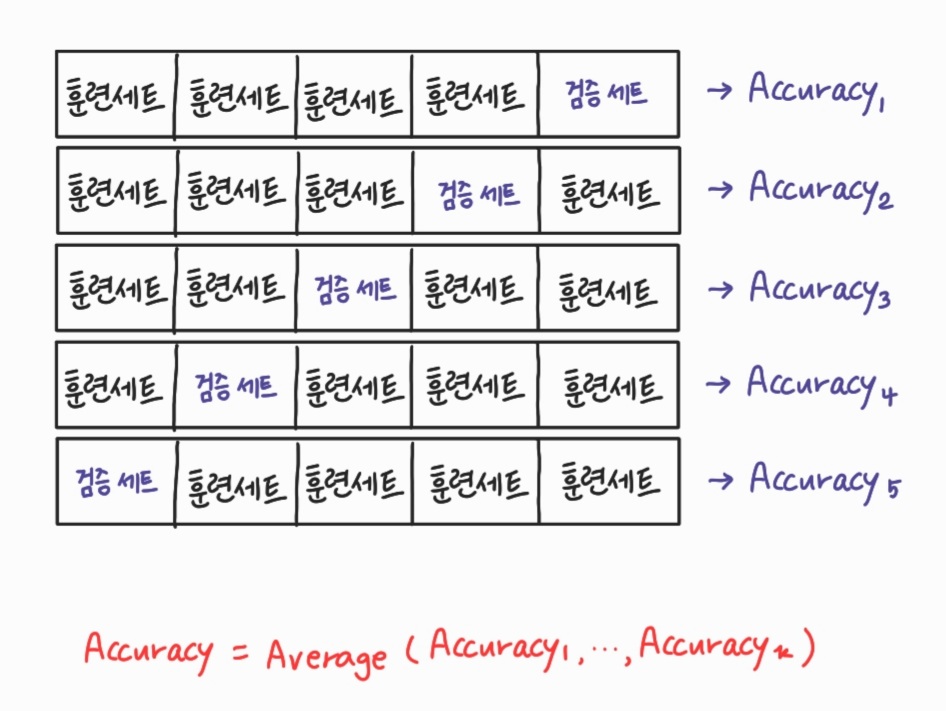

📌교차 검증

▪ 훈련 세트를 여러 폴드로 나눈 다음 한 폴드가 검증 세트의 역할을 하고 나엄지 폴드에서는 모델을 훈련함.

▪ 이런 식으로 모든 폴드에 대해 검증 점수를 얻어 평균하는 방법.

📌그리드 서치

▪ 하이퍼파라미터 탐색을 자동화해 주는 도구.

▪ 탐색할 매개변수를 나열하면 교차 검증을 수행하여 가장 좋은 검증 점수의 매개변수 조합을 선택함.

▪ 마지막으로 이 매개변수 조합으로 최종 모델을 훈련함.

📌랜덤 서치

▪ 연속된 매개변수 값을 탐색할 때 유용.

▪ 탐색할 값을 직접 나열하는 것이 아니고 탐색 값을 샘플링할 수 있는 확률 분포 객체를 전달함.

▪ 지정된 횟수만큼 샘플링하여 교차 검증을 수행하기 때문에 시스템 자원이 허락하는 만큼 탐색량을 조절할 수 있음.

📌앙상블 학습

▪ 더 좋은 예측 결과를 만들기 위해 여러 개의 모델을 훈련하는 머신러닝 알고리즘.

<사이킷런에서 제공하는 앙상블 학슴 알고리즘>

랜덤 포레스트

- 대표적인 결정 트리 기반의 앙상블 학습 방법.

- 부트스트랩 샘플을 사용하고 랜덤하게 일부 특성을 선택하여 트리를 만드는 것이 특징.

- 성능이 좋으며 안정적임.

엑스트라 트리- 랜덤 포레스트와 비슷하지만 부트스트랩 샘플을 사용하지 않음.

- 랜덤하게 노드를 분할해 과대적합 감소시킴.

- 랜덤 포레스트보다 훈련속도가 빠르지만 더 많은 트리가 필요함.

그레이디언트 부스팅- 깊이가 얇은 트리를 연속적으로 추가하여 손실 함수를 최소화하는 앙상블 방법.

- 성능이 뛰어나지만 병렬로 훈련할 수 없기 때문에 훈련 속도가 조금 느림.

- 학습률 매개변수를 조정하여 모델의 복잡도를 제어할 수 있음.

- 학습률 매개변수가 크면 복잡하고 훈련 세트에 과대적합된 모델을 얻을 수 있음.

히스토그램 기반 그레이디언트 부스팅- 그레이디언트 부스팅의 속도를 개선한 것.

- 훈련 데이터를 256개의 구간으로 변환하여 사용하기 때문에 노드 분할 속도가 매우 빠름.

📌부트스트랩

▪ 데이터 세트에서 중복을 허용하여 데이터를 샘플링하는 방식.

▪ 부트스트랩 샘플 = 부트스트랩 방식으로 샘플링하여 분류한 데이터.

💡기본미션: 교차 검증을 그림으로 설명하기

💡선택미션: Ch 05-3. 앙상블 모델 손코딩 코랩 화면 인증샷

📒혼자 공부하는 머신러닝+딥러닝 책을 참고하여 작성하였습니다.

https://www.hanbit.co.kr/store/books/look.php?p_code=B2002963743