경사 하강법이란?

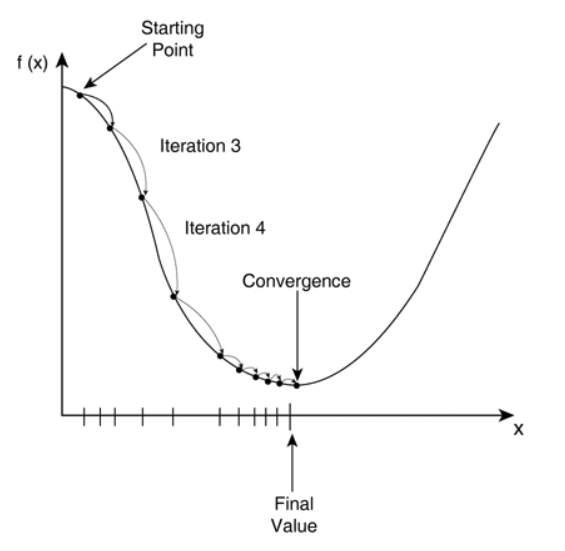

경사 하강법(Gradient Descent)은 기계학습 및 최적화 알고리즘에서 널리 사용되는 방법 중 하나로 목적 함수의 기울기(gradient)를 사용하여 함수의 최소값을 찾아내는 방법이다.

epoch

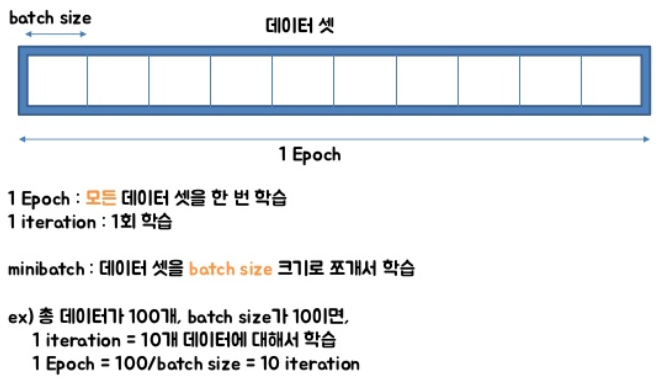

epoch(에포크)란 학습 데이터 전체를 한 번씩 모두 사용하여 학습을 완료하는 단위를 말한다.

보통 모델의 학습은 여러 개의 epoch를 반복하면서 수행된다. 이를 통해 모델은 학습 데이터에서 반복적으로 학습하면서 최적의 파라미터를 찾아내게 된다. epoch의 수는 하이퍼파라미터 중 하나로써, 적절한 epoch의 수를 찾는 것은 모델 성능을 높이기 위해 중요한 요소 중 하나다.

learning rate

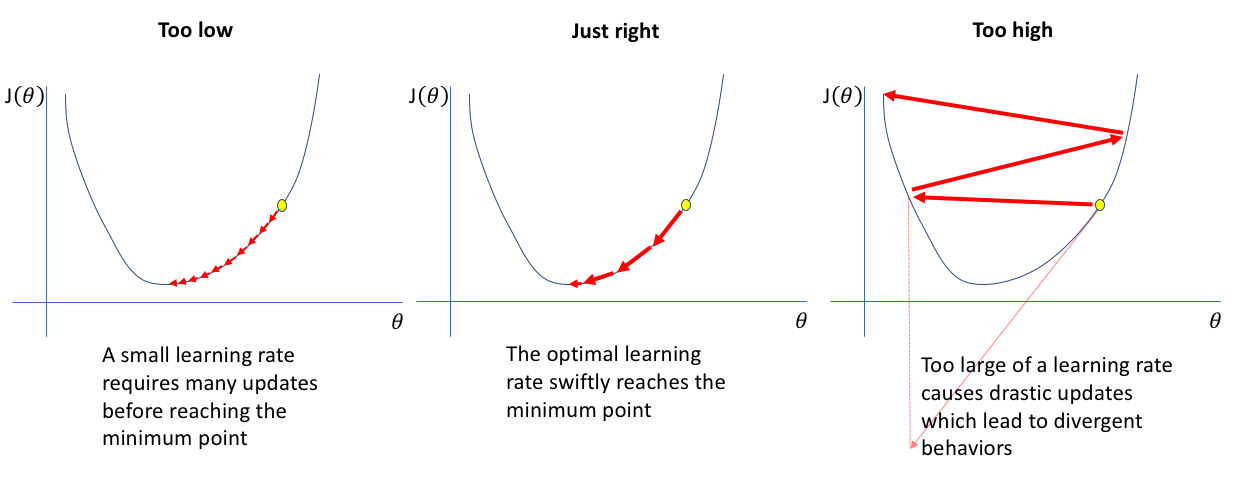

learning rate(학습률)는 경사 하강법에서 한 번의 학습 단계에서 얼마나 많이 학습할 것인지를 결정하는 하이퍼파라미터다.

경사 하강법은 현재 위치에서 기울기를 계산하여 해당 방향으로 일정 거리만큼 이동하면서 최적점을 찾아간다. 이때 학습률은 파라미터가 이동하는 크기를 결정한다.

학습률이 작으면 파라미터의 업데이트가 매우 작아져서 최적점까지 수렴하는 데 많은 시간이 소요된다.

반면, 학습률이 크면 파라미터가 너무 큰 간격으로 업데이트되어 최적점을 지나치게 될 수 있다. 즉, 학습률이 적절하지 않으면 최적점을 못 찾거나, 지나치거나, 발산할 수 있다.

로지스틱 회귀

로지스틱 회귀(Logistic Regression)는 분류(Classification) 문제에서 많이 사용되는 통계 기반의 회귀 알고리즘이다. 이는 데이터를 입력하면 데이터가 어떤 범주(Category)에 속할 확률을 출력하는 모델이다.

로지스틱 회귀는 종속 변수(Y)가 이항 변수(Binary Variable)인 경우(0 또는 1)에 적합하다. 따라서 이진 분류(Binary Classification) 문제에서 널리 사용된다. 로지스틱 회귀 모델은 선형 회귀 모델과 비슷하게 입력 데이터(X)와 파라미터(Weight, Bias)를 사용하여 모델을 학습한다. 하지만 로지스틱 회귀는 선형 회귀 모델과 달리, 출력값을 로지스틱 함수(Logistic Function)라는 확률 값으로 변환하여 사용한다.

로지스틱 함수는 S자 모양을 가지는 sigmoid 함수로서, 입력값을 0과 1 사이의 값으로 변환한다. 이를 통해 로지스틱 회귀 모델은 입력 데이터와 파라미터의 선형 조합값을 sigmoid 함수에 적용하여 해당 데이터가 어떤 범주에 속할 확률을 출력한다.

로지스틱 회귀는 다른 분류 알고리즘과 달리 해석이 쉽고, 계산 비용이 적으며, 이해하기 쉽기 때문에 분류 문제에서 많이 사용된다. 또한, 로지스틱 회귀 모델은 이진 분류 뿐만 아니라 다중 분류(Multi-class Classification) 문제에도 적용할 수 있다. 이때는 One-vs-Rest 또는 Softmax 함수를 이용하여 다중 클래스를 분류한다.