ICLR 2024 논문으로 딥러닝을 이용한 이미지 압축 논문이다. (코드 O)

Contributions

-

인코더, 디코더 내에 Swin transformer의 4가지 형태로 윈도우 설정

-

인코더 디코더 FFN 부분에 주파수 변환 -> linear -> 역변환 수행

-

Entropy module의 autoregressive를 masked transformer 형태로 구현하였다.

Overview

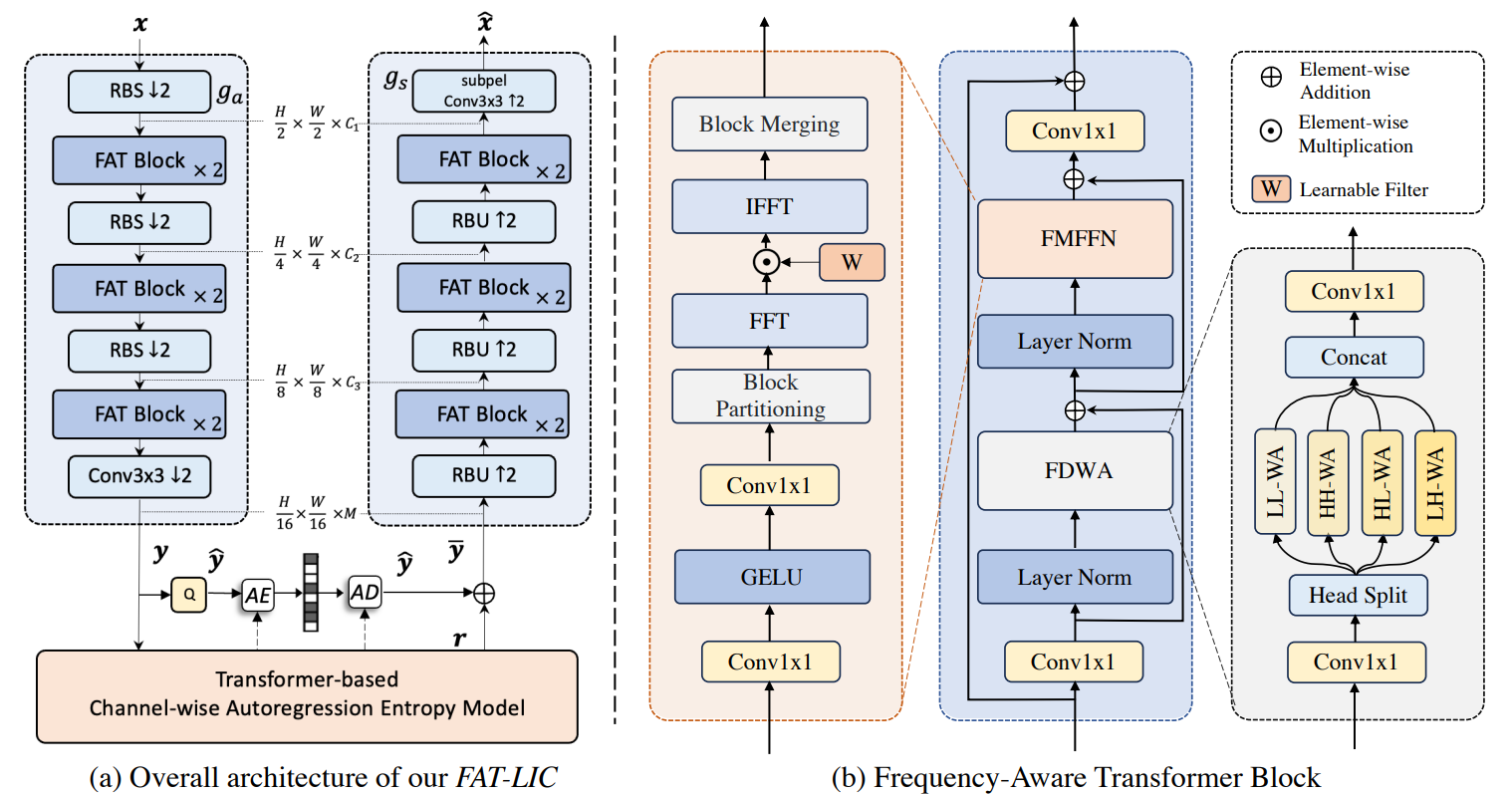

전체 모델 구조 그림이다.

RBS: Residual block with stride

RBU: Residual block with upsampling

FAT: Frequency Aware Transformer

인코더, 디코더

여느 CNN+Transformer 조합의 autoencoder 구조와 같이 CNN 구조인 RBS / RBU와 Swin transformer 기반의 FAT block의 반복으로 이루어져 있다.

FAT (Frequency Aware Transformer)

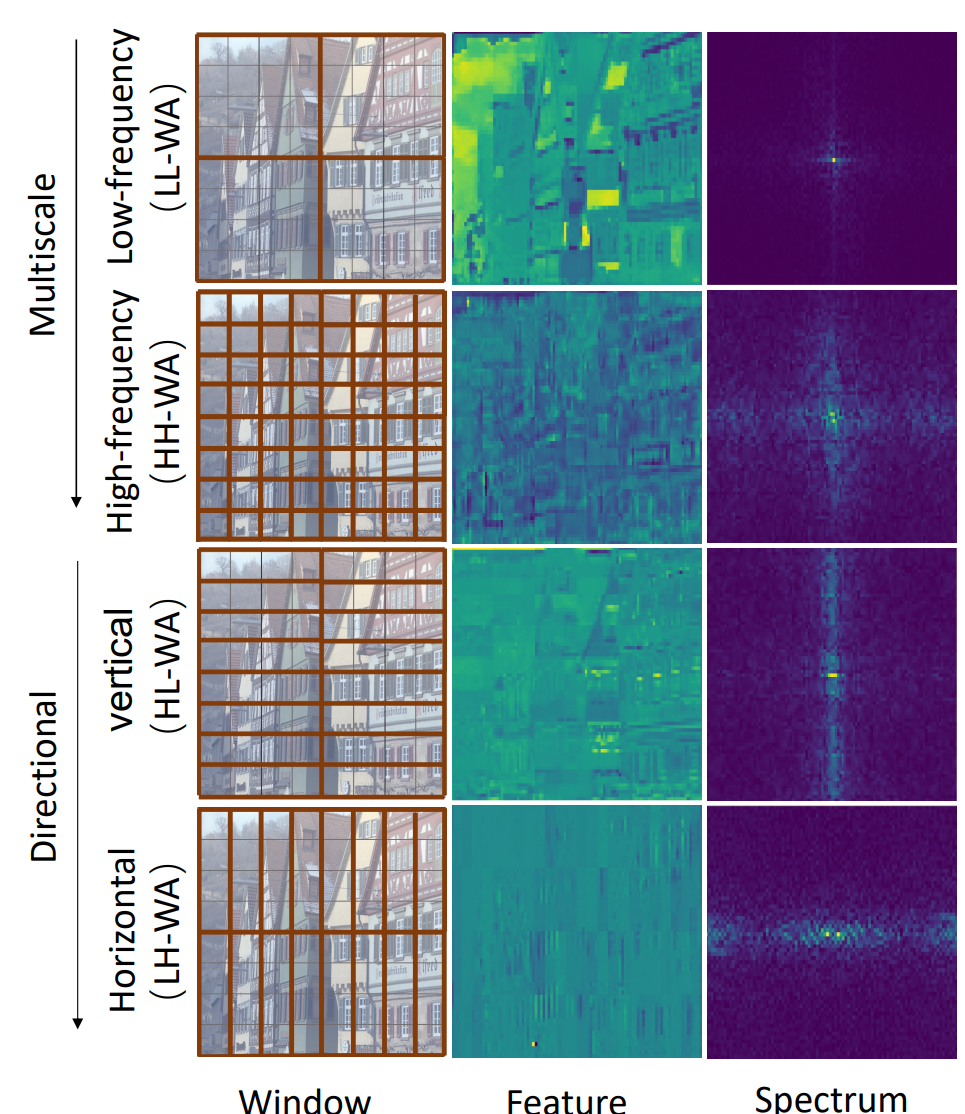

4가지의 윈도우 형태

기존 Swin과 다르게 윈도우 형태를 4가지로 사용하였다. 위 그림과 같이 각 윈도우의 특성에 따라 얻을 수 있는 특징이 달라진다고 한다.

-> 이건 이론적으로 예측하긴 어려울 것 같고, 대충 이럴 것 같다고 상상한 뒤 실험 해봐야 떠올릴 수 있는 아이디어일 듯 하다.

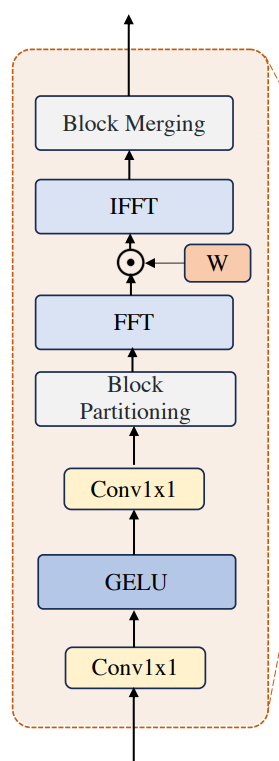

FM (Frequency Modulation)

기존 Transformer의 FFN를 통과한 뒤, 주파수 영역에서 Linear 연산이 하나 추가되었다.

동일 팀에서 ICLR 2025에 낸 논문 역시 에너지 관련 언급이 많은데, 이 팀은 이쪽으로 발전시키고 있는 것 같다.

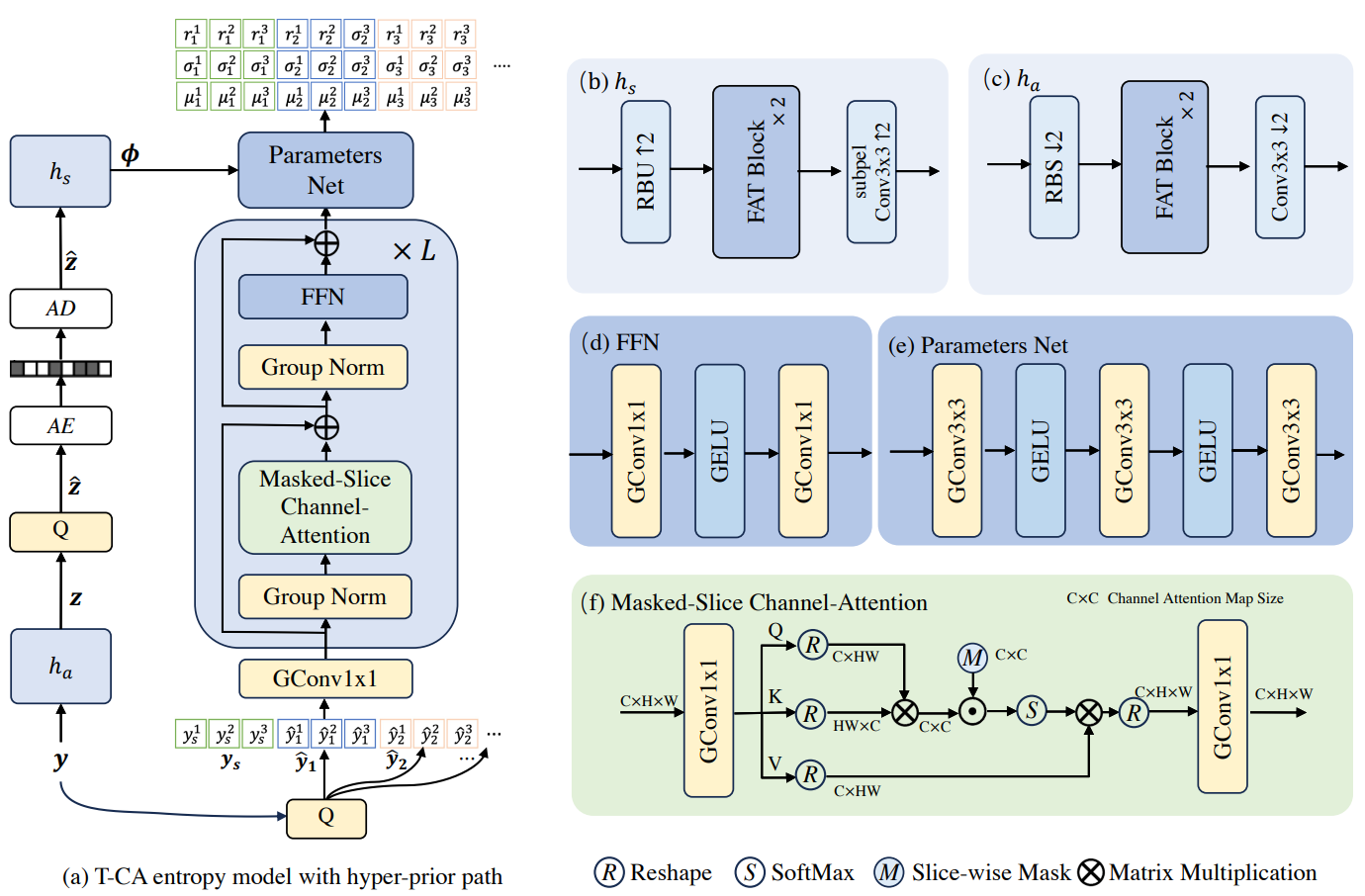

Entropy Module

사실 다른 Autoregressive 방식과 알고리즘 자체는 같지만 더 효율적인 구현을 contribution 삼은 것 같다.

기존 연구들과의 차이점:

- hyperprior encoder, decoder 내부에 FAT block을 사용

- Autoregressive 구현에 masked transformer 사용

모델 코드도 정리도 잘 되어 있고, 이해하기 좋게 짜여 있어 참조하기 좋다. 성능, hyperparameter는 직접 논문을 보면 되겠다.