CONTINUOUS CONTROL WITH DEEP REINFORCEMENT LEARNING - DDPG 발표대본

1p

안녕하세요 저희가 이번주에 리뷰할 논문은 CONTINUOUS CONTROL WITH DEEP REINFORCEMENT LEARNING이라는 논문입니다.

3p

먼저 AI를 이용하여 더욱더 복잡한 문제를 푸려고 시도해보니 DQN은 이산적이고 차원이 낮은 space를 가진 task만 해결이 가능합니다. action의 종류가 늘어날 수록 차원의 저주에 걸리기 때문입니다.

차원의 저주란 차원이 늘어남에 따라 모델의 성능이 안좋아지는 상황을 의미 합니다.

4p

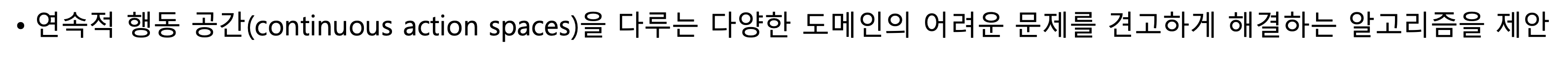

사진을 보시면 같은 데이터지만 1차원에서는 밀도가 촘촘했던 것들이 2,3차원으로 차원이 커질수록 데이터간의 간격이 늘어나는 것을 보실 수 있습니다. 이렇게 빈공간이 늘어나면 모르는 정보가 늘어났다는 의미 임으로 모델의 성능이 저하됩니다.

5p

앞에서 말씀드린 문제를 해결하기 위해 DPG 알고리즘 기반의 actor-critic 방식을 사용하고 DQN의 몇몇 특징들을 결합하여 DDPG라는 알고리즘을 소개합니다. actor-critic 알고리즘을 간단히 설명하면 actor는 행동 선택을 담당하고 그 행동의 가치를 평가하는 critic이 협력하여 정책을 개선하는 알고리즘입니다.

6p

먼저 모든 가중치와 네트워크를 초기화하고 현재 정책에서 행동을 고른후 노이즈를 추가합니다.

여기서 노이즈를 추가하는 이유는 DDPG는 그 이름에서 알 수 있듯이 deterministic, 결정론적인 알고리즘 입니다. 같은 상태에서 같은 행동을 하기 떄문에 노이즈를 통해 무작위성을 추가해야합니다. 이때 노이즈는 온스테인 울렌벡 프로세스를 통해 시간적으로 상관된 무작위 값이라고 합니다.

그 다음 행동에 대한 보상과 새로운 state를 replay buffer에 추가합니다. replay buffer에서 랜덤한 미니배치를 꺼내어 학습해 데이터의 상관성을 줄입니다. 노이즈를 통해 탐험과 활용의 균형을 맞추고 replay buffer를 통해 상관성을 낮추는 식으로 Ai가 일반화하는 능력을 향상시킵니다.

그 후 critic을 TD오류를 최소화하는 방향으로 업데이트 합니다. critic은 DQN에서의 네트워크와 마찬가지로 상태와 행동에 통해 미래의 보상을 반영하는 Q 값을 예측합니다. TD오류란 여기서 예측하는 Q값, 즉 예측된 보상과 실제 보상의 차이를 의미하고, DDPG에서는 critic을 통해 이 차이를 최소화 합니다.

7p

그러고 actor를 업데이트하는데 DDPG에서 actor의 학습목표는 주어진 상태에서 최적의 행동을 선택하도록하는 학습 정책 자체를 개선하는 것입니다. 이때 경사상승법을 사용합니다. DQN의 Q네트워크에서 경사하강법을 사용하는데 actor에서는 경사 상승법을 사용하는 이유는 두 네트워크의 목표가 다르기 때문입니다. DQN의 Q네트워크에서는 Q 값을 기반으로 최적의 행동을 선택하여 보상을 최대화 합니다. 최적의 행동을 선택하려면 실제 보상과 예측된 보상의 차이가 작아야하고 이것이 앞에서 말씀드린 TD오류입니다. 하지만 DDPG의 actor에서는 보상인 q값이 아닌 정책 자체를 최대화 해야하기 때문에 경사상승법을 사용합니다. actor는 critic을 통해 정책에 대한 피드백을 진행하고 actor는 이를 통해 경사상승법을 진행하며 정책을 최적화합니다.

8p

마지막으로 타겟 네트워크를 업데이트하고 마무리합니다. 타겟 네트워크를 업데이트 할때 soft 업데이트 방식으로 파라미터를 업데이트하여 급격한 변화가 학습에 미치는 영향을 줄이고 이 방식을 통해 DQN에서 발생했던 과대평가도 어느정도 예방할수 있다고 합니다.

추가적으로 배치 정규화도 사용했습니다.

10p

그림을 보시면 원래 DPG에 비해 타겟 네트워크를 사용한 모델들이 더 빨리 최적화되는것을 확인하실수 있습니다. 최적화 되는 시점은 학습수렴이 일어나는 시점으로 모델의 파라미터가 변화하며 더 이상 유의미한 변화가 일어나지 않고 일정한 값에 수렴하게 되는 시점이라고 보시면 됩니다.

11p

결과적으로 연속적 행동 공간(continuous action spaces)을 다루는 다양한 도메인의 어려운 문제를 견고하게 해결하는 알고리즘을 제안했고 대부분의 강화학습 알고리즘에서 비선형 함수 근사기로 인해 수렴 보장은 어렵지만, 실험을 통해 안정적인 학습이 가능함을 입증했습니다. 다만 Model-free 알고리즘 기반이라서 학습하는데 오랜 시간이 걸린다는 단점이 있습니다.

Model-free 알고리즘은 환경의 동적 모델을 학습하거나 사용하지 않고, 직접적인 경험을 통해 정책(policy)이나 가치를 학습하는 방식입니다. 이런 특징으로 인해 학습 시간이 오래 걸리는 단점이 발생

Model-free 알고리즘은 샘플 효율성이 낮습니다. 즉, 환경과의 상호작용을 통해 많은 경험을 얻어야 제대로 학습할 수 있습니다.