골치아픈걸 기계로 만들자

우리의 뇌를 공부하기 시작.

- 이 뇌가 굉장히 복잡하게 연결되있구나 ~

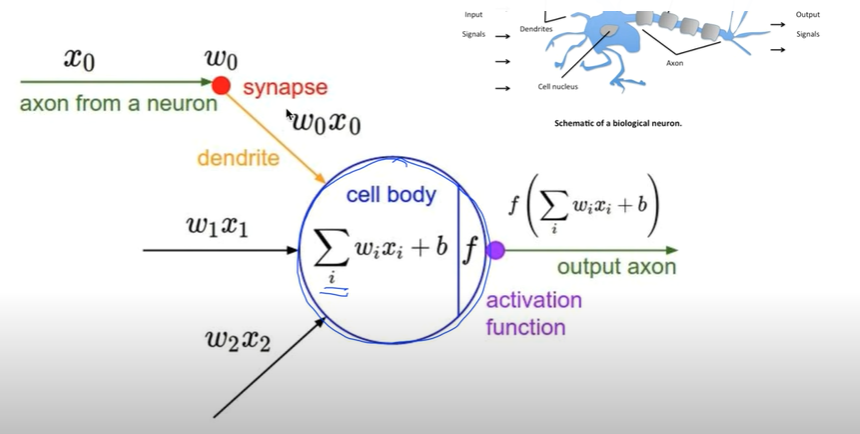

- 부분부분들을 자세히 보니 뉴런이라 불리는 유닛이 너무나 단순하게 동작되더라 근데 어캐생각할수 있지 ?

어떤 인풋이 있고 전해주는 것의 길이에 따라 신호의 양이 달라져.

존쉽.

X에 w정도의 신호가 들어온다. 그것들이 다 합쳐지고 sum 되고 통과되면서 bias 항목이 더해져서 그다음으로 전달되더라. 그러니 다 모여진 값이 우리가 정해진 어떤 값 이상이 되면 이것이 활성화 되고 (activation) 아니면 비활성 되더라.

이런형태 뉴런은 수학적으로 만들수도 있겠다~

요런 형태~~

이 기계를 직접 하드워드를 가지고도 만들수 있다.

아 근데 이니테이션 게임 보니깐.. 인공지능 창시자가 뭘 원하는 건지 알겠는게 신기해~

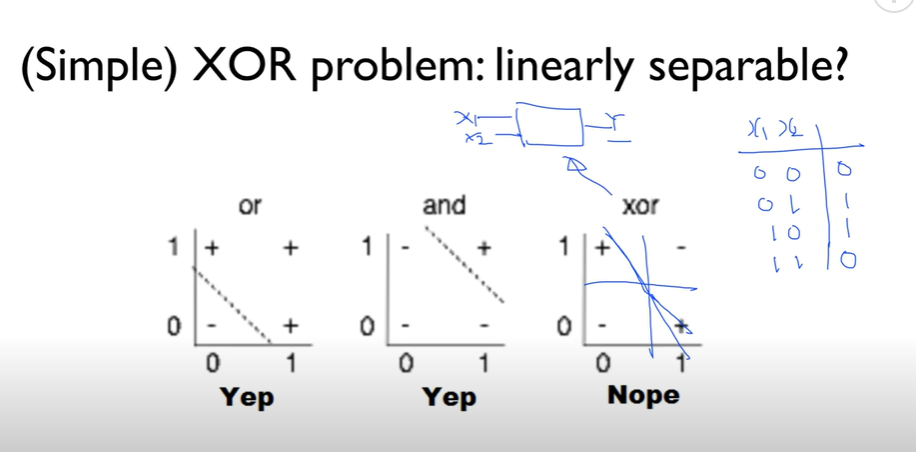

저거 풀기가 어려워.

Perceptreon(1969)

XOR은 풀수가 없다. 한개로는 할수없고 여러개를 합하면 MLP, multilayer perceptrons 라고 하고

할수 있어 문제는 각각의 w와 bias를 학습시킬수 없어.

강조한 것이. 아무도 못해.

이 책을 써서 뉴런네트워크 쪽의 인공지능 분야 20년 정도 후퇴한 듯.

그러고 시간 흘러감

86년도 까지 가서.

76에는 폴이란 사람이 방법 해결하긴 함.

Backpropagation (1986)

틀린 출력일 경우 w,b를 조절해야하는데 앞에서 조절 어려웠는데 저 알고리즘이 개발됬는데 역해서 뒤로 전달해 가면서 각각을 체인지 하면 어떨까? 단순한 건데 이것이 1974때 발표

민스키교수 찾아감. 1982 묻힐뻔 했으나. Hinton 이란 분. 똑같은 방법을 독자적으로 만들어냄. 재발견이다.

더 복잡한 형태의 예측이 가능해 졌다.

Convolutional Neural Networks

한편으로는 라쿤이라는 교수는 다른방법으로 접근함. 그 방법이 재밋다. 고양이를 가지고 어떻게 동작하는지 봤는데 그림의 형태에 따라 일부의 뉴런의 형태들이 활성화 되고 또 다른 그림은 다름. 그림을 볼때 우리 신경망 상태가 일부의 부분부분들이 담당하는 신경망들이 나중에 조합회는 것이 아닐까???? 해서 만듬

부분부분을 잘라서 보낸다음에 나중에 합치는 방법의 네트워크 개발 ex) 알파고

잘 동작됨. 90% 정도의 문자를 인식하고 등등

ex)책을 자동으로 읽는 기계 만듬

ex) 자동 주행 차량

그러다 문제에 봉착함

backpropagation 이 몇개의 것은 푸는데 최소 10여개 이상 되는 layer를 학습할수 있어야 하는데 앞의 에러를 뒤로 보낼때 의미가 갈수록 약해져서 나중에는 전달안되고 학습안됨.

많이 할수록 성능이 떨어짐.

한편으로는 다른형태의 알고리즘이 많이 나타났고 뉴런네트워크보다 더 간단한 알고리즘이 떠오름. SVM, RandomForest 등등

초기값을 주고 학습시키는데 초기값을 잘 주고 학습하면 잘된다.

한걸음 나아가 깊게 신경망을 구축하면 굉장히 복잡한 문제를 풀수있다. 라는 것을 논문통해 보여줌. 다시 사람들이 주목함. 이때 뉴런네트워크라고 하면 쳐다보지도 않았는데 Deep Nets, Deep Learning 이라 하자. 다른거같은데?하면서 관심가지게 됨. 똑같은거임 =_=

ex) 이미지넷이라는 챌린지에서 그림을 주고 무엇인지 맞춰봐라고 컴에게 맞추게 했다.

설명도 가능하고 정확도도 높고. 등등.