Knowledge Distillation and Student-Teacher Learning for Visual Intelligence: A Review and New Outlooks 논문 리뷰

Knowledge Distillaion 연구동향

내가 읽은 knowledge distillation논문 중에 해당 기술 동향을 잘 설명하는 논문이다. 참고로 이 논문은 총 40페이지에 달하며 knowledge distillation기술을 총망라하였다.

Abstract

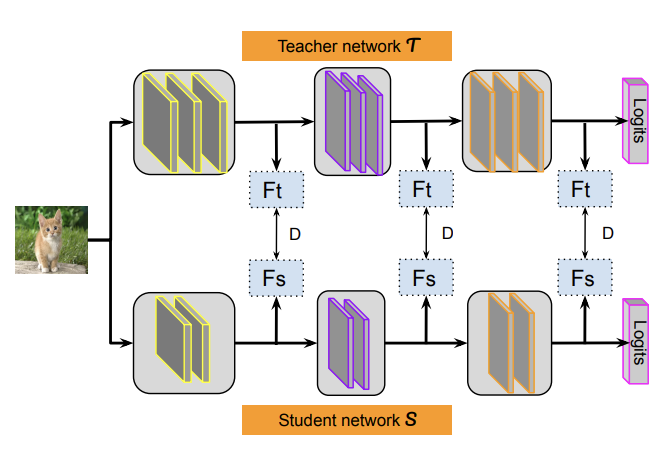

edge device에 배포하기 위함뿐만 아니라 performence의 속도가 redundant labeled data에 의존하는데 labeled data의 부족으로 인한 문제를 해결하기 위해 Knowledge distillation이 제안된다. KD(Knowledge distillation)는 Student-Teacher framework로 불리며 model compression및 knowledge transfer분야에 광범위하게 적용된다. 이 논문은 첫째로 KD가 무엇이며 어떻게/왜 작용하는지 설명할 것이며 최신 기술 동향을 설명할 것이다. 추가적으로 vision분야에서 systemically하게 분석할 것이며 마지막으로 잠재성과 기존 방법들의 도전과제에 대해 알아보겠다.

Introduction

DNN은 deep and wide하기에 training을 위해서는 상당한 computation이 필요하며 real-time에 작동되기 어렵다. performance를 저해하지 않으면서 labeled raining data를 줄이기 위한 노력이 계속되었다.

일반적인 예로 small set of labeled data와 a large set of unlabeled data에 학습되는 semi-supervised learning이 있다. 여기에는 consistency cost와 regularization이 중요하다. 목적은 추가적인 학습없이 student로부터 더 나은 teacher모델을 형성하는 것이다.

또 다른 예로 모델이 input data의 transformation을 통해 형성된 artificial labels을 training한 self-supervised learning 이 있다. 변형된 데이터의 지식은 모델 자체적인 성능 향상을 위한 supervise을 위해 전달된다.

KD는 작은 training set에도 불구하고 인간이 복잡하고 새로운 개념을 빠르게 학습하기 위한 메커니즘으로 간주된다. 이 논문은 vision task를 중점적으로 다룬다.

그리고 몇가지 fundamental한 질문을 탐구한다.

- KD의 이론적인 원리는 무엇인지?

- 무엇이 KD가 다른 모델보다 우수하게 만드는지?

- multiple teacher의 사용이 one teacher보다 나은지?

- larger모델이 항상 더 나은 teacher로 만드는지?

- student는 teacher가 있을때만 배울 수 있는지?

- student 스스로 학습할 수 있는지?

- off-line KD가 항상 online learning보다 나은지?

이 뿐만 아니라 neural architecture search(NAS), GNN, gating mechanism에 대해서도 다룬다. 논문 분량이 방대하기에 끊어서 출간하겠다.