트래픽 증가에 대한 두가지 대처방식

서비스의 규모가 커지거나 이용자수가 늘게되면 기존의 서버만으로는 원할한 서비스의 동작이 불가능하게 된다. 이에 대한 대처방법으로 크게 두가지가 있다.

1. 스케일 업(scale-up)

2. 스케일 아웃(scale-out)

이때, 스케일 아웃(scale-out) 방식으로 증가한 트래픽에 대처하기로 했다면, 여러대의 서버로 트래픽을 균등하게 분산시켜주는 로드밸런싱(Load Balancing)이 필요하다.

스케일 업(Scale-up)

기존 서버의 성능을 보다 높은 사양으로 향상시키는 방식이다. 서버 하나의 성능을 향상시키기 때문에 수직 스케일링(vertical scaling)이라고도 한다. 하드웨어적인 예를 들면, 서버에 디스크를 추가하거나 CPU메모리를 업그레이드 하는것을 말한다.

[스케일 업 장점]

- 스케일 업 아키텍처에서는 추가적인 네트워크 연결없이 용량을 증가시킬 수 있다.

- 스케일 아웃에 비해관리비용이나 운영이슈가 적고 사양만 높이면 되기 떄문에 비교적 설계가 쉽다.

- 여러대의 서버를 두는것보다 데이터 정합성이슈에서 비교적 자유롭다.

[스케일 업 단점]

- 기존의 서버를 교체하여 성능을 올릴때는 서비스를 이용할 수 없다.

- 성능향상에 한계가 있으며 성능향상에 대한 비용부담이 크다.

- 서버에 장애가 생길경우 서비스 전체를 이용할 수 없는 상황이 발생하는 등 장애의 영향을 크게 받는다.

스케일 아웃(Scale-out)

기존의 서버와 비슷한 성능의 서버를 증설하여 기존 서버의 부하를 분담하는 방식. 기존 서버만으로 용량이나 성능의 한계에 도달했을때 비슷한 사양의 서버를 추가로 연결해 처리할 수 있는 데이터 용량을 증가시키고 기존 서버의 부하를 분담해 성능향상의 효과를 기대할 수 있다. 서버를 추가로 확장하기 때문에 수평 스케일링(horizontal scaling)이라고도 한다.

참고로, 클라우드 서비스에는 자원 사용량을 모니터링하여 자동으로 서버를 증설하는 Auto Scaling기능도 있다.

[스케일 아웃 장점]

- 확장에 유연하다. 스케일 아웃 방식으로 서버를 구축해 놓은 경우 서버를 필요한 만큼 도입해두고 유연하게 서버를 추가하여 용량과 성능을 향상시킬 수 있다.

- 서버에 장애가 발생해도 다른 서버로 서비스를 제공할 수 있어 장애에 영향을 적게받는다.

- 병목현상 발생을 줄일 수 있다.

[스케일 아웃 단점]

- 여러 노드들을 연결하여 병렬 컴퓨팅 환경을 구성하고 유지하려면 아키텍처에 대한 높은 이해도가 요구된다.

- 서버의 수가 늘어날수록 관리가 힘들어진다.

- 여러 노드에 부하를 분산하기 위해 로드밸런싱에 대해 높은 이해도가 필요하다.

- 여러대의 서버로 구성되어있기 때문에 데이터 정합성 이슈가 발생할 수 있다. 모든 서버에서 데이터 일관성을 유지해야하기 때문에 설계 및 관리가 복잡하다.

- 클라우드 및 대규모 서비스 환경에 적합한 방식이다.

병렬 컴퓨팅 환경

여러개의 프로세스를 통해 하나의 프로그램을 처리하는 방법

로드밸런싱(LoadBalancing)

로드 밸런싱이란 서버가 처리해야할 요청(Load)을 여러대의 서버로 나누어(Balancing) 처리하는 것을 말한다. 한대의 서버로 부하가 집중되지 않도록 트래픽을 관리해 여러대의 서버가 각각 최적의 성능을 보일 수 있도록 하는것이 목적이다.

로드밸런싱 알고리즘

로드밸런싱 기법에는 여러가지가 있다. 서버에 성능에 맞추어 적절한 기법을 선택해서 사용해야한다.

- 라운드로빈 방식

- 가중 라운드로빈 방식

- IP 해시방식

- 최소연결방식

- 최소응답시간방식

라운드로빈 방식

서버에 들어온 요청을 순서대로 돌아가며 배정하는 방식이다. 클라이언트의 요청을 순서대로 분배하기 때문에 여러대의 서버가 동일한 스펙을 가지고 있고, 서버와의 연결(세션)이 오래 지속되지 않는 경우에 적합하다.

가중 라운드로빈 방식

각각의 서버에 가중치를 매기고 가중치가 높은 서버부터 클라이언트의 요청을 우선적으로 분배한다. 주로 서버의 트래픽 처리 능력이 상이한 경우 사용되는 부하 분산 방식이다.

예를들어, A 서버가 5 그리고 B서버가 2 만큼의 가중치를 가지고 있다면 로드 밸런서는 라운드로빈 방식으로 A서버에 5개의 요청을, B서버에 2개의 요청을 각각 전달한다.

IP 해시방식

클라이언트의 IP 주소를 특정 서버로 매핑하여 요청을 처리하는 방식이다. 사용자의 IP를 해싱하여 로드를 분배하기 때문에 사용자가 항상 동일한 서버로 연결되는것을 보장한다.

해싱

임의의 길이를 지닌 데이터를 고정된 길이의 데이터로 매핑하는 것 또는 그러한 함수

최소연결 방식

요청이 들어온 시점에 가장 적은 연결 상태를 보이는 서버에 우선적으로 요청을 배분한다. 자주 세션이 길어지거나 서버에 분배된 트래픽들이 일정하지 않은 경우에 적합한 방식이다.

최소응답시간 방식

서버의 현재 연결 상태와 응답 시간을 모두 고려하여 트래픽을 배분한다. 가장 적은 연결상태와 가장 짧은 응답시간을 보이는 서버에 우선적으로 요청을 배분한다.

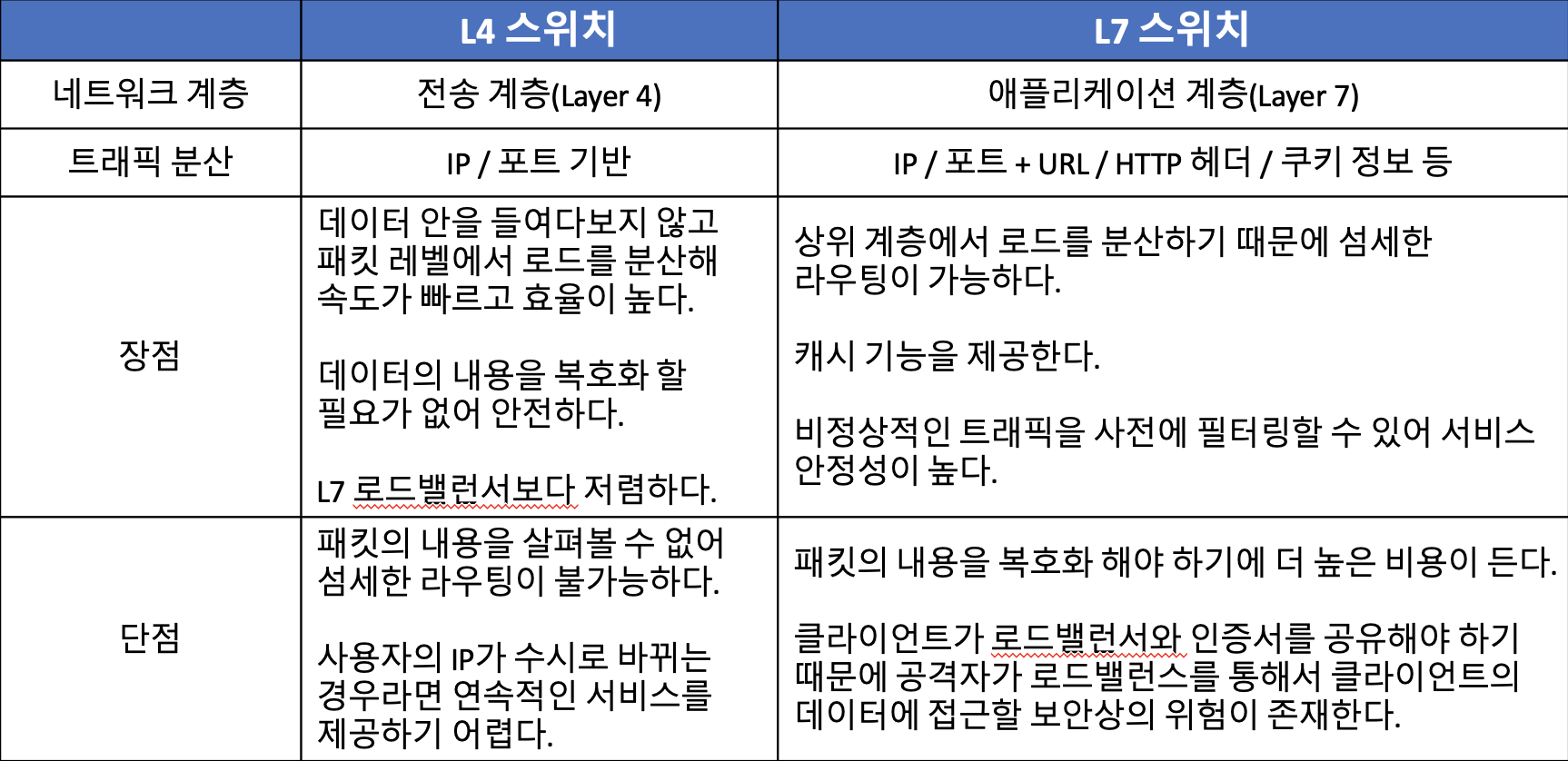

L7 로드밸런싱과 L4 로드밸런싱

로드 밸런싱에는 L4 로드밸런싱과 L7 로드밸런싱이 가장 많이 활용된다.

L4, L7은 각각 Layer4(전송계층) 프로토콜과 Layer7(응용계층) 프로토콜의 헤더를 부하분산에 이용하기 때문에 붙은 접두사이다. 모든 요청을 L4 또는 L7 로드밸런서가 받아 서버들에게 배분한다.

L4 로드밸런서는 네트워크 계층(IP)이나 전송계층(TCP,UDP)의 정보(IP주소, 포트번호, MAC주소, 전송 프로토콜)를 바탕으로 로드를 분산한다.

L7로드 밸런서는 애플리케이션 계층(HTTP, FTP, SMTP)에서 로드를 분산하기 때문에 HTTP 헤더, 쿠키등과 같은 사용자의 요청을 기준으로 특정 서버에 트래픽을 분산하는 것이 가능하다. 다시말해, 패킷의 내용을 확인하고 그 내용에 따라 로드를 특정 서버에 분배할 수 있다. URL에 따라 부하를 분산시키거나 HTTP 헤더의 쿠키값에 따라 부하를 분산하는 등 클라이언트의 요청을 보다 세분화하여 서버에 전달하는 것이 가능하다. 또한, L7 로드밸런서의 경우 특정한 패턴을 지닌 바이러스를 감지하여 네트워크를 보호할 수 있다. Dos/DDos 같은 비정상적인 트래픽을 감지해 필터링할 수 있어 네트워크 보안에도 활용된다.

잘 봤습니다. 좋은 글 감사합니다.