선형 회귀와 가설, 손실 함수 Hypothesis & Cost Function (Loss function)

선형회귀 / 가설 / 손실 함수

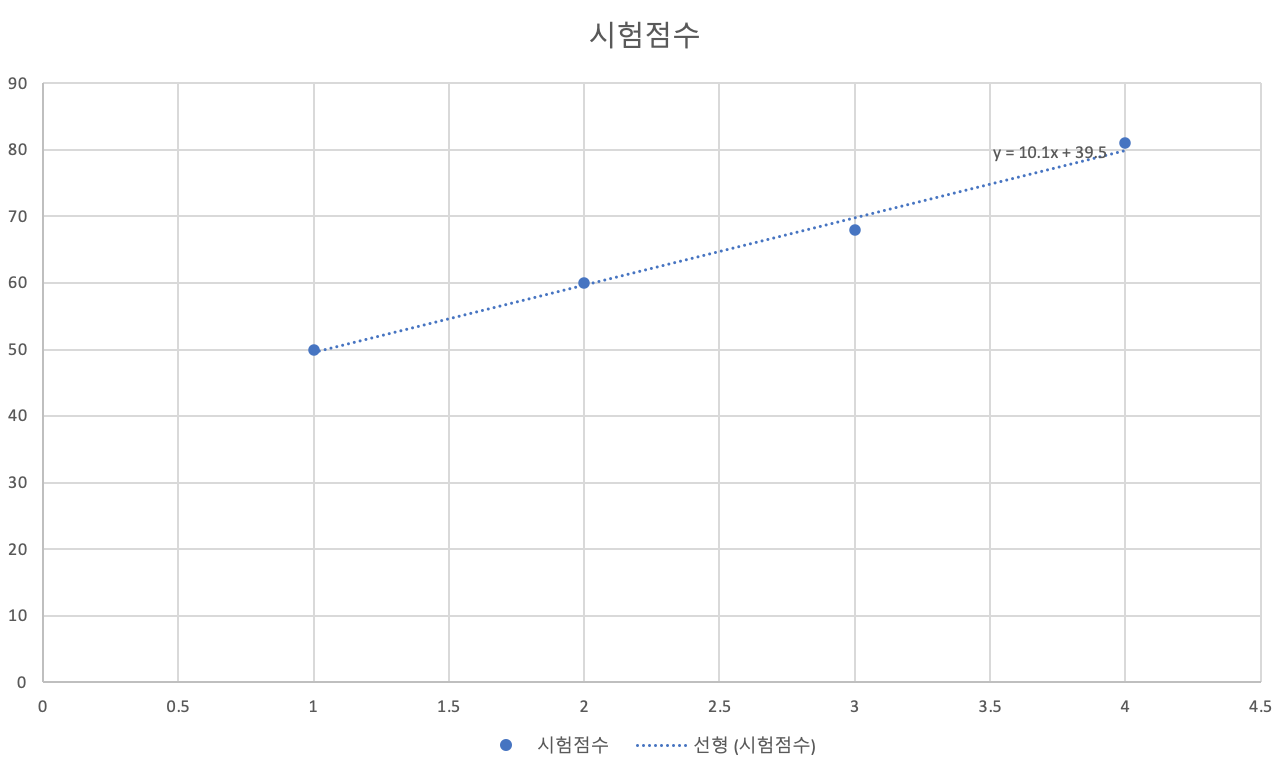

위 그래프는 직선형태로 1차 함수로 표현이 가능하다. H(x) = Wx + b 정학한 예측을 위하여 임의의 직선(가설)과 점(정답)의 거리가 가까워지도록 해줘야 한다. (= mean suared error, Cost function)

임의의 직선 H(x)를 가설(Hypothesis)라고 하고,

Cost를 손실 함수(Cost or Loss function)이라고 함.

다중 선형 회귀(Multi-variable Linear regression)

입력값이 2개 이상이 되는 문제를 선형 회귀로 풀고 싶을 때 사용하는 방법.