aspose

설치

pip install aspose-words

실행

import os

import json

import random

import aspose.words as aw

import tempfile

import re

lic = aw.License()

lic.set_license("라이센스경로")

def aspose_filter(file_path:str) -> str:

with tempfile.TemporaryDirectory() as temp_dir:

pdf = aw.Document(file_path)

save_path = os.path.join(temp_dir, "pdf.md")

pdf.save(save_path)

with open(save_path, "r") as f:

text = f.read()

return text

file_path = "./test_data/[별첨] 지방은행의 시중은행 전환시 인가방식 및 절차.pdf"

text = aspose_filter(file_path)

print(text)

단순한 표

결과

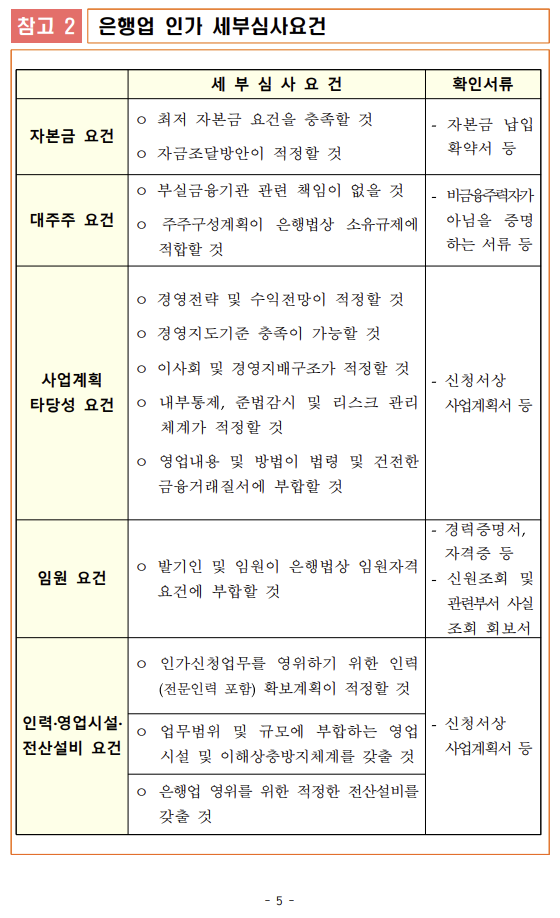

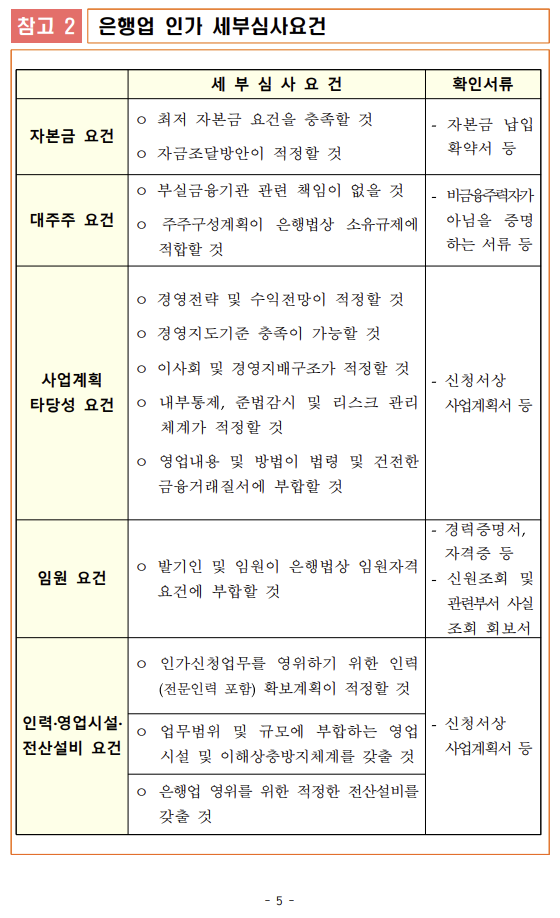

참고 2 은행업 인가 세부심사요건

<table><tr><th colspan="1"></th><th colspan="1" valign="top"><b>세 부 심 사 요 건</b></th><th colspan="1" valign="top"><b>확인서류</b></th></tr>

<tr><td colspan="1" valign="top"><b>자본금 요건</b></td><td colspan="1" valign="top">ㅇ 최저 자본금 요건을 충족할 것 ㅇ 자금조달방안이 적정할 것</td><td colspan="1">- 자본금 납입 확약서 등</td></tr>

<tr><td colspan="1" valign="top"><b>대주주 요건</b></td><td colspan="1"><p>ㅇ 부실금융기관 관련 책임이 없을 것</p><p>ㅇ 주주구성계획이 </p><p>은행법상 소유규제에 </p><p>적합할 것</p></td><td colspan="1">- 비금융주력자 가 아님을 증명 하는 서류 등</td></tr>

<tr><td colspan="1" valign="top"><b>사업계획 타당성 요건</b></td><td colspan="1"><p>ㅇ 경영전략 및 수익전망이 적정할 것</p><p>ㅇ 경영지도기준 충족이 가능할 것</p><p>ㅇ 이사회 및 경영지배구조가 적정할 것 ㅇ 내부통제 , 준법감시 및 리스크 관리 </p><p>체계가 적정할 것</p><p>ㅇ 영업내용 및 방법이 법령 및 건전한</p><p>금융거래질서에 부합할 것</p></td><td colspan="1">- 신청서상 사업계획서 등</td></tr>

<tr><td colspan="1" valign="top"><b>임원 요건</b></td><td colspan="1"><p>ㅇ 발기인 및 임원이 은행법상 임원자격</p><p>요건에 부합할 것</p></td><td colspan="1"><p>- 경력증명서 , 자격증 등</p><p>- 신원조회 및 관련부서 사실 조회 회보서</p></td></tr>

<tr><td colspan="1" rowspan="3" valign="top"><b>인력·영업시설· 전산설비 요건</b></td><td colspan="1"><p>ㅇ 인가신청업무를 영위하기 위한 인력</p><p>(전문인력 포함 ) 확보계획이 적정할 것</p></td><td colspan="1" rowspan="3"><p>- 신청서상 사업계획서 </p><p>등</p></td></tr>

<tr><td colspan="1"><p>ㅇ 업무범위 및 규모에 부합하는 영업</p><p>시설 및 이해상충방지체계를 갖출 것</p></td></tr>

<tr><td colspan="1"><p>ㅇ 은행업 영위를 위한 적정한 전산설비를</p><p>갖출 것</p></td></tr>

</table>

다단표

결과

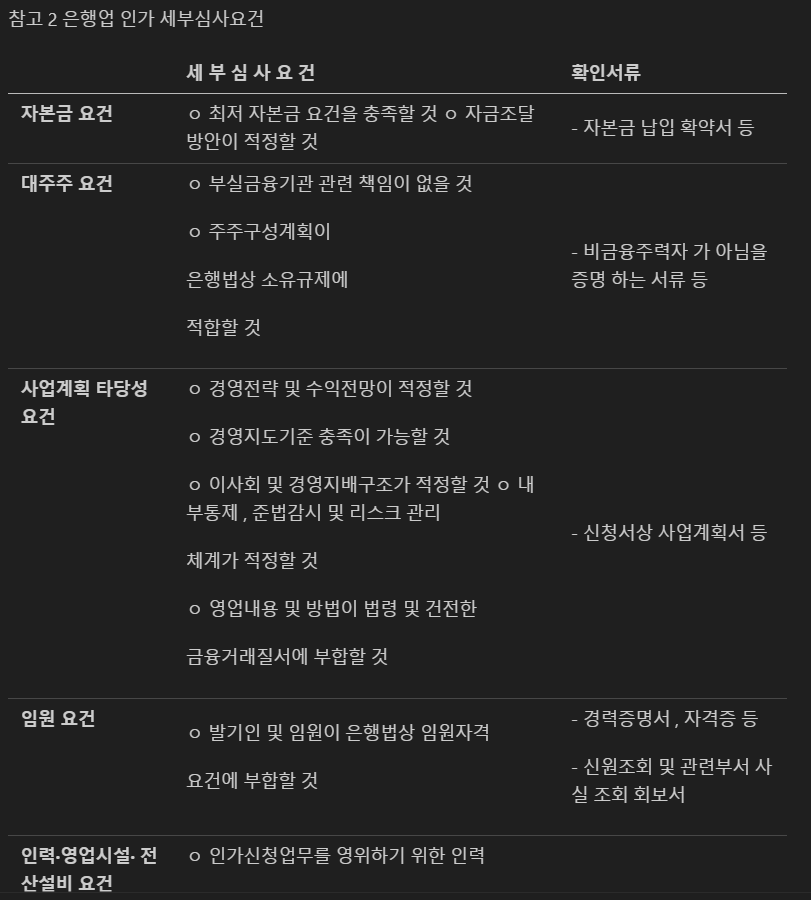

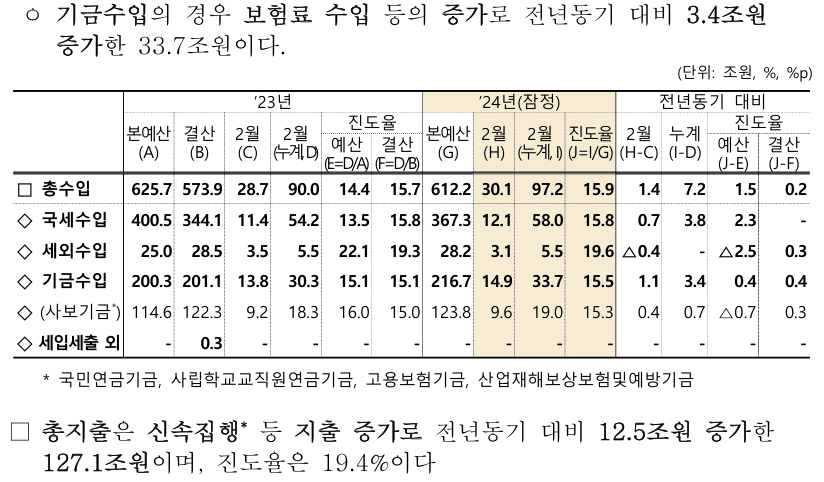

` `ㅇ 기금수입의 경우 보험료 수입 등의 증가로 전년동기 대비 3.4조원

증가한 33.7조원이다.

(단위: 조원, %, %p)

<table><tr><th colspan="1" rowspan="3"></th><th colspan="6">’23년</th><th colspan="4">’24년(잠정)</th><th colspan="4">전년동기 대비</th></tr>

<tr><td colspan="1" rowspan="2">본예산 (A)</td><td colspan="1" rowspan="2">결산 (B)</td><td colspan="1" rowspan="2">2월 (C)</td><td colspan="1" rowspan="2">2월 (누계,D)</td><td colspan="2" valign="top">진도율</td><td colspan="1" rowspan="1">본예산 (G)</td><td colspan="1" rowspan="2">2월 (H)</td><td colspan="1" rowspan="2">2월 (누계,I)</td><td colspan="1" rowspan="2">진도율 (J=I/G)</td><td colspan="1" rowspan="2">2월 (H-C)</td><td colspan="1" rowspan="2">누계 (I-D)</td><td colspan="2" valign="top">진도율</td></tr>

<tr><td colspan="1">예산 (E=D/A)</td><td colspan="1">결산 (F=D/B)</td><td colspan="1">예산 (J-E)</td><td colspan="1">결산 (J-F)</td></tr>

<tr><td colspan="1"><b>□ 총수입</b></td><td colspan="1"><b>625.7</b></td><td colspan="1"><b>573.9</b></td><td colspan="1"><b>28.7</b></td><td colspan="1"><b>90.0</b></td><td colspan="1"><b>14.4</b></td><td colspan="1"><b>15.7</b></td><td colspan="1"><b>612.2</b></td><td colspan="1"><b>30.1</b></td><td colspan="1"><b>97.2</b></td><td colspan="1"><b>15.9</b></td><td colspan="1"><b>1.4</b></td><td colspan="1"><b>7.2</b></td><td colspan="1"><b>1.5</b></td><td colspan="1"><b>0.2</b></td></tr>

<tr><td colspan="1" valign="top"><p>- <b>국세수입</b></p><p>- <b>세외수입</b></p><p>- <b>기금수입</b></p><p>- (사보기금*)</p><p>- <b>세입세출 외</b></p></td><td colspan="1" valign="top"><b>400.5 25.0 200.3</b> 114.6 <b>-</b></td><td colspan="1" valign="top"><b>344.1 28.5 201.1</b> 122.3 <b>0.3</b></td><td colspan="1" valign="top"><b>11.4 3.5 13.8</b> 9.2 <b>-</b></td><td colspan="1" valign="top"><b>54.2 5.5 30.3</b> 18.3 <b>-</b></td><td colspan="1" valign="top"><b>13.5 22.1 15.1</b> 16.0 <b>-</b></td><td colspan="1" valign="top"><b>15.8 19.3 15.1</b> 15.0 <b>-</b></td><td colspan="1" valign="top"><b>367.3 28.2 216.7</b> 123.8 <b>-</b></td><td colspan="1" valign="top"><b>12.1 3.1 14.9</b> 9.6 <b>-</b></td><td colspan="1" valign="top"><b>58.0 5.5 33.7</b> 19.0 <b>-</b></td><td colspan="1" valign="top"><b>15.8 19.6 15.5</b> 15.3 <b>-</b></td><td colspan="1" valign="top"><p><b>0.7 △0.4</b></p><p><b>1.1</b> 0.4 <b>-</b></p></td><td colspan="1" valign="top"><b>3.8 - 3.4</b> 0.7 <b>-</b></td><td colspan="1" valign="top"><p><b>2.3 △2.5</b></p><p><b>0.4</b> △0.7 <b>-</b></p></td><td colspan="1" valign="top"><b>- 0.3 0.4</b> 0.3 <b>-</b></td></tr>

</table>

* 국민연금기금, 사립학교교직원연금기금, 고용보험기금, 산업재해보상보험및예방기금

- 총지출은 신속집행\* 등 지출 증가로 전년동기 대비 12.5조원 증가한 127.1조원이며, 진도율은 19.4%이다

2단문서 (가로)

결과

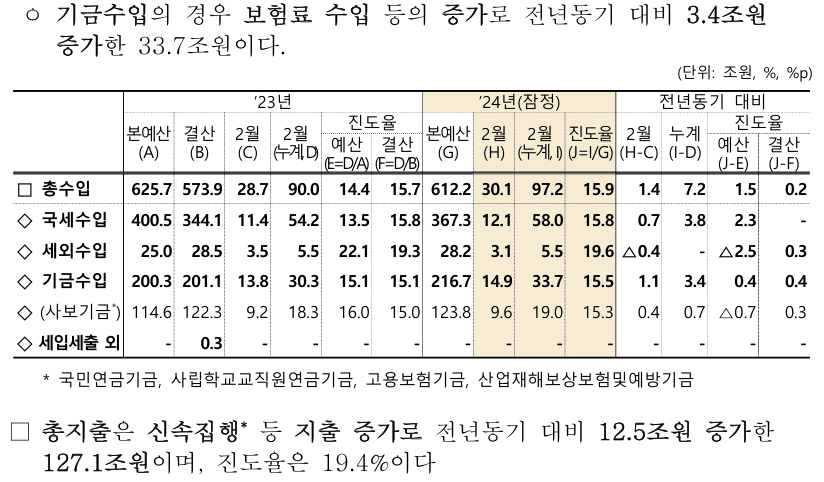

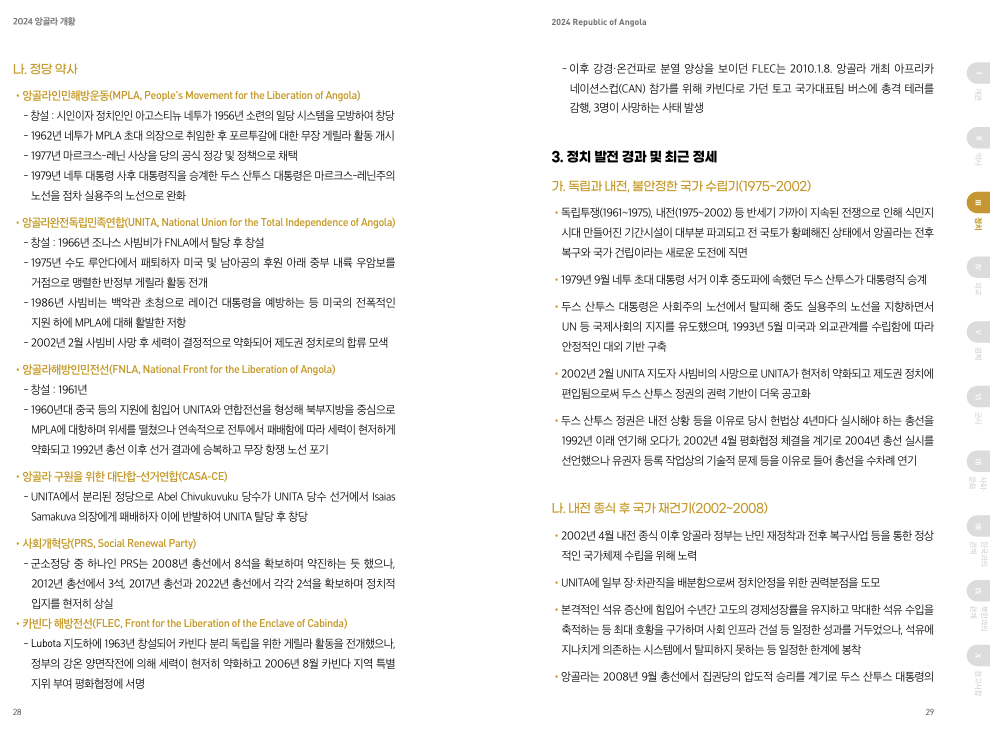

나. 정당 약사

- 앙골라인민해방운동(MPLA, People’s Movement for the Liberation of Angola)

- 창설 : 시인이자 정치인인 아고스티뉴 네투가 1956년 소련의 일당 시스템을 모방하여 창당

- 1962년 네투가 MPLA 초대 의장으로 취임한 후 포르투갈에 대한 무장 게릴라 활동 개시

- 1977년 마르크스-레닌 사상을 당의 공식 정강 및 정책으로 채택

- 1979년 네투 대통령 사후 대통령직을 승계한 두스 산투스 대통령은 마르크스-레닌주의 노선을 점차 실용주의 노선으로 완화

- 앙골라완전독립민족연합(UNITA, National Union for the Total Independence of Angola

- 창설 : 1966년 조나스 사빔비가 FNLA에서 탈당 후 창설

- 1975년 수도 루안다에서 패퇴하자 미국 및 남아공의 후원 아래 중부 내륙 우암보를 거점으로 맹렬한 반정부 게릴라 활동 전개

- 1986년 사빔비는 백악관 초청으로 레이건 대통령을 예방하는 등 미국의 전폭적인 지원 하에 MPLA에 대해 활발한 저항

- 2002년 2월 사빔비 사망 후 세력이 결정적으로 약화되어 제도권 정치로의 합류 모색

- 앙골라해방인민전선(FNLA, National Front for the Liberation of Angola)

- 창설 : 1961년

- 1960년대 중국 등의 지원에 힘입어 UNITA와 연합전선을 형성해 북부지방을 중심으로 MPLA에 대항하며 위세를 떨쳤으나 연속적으로 전투에서 패배함에 따라 세력이 현저하게 약화되고 1992년 총선 이후 선거 결과에 승복하고 무장 항쟁 노선 포기

- 앙골라 구원을 위한 대단합-선거연합(CASA-CE)

- UNITA에서 분리된 정당으로 Abel Chivukuvuku 당수가 UNITA 당수 선거에서 Isaias Samakuva 의장에게 패배하자 이에 반발하여 UNITA 탈당 후 창당

- 사회개혁당(PRS, Social Renewal Party)

- 군소정당 중 하나인 PRS는 2008년 총선에서 8석을 확보하며 약진하는 듯 했으나, 2012년 총선에서 3석, 2017년 총선과 2022년 총선에서 각각 2석을 확보하며 정치적 입지를 현저히 상실

- 카빈다 해방전선(FLEC, Front for the Liberation of the Enclave of Cabinda)

- Lubota 지도하에 1963년 창설되어 카빈다 분리 독립을 위한 게릴라 활동을 전개했으나, 정부의 강온 양면작전에 의해 세력이 현저히 약화하고 2006년 8월 카빈다 지역 특별 지위 부여 평화협정에 서명

- �이후 강경·온건파로 분열 양상을 보이던 FLEC는 2010.1.8. 앙골라 개최 아프리카 네이션스컵(CAN) 참가를 위해 카빈다로 가던 토고 국가대표팀 버스에 총격 테러를 감행, 3명이 사망하는 사태 발생

3. **정치 발전 경과 및 최근 정세![ref3]![ref10]**

가. 독립과 내전, 불안정한 국가 수립기(1975~2002) ![ref11]

- 독립투쟁(1961~1975), 내전(1975~2002) 등 반세기 가까이 지속된 전쟁으로 인해 식민지

)

시대 만들어진 기간시설이 대부분 파괴되고 전 국토가 황폐해진 상태에서 앙골라는 전후 복구와 국가 건립이라는 새로운 도전에 직면 ![ref5]

2단문서 (세로)

결과

BERT: Pre-training of Deep Bidirectional Transformers for

Language Understanding

Jacob Devlin Ming-Wei Chang Kenton Lee Kristina Toutanova Google AI Language

fjacobdevlin,mingweichang,kentonl,kristoutg@google.com

Abstract

We introduce a new language representa- tion model called BERT, which stands for Bidirectional Encoder Representations from Transformers. Unlike recent language repre- sentation models [(Peters et al., 2018a;](#_page10_x67.02_y719.13)[ Rad- ford et al., 2018](#_page10_x302.29_y137.42)), BERT is designed to pre- train deep bidirectional representations from unlabeled text by jointly conditioning on both left and right context in all layers. As a re- sult, the pre-trained BERT model can be fine- tuned with just one additional output layer to create state-of-the-art models for a wide range of tasks, such as question answering and language inference, without substantial task- specificarchitecture modifications.

BERT is conceptually simple and empirically powerful. It obtains new state-of-the-art re- sults on eleven natural language processing tasks, including pushing the GLUE score to 80.5% (7.7% point absolute improvement), MultiNLI accuracy to 86.7% (4.6% absolute improvement), SQuAD v1.1 question answer- ing Test F1 to 93.2 (1.5 point absolute im- provement) and SQuAD v2.0 Test F1 to 83.1 (5.1 point absolute improvement).

1 Introduction

Language model pre-training has been shown to be effective for improving many natural language processing tasks [(Dai and Le, 2015;](#_page9_x302.29_y303.57)[ Peters et al., 2018a;](#_page10_x67.02_y719.13)[ Radford et al., 2018;](#_page10_x302.29_y137.42)[ Howard and Ruder, 2018](#_page9_x302.29_y620.72)). These include sentence-level tasks such as natural language inference [(Bowman et al., 2015; ](#_page9_x67.02_y401.06)[Williams et al.,](#_page11_x67.02_y248.47) [2018)](#_page11_x67.02_y248.47) and paraphrasing [(Dolan and Brockett, 2005](#_page9_x302.29_y391.02)), which aim to predict the re- lationships between sentences by analyzing them holistically, as well as token-level tasks such as named entity recognition and question answering, where models are required to produce fine-grained output at the token level [(Tjong Kim Sang and De Meulder, 2003;](#_page10_x302.29_y475.49)[ Rajpurkar et al., 2016](#_page10_x302.29_y190.11)).

�There are two existing strategies for apply- ing pre-trained language representations to down- stream tasks: feature-based and fine-tuning. The feature-based approach, such as ELMo [(Peters et al., 2018a](#_page10_x67.02_y719.13)), uses task-specific architectures that include the pre-trained representations as addi- tional features. The fine-tuning approach, such as the Generative Pre-trained Transformer (OpenAI GPT) [(Radford et al., 2018](#_page10_x302.29_y137.42)), introduces minimal task-specific parameters, and is trained on the downstream tasks by simply fine-tuning all pre- trained parameters. The two approaches share the sameobjectivefunctionduringpre-training,where they use unidirectional language models to learn general language representations.

줄없는표

결과

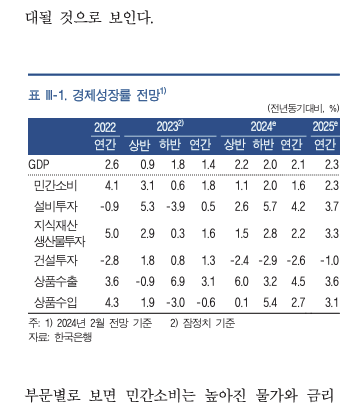

대될 것으로 보인다 .

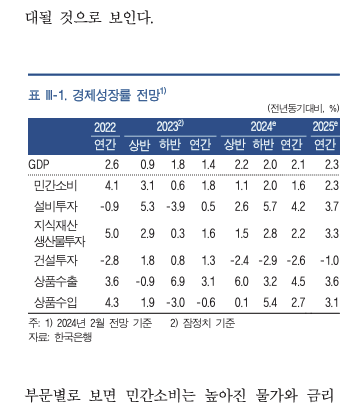

표 III-1. 경제성장률 전망 1)

(전년동기대비 , %) 2022 20232) 2024e 2025e

연간 상반 하반 연간 상반 하반 연간 연간 GDP 2.6 0.9 1.8 1.4 2.2 2.0 2.1 2.3 민간소비 4.1 3.1 0.6 1.8 1.1 2.0 1.6 2.3 설비투자 -0.9 5.3 -3.9 0.5 2.6 5.7 4.2 3.7 지식재산

5\.0 2.9 0.3 1.6 1.5 2.8 2.2 3.3

` `생산물투자

` `건설투자 -2.8 1.8 0.8 1.3 -2.4 -2.9 -2.6 -1.0 상품수출 3.6 -0.9 6.9 3.1 6.0 3.2 4.5 3.6 상품수입 4.3 1.9 -3.0 -0.6 0.1 5.4 2.7 3.1

주: 1) 2024년 2월 전망 기준 2) 잠정치 기준 자료 : 한국은행

부문별로 보면 민간소비는 높아 진 물가와 금리

비정형문서

결과

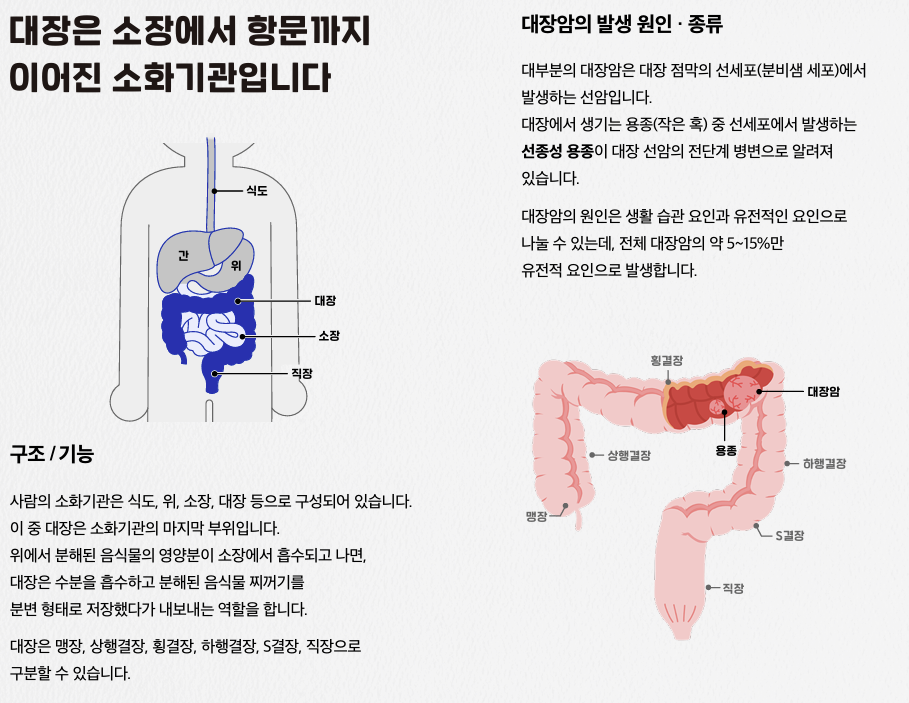

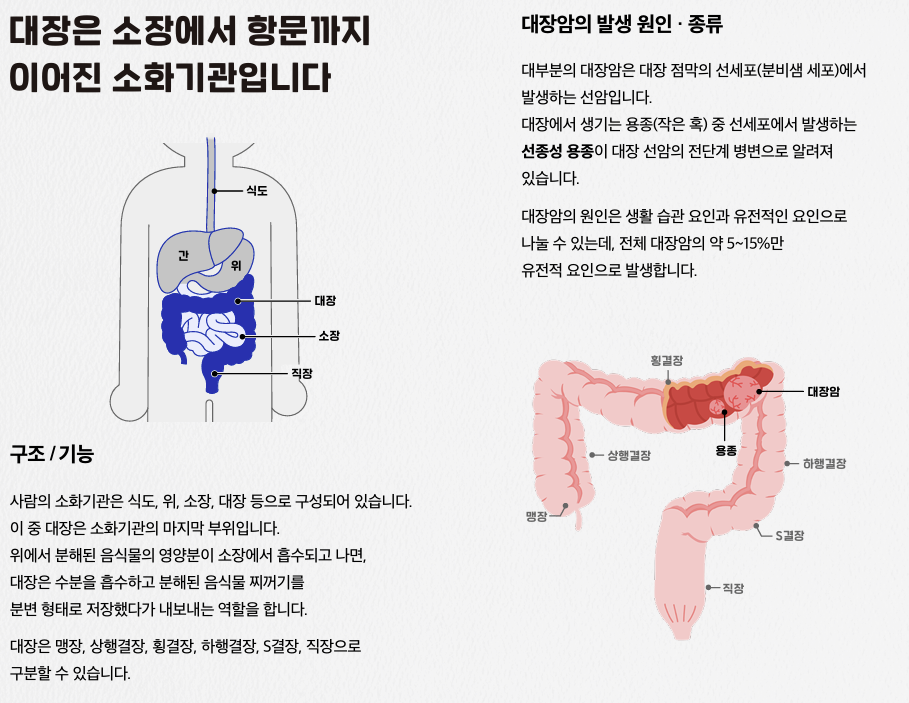

대장은 소장에서 항문까지 이어진 소화기관입니다

식도

간

위

대장

소장

직장

구조 / 기능

사람의 소화기관은 식도, 위, 소장, 대장 등으로 구성되어 있습니다. 이 중 대장은 소화기관의 마지막 부위입니다.

위에서 분해된 음식물의 영양분이 소장에서 흡수되고 나면, 대장은 수분을 흡수하고 분해된 음식물 찌꺼기를

분변 형태로 저장했다가 내보내는 역할을 합니다.

�대장암의 발생 원인 · 종류

대부분의 대장암은 대장 점막의 선세포(분비샘 세포)에서 발생하는 선암입니다.

대장에서 생기는 용종(작은 혹) 중 선세포에서 발생하는 선종성 용종이 대장 선암의 전단계 병변으로 알려져 있습니다.

대장암의 원인은 생활 습관 요인과 유전적인 요인으로 나눌 수 있는데, 전체 대장암의 약 5~15%만

유전적 요인으로 발생합니다.