Hugging Face(허깅 페이스)

- 트랜스포머를 기반으로 하는 다양한 모델과 학습 스크립트를 구현해 놓은 모듈

필자는 트랜스포머의 인코더 부분만 사용해야하기에 허깅 페이스의 BERT 모듈을 이용하기로 하였다.

허깅 페이스의 'BERT'이용하기

작동방식

- 토큰화

-

WordPiece : 단어를 여러개의 서브워드나 문자로 분리하는 방식

(일반적인 형태소 분석, 토큰화와는 다른 방식)

BertTokenizer사용 -

특별 토큰 추가 : BERT는 시작과 끝에

[CLS]와[SEP]이라는 특별한 토큰을 추가한다.

BertTokenizer사용

- 정수 인코딩

- 단어나 서브워드를 해당하는 정수 ID로 변환한다.

- 어텐션 마스크 생성

- BERT에 입력되는 문장들은 모두 동일한 길이어야하므로 패딩토큰으로 채워줌

- 어텐션 마스크는 모델이 패딩토큰을 무시하게 도와줌

- BERT의 기본 입력

input_ids: 각 토큰의 정수 ID를 담고있는 배열attention_mask: 어텐션 마스크 배열token_type_ids: 질의응답과 같이 두 개의 문장을 한번에 BERT에 입력할 경우, 각 문장을 구분해주는 역할

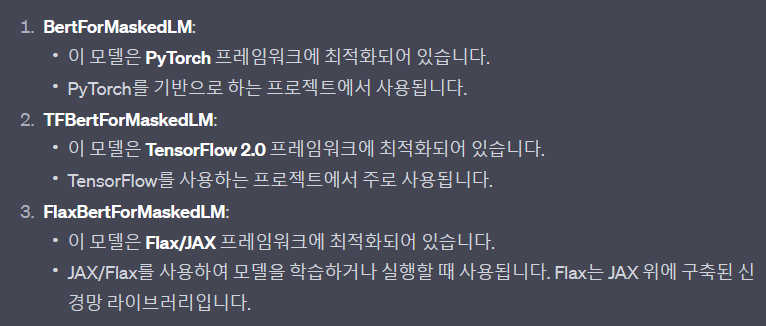

제공하는 세 가지 방식의 모델