Linear Regression

Predicting exam score: regression

어떤 학생이 몇 시간정도 공부를 했더니 얼마정도의 성적이 나왔다라는 데이터를 가지고Supervised learning한다고 진행.

| x(hours) | y(score) |

|---|---|

| 10 | 90 |

| 9 | 80 |

| 3 | 50 |

| 2 | 30 |

- 0~100점의 범위를 예측하는 것이기 때문에 이런 형태는 supervised learning의

regression이라 부릅니다. - 위의 데이터를 가지고 학습을 시키는데 이 과정을

training이라 부릅니다. - 위의 표는

training data라고 부르면 됩니다. - regression모델이 데이터를 학습을 끝나고 모델이 만들어지게 됩니다.

- 학생이 7시간 정도 공부를 했는데 인공지능에게 물어보면 65점도 받을 수 있겠구나 예측을 할 것입니다.

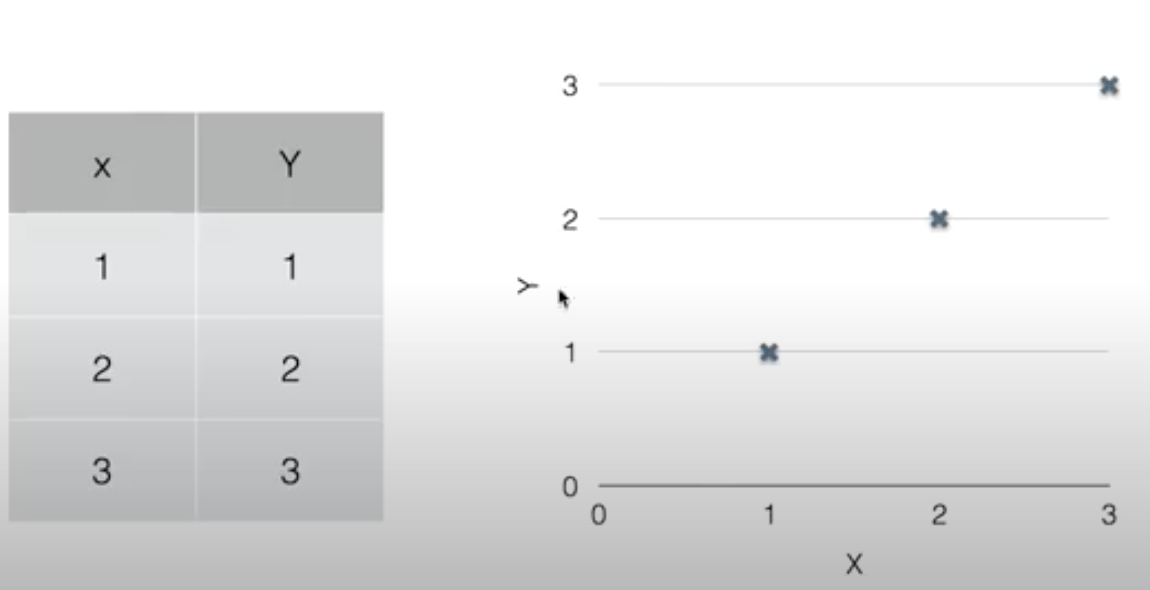

Regression (data)

- regression의 모델을 학습한다는 것은 어떤 하나의 가설을 세울 필요가 있습니다.

Linear한 모델이 우리 데이터에 맞을 것이다라고 가설을 세우는 것이Linear Regression입니다.Linear Regression세상에 있는 많은 데이터, 현상들이 Linear한 경우로 드러나는 것이 많이 존재합니다.- Linear하게 가설을 세운다는 것은 잘 맞는 선을 찾는다고 생각할 수 있습니다. 어떤 것이 이 데이터에 잘 맞는 선일까? 선을 찾는 것을 학습한다고 생각할 수 있습니다.

Cost Function

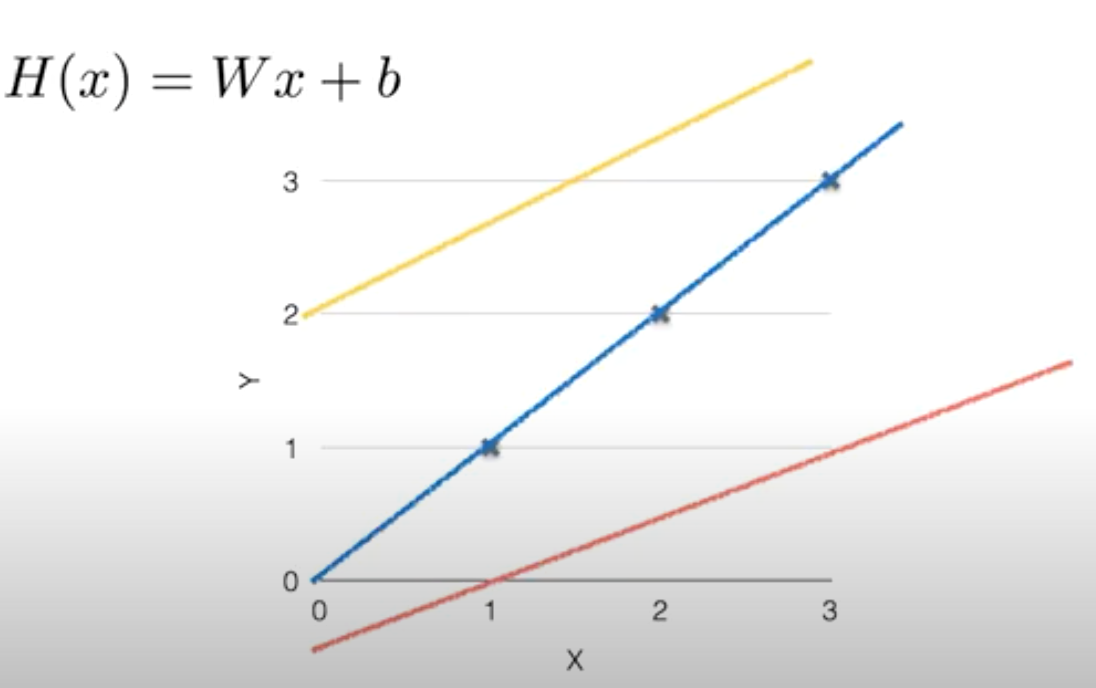

- 선들 중에서 가장 잘 맞는 선이 무엇인지 찾아야 합니다.

H(x) = Wx + b- 파랑 H(x) = 1 * x + 0

- 노랑 H(x) = 0.5 * x + 2

- 두 선 중에서 어떤 선이 더 좋은지 찾아야 합니다.

- 실제 데이터와 가설들과의 점들과 거리를 비교합니다.

- 거리가 멀면 나쁘고, 가까우면 좋습니다.

- 거리가 멀면 나쁘고, 가까우면 좋습니다.

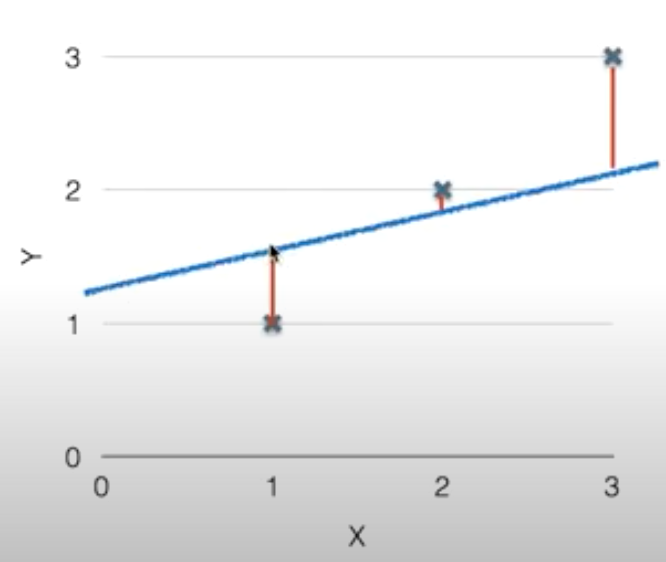

Linear Regression에서는 거리를 측정하는 것을Cost funcionorLoss function이라 부릅니다.- 우리가 세운 가설과 실제 데이터가 얼마나 다른가를 나타내게 됩니다.

- 기본적인 계산은 차이를 계산하는 것입니다.

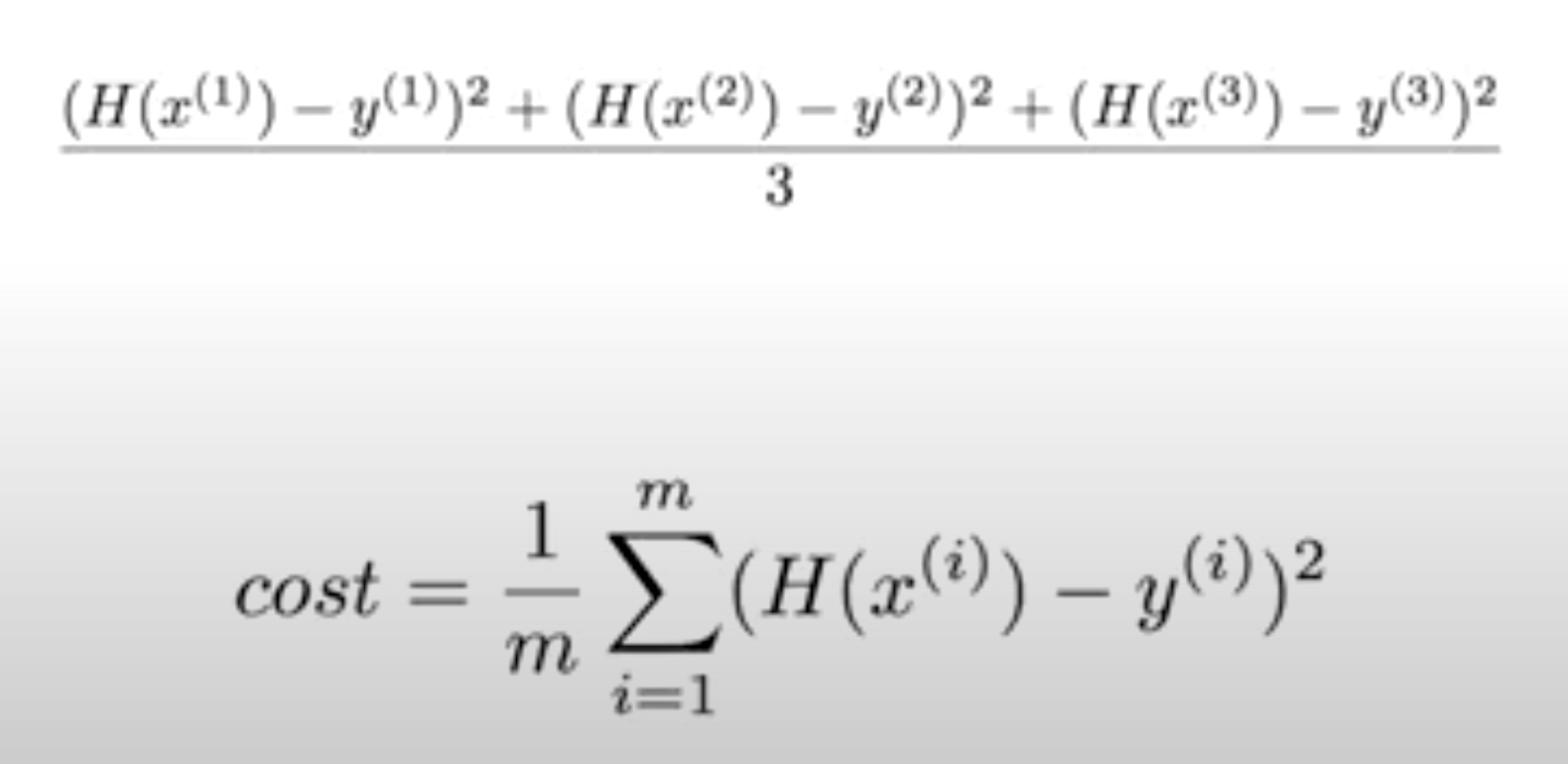

- (H(x) - y) 2

- 제곱을 하게되면 일정하게 차이를 양수로 표현해주면 차이가 클 때 패널티를 많이 주게 되면서, 차이를 작게 만들 수 있는 중요한 값을 나타낼 수 있습니다.

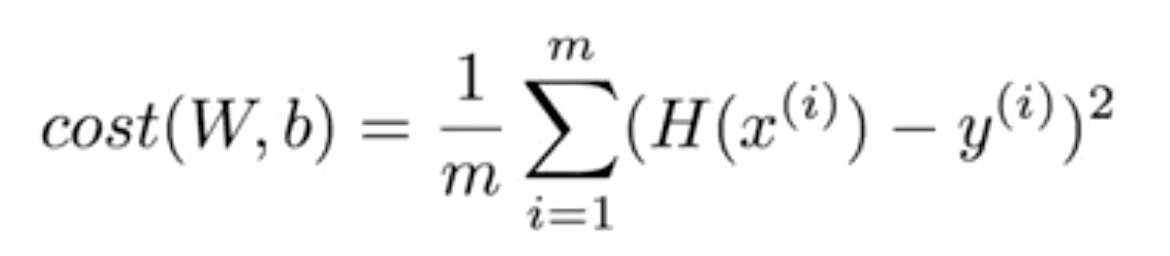

- 표현을 하게 되면 아래와 같습니다.

- 가장 작은 값을 갖는 W, b를 구하는 것이 Linear Regression의 학습입니다.