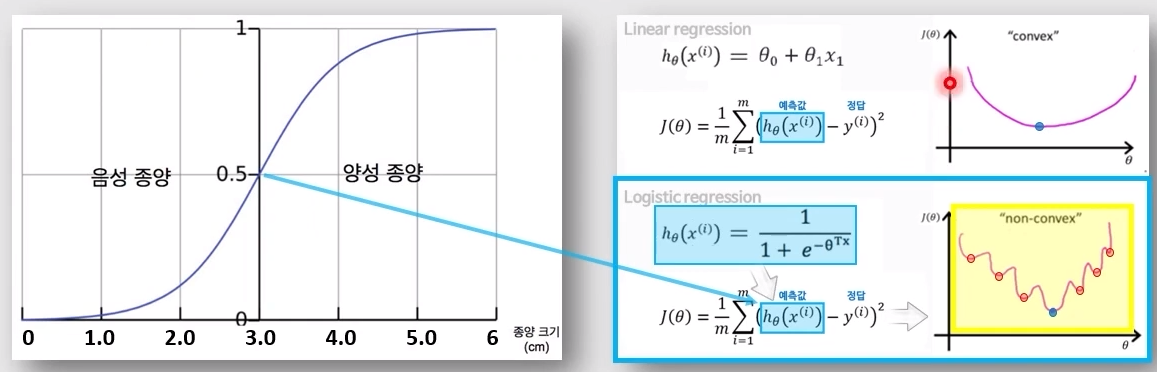

=> sigmoid 함수를 MSE에 넣으면 깊은 함정들이 많이 생긴다. (sigmoid 함수가 지수함수가 포함되어 있기에!)

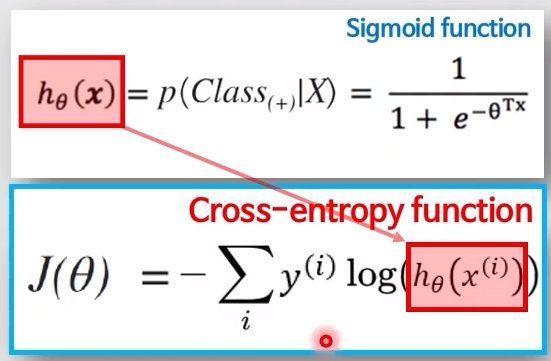

Cross entrophy : 분류 모델의 대표적 Cost Function

- 아슬아슬하게 맞추고 확실하게 틀리는 모델

- 확실하게 맞추고 아슬아슬하게 틀리는 모델

2번이 더 좋음! => 어떻게 알지? => By Cross Entrophy

- 단순히 맞추고 틀리는 가보다 얼마나 확신을 가지고 맞추는가!

Cross Entrophy : 어떤 하나의 분포를 다른 분포로 이동시키는 데까지의 거리

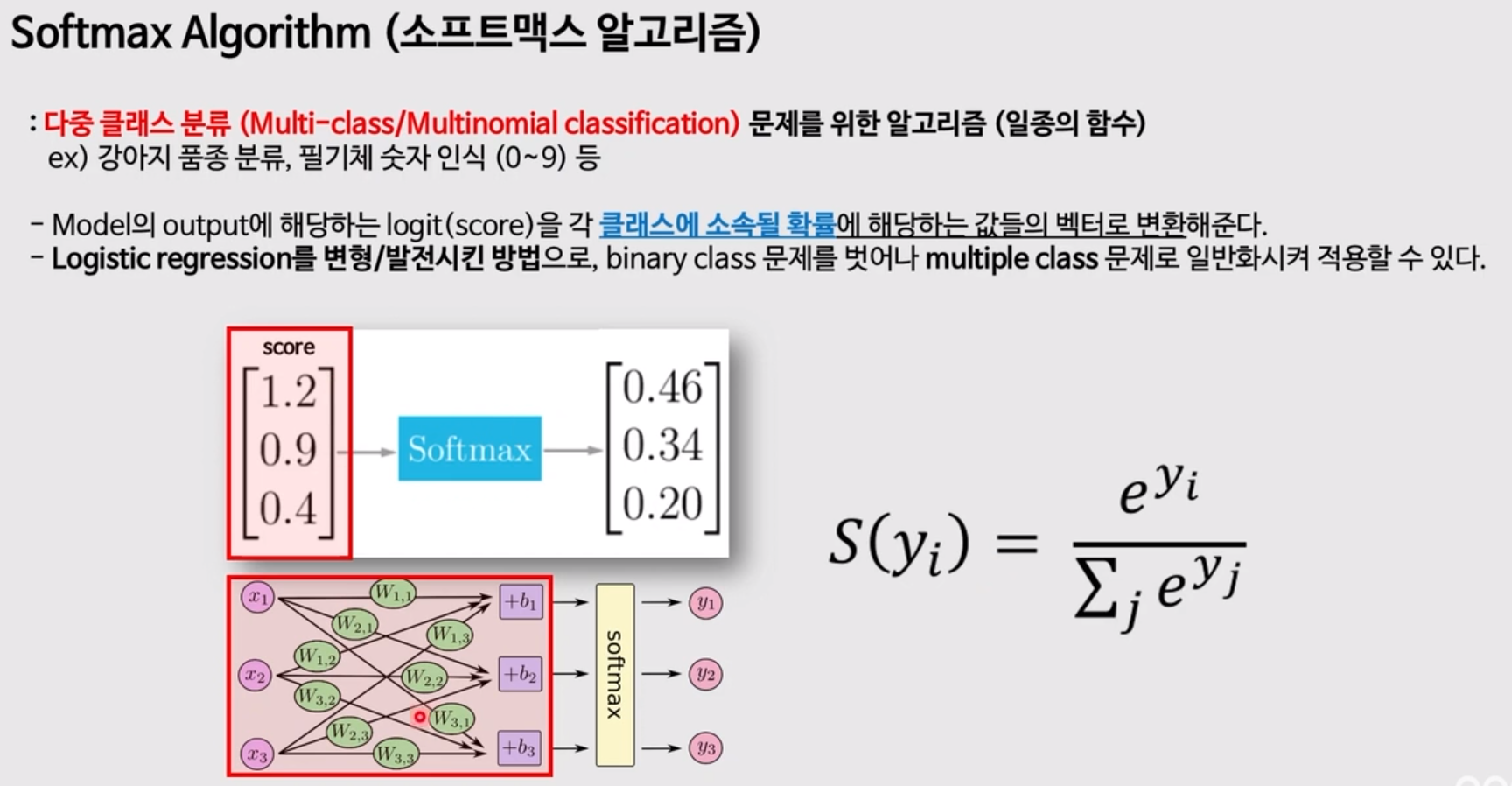

SoftMax : logistic regression에서 class 0 , class 1의 확률값 2개만을 알려주다가 N개의 확률값을 알려줌!

하나의 instance(1개의 행, column)를 입력값으로 넣으면 결과값으로 분류를 해주고, 그 때 분류한 결과가 어떤 값으로 나오는데, 이를 soft Max 알고리즘을 통해 확률값으로 바꿔주고, 그 확률값을 통해 얻은 모델이 예상한 정답 데이터를 one - hot encoding을 해서 one-hot label로 바꿔준 후 확률값 행렬과 one-hot label data를 Cross Entrophy를 통해 계산하여 모델이 얼마나 확신을 가지고 맞추는 지를 평가한다!