Neural Networks(신경망)에서의 선형변환

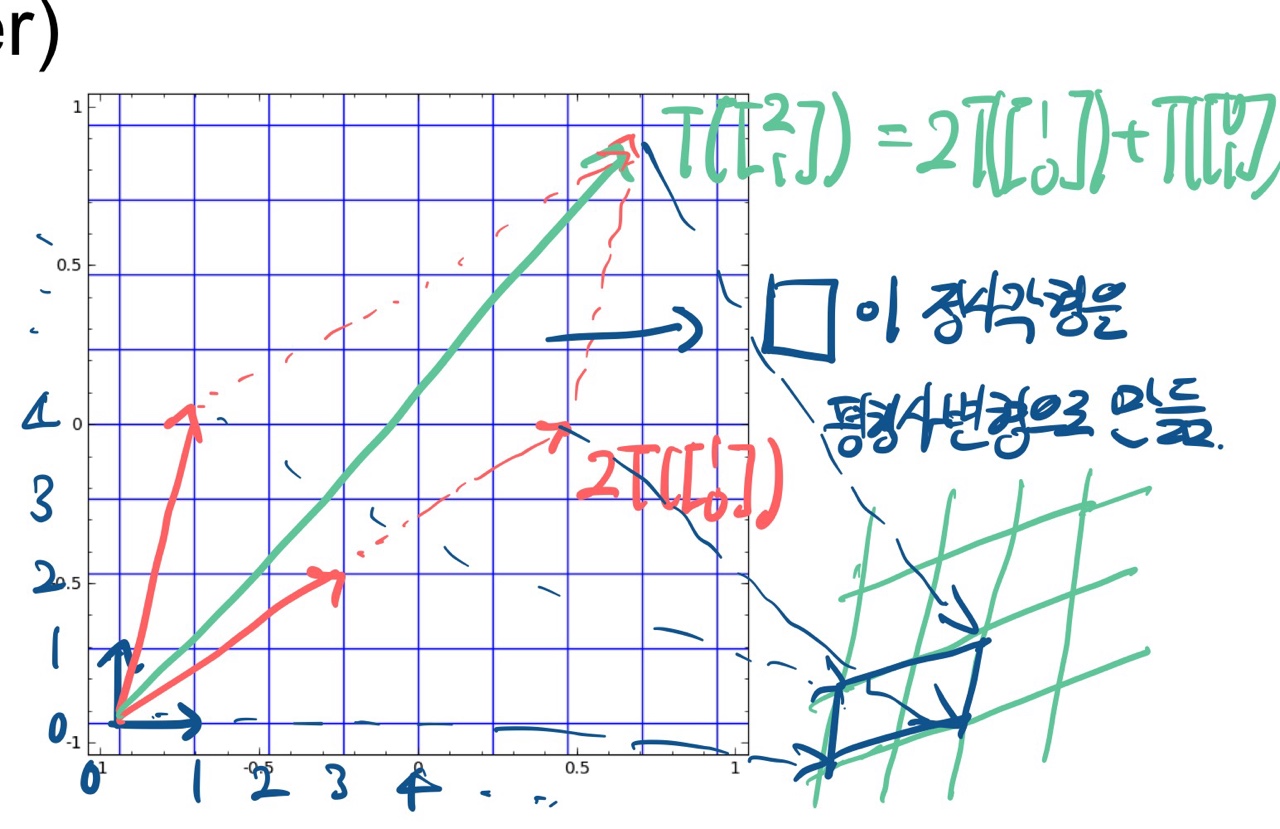

- 신경망에서의 Wx + b변환은 아래 그림과 같이 표현할 수 있다.

선형변환 -> bias에 의한 translation -> 비선형 함수에 의한 변형

- 위 그림을 토대로 2차원->2차원 선형변환을 다음과 같이 표현할 수 있다.

- 즉 2차원 모눈종이 공간이 선형변환된 공간은 기울어진 평행사변형으로 이루어진 모눈종이라고 볼 수 있다.

Affine Layer

- 신경망은 일반적으로

bias term을 포함한다. - 이 경우 선형변환이 아니라,

affine transformation이 이루어진다.

예시

- 벡터화(vectorization)된 픽셀 4개로 이루어진 이미지를 3차원으로 affine transformation 한다고 생각하자.

Wx + b = h

W는 이미 학습에 의해 최적화된 가중치 행렬이다.

x는 입력받은 이미지 벡터이다.

- 이경우 Wx 행렬곱 후 더해지는

bias term을affine layer라고 한다. affin layer에 의해 선형변환이 아니라affine transformation이 된다.

Column Combinations를 이용한 선형변환

-

Affine transformation은 column combination에 의해 선형변환으로 표현할 수 있다.

-

즉

bias term은 input의 첫 dimension이나 마지막 dimension에 1을 추가하고,bias term을 가중치 행렬에 추가함으로써 선형변환 문제로 해결할 수 있다.