시작해보자..

이래저래 많이 했다!

2021.11 ~ 현재까지, 정말 숨가쁘게 달려왔던 것 같다.

데이터 분석가이기 이전에 다양한 경험을 해보고싶다! 실무를 모르는 데이터 분석가이고 싶지 않다! 라는 고민 끝에 결정한 나의 행동이, 결론적으로 옳았다는 생각이 들었다.

성장하고자 하면 성장하는구나. 그러다보면 이 모든 상황에 감사하게 된다.

업무적으로..

분석하고 컨설팅했다.

-

회사에서는 기존 paid 캠페인의 경우 GA에서 제공하는 기여모델을 사용하여 first click, last click에 따른 매출 기여도를 측정하고 있었는데, 페북 중심이었던 기존 마케팅 활동에서 네이버, 카카오 DA + 푸시 위주로 진행하고자 하는 방향성을 가지고 있었다. UTM도 워낙 꼼꼼하게 관리하고 있어서 GA 위주의 마케팅 전략을 펼치고 있다.

-

이 상황에서 광고 비용과 그에 따른 매출을 엮어 CPA 및 ROAS를 분석하고 싶었던 게 현재 기업의 니즈였는데, 먼저 주요 매출 수단이던 페북 데이터를 끌어와 ROAS 분석을 진행하고 Tableau로 대시보드화했다.

-

피드백 : 기여모델을 넘어서 전체 퍼널 형태로 보고싶다는 니즈 ( 유입 -> 클릭 -> 장바구니 -> 구매 -> 재구매)

-

위 피드백에 따른 내 생각 : 회사에 개발자도 없고 엔지니어도 없기에 데이터 파이프라인이 없어서, 단계별로 데이터 수집을 진행해봐야겠다!(ㅠㅠ)

-

신규 paid 캠페인(차이, 페이코) 으로 데려오는 고객이 진짜 신규 고객인가? 를 판별하는 데이터 분석도 진행했다. 각 매체에서 주장하는 '신규고객'과, 우리가 보고 있는 '신규고객'의 편차가 어느정도로 큰지, 이 고객들에 따라 실제 비용은 어느정도로 책정되어야 하는지 등을 배웠다. 이 분석에서 배울게 많았는데, (1) 우리가 원하는 타겟을 정말 데려오고 있는지 (2) 분석을 요청한 팀의 ROAS 상승 기준 또한 알아야 한다 는 점이었다.

-

결론적으로 위 캠페인은 CAC에 집중을 하게 됐다. 고객 한명당 얼마를 붓고있는지, 그 고객이 가진 퀄리티가 어느정도 되는지 객단가로 본다.

-

데이터를 보는 기준은 항상 다 다르다. ROAS 250% 이상이 누군가에게는 좋은 성과일 수도, 그저 그럴수도 있다. 좋은 성과인지, 나쁜 성과인지 판별할 수 있는 기준은, 이전 캠페인 진행 여부와 타 캠페인에서 오는 인사이트라고 느꼈다. 대조군은 중요하다!

자동화하고 수집하고 스케줄링했다.

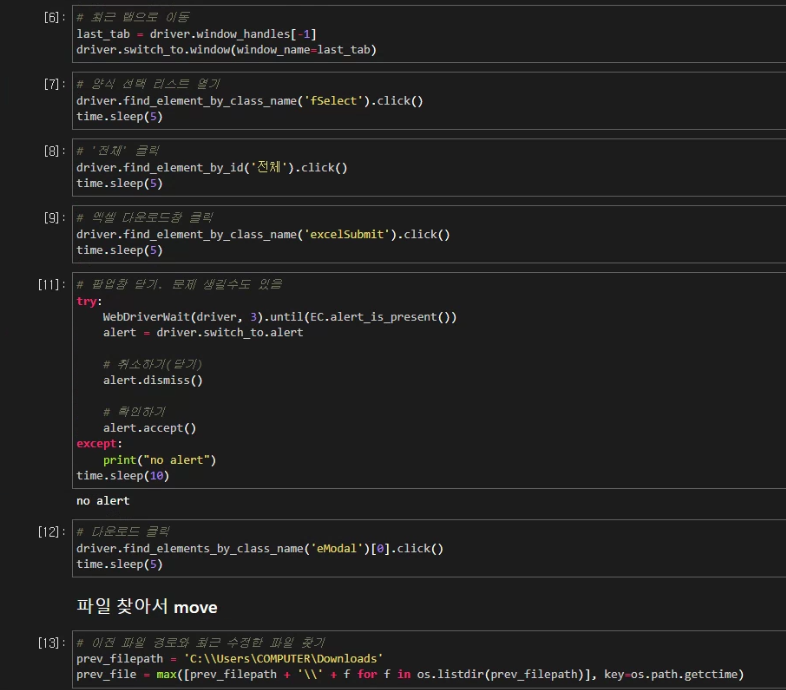

(지극히 지극히 간단한 코드)

- ...사실 자동화의 자도 몰랐다. API도 한번 팀플때 써봤었고 하나도 몰랐다.

- 먼저, 업무상에서 불필요한 프로세스들을 전반적으로 자동화하여 작업 스케줄링화 했다. 예를 들어,

(1) 자사몰 내 데이터를 매일마다 특정 시간에 받아와서 특정 로컬 경로에 저장 (매우 쉬움)

: python selenium > import os

but 특정 요일마다 이슈가 있을때 python 상에서 try와 except 적용

(2) 특정 데이터를 지속적으로 google spreadsheet에 업데이트

: selenium + pandas + gspread + 스케줄러의 합작이었다등이 있겠다.

-

사실 단순한 작업들을 자동화 시키는건 매우 재밌는 일이었다. 실무에 곧바로 적용되어 누군가의 도움이 되고 있기 때문이다. 다만, 두 가지 이슈가 있었다.

(1) 크롤링의 한계 -> 특정 구간에서 페이지 태그가 변경된 사항이 있거나, 에러가 있으면 이상한 데이터를 가져온다

(2) 스케줄러의 한계 -> 너무 많은 스케줄러를 돌리다 보니... 몇몇개는 이상하게 안돌아갈 때가 있다. 또, 스케줄러끼리 스케줄이 겹쳐 혼란스러운 때도 있었다. -

이런 점을 극복하기 위해서 했던 짓 중 하나는..

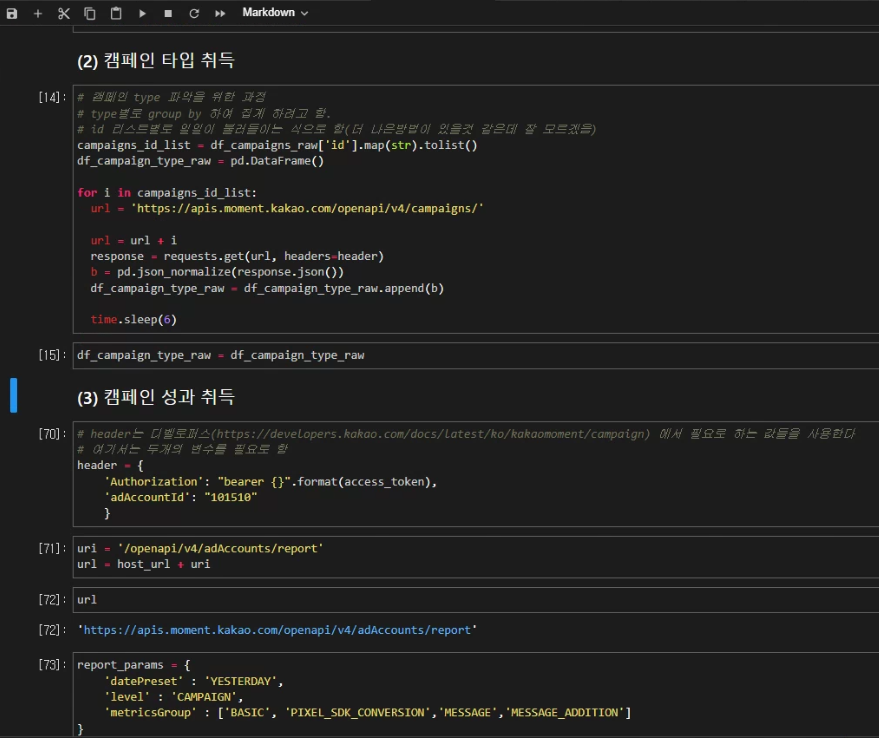

(1) API를 도입했다.

광고 데이터의 경우 실시간으로 업데이트 되어야 하는 니즈가 있었지만, 크롤링으로 하게 되면 데이터 정합성이 늘 좋지 않았고 로봇탐지가 발생한다. 그 가운데에서 생각한 것이 REST API를 통한 취득 방식이었다. -

API의 경우 광고(paid ad)쪽은 권한 이슈가 굉장히 크게 작용한다. 카카오의 경우 공식 대행사 측에만 열어주는 이슈도 있다. expired 되지 않기 위해 토큰을 바꿔주어야 하는 이슈 또한 존재하기에, 플랫폼 별 access token과 refresh token, 그 이전의 인가 관계를 잘 알아둬야 한다.

-

한계점도 있겠으나 크롤링보단 훨씬 정확한 방식으로 데이터를 취득할 수 있었다. 또한 데이터를 정제하기에도 정말 편했다. (일단 JSON 다루는 법이 많이 늘었다!)

-

일단은 네이버 / 카카오 / 구글 쪽을 API로 활용한 상태.

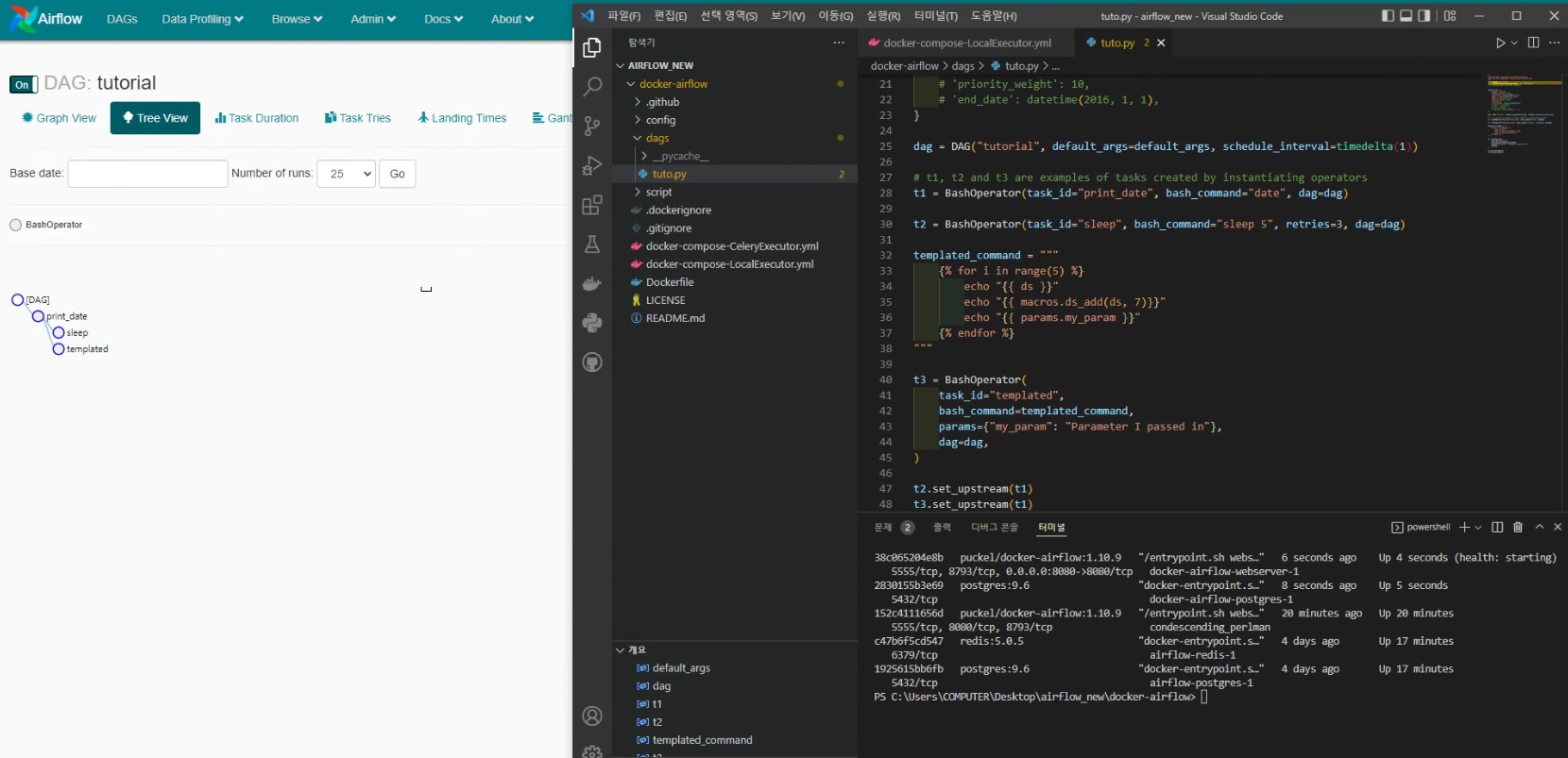

(2) airflow를 도입하려고 한다 (진행중)

-

스케줄러가 제대로 동작하지 않을 때가 많아서, (1) 필요할 때 retry 하고 error report를 보낼 수 있고 (2) 에러가 기록되고 (3) task 순서를 관리해 줄 수 있는 걸 찾고있었는데, 그게 airflow를 알게 된 이유였다.

-

airflow ui를 첨 봤을때 진짜 너무 기뻤다.... (이세상 모든 아카이브 매체와 작성자들에게 감사드린다.)

-

airflow는 나에게 너무 신세계였다. DB,웹서버,DAG,TASK... 다양한 용어가 난무하는 데다가, 어떤 환경이 베스트인지 잘 감이 안왔었다. 진짜 리눅스 환경이 낫나 싶어서 우분투 깔고 리눅스 해봤다가 에러의 늪에서 헤어나오질 못했다. 심지어 세팅되어있는 환경들에 대한 이해도도 약해서 도대체 뭐가 뭔지??? 음?? 매번 이런 상태.

-

결국 docker에 의존해서 기존에 누군가가 세팅해 놓은 레포를 토대로 localhost를 활용해서 진행하는 것으로 결정했다.

-

다만, dag 작성 시 정작 필요한 모듈들을 불러오지 못해서 막혀있는 상황. 이 상황은 꼭 해답을 찾아보고 싶다...

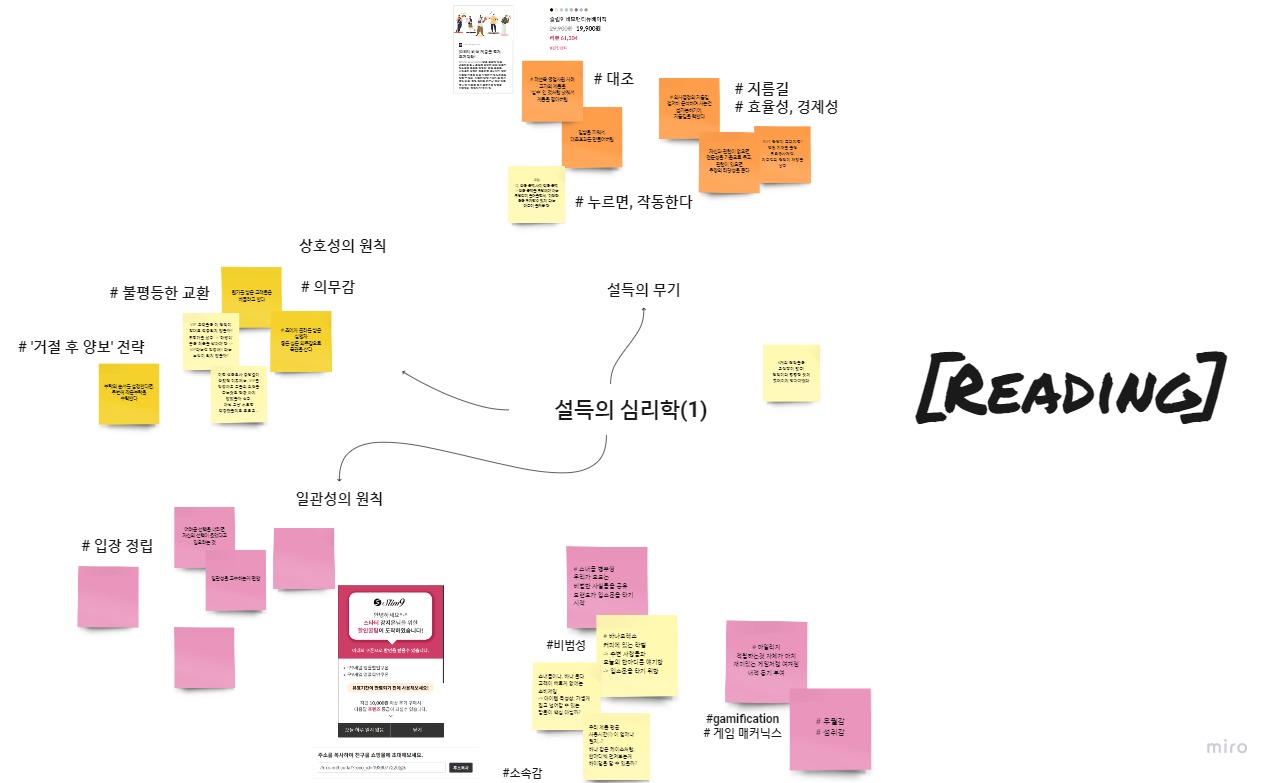

CRM 했다.

- 사실 업무 비중에서 제일 높은 것중 하나일지도 모르겠다.

- 내가 세운 업무 프로세스 : 프로모션 및 이벤트 진행 > CRM(=플친, 알림톡) 캠페인 기획 > 세그먼트 설정 > 전체 세팅(with 루나소프트, 데이터라이즈) > 성과 측정 으로 진행했다.

이 중에서도 제일 중요했던 건 세그먼트 설정이었다고 생각한다.

위 세그먼트는 기존에 RFM에 의한 세그먼트를 진행하면서 만든 총 14개의 세그먼트를 내가 X와 Y축에 맞게 배열한 것인데, 이는 사실 태블로 상에서 구현이 불가능한 로직이었다. - 때문에, 태블로에서 가능한 trick을 약간 써서 진행했다! 각 세그먼트를 IF문으로 맵핑 시키는 방식이다.

- 이렇게 해서 내가 X와 Y를 지정해버리면 끝!

- CRM은 진짜 회사 매출액에 큰 기여를 한(!) 수단이기 때문에, 약간 꽃처럼 생각하는 아이다. 고객과의 접점이 되기도 하기 때문에 다양한 반응이 쏟아지는 캠페인이기도 하다.

- 때문에 실무를 전부 오퍼레이팅 해보면서 협업과 커뮤니케이션 능력도 늘어나게 되었고, CRM은 어떤 지표로 바라봐야 하는지 고민하게 되었다.

성과는 ROAS로 산정될 수 없고(비용보다 항상 몇배의 이익을 가져옴) 작게는 세그먼트별 접속률이나 객단가, 크게는 LTV로 확장되어서 고민을 했던 것 같다. - 사실 RFM은 한계가 많은 구모델이기는 해서, 활용 가능한 다른 데이터(체류시간같은)를 가져오면 또 만들고 싶다.

GA 공부부터 세팅까지 했다.

- 멋진 분께 아주 좋은 GA 서적을 추천받았다.

- 사실 그 책은 ga를 가장한 분석책이 아닌가 라는 생각이 들 정도로 내용이 좋아서, n회독을 해야하지 않을까 생각한다.

- UA의 시대가 점차 저물어가면서 GA4를 세팅하게 되었고, 기존 GA 세팅된 gtag에 기반하여 웹 데이터 스트림을 형성했다.

- 이 과정에서 아주아주 쉽게 빅쿼리도 연동을 했고, GA4 스키마 에 대해서도 공부하는 중이다.

- 이 부분에서 gtm의 중요성을 여실히 깨달아서, gtm + ga4 공부를 병행해야 할 것 같다. gtm은 어쨌든 유저 액션을 가져오겠다는 약속이기에, '어떤 액션을 들고올 것인가?' 도 너무너무 중요하다.

기획도 경험했다.

- 9일마다 열리는 프로모션 데이에서 리워드와 랜딩 페이지 관련 아이디어를 도출했다.

5월 9일 - 친구 추천에 따른 리워드 (친구와 내가 주력 제품을 받는 혜택) + 설문조사로 정보 획득

6월 9일 - 앱 시프팅을 위해 무난하게 끌리는 리워드 (스벅, 베라 깊티 등등) - 랜딩 페이지의 구성이나 레퍼를 많이 전달드렸고, 이에 따른 카피나 기획은 다른 팀에서 진행했다.

- 리워드에 따른 CRM 구성, 설문조사 세팅, 혜택 발주 넣는 과정 등등 여러 프로세스에 관여하게 되면서, 조금 더 실무에 가까워진 느낌이 들었다.

- 프로모션은 참 어렵다. 모든 팀이 협업하는데 만족스러운 선을 찾기 참 어려운 것 같다. 기획자로서도 피드백을 받아들이되 불도저처럼 밀고 나가자 하는 단호함도 있어야 한다. 재밌지만 욕먹기 쉬운 일.

그 외에...

- 사실 삽질을 제일 많이 했는데 차마 그 수많은 삽질은 아카이빙도 안되고 하다가 기운 빠질것 같아서 포기했다.ㅠㅠ

- Tableau 역량이 정말 정말 정말 정말 많이 늘었다. 21세기 정말 fancy한 툴을 뽑자면 tableau도 꼭 꼽고 싶다. 물론 어렵지만, 이정도로 쉽게 고퀄리티 BI툴을 만들어줬다는 것에 감탄할 뿐.

- 팀원들을 챙기는(?) 능력도 많이 늘었다. 나는 나의 일을 하면서 항상 다른 사람의 일을 궁금해하고 살피는 편이다. 사실 팀 안에서 하고 있는 일 = 곧 나의 일이 될수도 있다는 생각에 더 그렇다.

(사이즈 어떻게 줄이지.. select 케틀벨 from 헬스장)

- 운동에 맛들려서 너무너무 즐겁게 주4~5회 아침+피티로 운동 -> 일 -> 집와서 공부!

- 코로나도 걸렸다.(이런건 경험 안하고싶다...)

나는...

- 난 사실 밝은 사람인 편에 속하나, 긍정적이고 밝은 회고를 쓰는건 사실 나에게 잘 맞지 않는 일이다. 희망찬 무언가를 쓰는 사람은 영영 될 수 없을 것 같다. 일기를 쓸 때도 투박하게, 덤덤하게 쓰는걸 매우 선호하는 타입이며, 정과 동중에 정을 택하고, 흑백과 컬러 중에는 흑백을 택한다.

- 모든 경험이 다 좋았는가? 라고 했을 때, 그렇다고 할 수는 없을 것 같다. 즐거운 것도 많았지만 억울한 것도 좀 있고, 불안한 것도 있고 불만인 것도 있고 이해가 안되는 것들도 참 많다. 실망한 것도 참 많고. 세상사가 다 그런가? 싶기도 하다. 어딜 가나 그럴거다 아마.

- 그럼에도 2022년 목표인 '다양한 경험을 한다' 라는 면에서, 이 모든 경험들은 나에게 도움이 되었던 것 같다. 한 발자국 나아갈 수 있는 사람이 되었고, 경험에 감사하고, 그 경험을 준 모든 분들에게도 감사하게 되었기 때문.

- 앞으로도 조금은 내려놓으면서, 조금은 더 나설 수 있는 사람이 되었으면 한다.