딥러닝

1.[딥러닝] CNN (Convolutional Neural Networks) 이론 및 pytorch 코드

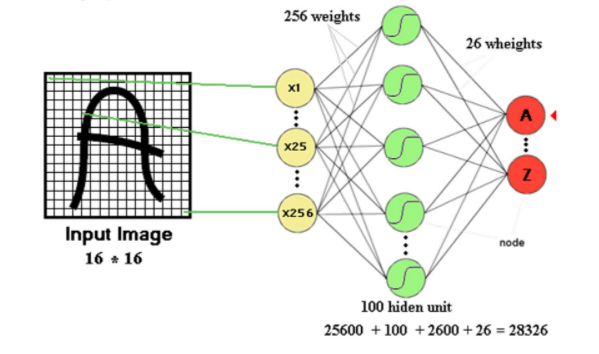

기존 DNN(Deep Neural Network)의 문제점.이미지 처리시 입력 뉴런의 수와 파라미터 수가 급격하게 증가됨.기본적으로 1차원 형태의 입력 데이터를 사용함. -> 1차원 형태의 입력 데이터를 사용하기 때문에 직렬화를 수행하면서 픽셀들의 상관관계를 잃게 됨.

2024년 1월 7일

2.[딥러닝] Transformer(트랜스포머) 이론 및 pytorch 코드

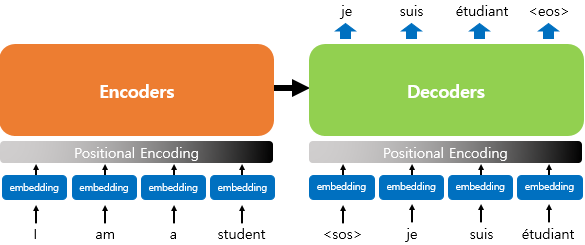

1. 등장배경 2. Attention 3. Transformer 관련 기초 개념 4. Transformer 전체 구조 및 과정 figure1의 왼쪽은 인코더, 오른쪽은 디코더. 전체적인 트랜스포머의 구조는 seq2seq과 마찬가지로 인코더와 디코더로 구성. 그

2024년 1월 8일