[03-1 k-최근접 이웃 회귀]

-

회귀 : 임의의 수치를 예측하는 문제 -> 타깃값 : 임의의 수치

-

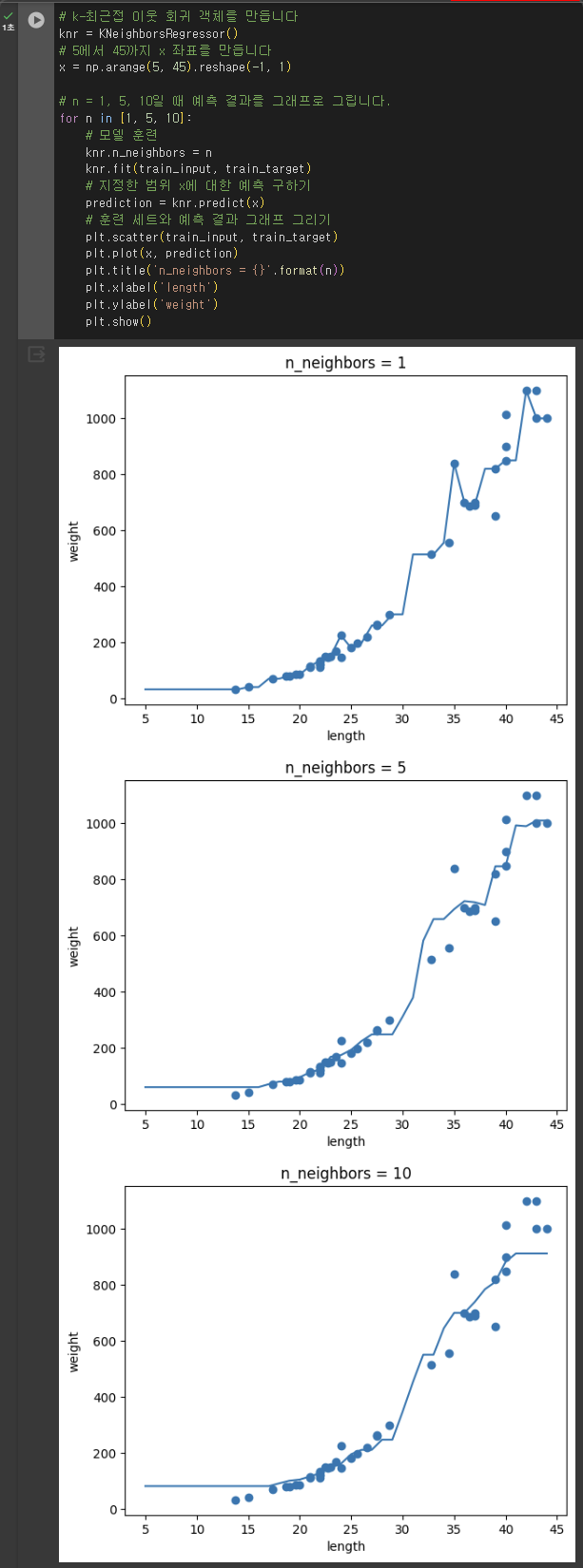

k-최근접 이웃 회귀 : k-최근접 이웃 알고리즘을 사용해 회귀 문제를 푸는 방법 -> 가장 가까운 이웃 샘플을 찾고 샘플들의 타깃값의 평균을 예측으로 삼는다.

-

결정계수 : 대표적인 회귀 문제의 성능 측정 도구 -> 1에 가까울 수록 성능이 좋고, 0에 가까울 수록 성능이 나쁜 모델이다.

-

과대적합 : 모델의 훈련 세트 성능이 테스트 세트 성능보다 훨씬 높을 때 일어난다.

과소적합 : 모델의 훈련 세트와 테스트 세트 성능이 모두 동일하게 낮거나 테스트 세트 성능이 오히려 더 높을 때 일어난다.

scikit-learn

-

KNeighborsRegressor

k-최근접 이웃 회귀 모델을 만드는 사이킷런 클래스

n-neighbors 매개변수로 이웃의 개수 지정 (기본값 : 5)

다른 매개변수는 KNeighborsClassifier 클래스와 거의 동일 -

mean_absolute_error()

회귀 모델의 평균 절댓값 오차 계산

첫 번째 매개변수는 타깃, 두 번째 매개변수는 예측값 전달

mean_squared_error()와 유사 (평균 제곱 오차를 계산하는 함수)

numpy

-

reshape()

배열의 크기를 바꾸는 메서드

바꾸고자 하는 배열의 크기를 매개변수로 전달

바꾸기 전후의 배열 원소 개수는 동일

[03-2 선형 회귀]

-

선형 회귀 : 특성과 타깃 사이의 관계를 가장 잘 나타내는 선형 방정식을 찾는 과정

-> 이 관계는 선형 방정식의 계수 또는 가중치에 저장된다. -

다항 회귀 : 다항식을 사용하여 특성과 타깃 사이의 관계를 나타낸다.

scikit-learn

-

LinearRegression :

사이킷런의 선형회귀 클래스

fit_intercept의 매개변수를 False로 지정하면 절편 학습 X

(기본값 : True)

[03-3 특성 공학과 규제]

-

다중 회귀 : 여러 개의 특성을 사용해 강력한 성능을 발휘하는 회귀 모델

-

특성 공학 : 주어진 특성을 조합하여 새로운 특성을 만드는 과정

-

릿지 : 규제가 있는 선형 회귀 모델 중 하나

선형 모델의 계수를 작게 만들어 과대적합을 완화시킨다. -

라쏘 : 릿지와 달리 계수 값을 아예 0으로 만들 수 있는 선형 회귀 모델

-

하이퍼파라미터 : 사전에 지정해야하며 머신러닝 알고리즘이 학습하지 않는 파라미터 (대표적으로 릿지와 라쏘의 규제 강도 alpha 파라미터)

pandas

- read_csv()

CSV 파일을 로컬 컴퓨터나 인터넷에서 읽어 판다스 데이터프레임을 변환하는 함수

scikit-learn

- PolynomialFeatures

주어진 특성을 조합하여 새로운 특성을 만든다

degree : 최고 차수 지정 (기본값 : 2)

interaction_only : True이면 거듭제곱 항은 제외되고 특성 간의 곱셈 항만 추가 (기본값 : False)

include_bias : False이면 절편을 위한 특성을 추가하지 않는다.(기본값 : True)

- Ridge

규제가 있는 회귀 알고리즘인 릿지 회귀 모델을 훈련

alpha 매개변수로 규제의 강도 조절

solver 매개변수에 최적의 모델을 찾기 위한 방법 지정

-

Lasso

규제가 있는 회귀 알고리즘인 라쏘 회귀 모델을 훈련

최적의 모델을 찾기 위해 좌표축을 따라 최적화를 수행해가는 좌표 하강법 사용

기본미션

Ch.03(03-1) 2번 문제 출력 그래프 인증하기

선택미션

모델 파라미터에 대해 설명하기

: 선형 회귀가 찾은 가중치처럼 머신러닝 모겔이 특성에서 학습한 파라미터를 말한다. 앞서 선형 회귀 알고리즘에서 머신러닝 알고리즘이 찾은 값인 coef와 intercept가 모델 파라미터에 해당한다.