정규화 기법은 입력층에 이미지를 입력하기 위한 학습 데이터의 전처리에 집중되어 있었다.

이미 추출된 특징일 정규화하면 은닉층도 마찬가지로 정규화의 도움을 받을 수 있다.

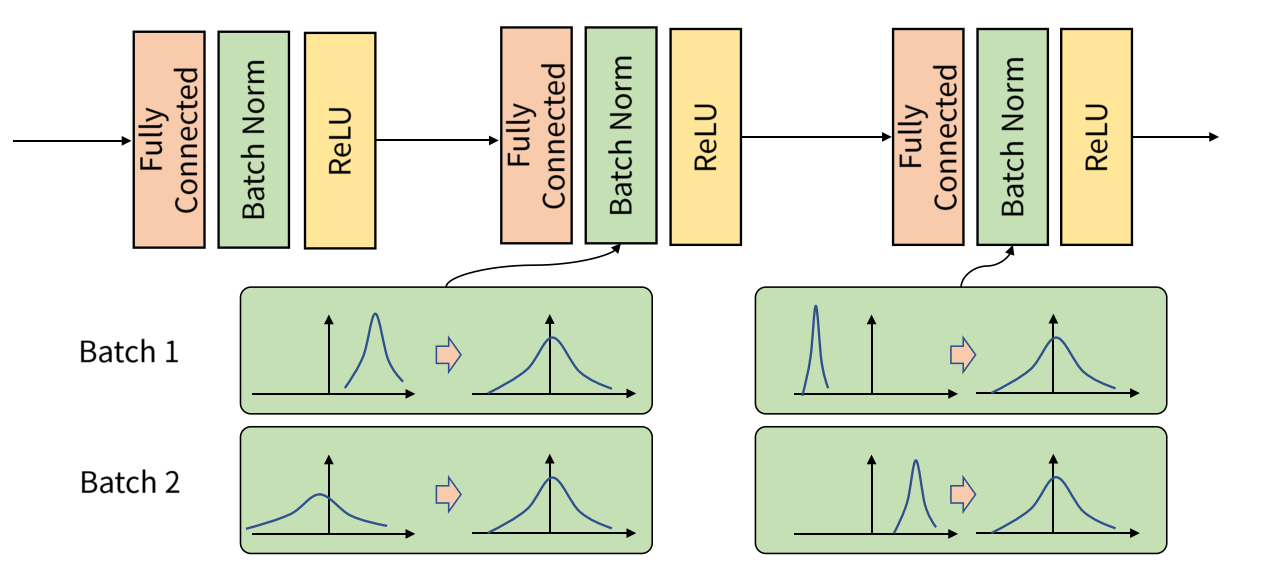

추출된 특징은 변화가 심하므로 정규화를 통해 신경망의 학습 속도와 유연성을 개선할 수 있는데 이를 배치 정규화라고 한다.

https://gaussian37.github.io/dl-concept-batchnorm/

공변량 시프트 문제

- 학습 데이터가 한 쪽으로만 몰려있는 문제(사과, 오렌지 구별 문제에서 학습 데이터에 사과만 있는 경우)

- 테스트 데이터를 제대로 분류하기 어려울 것이다.

배치 정규화의 원리

- 입력의 평균을 0으로 조정

- 평균이 0으로 조정된 입력을 정규화

- 연산 결과의 배율 및 위치 조정

from keras.models import Sequential

from keras.layers import Dense, Dropout

from keras.layers.normalization import BatchNormalization

model = Sequential()

model.add(Dense(hidden_units, activation='relu'))

model.add(BatchNormalization())

model.add(Dropout(0.5))

model.add(Dense(units, activation='relu'))

model.add(BatchNormalization())

model.add(Dense(2,activation='softmax'))[참고자료]

https://www.hanbit.co.kr/store/books/look.php?p_code=B6566099029