이것저것

1.2021년 10월 31일

요즘 너무 불안...들어가고 싶은 랩실이 있는데 정말... 정말 가고 싶은데... 그 중간고사 문제를 너무 어이 없는 것을 많이 틀렸기 때문 ㅎㅎ... 정말 이해할 수 없다.집에 오는 길에 생각하는데 왜 그렇게 적었을까 하는 그런 생각이 머리 속을 가득 채웠다...11

2021년 10월 31일

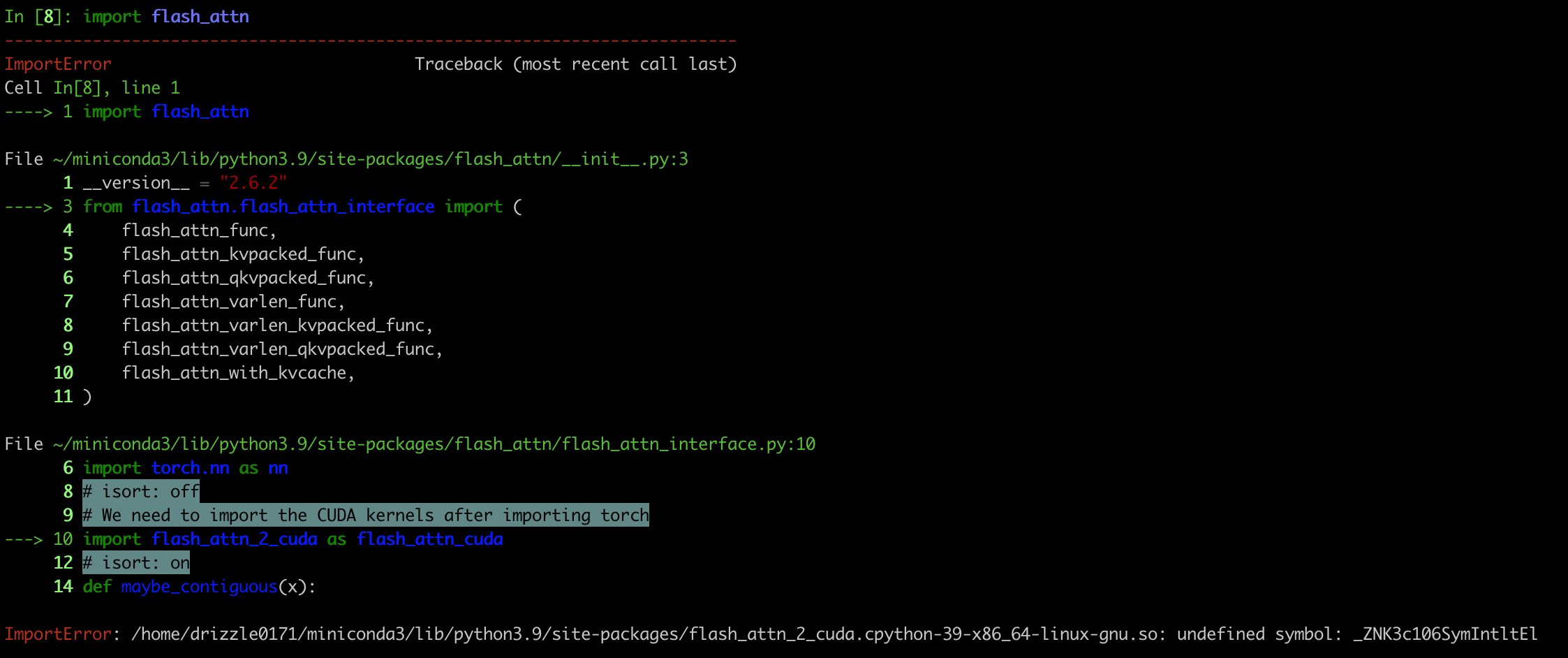

2.[Error] ImportError: flash_attn_2_cuda.cpython-39-x86_64-linux-gnu.so: undefined symbol

VLM inference 때문에 flash attention package를 사용해야 하는데, import가 안됨 ... ㅎcuda, pytorch, flash_attn 모두 각자 environment에 맞는 것을 설치하면 되는데, 만약 아래의 command를 따른다면

2024년 8월 21일