LangGRAPH

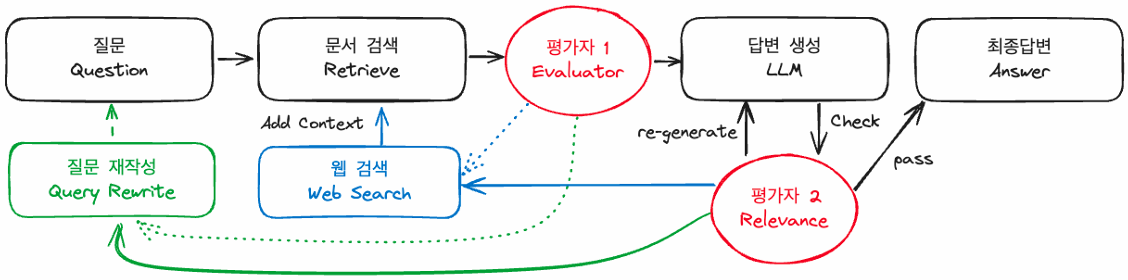

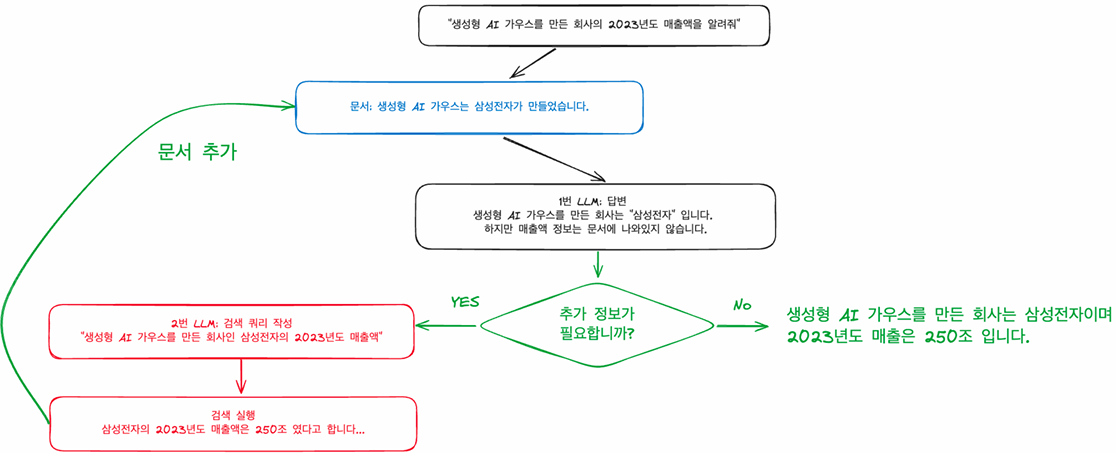

RAG(Retrieval-Augmented Generation)를 사용했을 때 발생하는 고민이 있다.

- Hallucination

- RAG를 적용한 답변인가? 사전지식 답변인가?

- "인터넷" 혹은 "논문"에서 부족한 정보를 검색하여 지식 보강할 수 있나?

웹 검색과 평가자 라는 요소를 넣어 답변의 신뢰도를 높인다.

출처: 테디노트

Fine-Tuning

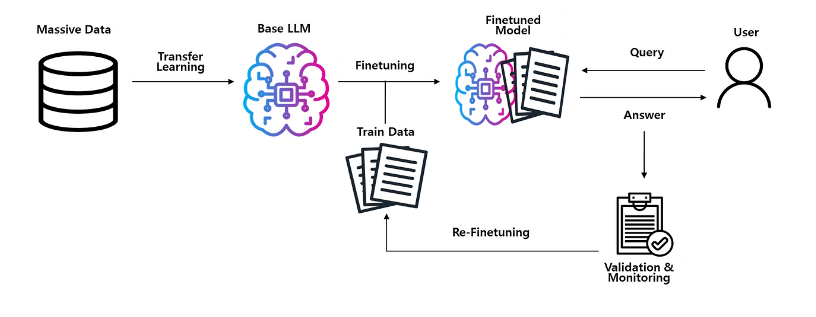

하지만 그럼에도 정보가 부족할 수 있다. 그런 부분을 채우기 위해 파인튜닝을 한다.

출처: Dende

모니터링을 통해 답변을 검증하고, 환각 혹은 미응답에 대한 Data를 만들고 LLM에 넣어준다. LoRa(Low-Rank-Adaption)는 PEFT기법으로 소규모 조정 및 작은 데이터셋으로 효율적으로 파인튜닝할 수 있다.

지도 파인튜닝(Supervised Fine-Tuning, SFT)은 라벨이 지정된 데이터셋을 사용해 사전 학습된 모델을 특정 목적에 맞게 조정하는 방법이다. 해당 방법도 맞춤형 및 효율성에 초점을 맞춘다.

멀티모달

LLM은 대규모 언어 모델로 텍스트 기반 유니모달 모델이다. 하지만 멀티모달은 사진, 소리, 움직임 등 비언어적 정보를 해석해 문장을 더 풍부하고 구체적으로 생성할 수 있다.

벨로그

요즘 정신없어서 배운 것에 대한 정리를 안 했는데... 다시 꾸준하게 정리를 해야겠다. 다음 포스팅은 미니 프로젝트 3차에 대한 얘기를 해볼 것이다.