주 2회 ML & DL Study & Q&A 피드백 진행

해당 포스트

📗 인공신경망

스터디원🙎♀️ @dbswls6685

2023-05-11

❓ 질문 1

Q. 입력 신호의 총합은 단순 + 연산으로 계산되는건가?

A.TLU에는 은닉층이 없으니까 x1~xn개의 단순 합이 입력 신호의 총합이 되는거고, 은닉층이 존재한다면 가중치까지 적용한 합이 총합이 된다.

❓ 질문 2

Q. 하이퍼 파라미터 임계값은 사용자가 지정하는건지? 출력값에 큰 영향을 주는데 어떻게 조정하는가?

A. YES, 단위에 따라서 임계값을 잘 정해야 함. 임계값에 따라서 활성 함수 반환값이 달라지니까

❓ 질문 3

Q. 퍼셉트론의 임계값을 0으로 선정하는 이유가 TLU가 0 혹은 1을 반환해서인지?

A. '퍼셉트론 동작 원리' 예시 설명에서 가중치 곱한 값들의 총합이 0 이상이면 1을 부여한다고 설명했을 때를 말한 것. 퍼셉트론 임계값을 0으로 선정했다는건 일반화된 내용이 아님.

❓ 질문 4

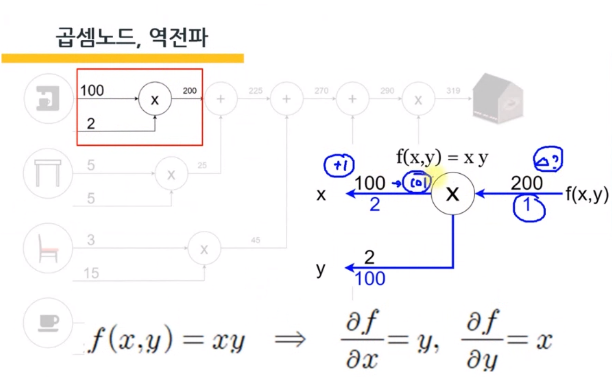

Q. 덧셈노드와 곱셈노드는 역전파 알고리즘 어느 층에서 이용되는건지?

A. 출력층에서 입력층으로 가는 과정에서 이용, 덧셈노드와 곱셈노드는 역전파 알고리즘에서 파생된 것이기 때문에 역전파에만 존재, 덧셈노드와 곱셈노드 연산을 이용하면 노드가 아무리 많아지더라도 순전파보다 연산 소요 시간은 짧음

❓ 질문 5

Q. 곱셈노드 설명

기울기에 따라서 x는 1 증가할 때 1이 증가하지만 y는 1 증가할 때 100이 증가된다.

x보다 y가 최종값에 영향을 더 많이 주므로 더 큰 역전파를 준다.

❓ 질문 6

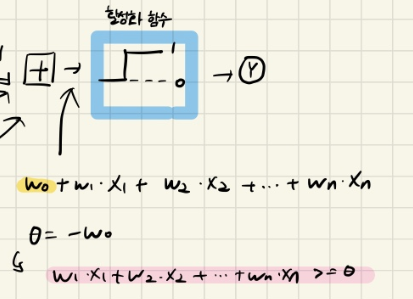

Q. 가중치와 편향의 차이점? 편향을 가중치에 포함시켜도 되는거 아닌가?

A. 편향을 가중치라고 할 수는 없다.

위 식으로 볼 때, 가중치는 식에서 다 더해주는데, 이후에 가중치 총합과 임계값을 비교하기 위해서는 편향값(w0)은 빼줘야 함.

가중치는 '중요도'이고 편향은 '성향'이라고 생각하자.

bias = '뉴런이 얼마나 쉽게 활성화 되는가'를 조정하는 매개변수

편향 예시 설명 1

편향 예시 설명 2 - 결혼

편향 예시 설명 3 - 파티

❓ 질문 7

Q. 오차를 줄이는 방향으로 가중치 갱신하여 맞추면 그대로 이용하고, 못맞추면 weight를 조정하는게 무슨 말인지?

A. 처음에는 중요도와 상관없이 가중치를 설정한다. 처음 선정된 가중치로 인한 예측값과 실제값의 오차가 생긴다. 그 오차를 점점 줄여나가는 과정에서 예측값과 실제값이 일치하면 그대로 이용한다는 의미이다.

순전파에서 오류가 큰 노드는 가중치를 작게 주어 영향력을 줄이고,

반대로 오차 역전파는 오류가 큰 노드에 큰 가중치를 준다.

❓ 질문 8

Q. 활성 함수인 비선형 함수는 선형 데이터를 쓸 수 없는지?

A. No. 중간에 은닉층을 추가하여 기존의 선형 모델로 표현할 수 없었던 데이터를 표현할 수 있으며, 이는 층을 추가함으로써(= 활성 함수를 통해) 모델의 선형성을 비선형으로 바꿔주는 효과를 발생시킨다.

신경망에서 활성 함수로 비선형 함수만을 사용하는 이유는 선형 함수인 경우에는 층과 층 사이에서 데이터가 이동할 때도 선형성이 유지되기 때문에 결국 층을 깊에 쌓아봤자 하나의 층으로 표현 가능해져 층을 쌓는 이유가 없어지기 때문이다.

❓ 질문 9

Q. 시그모이드 함수가 계단 함수보다 데이터 정보를 더 보존한다?

A. YES. 계단 함수는 임계값 기준으로 0,1만 출력하는 함수라 극단적이지만, 시그모이드는 0과 1 사이 연속적인 값을 출력하기 때문에 계단 함수보다는 데이터를 더 보존한다고 할 수 있다.

❓ 질문 10

Q. 역전파 알고리즘 과정에 순전파가 포함되는건가?

A. YES. 역전파에서 가중치를 업데이트 하기 위해서는 순전파에 의해 입력값이 출력층까지 전달되어야 한다. 전달 후 발생하는 오차를 기반으로 가중치를 조정하기 때문이다.

단계 1) 전방향으로 출력값과 ANN 출력값 간의 오차를 계산

단계 2) 전방향 단계에서 계산된 오차를 최소화하기 위해 가중치 수정