잘 쉬고(쉬었다기 보단 징징대고) 돌아왔다!

과제를 앞두고 제대로 강의를 듣지 않아 직접 코딩하면서 머신러닝 기초 강의를 들었다.

불행 중 다행으로 자격증 시험 볼 때 유난스럽게 붙잡던 내용이라 아주 수월하게 공부했다.

단순선형회귀 (키-몸무게 데이터, tips데이터) 범주형 데이터 총 세 가지 였는데,

손으로 쓰고 눈으로 읽다 보니 코드도 꽤나 머리에 남는다.

쉬길 잘했다 느껴질만큼 오늘 하루 능률이 좋았으나.. 습관이 되면 안되겠다고 생각...

주어진 시간에 최선을 다하는 것에 쉼도 포함이 되길 바란다.

쉬면 죽는 병에 걸린 사람처럼 맨날 왜 이 난리인지 모르겟음,,🥱

<선형회귀 이론>

선형회귀 : ‘직선’으로 돌아가다.

주변의 점, 데이터들이 선 위의 점으로 돌아가려는 모형

분류 : 범주형 자료

- 실제값과 예측값이 작을 수록 예측을 잘 한다.

- 음수와 양수의 합을 계산하면 서로 상쇄될 위험이 있기 때문에 제곱

- 데이터가 늘어나면 오차가 많아지므로 평균을 구한다.

-

: 편향(Bias)

-

: 회귀 계수

-

: 오차(에러), 모델이 설명하지 못하는 Y의 변동성

-

머신러닝/딥러닝에서 사용하는 선형회귀 식

- : 가중치(weight)

- : 편향(Bias)

- 머신러닝/딥러닝 모델에서 오차 항은 명시적으로 다루지 않음

- 추정치(가중치)와 편향을 알고 있으면 x(몸무게)가 있을 때 y(키)를 알수 있다.

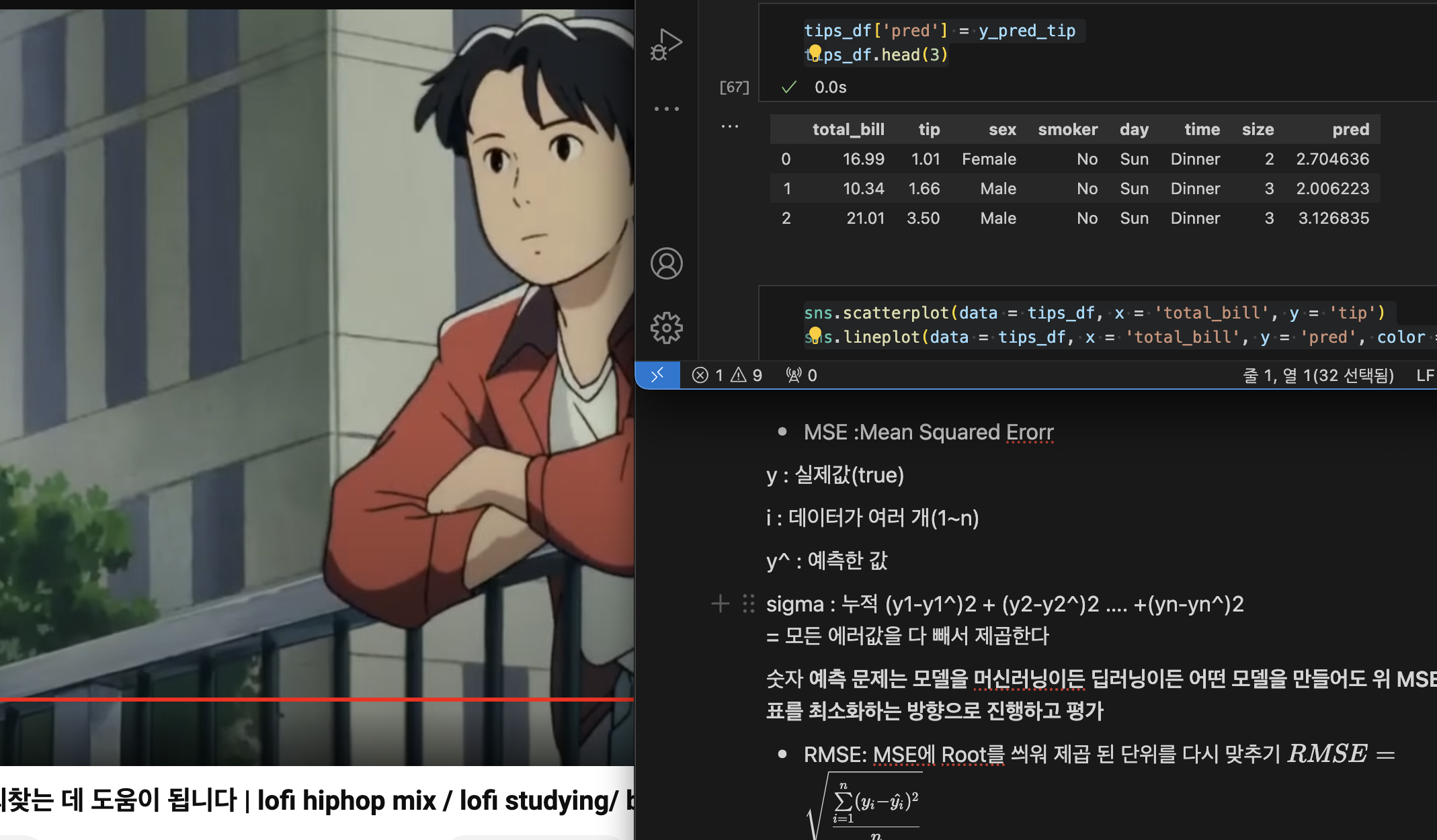

- MSE :Mean Squared Erorr

y : 실제값(true)

i : 데이터가 여러 개(1~n)

y^ : 예측한 값

sigma : 누적 (y1-y1^)2 + (y2-y2^)2 …. +(yn-yn^)2

= 모든 에러값을 다 빼서 제곱한다

숫자 예측 문제는 머신러닝이든 딥러닝이든 어떤 모델을 만들어도 위 MSE 지표를 최소화하는 방향으로 진행하고 평가

- RMSE: MSE에 Root를 씌워 제곱 된 단위를 다시 맞추기

- MAE: 절대 값을 이용하여 오차 계산하기

<기초 용어>

- : 특정 데이터의 실제 값

- : 평균 값

- : 예측, 추정한 값

- SST : sum of square’s Total (Error + REgression)

- SSR : Regression : 회귀가 설명한 값 (y1^- -y)

- SSE : Error : 회귀가 설명하지 못한 값 (y1- y1^)

- R Square의 정의

<필요한 함수를 찾아보는 방법 tip>

- 구글링 -> 블로그

- 단점 : 늘 블로그가 바뀌고, 형태가 일정하지 않다.

- ChatGPT LLM

- 단점 : 의존하게 되면 더 이상 공부를 안함 / 거짓 정보를 전달하는 경우

- 공식 문서

- 장점 : 일괄되게 정리되어 있어, 동일한 위치(경로)에 같은 문서가 있다.

- 자격증 시험에서도 공식문서만 열람할 수 있음.

- 단점 : 초보자가 읽기 어렵다.

<선형회귀 실습 메모>

- y = 0.86 + 109.37

- 활용하여 예측 컬럼을 추가.

- 에러값을 각각 계산.

- 양수를 만들기 위해 제곱

- 모두를 더한다(MSE)

- 산점도 그래프에 선형식을 만들어서 그래프로 그리기

<선형 회귀 모델 평가>

1. 회귀(숫자를 맞추는 방법) : MSE(수동 계산 = 10)

2. R Square 값이 평균 대비 설명력, 0이면 제일 낮음, 1일수록 높은 것

코딩 내용은 너무 길어서 강의 내용과 함께 노션에 정리했다.

링크텍스트

코드카타고 나발이고 하루종일 강의듣고 공부했지만 아쉽진 않다.

내일은 본격적으로 시작할 과제 세팅이랑,, 심화 1주차까진 들을 수 있음 좋겠다.

미루다 똥되는건 나니까,,,코드카타 밤늦게 한 문제라도 풀길 기원,,,

아무튼 주말 땡겨서 썼다 생각해야지 모

2월 첫 주 액땜, 앞으로도 오늘만큼만 열심히 하면 참-좋겠다!