이 문서는 다중 분류(Multiclass Classification) 문제에서 모델 성능을 측정하는 주요 지표인 Accuracy, Precision, Recall, F1 Score의 개념과 사용 기준을 시각 자료와 함께 정리한 학습 기록

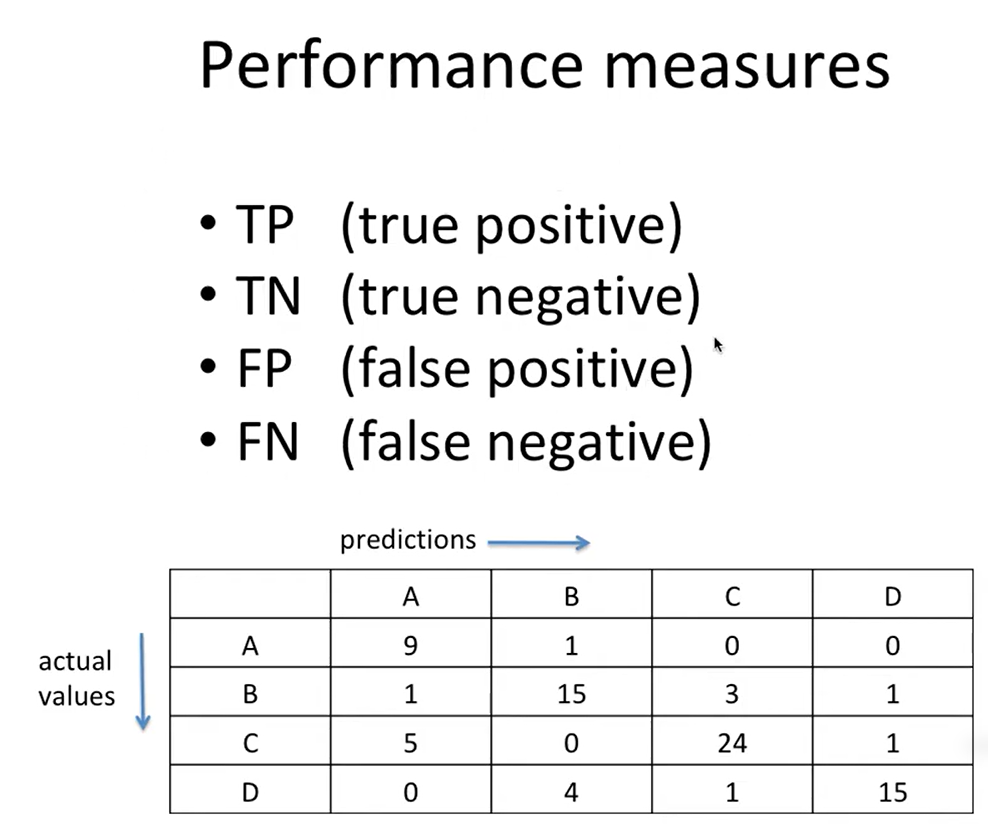

1. 다중 분류에서의 성능 평가 지표

다중 클래스 문제에서는 단일 이진 분류와 달리, 각 클래스별로 따로 정밀도·재현율을 계산하고 평균을 내야 합니다.

- Accuracy (정확도): 전체 샘플 중 맞춘 비율

- Precision (정밀도): 예측한 것 중 실제로 맞은 비율

- Recall (재현율): 실제 정답 중 모델이 맞춘 비율

- F1 Score: 정밀도와 재현율의 조화 평균

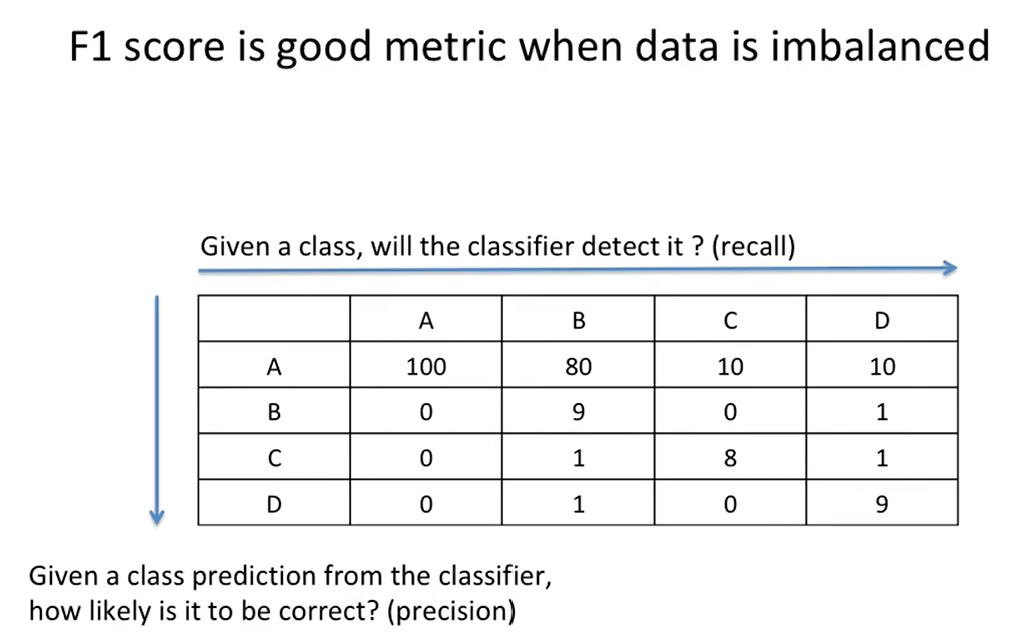

2. Accuracy의 한계

- 데이터가 균형(Balanced) 되어 있는 경우에 Accuracy는 유효한 지표입니다.

- 하지만 클래스 불균형(Unbalanced)이 심한 경우, Accuracy는 성능을 과대평가할 수 있습니다.

예시:

- 전체 데이터의 90%가 클래스 A일 경우 → 항상 A만 예측해도 Accuracy는 90%

- 하지만 이 모델은 B, C, D 등의 클래스는 전혀 구분하지 못함

3. Precision, Recall, F1 Score의 필요성

- 불균형 데이터에서는 정밀도(Precision) 와 재현율(Recall) 을 따로 보는 것이 중요합니다.

- F1 Score는 Precision과 Recall을 조화평균(Harmonic Mean) 으로 결합한 지표입니다.

F1 = 2 * (Precision * Recall) / (Precision + Recall)- Precision만 높고 Recall이 낮거나 그 반대인 경우 → F1 Score는 낮게 나옴

- 모델이 한쪽으로 치우쳐 있지 않고 균형 있게 잘 예측하고 있는지를 판단할 수 있음

4. 실제 적용 기준

| 데이터 분포 | 추천 지표 |

|---|---|

| 클래스가 균형(Balanced) 되어 있음 | Accuracy |

| 클래스가 불균형(Unbalanced) 되어 있음 | F1 Score, Precision, Recall |

5. 느낀 점

- 처음에는 Accuracy 하나만 보면 될 줄 알았는데,

실제로는 불균형 데이터가 많은 현실 문제에서는 전혀 도움이 되지 않는다는 것을 깨달았다. - F1 Score는 단순한 수학 공식이 아니라, Precision과 Recall 간 균형을 보여주는 중요한 지표라는 점에서 더 의미 있게 느껴졌다.

요약

- Accuracy는 간단하지만, 불균형 데이터에 취약

- Precision/Recall은 각각 모델의 다른 관점을 보여줌

- F1 Score는 둘의 조화 → 모델의 종합적인 판단 지표

- 실전에서는 데이터 분포에 따라 지표를 선택해야 한다