Intro

L-BFGS attack은 Intriguing properties of neural networks에서 소개된 공격 기법이다.

DNN은 여러 분야에서 뛰어난 성능을 보이고 있지만, 모델 특성상 우리의 직관에 반하는 input을 학습하게 된다. [1]에서는 두가지 DNN의 속성을 탐구한다.

- DNN의 unit을 분석하였을때, individual high level units과 random linear combinations of high level units의 차이가 없다. 즉, 개별 unit 보다는 unit이 모인 공간이 의미론적 정보를 갖는다.

- DNN은 input과 output을 mapping하는데, 이 mapping이 불연속적이다.

이중 두번째 속성이 이 공격의 시발점이 된다.

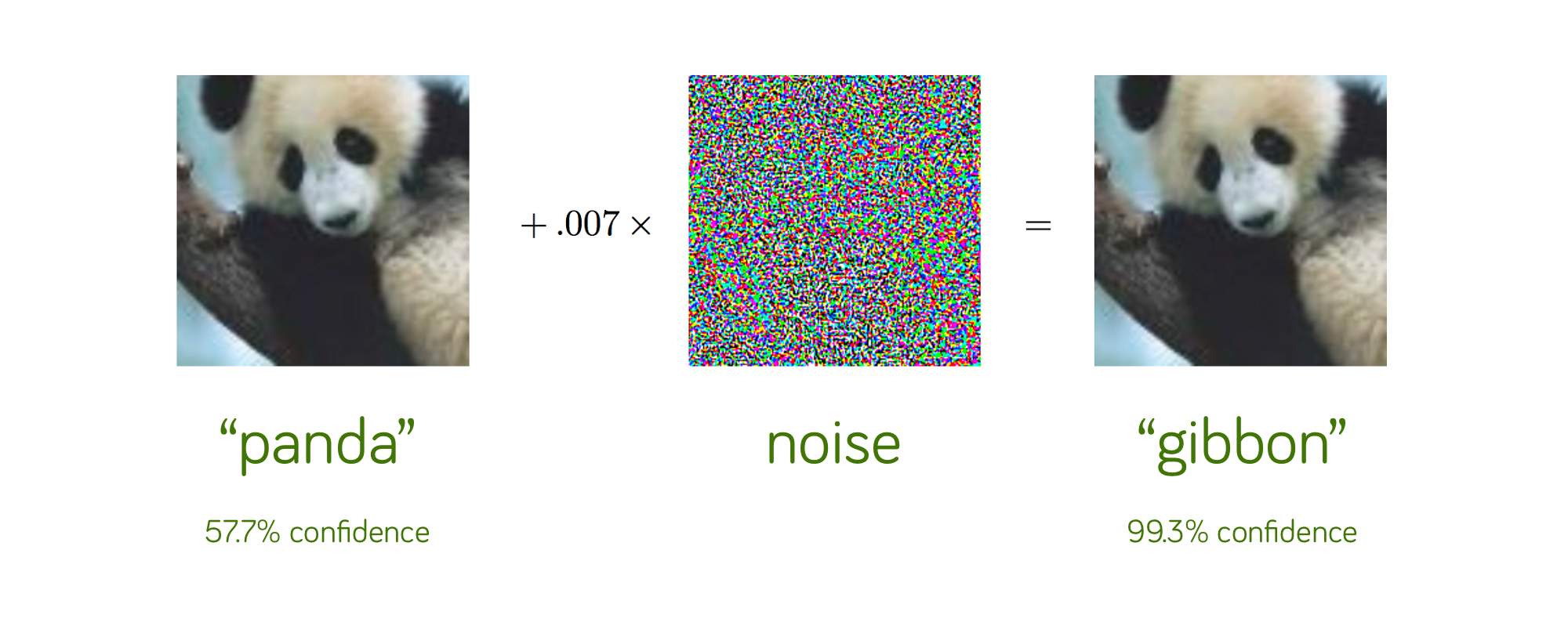

직관적으로는 작은 perturbation이 모델의 예측을 바꿀 수 없으리라 생각된다. 그러나, 이 논문에서는 작은 perturbation을 통해서도 모델의 예측을 바꿀 수 있음이 밝혀졌다. 이러한 perturbation은 loss function을 최소화하는 방향으로 구할 수 있다.

finding perturbation

를 image에서 k개의 label로 mapping하는 classifier라 하자

를 연속적인 loss function이라 하자.

주어진 라벨 과 image 에 대해, 다음의 box-constrained optimization problem를 푸는 것을 목표로 한다.

그러나, 이를 정확히 계산하는 것은 어려운 문제이므로, box-constrained L-BFGS를 사용해 근사값을 구한다. L-BFGS의 수학적 기반은 더 조사 및 공부가 필요하다.

의의

- L2 norm을 기준으로 했기 때문에, L-BFGS가 기존의 input과 매우 유사한 adversarial example을 생성해낼 수 있다.(당시 sota인 alexnet과 quocnet을 상대로 효율적이었음)

- adversarial example의 생성 프로세스를 최적화 문제로 모델링함으로써, objective function을 기준으로 잡을 수 있게 됐다. (어느 모델이든 objefctive function이 존재하니, 유연하다)

Reference

Intriguing properties of neural networks

On the limited memory BFGS method for large scale optimization