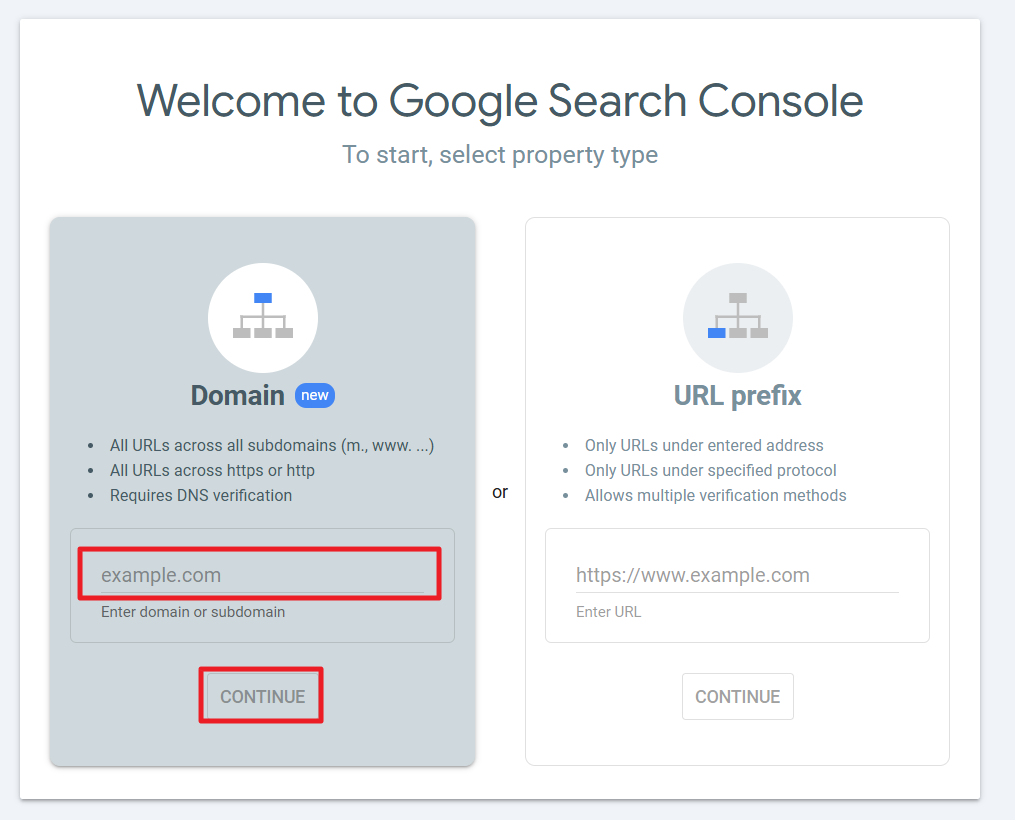

구글 Search Console에는 두가지 방법이 있다.

1. Domain 등록 방식

- 장점 : 연관된 모든 서브사이트가 한번에 등록된다.

사이트맵을 일일이 작성할 필요가 없다. - 단점 : 특정 사이트 예외처리가 안된다.

DNS인증이 필요하다. (인프라에 부탁 드려야해서 귀찮음)

1) Domain을 선택하고 URL구조 중 도메인만 작성한다. (example.com)

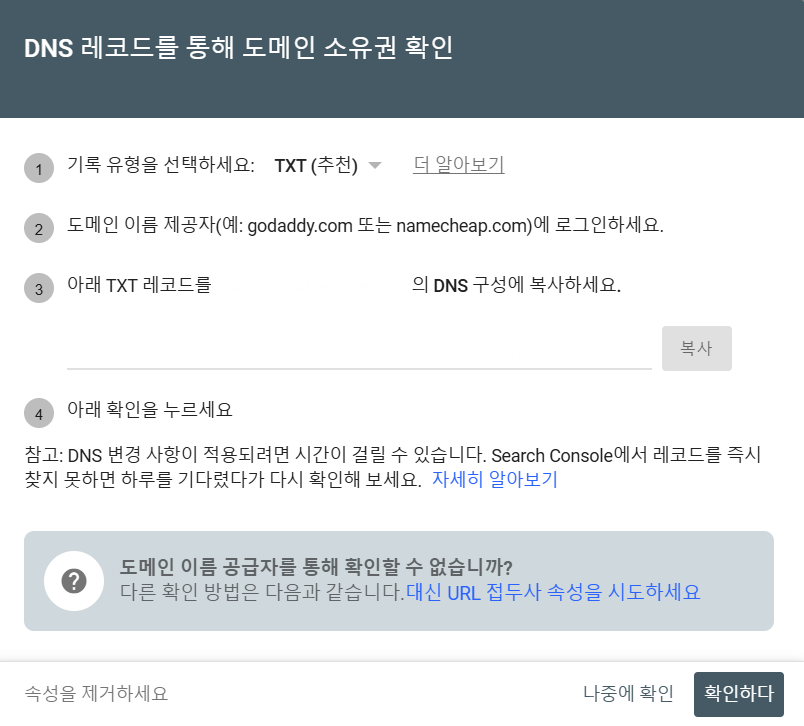

2) 생성된 TXT레코드를 복사하여 DNS 구성에 추가한후 확인버튼을 누른다.

참고로 나는 DNS구성에 등록할 수 있는 권한이 없어서

소스코드 내부에 아래와같이 meta태그로 등록했는데, 인증에 실패했다... DNS에 등록하도록 하자

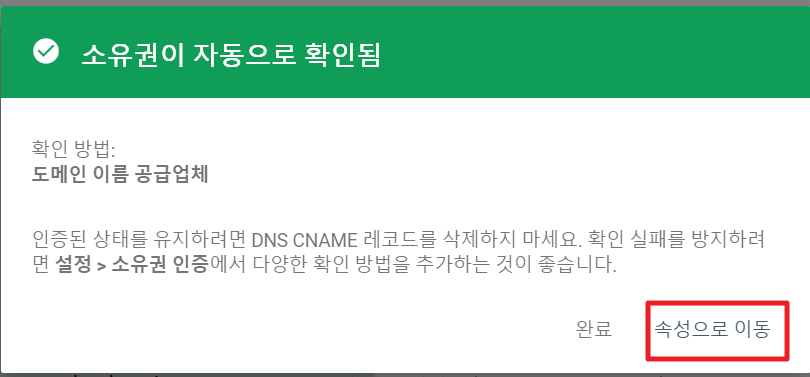

<meta name="google-site-verification" content="전달받은 txt레코드" />3) 확인 창이 뜨면 속성으로 이동한다.

2. 사이트맵 등록방식

1) URL 접두사 방식을 선택한다.

이때는 프로토콜 + 도메인이 합쳐진 URL을 넣으면 된다.

다만 쿼리 파라미터는 안넣어도됨.

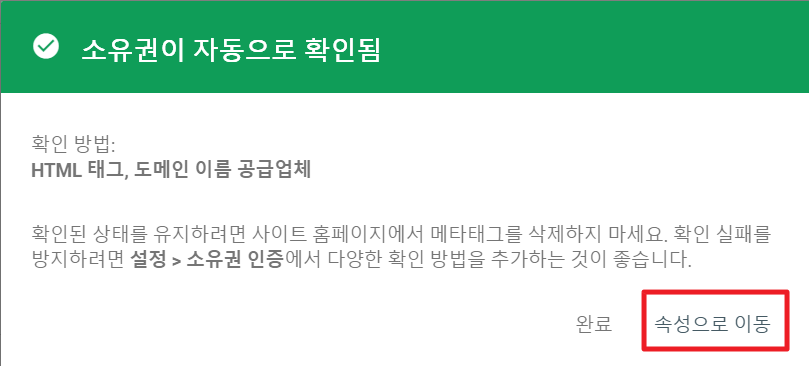

2) URL만 안틀리면 쉽게 성공 가능하다.

속성으로 이동한다.

3) 사이트맵 등록방식의 가장 중요한단계는 사이트맵 등록이다.

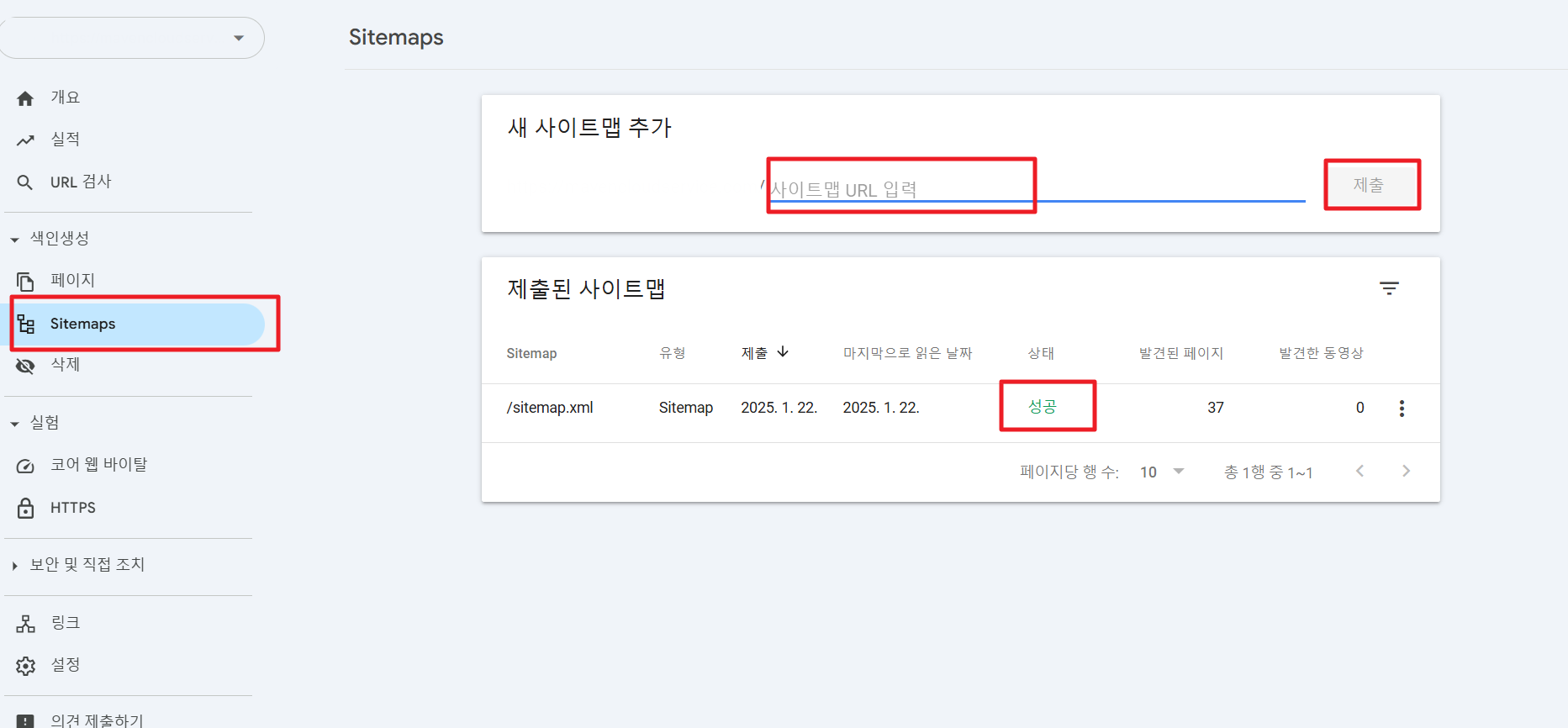

속성 -> Sitemap -> sitemap.xml 상대경로 입력 -> 제출

참고로 나는 여러번 실패했다.

사이트맵 실패 시 대처법 (상태값 : 가져올 수 없음)

sitemap.xml파일을 잘 작성하고, robots.txt파일만 제대로 작성하면 웬만해선 실패할 일이 없다.

- 사이트맵 등록은 xml파일로

: 처음에 나는 따온 URL을 모두 입력해야하는건줄 알고 뻘짓을 했다.

이게 아니라 xml 파일에 URL을 형식에 맞춰서 입력하고 xml파일로 저장해야한다.

작성법은 아래와 같다.

사이트맵 파일 작성법

URL로 접근 가능한 모든 페이지의 URL을 딴다.

아래의 형식으로 sitemap.xml파일을 생성하고 따낸 url은 loc태그 내부에 작성한다.

lastmod 태그의 날짜는 YYYY-MM-DD 형식으로 작성한다.<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9"> <url> <loc>url 1</loc> <lastmod>2025-01-22</lastmod> </url> <url> <loc>url 2</loc> <lastmod>2025-01-22</lastmod> </url> </urlset>우선순위나 업데이트 주기 태그도 추가하는 경우가 있지만 필수는 아니다. 제일중요한건 loc태그에 URL적기!!

URL은 쿼리 파라미터(url의 ?뒤에 오는 문자열)까지 적어주어야 한다.파일은 프로젝트 root경로에 저장하는것이 일반적이다.

- robots.txt파일을 점검하자.

robots.txt파일은 특정 사이트의 크롤링을 차단하는것이다.

만약 xml파일을 잘 작성하고 경로도 틀리지 않았는데, 사이트맵 등록에 실패한다면

프로젝트 파일에 robotx.txt파일이 있는지 체크하자.

참고로 나는 robotx.txt파일에 아래와 같이 모든 사이트가 차단되어 있었다...

User-agent:*

Disallow: /작성법은 간단하다.

User-agent 는 크롤링 사이트 이름이고

Disallow는 내가 허락하지 않는 경로이다.

만약 내가 구글크롤링의 sitemap.xml에 대한 접근권한을 허용하려면 아래와 같이 작성하면 된다.

User-agent: Googlebot

allow: /

User-agent: googlebot-image

allow: /

User-agent: googlebot-mobile

allow: / 예외로 접근을 제한하려는 페이지 (ex.관리자화면) 같은 경우는 아래와 같이 작성한다.

User-agent: *

Disallow : /secret끝으로, 인덱싱(색인)은 일주일정도 쌓고나서 확인하면 된다. 바로 생성되지 않는다.