논문 링크

무려 올해 2월에 arxiv에 게재된 최신 논문...! 이다.

한줄요약: Undersampled k-space 데이터만을 사용하여 NeRF로 reconstruction

논문 읽기 전에 NeRF가 뭔지 알아보고 들어가도록 하자. (히히 GPT한테 물어볼거임)

NeRF(Neural Radiance Field) : 여러 2D 이미지를 입력받아 3D scene을 생성하는 모델

(약간 예전에 연구했던 Fourier Ptychographic Microscopy(FPM) 생각나긴 하는데 얘는 딥러닝 안쓰니까 좀다른 것 같다. NeRF에 대한 자세한 리뷰는 다른 포스팅에서 해야겠다!)

NeRF 논문 링크

🍞 1. Introduction

- High-resolution MR 이미지 생성에 있어 Undersampled MR 이미지의 중요성과 관심이 증가하고 있다~~

- 우리의 목표: image quality 저하 없이 mr scan time을 최소화하는 것

- 기존 방식: undersample 시 aliasing artifact가 발생 + recon 시 train data의 양, 질, 다양성 등에 크게 의존

----------> 광범위한 데이터셋 없이도 특정 k-space에 대해 적용 가능한 NeRF를 활용한 방법 제시

🍞 2. Method

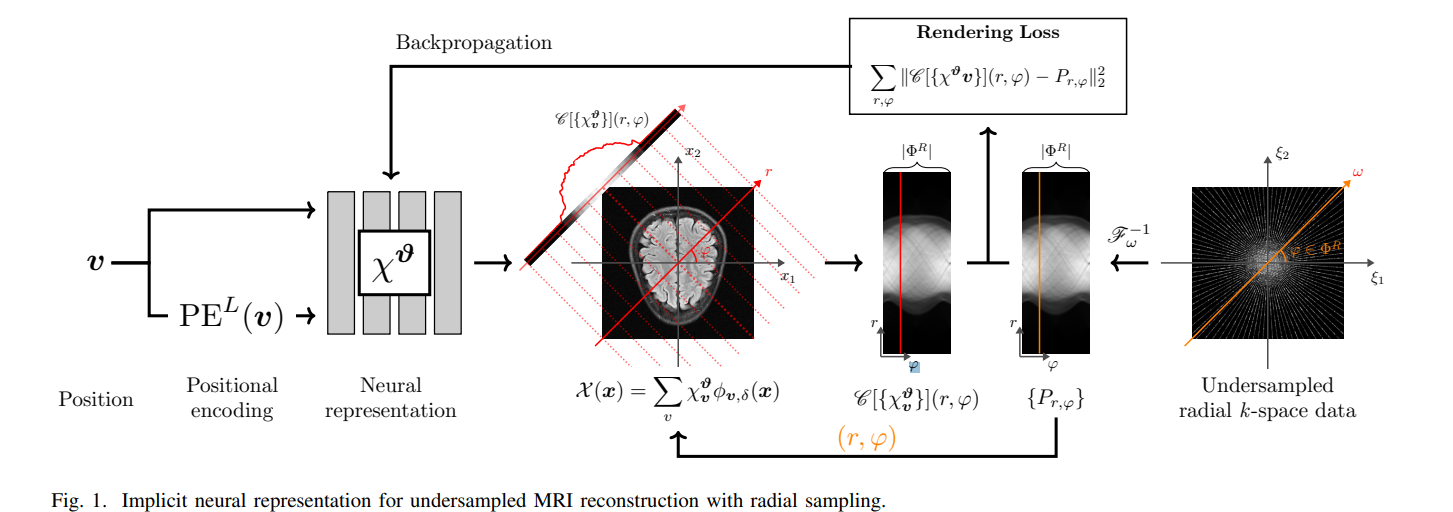

수식이 진짜 개많은데... 일단 그림으로 이해해보자.

**여기서 나오는 positional encoding 개념은 transformer의 개념과 다르다!

우선 radial undersampling을 이용한다는걸 알면 대충 이해될거다.

히히 뭐 역문제랑 증명 막 나오는데 대충 영어만 읽고 그러려니 해야지

🍞 3. Result

🌿 Experimental set-up

- FastMRI의 뇌와 무릎 데이터셋을 활용 + radial undersampling

- zero-padded 된 이미지에 NUFFT(Non-Uniform Fast Fourier Transform)을 적용하여 452x452 얻음. (기존 320x320)

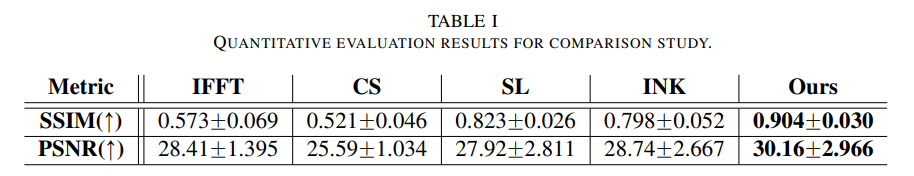

- SSIM과 PSNR 지표로 recon 이미지 평가

- Intel Xeon CPUs E5-2630 v4 / 4개의 NVIDIA GeForce GTX 3080Ti GPU 사용 (

부럽다..)

🌿 Comparison study

비교 대상: IFFT(ifft 이용한 zero filling), CS(total variation penalty 이용한 Compressed Sensing), SL(TransUNet 사용한 지도학습), INK(neural representation 이용한 k-space interpolation)

- NeRF는 SL과 비교적 유사, 나머지보다 우수한 성능을 보임.

- k-space에서의 neural representation이 accuracy와 stability 측면에서 덜 효과적.

- SL에 비해 anatomical(해부학적) detail 더 잘 유지 -> 주어진 데이터에 대해 더 높은 adaptiveness 가지기 때문

- SL은 훈련 데이터의 양 등에 의존하지만, NeRF를 사용한 방식은 훈련 데이터의 양 등에 상관없이 효과적 recon 가능

🍞 4. Conclusion and Discussion

이 논문은 sparse한 view-rendering 정보로 임의의 view에서 이미지 추론 가능한 NeRF 사용했다.

radial sampling을 통해 undersampled 된 MR 영상이 위에 언급한 sparse한 view-rendering으로부터의 이미지 모델링과 동등함.

- NeRF와의 차이: 제안된 방법론은 모델의 실현에 초점

- implicit neural representation

- anatomical detail 더 잘 포착

암튼 뭐 미래에 기여할 수 있다.

NeRF 기반의 방식으로 medical imaging 분야에서 새로운 가능성을 열었다 ~~

간단한 리뷰가 되어버렸는데... 수식 생략해서 그런가

SoTA 정도는 아니었고, 이러한 방법도 있다 라는 것을 소개하는 논문인가보다.

당신 개발자였냐고..