백본 네트워크

1. 딥러닝 논문의 구조

논문의 형식적 구조

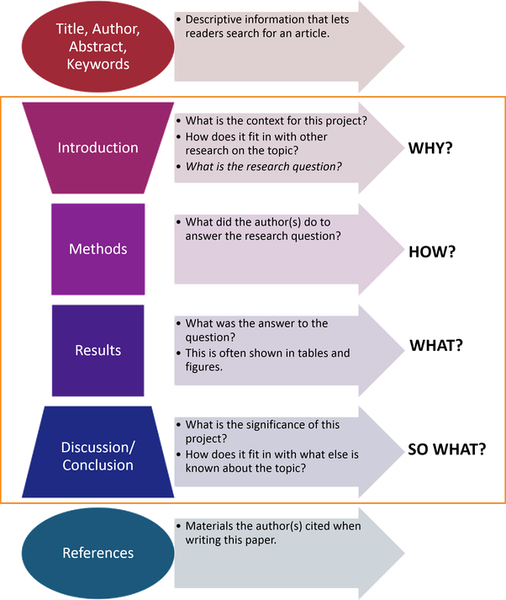

논문의형식은 아래와 같은 논리 구조를 담고 있습니다.

- 이전까지의 연구가 해결하지 못했던 문제의식

- 이 문제를 해결하기 위한 그동안의 다른 시도들

- 이 문제에 대한 이 논문만의 독창적인 시도

- 그러한 시도가 가져온 차별화된 성과

위 논리구조는 아래의 형식으로 정리됩니다.

초록(Abstract), 서론(Introduction), 관련 연구(Related work), 실험(Experiments), 결론(Conclusion)

2. ResNet의 핵심 개념과 그 효과

1) ResNet 논문의 문제의식

서론(Introduction)에서 ResNet 논문이 최초로 제기하는 질문은 딥러닝 모델의 레이어를 깊이 쌓으면 항상 성능이 좋아지는가 하는 것입니다. 그러나 레이어를 깊이 쌓았을 때 Vanishing/Exploding Gradient 문제가 발생하여 모델의 수렴을 방해하는 문제는 이미 몇 가지 대응 방법이 알려져 있습니다. (ex. normalized initialization, intermediate normalization layers)

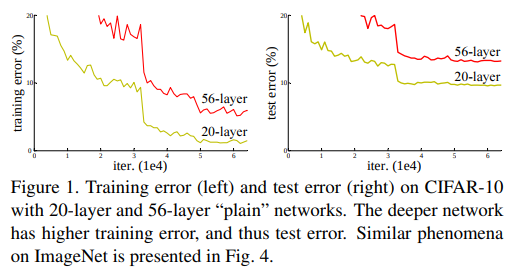

문제의 핵심은 Degradation Problem입니다. 이것은 레이어를 깊이 쌓았을 때 모델이 수렴하고 있음에도 불구하고 발생하는 문제입니다. 모델의 레이어가 깊어졌을 때 모델이 수렴했음에도 불구하고 오히려 레이어 개수가 적을 때보다 training/test error가 더 커지는 현상이 발생하는데, 이것은 모버피팅 때문이 아니라 네트워크 구조상 레이어를 깊이 쌓았을 때 최적화가 잘 안되기 때문에 발생하는 문제입니다. 아래의 그래프가 이 문제의 핵심을 잘 보여줍니다.

2) ResNet 논문이 제시한 솔루션 : Residual Block

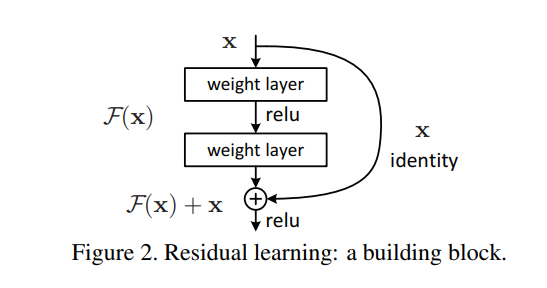

ResNet은 깊은 네트워크 학습이 어려운 점을 해결하기 위해 레이어의 입력값을 활용하여 레이어가 "residual function" (잔차 함수)을 학습하도록 합니다.

간단히 말하면, 지름길(shortcut connection)을 통해 레이어가 입력값을 직접 참조하도록 레이어를 변경한 것입니다.

위의 구조와 같이 학습해야 할 레이어 를 로 만듭니다. 그러면 가 Vanishing Gradient현상으로 전혀 학습이 안되어 zero mapping이 될지라고, 최종 는 최소한 identity mapping이라도 되어 성능 저하는 발생하지 않게 됩니다. 이때 실제로 학습해야 할 는 학습해야할 레이어 에다 입력값 를 뺀 형태, 즉 잔차(Residual)함수를 학습시키는 것이 를 직접 학습하는 것보다 훨씬 학습이 쉽습니다.

3) Experiments

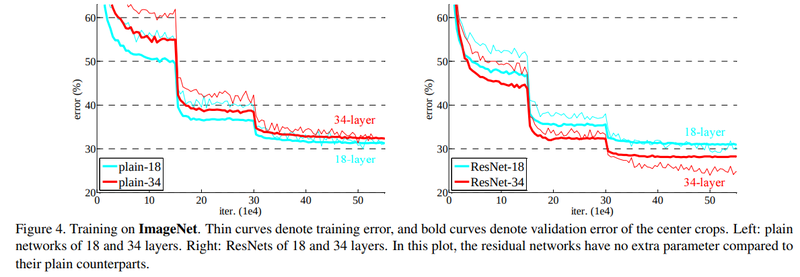

논문에서는 모델의 설계를 설명한 뒤 모델을 실제로 구현해 그 효과를 입증합니다. 실제 논문에서는 shortcut connection의 유무와 네트워크 깊이에 따라 경우를 나누어 모델을 구현합니다.

위 그림에서 34개 층을 갖는 네트워크가 18개 층을 갖는 네트워크보다 오류율(error rate)이 높습니다. 하지만 shortcut이 적용된 오른쪽에서는 레이어가 깊어져도 학습이 잘 되는 효과를 볼 수 있습니다.

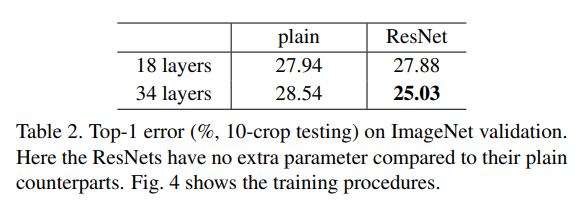

위 표는 이미지넷 검증 데이터셋을 사용해 실험한 결과를 나타냅니다. Top-1 error란 모델이 가장 높은 확률 값으로 예측한 class 1개가 정답과 일치하는지 보는 경우의 오류율입니다. Top-5는 모델이 예측한 값들 중 가장 높은 확률 값부터 순서대로 5개 class 중 정답이 있는지를 보는 것입니다.

일반 네트워크(plain)은 네트워크가 깊어져도 오류율은 오히려 높아진 것을 확인할 수 있습니다.

어떤 task의 모델 간 성능을 비교할 때 널리 사용되어 기준이 되는 데이터셋을 벤치마크 데이터셋이라고 합니다. 이를 통해 SOTA(State of the art)를 기록하는 모델을 가리기도 합니다. 논문의 실험에서는 ResNet에 앙상블(ensemble)을 적용한 모델과 다른 앙상블 모델을 비교한 표를 제시합니다.