본 내용은 참고 사이트를 읽고 정리한 내용입니다.

궁금한 부분은 참고사이트를 이용해주시면 감사하겠습니다.

entropy - 최적의 전략 하에서 필요한 질문에 대한 개수

cross entropy - 어떤 문제에 대해 특정 전략을 쓸 때, 예상되는 질문 개수에 대한 기대값

CS(Cross Entropy)

- 잘 못 에측한 경우에 대하여 패널티를 부여하는 것에 초첨.

- positive와 negative의 비중을 제대로 조율 못한다.

원래 cross entropy 식은 아래와 같다.

p는 참값 또는 목표 확률값이다. y는 학습한 확률값

CE(p,y)={−log(p),y=1−log(1−p),otherwise

여기에 p라는 조건을 붙게 되면

pt={p,y=11−p,otherwise

아래와 같이 깔끔하게 정리가 된다.

CE(pt)=−log(pt)

Balanced Cross Entropy

- cross entropy에 α라는 가중치를 조절하는 값?변수?를 추가하게된다.

- positive/negative를 조절할 수 있게된다.

α의 조건식은 아래와 같다.

α={α,y=11−α,otherwise

최종 Balanced Cross Entropy 식이다.

CE(pt)=−αlog(pt)

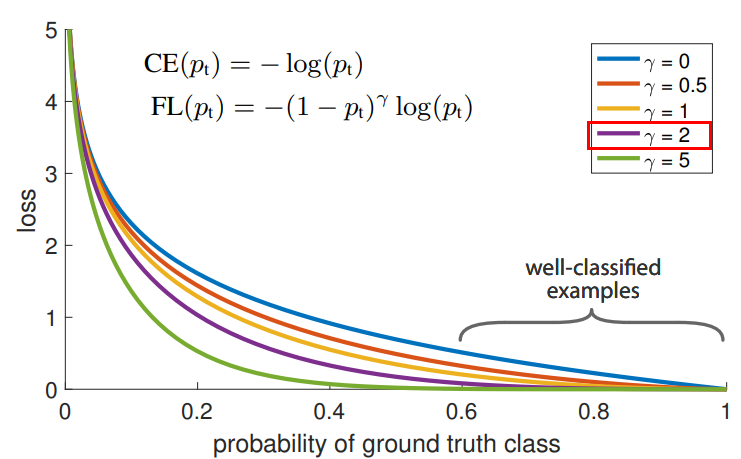

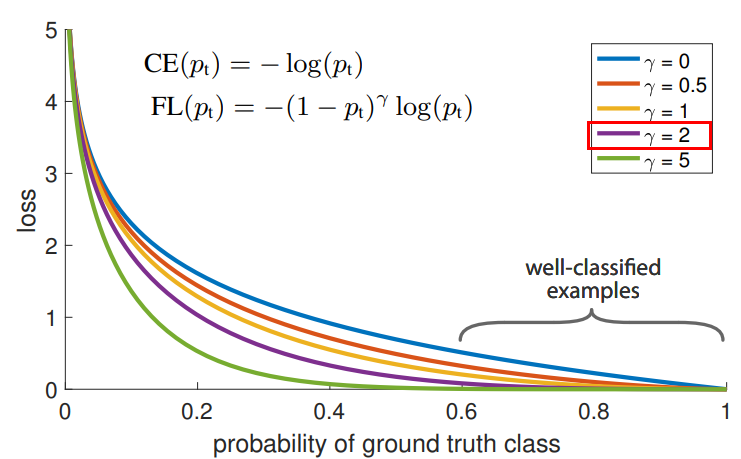

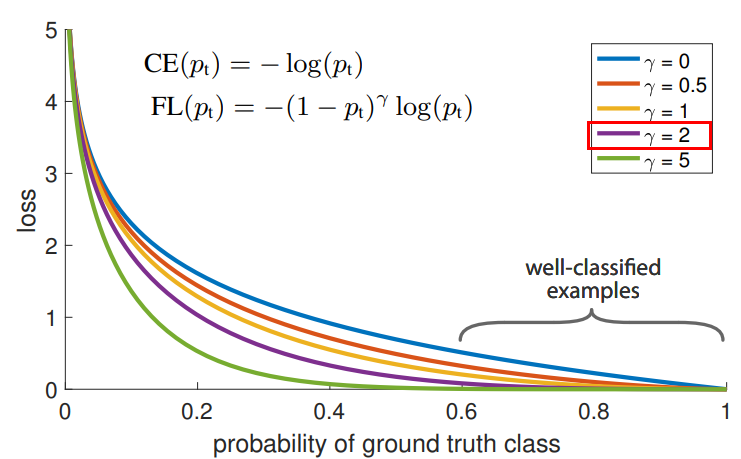

그림을 보면 CE(p)와 FL(p)의 차이점이 (1−pt)γ가 추가된 것을 알 수 있다.

Focal Loss

-

non-alpha form

FL(pt)=−(1−pt)γlog(pt)

-

alpah form

FL(pt)=−αt(1−pt)γlog(pt)

참고 사이트