오토 인코더가 적용되기 적합한 상황에 대해 설명하고, 오토 인코더를 구성하는 인코더(Encoder)와 디코더(Decoder) 각각의 개념과 차이점에 대해 설명하세요.

오토인코더(Autoencoder)란?

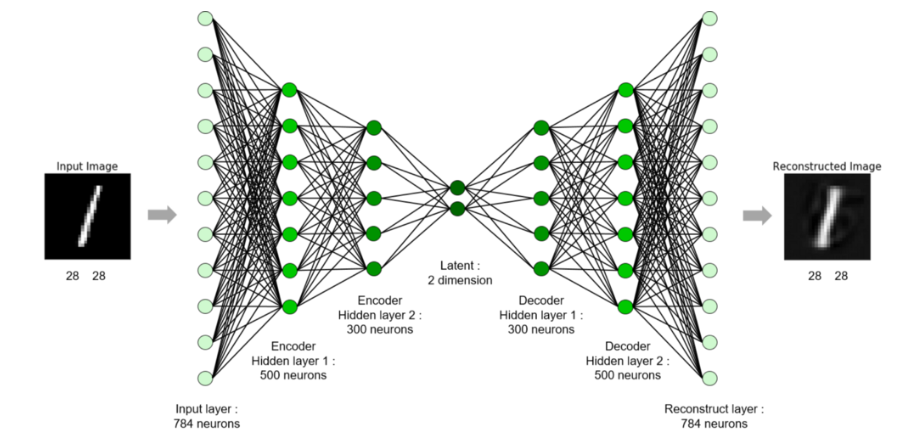

오토인코더는 입력 데이터가 들어왔을 때, 해당 데이터를 최대한 압축시킨 후, 데이터의 특징을 추출하여 다시 본래의 입력 형태로 복원시키는 신경망이다. 이때, 데이터를 압축하는 부분을 Encoder, 복원하는 부분을 Decoder라고 한다.

인코더(Encoder)와 디코더(Decoder)

인코더(Encoder)는 입력 데이터를 압축하는 역할을 한다. 이 과정에서 입력 데이터의 중요한 특징만 추출하고, 불필요한 정보를 제거한다. 예를 들어, 고차원 데이터에서 주요 패턴만 학습하는 역할을 한다.

반대로 디코더(Decoder)는 잠재 공간에서 압축된 표현을 다시 원래 데이터로 복원하는 역할을 한다. 디코더는 인코더가 학습한 특징을 기반으로 데이터의 세부 정보를 복원하며, 입력 데이터와 유사한 출력을 생성한다.

| 구분 | 인코더(Encoder) | 디코더(Decoder) |

|---|---|---|

| 기능 | 데이터를 압축하여 특징을 추출 | 압축된 데이터를 원래 형태로 복원 |

| 출력 차원 | 입력보다 작은 차원 (보통) | 입력과 동일한 차원 |

| 역할 | 데이터의 핵심 정보를 유지 | 압축된 정보를 이용해 원본 복원 |

| 예시 | 이미지에서 특징 벡터 추출 | 특징 벡터에서 원본 이미지 생성 |

| 활용 분야 | 차원 축소, 특징 학습, 문장 인코딩 | 데이터 복원, 생성 모델 (GAN, VAE) |

오토인코더를 사용할 때

1) 차원 축소

오토인코더는 입력 데이터를 압축한 뒤, 다시 원래 크기로 복원하도록 학습하는 신경망이다. 이 과정에서 데이터의 핵심적인 특징만을 남기고 불필요한 정보를 제거하기 때문에 차원 축소에 사용된다.

2) 노이즈 제거

Denoising Autoencoder(DAE)는 일반 오토인코더와 동일한 구조이지만, 학습 시 일부러 노이즈가 포함된 데이터를 입력하고, 깨끗한 원본 데이터를 복원하도록 학습한다.

노이즈는 랜덤한 요소로 존재하기 때문에, 오토인코더는 노이즈를 학습하지 않는다. 반면, 원본 데이터의 주요 특징은 반복적으로 나타나기 때문에 모델이 이를 학습하고 복원하는 능력이 향상된다.

즉, 모델은 입력 데이터의 노이즈를 제거한 후, 핵심적인 특징만 복원하는 걸 반복 학습하게 되는 것이다.

3) 이상치 탐지

정상 데이터를 학습한 모델은 이상 데이터를 복원하기 어려워 한다. 이상치는 자연스럽게 학습에서 누락되지 때문에, 이를 기반으로 이상치를 탐지할 수 있다.