k-최근접 이웃 회귀

회귀(regression)는 클래스 중 하나로 분류하는 것이 아니라 임의의 어떤 숫자를 예측하는 문제임.

ex. 내년도 경제 성장률을 예측하거나 배달이 도착할 시간을 예측하는 것

ex. 주어진 문제처럼 농어의 무게를 예측하는 것

데이터 준비

perch_length = np.array([8.4, 13.7, 15.0, 16.2, 17.4, 18.0, 18.7, 19.0, 19.6, 20.0, 21.0,

21.0, 21.0, 21.3, 22.0, 22.0, 22.0, 22.0, 22.0, 22.5, 22.5, 22.7,

23.0, 23.5, 24.0, 24.0, 24.6, 25.0, 25.6, 26.5, 27.3, 27.5, 27.5,

27.5, 28.0, 28.7, 30.0, 32.8, 34.5, 35.0, 36.5, 36.0, 37.0, 37.0,

39.0, 39.0, 39.0, 40.0, 40.0, 40.0, 40.0, 42.0, 43.0, 43.0, 43.5,

44.0])

perch_weight = np.array([5.9, 32.0, 40.0, 51.5, 70.0, 100.0, 78.0, 80.0, 85.0, 85.0, 110.0,

115.0, 125.0, 130.0, 120.0, 120.0, 130.0, 135.0, 110.0, 130.0,

150.0, 145.0, 150.0, 170.0, 225.0, 145.0, 188.0, 180.0, 197.0,

218.0, 300.0, 260.0, 265.0, 250.0, 250.0, 300.0, 320.0, 514.0,

556.0, 840.0, 685.0, 700.0, 700.0, 690.0, 900.0, 650.0, 820.0,

850.0, 900.0, 1015.0, 820.0, 1100.0, 1000.0, 1100.0, 1000.0,

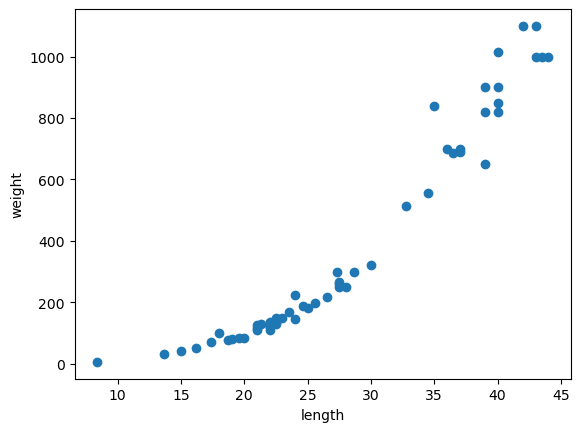

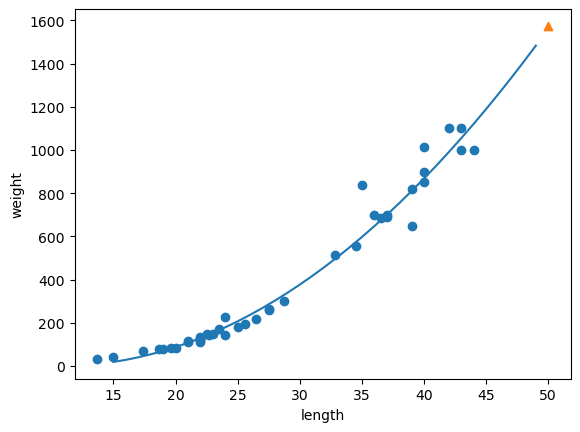

1000.0])- 데이터가 어떤 형태를 띠고 있는지 산점도로 그려보자.

- 하나의 특성을 사용하기 때문에 특성 데이터를 x축에 놓고, 타깃 데이터를 y축에 놓음.

import matplotlib.pyplot as plt

plt.scatter(perch_length, perch_weight)

plt.xlabel('length')

plt.ylabel('weight')

plt.show()농어의 길이가 커짐에 따라 무게가 늘어남.

- train_test_split( ) 함수를 사용해 훈련 세트와 테스트 세트로 나눔. (결과를 동일하게 유지하기 위해 random_state=42)로 지정.

- 사이킷런에 사용할 훈련 세트는 2차원 배열이어야 함.

이런 1차원 배열을 1개의 열이 있는 2차원 배열로 바꾸어야 함.

- 넘파이 배열은 크기를 바꿀 수 있는 reshape( )메소드를 제공함.

test_array = np.array([1,2,3,4])

print(test_array.shape)

### 결과 : (4,)

test_array = test_array.reshape(2,2)

print(test_array.shape)

### 결과 : (2, 2)- 메서드를 사용해 train_input( )과 test_input( )을 2차원 배열로 바꾸자.

넘파이는 배열의 크기를 자동으로 지정하는 기능도 제공하는데, 크기에 -1에 지정하면 나머지 원소 개수로 모두 채우라는 의미임.

ex. train_input.reshape(-1, 1)은 첫 번째 크기를 나머지 원소 개수로 채우고, 두 번째 크기를 1로 하는 것임.

train_input = train_input.reshape(-1,1)

test_input = test_input.reshape(-1,1)

print(train_input.shape, test_input.shape)

### 결과 : (42, 1) (14, 1)- reshape(-1, 1)과 같이 사용하면 배열의 전체 우너소 개수를 매번 외우지 않아도 되므로 편리함.

결정계수(R^2)

rom sklearn.neighbors import KNeighborsRegressor

knr = KNeighborsRegressor()

# k-최근접 이웃 회귀 모델을 훈련

knr.fit(train_input, train_target)

print(knr.score(test_input, test_target))

### 결과 : 0.992809406101064R^2 = (타깃-예측)^의 합 / (타깃-평균)^2의 합

-

타깃의 평균을 예측하는 수준이라면 R^2는 0에 가까워짐.

-

예측이 타깃에 아주 가까워지면 1에 가까운 값이 됨.

-

하지만 정확도처럼 R^2가 직감적으로 얼마나 좋은지 이해하기는 어려움.

-

타깃과 예측한 값 사이의 차이를 구해 보면 어느 정도 예측이 벗어났는지 가능하기 좋음.

from sklearn.metrics import mean_absolute_error

# 테스트 세트에 대한 예측 만들기

test_prediction = knr.predict(test_input)

# 테스트 세트에 대한 평균 절댓값 오차를 계산

mae = mean_absolute_error(test_target, test_prediction)

print(mae)

### 결과 : 19.157142857142862- 만약 훈련 세트를 사용해 평가하면 어떨까?

print(knr.score(train_input, train_target))

### 결과 : 0.9698823289099254과대적합 vs 과소적합

과대적합(overfitting) : 모델의 훈련 세트 성능이 테스트 성능보다 훨씬 높을 때 발생. 모델이 훈련 세트에 너무 집착해서 데이터에 내재된 거시적인 패턴을 감지하지 못함.

과소적합(underfitting) : 훈련 세트와 테스트 성능이 모두 동일하게 낮거나 테스트 세트 성능이 오히려 높을 때 발생. 이런 경우 더 복잡한 모델을 사용해 훈련 세트에 잘 맞는 모델을 만들어야 함.

- 훈련 세트가 전체 데이터를 대표한다고 가정하기 때문에 훈련 세트를 잘 학습하는 것이 중요함.

- k-최근접 이웃 회귀로 평가한 훈련 세트와 테스트 세트의 점수는 훈련 세트보다 테스트 세트의 점수가 높으니 과소적합함.

- 따라서 모델을 조금 더 복잡하게 만들면 됨.

⇒ k-최근접 이웃 알고리즘으로 모델을 더 복잡하게 만드는 방법은 이웃의 개수 k를 줄이는 것임.

⇒ 이웃의 개수를 줄이면 훈련 세트에 있는 국지적인 패턴에 민감해지고, 이웃의 개수를 늘리면 데이터 전반에 있는 일반적인 패턴을 따를 것임.

# 이웃의 개수를 3으로 설정

knr.n_neighbors = 3

# 모델을 다시 훈련

knr.fit(train_input, train_target)

print(knr.score(train_input, train_target))

### 결과 : 0.9804899950518966print(knr.score(test_input, test_target))

### 결과 : 0.9746459963987609- 테스트 세트의 점수는 훈련 세트보다 낮아졌으므로 과소적합 문제를 해결한 것 같음.

- 또한 두 점수의 차이가 크지 않으므로 이 모델이 과대적합 된 것 같지도 않음.

k-최근접 이웃의 한계

- 이 모델을 활용하여 길이가 50cm인 농어의 무게를 예측해보자.

print(knr.predict([[50]]))

### 결과 : [1033.33333333]- 혼공머신의 모델은 50cm 농어의 무게를 1,033g 정도로 예측함.

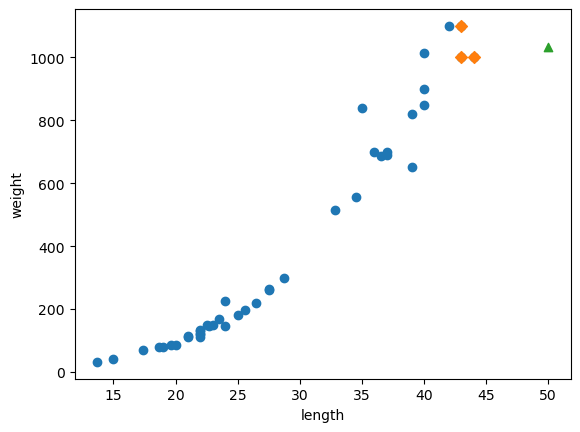

import matplotlib.pyplot as plt

# 50cm 농어의 이웃 구하기

distances, indexes = knr.kneighbors([[50]])

# 훈련 세트의 산점도를 구하기

plt.scatter(train_input, train_target)

# 훈련 세트 중에서 이웃 샘플만 다시 그리기

plt.scatter(train_input[indexes], train_target[indexes], marker='D')

# 50cm 농어 데이터

plt.scatter(50, 1033, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

# 이웃 샘플의 타깃의 평균 구하기

print(np.mean(train_target[indexes]))

### 결과 : 1033.3333333333333- k-최근접 이웃 회귀는 가장 가까운 샘플을 찾아 타깃을 평균함. 따라서 새로운 샘플이 훈련 세트의 범위를 벗어나면 엉뚱한 값을 예측할 수 있음.

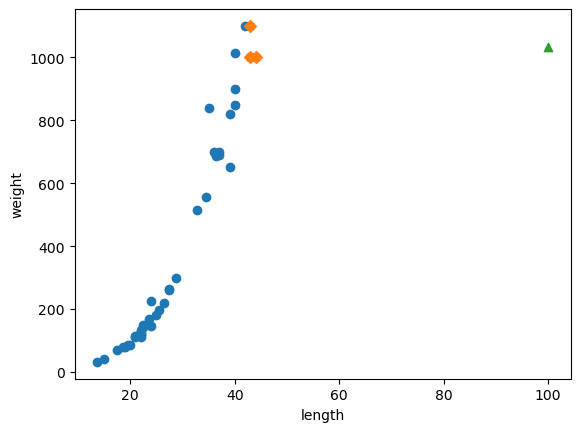

- 예를 들어 길이가 100cm인 농어도 여전히 1,033g으로 예측함.

print(knr.predict([[100]]))

### 결과 : [1033.33333333]

# 100cm 농어의 이웃을 구하기

distances, indexes = knr.kneighbors([[100]])

# 훈련 세트의 산점도 그리기

plt.scatter(train_input, train_target)

# 훈련 세트 중에서 이웃 샘플만 다시 그리기

plt.scatter(train_input[indexes], train_target[indexes], marker='D')

# 100cm 농어 데이터

plt.scatter(100, 1033, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()- k-최근접 이웃을 사용해 이 문제를 해결하려면 가장 큰 농어가 포함되도록 훈련 세트를 다시 만들어야 함.

선형 회귀

선형 회귀(linear regression)는 특성과 티깃 사이의 관계를 가장 잘 나타내는 선형 방정식을 찾음. 특성이 하나면 직선 방정식이 됨.

from sklearn.linear_model import LinearRegression

lr = LinearRegression()

# 선형 회귀 모델을 훈련

lr.fit(train_input, train_target)

# 50cm 농어에 대해 예측

print(lr.predict([[50]]))

### 결과 : [1241.83860323]- 사이킷런은 LinearRegression 클래스로 선형 회귀 알고리즘을 구현해놓음.

- k-최근접 이웃 회귀를 사용했을 때와 달리 선형 회귀는 50cm 농어의 무게를 아주 높게 예측하였음.

선형 방정식은 a×x+b로 구성.

- LinearRegression 클래스가 찾은 a와 b는 lr 객체의 coef와 intercept 속성에 저장되어 있음.

print(lr.coef_, lr.intercept_)

### 결과 : [39.01714496] -709.0186449535477- 모델 파라미터(model parameter)란 coef_나 intercept_처럼 머신러닝 모델이 특성에서 학습한 파라미터를 말함.

- 많은 머신러닝 알고리즘의 훈련 과정은 최적의 모델 파라미터를 찾는 것과 같음. 이를 모델 기반 학습이라고 부름.

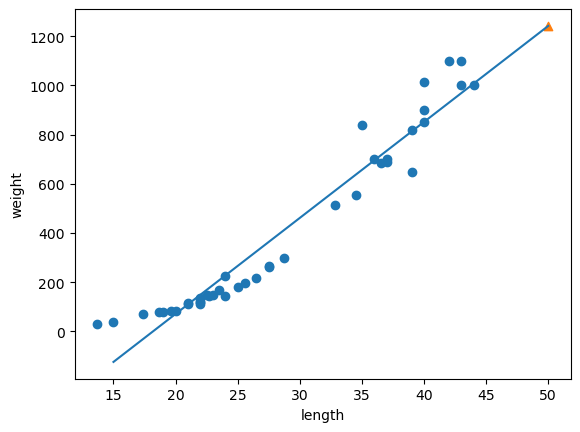

# 훈련 세트의 산점도를 그림

plt.scatter(train_input, train_target)

# 15에서 50까지 1차 방정식 그래프를 그림

plt.plot([15,50],[15*lr.coef_+lr.intercept_, 50*lr.coef_+lr.intercept_])

# 50cm 농어 데이터

plt.scatter(50, 1241.8, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()print(lr.score(train_input, train_target)) # 훈련 세트

### 결과 : 0.939846333997604

print(lr.score(test_input, test_target)) # 테스트 세트

### 결과 : 0.8247503123313558- 훈련 세트외 테스트 세트의 점수가 차이가 나는데, 훈련 세트의 점수도 높지 않으므로, 오히려 전체적으로 과소적합되었다고 볼 수 있음.

다항 회귀

- 선형 회귀가 만든 직선이 왼쪽 아래로 쭉 뻗어 있는데, 이 직선대로면 농어의 무게가 0g 이하로 내려갈 것임.

- 농어의 길이와 무게에 대한 산점도를 자세히 보면 일직선보다 왼쪽 위로 조금 구부러진 곡선에 가까움.

- 2차 방정식의 그래프를 그리려면 길이를 제곱한 항이 훈련 세트에 추가되어야 함.

train_poly = np.column_stack((train_input ** 2, train_input))

test_poly = np.column_stack((test_input ** 2, test_input))

print(train_poly.shape, test_poly.shape)

### 결과 : (42, 2) (14, 2)- 원래 특성인 길이를 제곱하여 왼쪽 열에 추가했기 때문에 훈련 세트와 테스트 세트 모두 열이 2개로 늘어남.

- 2차 방정식 그래프를 찾기 위해 훈련 세트에 제곱 항을 추가했지만, 타깃값은 그대로 사용한다는 것임.

목표하는 값은 어떤 그래프를 훈련하든지 바꿀 필요가 없음.

lr = LinearRegression()

lr.fit(train_poly, train_target)

print(lr.predict([[50**2, 50]]))

### 결과 : [1573.98423528]

print(lr.coef_, lr.intercept_)

### 결과 : [ 1.01433211 -21.55792498] 116.05021078278259-

모델은 다음과 같은 그래프를 학습함. 이러한 식을 다항식이라고 부름.

무게 = 1.01 × 길이^2 - 2.16 × 길이 + 116.05

-

다항 회귀는 다항식을 사용하여 특성과 타깃 사이의 관계를 나타냄. 이 함수는 비선형일 수 있지만 여전히 선형 회귀로 표현할 수 있음.

# 구간별 직선을 그리기 위해 15에서 49까지 정수 배열을 만듦

point = np.arange(15, 50)

# 훈련 세트의 산점도를 그림

plt.scatter(train_input, train_target)

# 15에서 49까지 2차 방정식 그래프를 그림

plt.plot(point, 1.01*point**2 - 21.6*point + 116.05)

# 50cm 농어 데이터

plt.scatter(50, 1574, marker='^')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()- 앞선 단순 선형 회귀 모델보다 훨씬 나은 그래프가 그려졌음.

- 훈련 세트의 경향을 잘 따르고 있고 무게가 음수로 나오는 일도 없을 것 같음.

print(lr.score(train_poly, train_target))

### 결과 : 0.9706807451768623

print(lr.score(test_poly, test_target))

### 결과 : 0.9775935108325121- 훈련 세트와 테스트 세트의 R^2 점수를 평가해보자.

- 훈련 세트와 테스트 세트에 대한 점수가 크게 높아졌지만, 여전히 테스트 세트의 점수가 조금 더 높음.

다중 회귀

- 다중 회귀(multiple regression)란 여러 개의 특성을 사용하는 회귀 모델임. 특성이 많으면 선형 모델은 강력한 성능을 발휘함.

- 특성 공학(feature engineering)이란 주어진 특성을 조합하여 새로운 특성을 만드는 일련의 작업 과정임.

사이킷런의 변환기

- 변환기(transformer)란 특성을 만들거나 전처리하기 위한다양한 클래스를 말함.

from sklearn.preprocessing import PolynomialFeatures

poly = PolynomialFeatures()

# 2개의 특성 2와 3으로 이루어진 샘플 하나를 적용해보자.

poly.fit([[2,3]])

print(poly.transform([[2,3]]))

### 결과 : [[1. 2. 3. 4. 6. 9.]]

poly = PolynomialFeatures(include_bias=False)

poly.fit([[2,3]])

print(poly.transform([[2,3]]))

### 결과 : [[2. 3. 4. 6. 9.]]- 2개의 특성(원소)을 가진 샘플 [2. 3]이 6개의 특성을 가진 샘플 [1. 2. 3. 4. 6. 9]로 바뀌었음.

- PolynomialFeatures 클래스는 기본적으로 각 특성을 제곱한 항을 추가하고 특성끼리 서로 곱한 항을 추가함.

# train_input을 변환한 데이터를 train_poly에 저장하고 배열의 크기를 확인

poly = PolynomialFeatures(include_bias=False)

poly.fit(train_input)

train_poly = poly.transform(train_input)

print(train_poly.shape)

### 결과 : (42, 9)

# 9개의 특성이 각각 어떤 입력의 조합으로 만들어졌는지 알려줌.

poly.get_feature_names_out()

### 결과 : ['x0', 'x1', 'x2', 'x0^2', 'x0 x1', 'x0 x2', 'x1^2', 'x1 x2','x2^2']

# 테스트 세트 변환

test_poly = poly.transform(test_input)다중 회귀 모델 훈련하기

- 다중 회귀 모델을 훈련하는 것은 선형 회귀 모델을 훈련하는 것과 같음. 다만 여러 개의 특성을 사용하여 선형 회귀를 만드는 것임.

from sklearn.linear_model import LinearRegression

lr = LinearRegression()

lr.fit(train_poly, train_target)

print(lr.score(train_poly, train_target))

### 결과 : 0.9903183436982125

print(lr.score(test_poly, test_target))

### 결과 : 0.9714559911594155-

농어의 길이뿐만 아니라 높이와 두께를 모두 사용했고 각 특성을 제곱하거나 서로 곱해서 다항 특성을 더 추가하였음.

-

특성이 늘어나면 선형 회귀의 능력은 매우 강함.

-

테스트 세트에 대한 점수는 높아지지 않았지만 농어의 길이만 사용했을 때 있던 과소적합 문제는 더 이상 나타나지 않음.

-

만약 특성을 더 많이 추가하면 어떻게 되는가?

# PolynomialFeatures 클래스의 degree 매개변수를 사용하여 필요한 고차항의 최대 차수를 지정할 수 있음.

# 5제곱까지 특성을 만들어 출력해보자.

poly = PolynomialFeatures(degree=5, include_bias=False)

poly.fit(train_input)

train_poly = poly.transform(train_input)

test_poly = poly.transform(test_input)

print(train_poly.shape)

### 결과 : (42, 55)- 데이터를 사용해 선형 회귀 모델을 다시 훈련해보자.

lr.fit(train_poly, train_target)

print(lr.score(train_poly, train_target))

### 결과 : 0.9999999999938143

print(lr.score(test_poly, test_target))

### 결과 : -144.40744532797535특성의 개수를 크게 늘리면 선형 모델은 아주 강력해지므로, 훈련 세트에 대해 거의 완벽하게 학습할 수 있음.

하지만 이런 모델은 훈련 세트에 너무 과대적합하므로 테스트 세트에서는 형편없는 점수를 만들어내는 것임.

규제

- 규제(regularization)는 머신러닝 모델이 훈련 세트를 너무 과도하게 학습하지 못하도록 훼방하는 것을 말함.

- 일반적으로 선형 회귀 모델에 규제를 적용할 때 계수 값의 크기가 서로 많이 다르면 공정하게 제어되지 않으므로, 규제를 적용하기 전에 정규화를 해야 함.

# 사이킷런에서 제공하는 StandardScaler 클래스를 사용

from sklearn.preprocessing import StandardScaler

ss = StandardScaler()

ss.fit(train_poly)

train_scaled = ss.transform(train_poly)

test_scaled = ss.transform(test_poly)- 이제 표준점수로 변환한 train_scaled와 test_scaled가 준비되었음.

⇒ 선형 회귀 모델에 규제를 추가한 모델을 릿지(ledge)와 랏쏘(lasso)라고 부름. 릿지는 계수를 곱한 값을 기준으로 규제를 적용하고, 라쏘는 계수의 절댓값을 기준으로 규제를 적용함.

릿지 회귀

- 모델 객체를 만들고 fit( ) 메서드에서 훈련한 다음 score( ) 메서드로 평가함.

from sklearn.linear_model import Ridge

ridge = Ridge()

ridge.fit(train_scaled, train_target)

print(ridge.score(train_scaled, train_target))

### 결과 : 0.9896101671037343

# 테스트에 대한 점수 확인

print(ridge.score(test_scaled, test_target))

### 결과 : 0.979069397761539-

확실히 많은 특성을 사용했음에도 불구하고 훈련 세트에 너무 과대적합하지 않아 테스트 세트에서도 좋은 성능을 내고 있음.

-

릿지와 라쏘 모델을 사용할 때 규제의 양을 임의로 조절할 수 있음.

-

alpha 값이 크면 규제 강도가 세지므로 계수 값을 더 줄이고 조금 더 과소적합되도록 유도함.

-

alpha 값이 작으면 계수를 줄이는 역할이 줄이는 역할이 줄어들고 선형 회귀 모델과 유사해지므로 과대적합될 가능성이 큼.

-

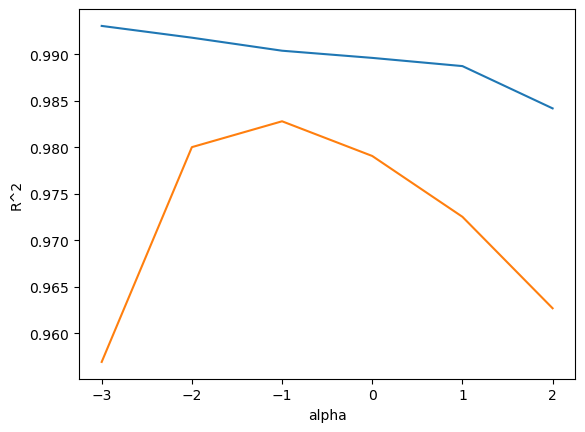

적절한 alpha 값을 찾는 한 가지 방법은 alpha 값에 대한 R^2값의 그래프를 그려 보는 것임.

-

훈련 세트와 테스트 세트의 점수가 가장 가까운 지점이 최적의 alpha 값이 됨.

import matplotlib.pyplot as plt

# alpha 값을 바꿀 때마다 score( ) 메서드의 결과를 저장할 리스트를 만들자.

train_score = []

test_score = []

# alpha 값을 0.001에서 100까지 늘려가며 릿지 회귀 모델을 훈련

# 훈련 세트와 테스트 세트의 점수를 파이썬 리스트에 저장

alpha_list = [0.001, 0.01, 0.1, 1, 10, 100]

for alpha in alpha_list:

# 릿지 모델을 만듦

ridge = Ridge(alpha=alpha)

# 릿지 모델을 훈련

ridge.fit(train_scaled, train_target)

# 훈련 점수와 테스트 점수를 저장

train_score.append(ridge.score(train_scaled, train_target))

test_score.append(ridge.score(test_scaled, test_target))- alpha_list에 있는 6개의 값을 동일한 간격으로 나타내기 위해 로그 함수로 바꾸어 지수로 표현함.

⇒ 0.001은 -3, 0.01은 -2가 되는 식임.

plt.plot(np.log10(alpha_list), train_score)

plt.plot(np.log10(alpha_list), test_score)

plt.xlabel('alpha')

plt.ylabel('R^2')

plt.show()- 적절한 alpha 값은 두 그래프가 가장 가깝고 테스트 세트의 점수가 가장 높은 -1, 즉 10^-1=0.1이다.

alpha 값을 0.1로 하여 최종 모델을 훈련해보자.

ridge = Ridge(alpha=0.1)

ridge.fit(train_scaled, train_target)

print(ridge.score(train_scaled, train_target))

### 결과 : 0.9903815817570369

print(ridge.score(test_scaled, test_target))

### 결과 : 0.9827976465386932라쏘 회귀

from sklearn.linear_model import Lasso

lasso = Lasso()

lasso.fit(train_scaled, train_target)

print(lasso.score(train_scaled, train_target))

### 결과 : 0.989789897208096

# 테스트의 점수 확인

print(lasso.score(test_scaled, test_target))

### 결과 : 0.9800593698421884- 라쏘도 과대적합을 잘 억제한 결과를 보여줌.

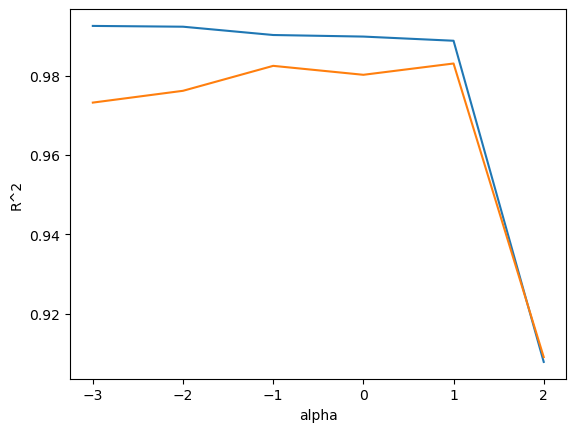

- 라쏘 모델도 alpha 매개변수로 규제의 강도를 조절할 수 있음.

# alpha 값을 바꾸어 가며 훈련 세트와 테스트 세트에 대한 점수 계산

train_score = []

test_score = []

alpha_list = [0.001, 0.01, 0.1, 1, 10, 100]

for alpha in alpha_list:

# 라쏘 모델을 만듦

lasso = Lasso(alpha=alpha, max_iter=10000)

# 라쏘 모델을 훈련

lasso.fit(train_scaled, train_target)

# 훈련 점수와 테스트 점수를 저장

train_score.append(lasso.score(train_scaled, train_target))

test_score.append(lasso.score(test_scaled, test_target))- 그다음 trian_score와 test_score를 사용해 그래프를 그림.

plt.plot(np.log10(alpha_list), train_score)

plt.plot(np.log10(alpha_list), test_score)

plt.xlabel('alpha')

plt.ylabel('R^2')

plt.show()- 라쏘 모델에서 최적의 alpha 값은 1, 10^1=10이다. 이 값으로 다시 모델을 훈련해보자.

lasso = Lasso(alpha=10)

lasso.fit(train_scaled, train_target)

print(lasso.score(train_scaled, train_target))

### 결과 : 0.9888067471131867

print(lasso.score(test_scaled, test_target))

### 결과 : 0.9824470598706695- 특성을 많이 사용했지만, 릿지와 마찬가지로 라쏘 모델이 과대적합을 잘 억제하고 테스트 성능을 크게 높였음.

- 라쏘 모델은 계수 값을 아예 0으로 만들 수 있음. (라쏘 모델의 계수는 coef_ 속성에 저장되어 있음.)

print(np.sum(lasso.coef_ == 0))

### 결과 : 40- 55개의 특성을 모델에 주입했지만 라쏘 모델이 사용한 특성은 15개 밖에 되지 않음.

- 이런 특징 때문에 라쏘 모델을 유용한 특성을 골라내는 용도로도 사용할 수 있게 되었음.