C 5.0알고리즘을이용한다.

CART, CHEAD, QUEST 등 여러 알고리즘이 존재함

이진분류문제(Binary classification)을 확장해 다지분류문제(Mulyiclass classification)

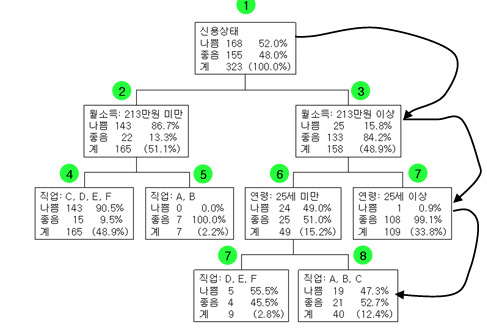

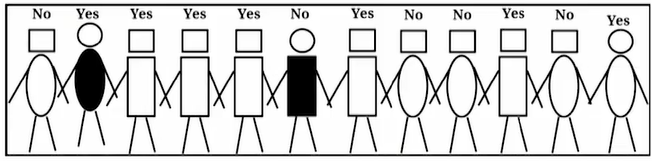

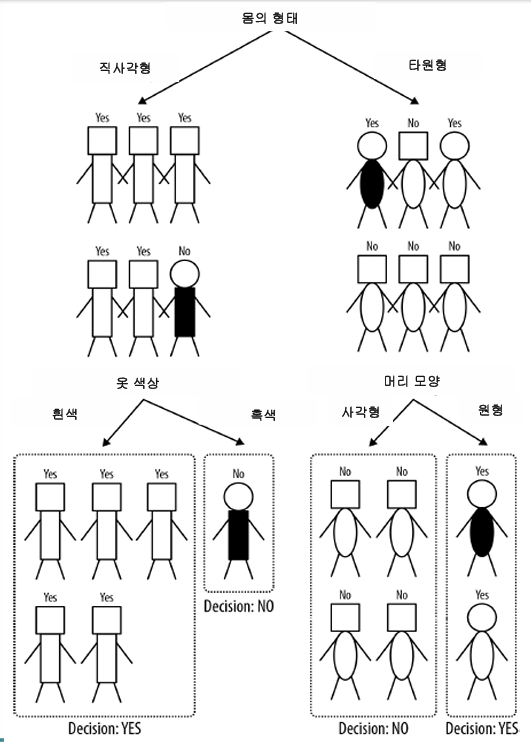

사례

속성들 :

- 머리형태 : 사각형, 원형

- 몸 형태 : 직사각형, 타원형

- 옥 색상 : 흑색, 흰색

목표성성 : Yes, No

동질성(속성)적인 개체들만 모으는것 -> 순수하다

나무를 분류하는 속성에 따라 나무의 크기가 달라짐

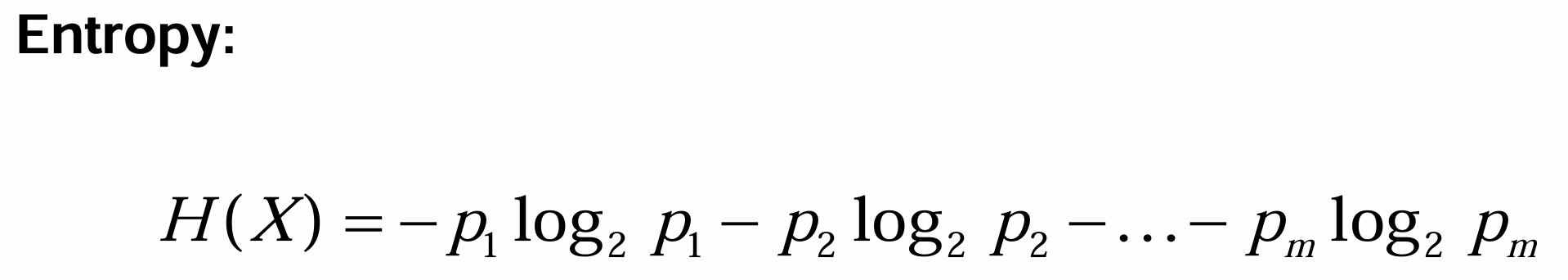

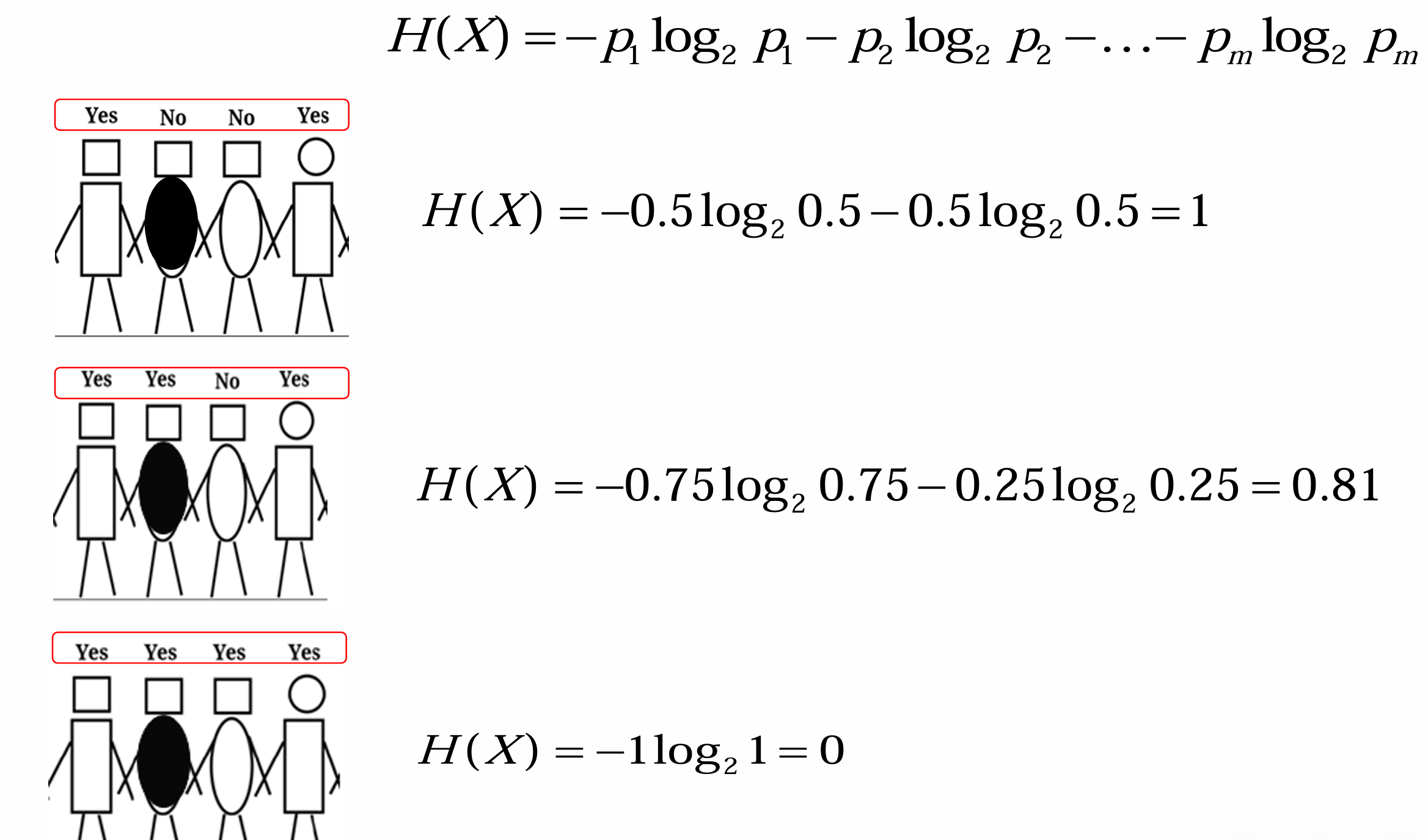

엔트로피(Entropy)와 정보이득

- 목표속성이두개또는그이상의범주를가진경우: 1, 2 (,…m)

- 범주1에대한P1의확률

- 범주2에대한P2의확률

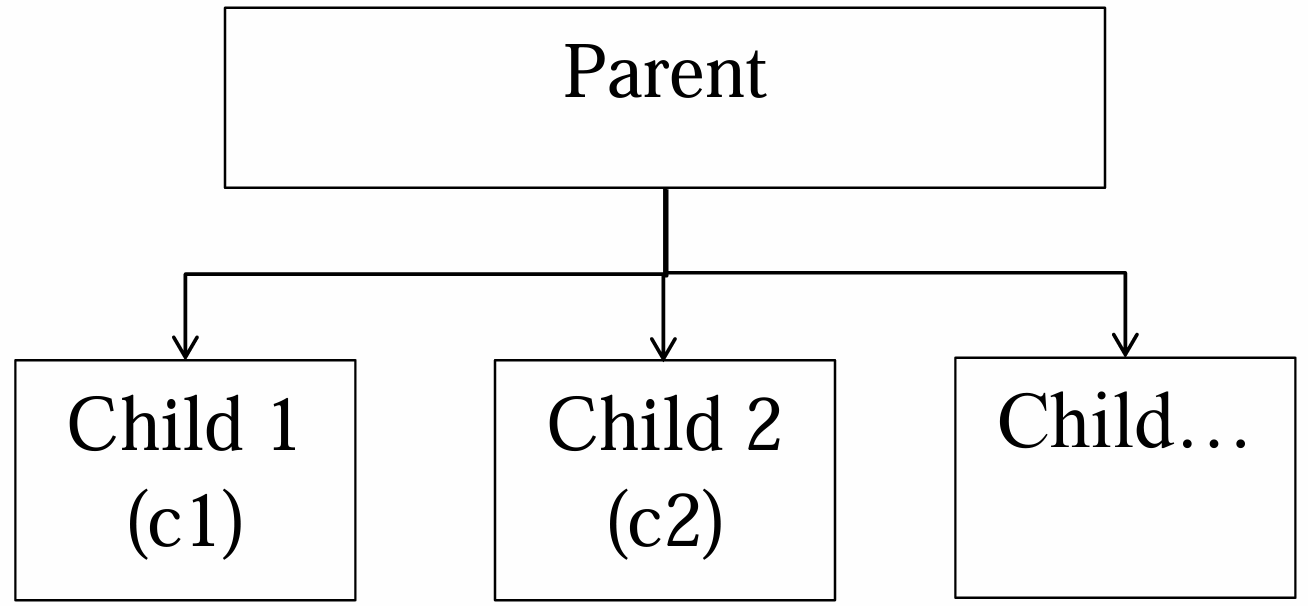

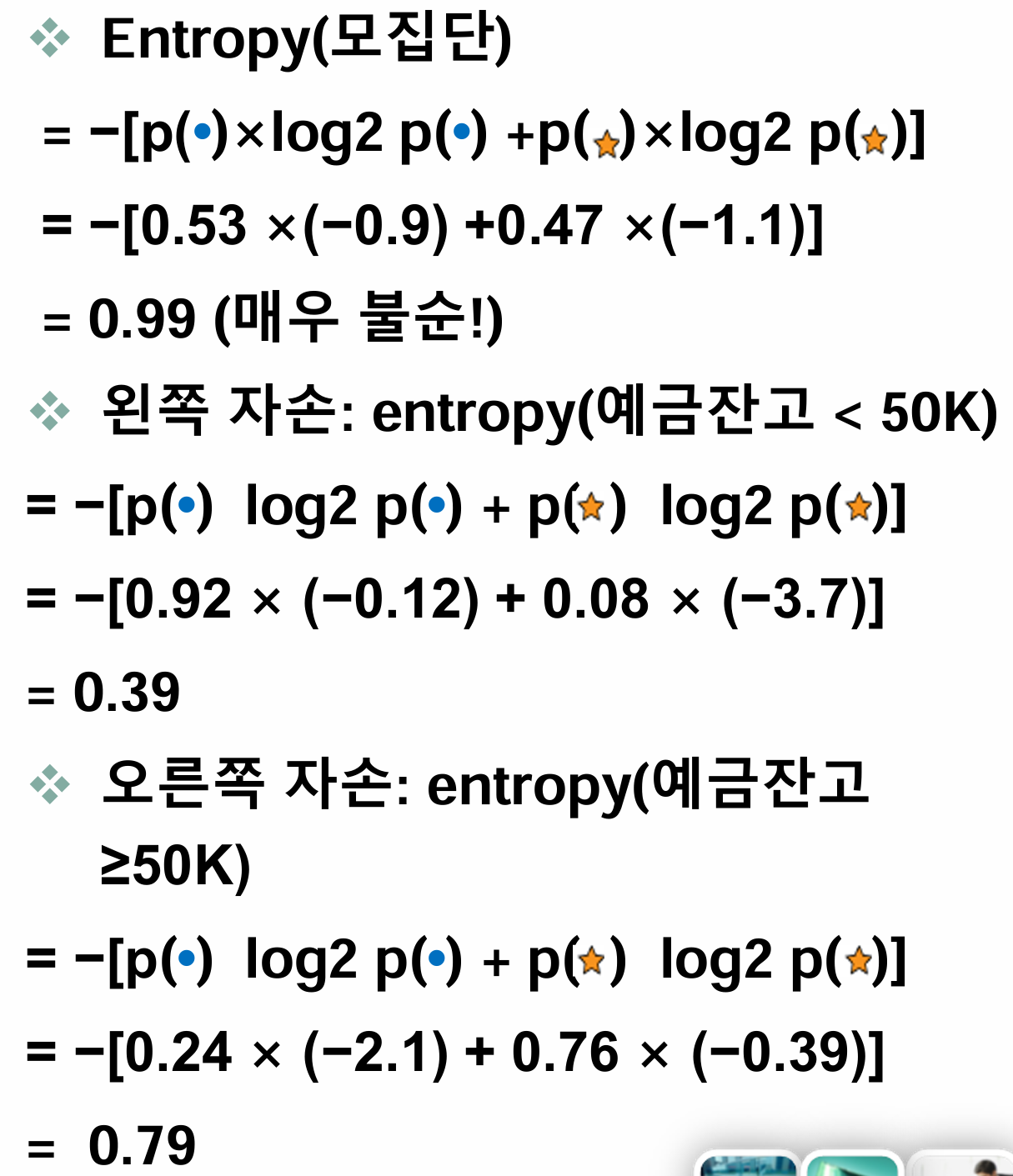

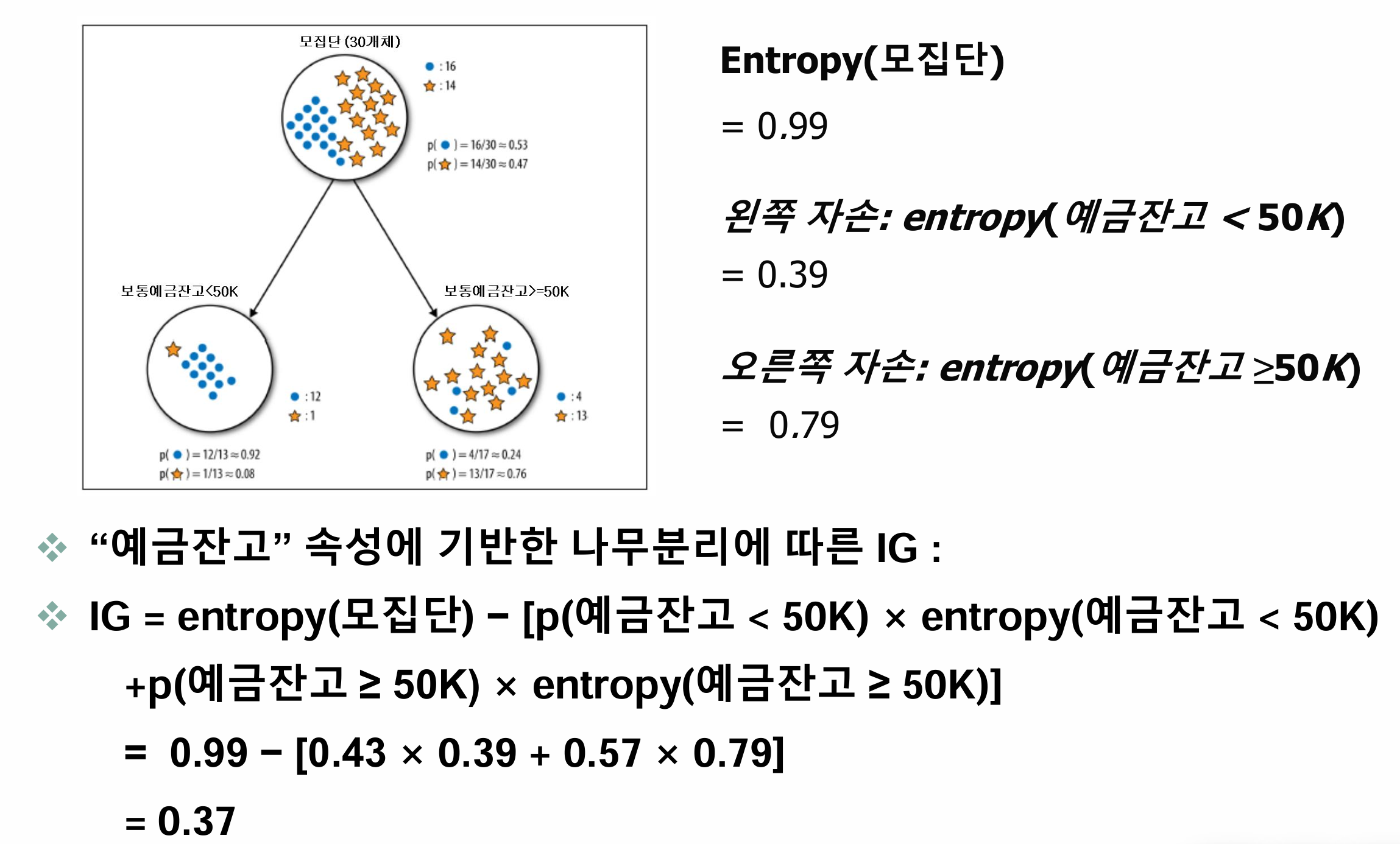

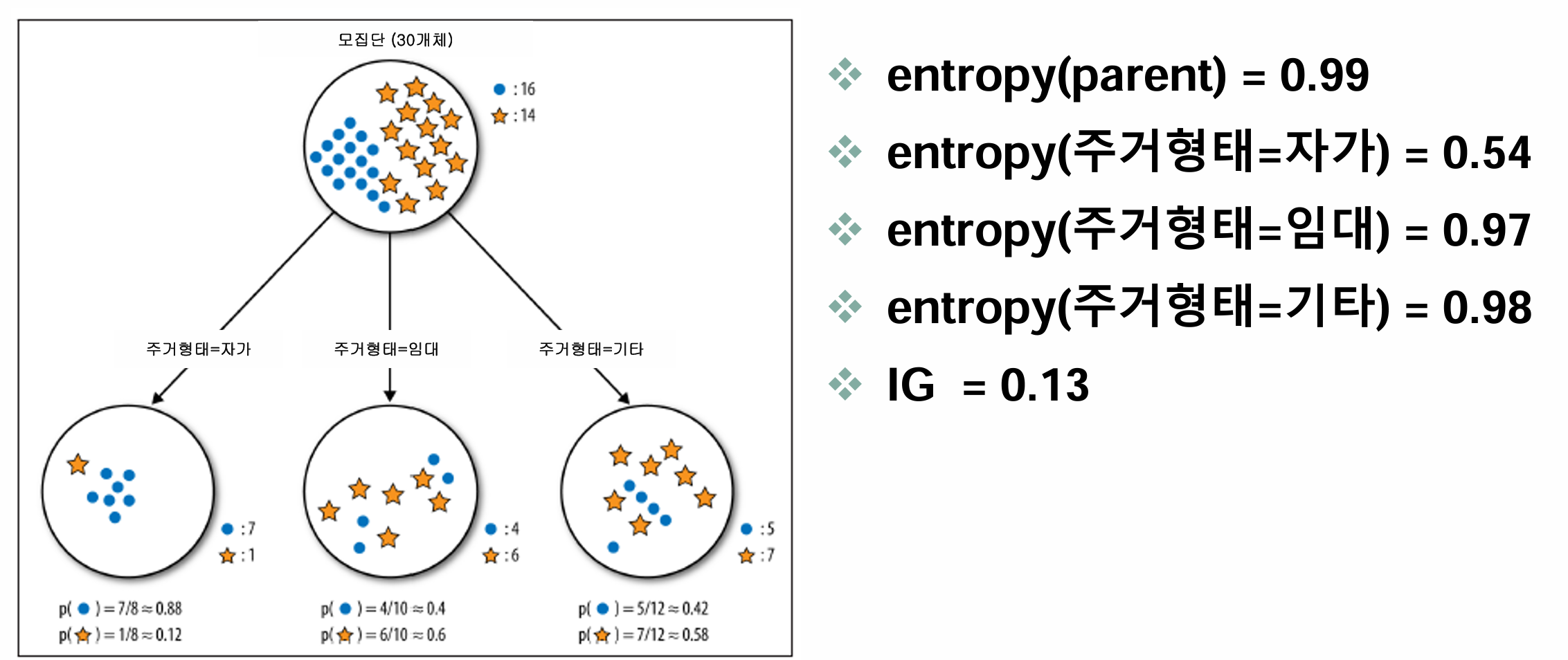

정보이득

IG (parent, children) =

entropy(parent)−[p(c1)×entropy(c1)+p(c2)×entropy(c2) +…]

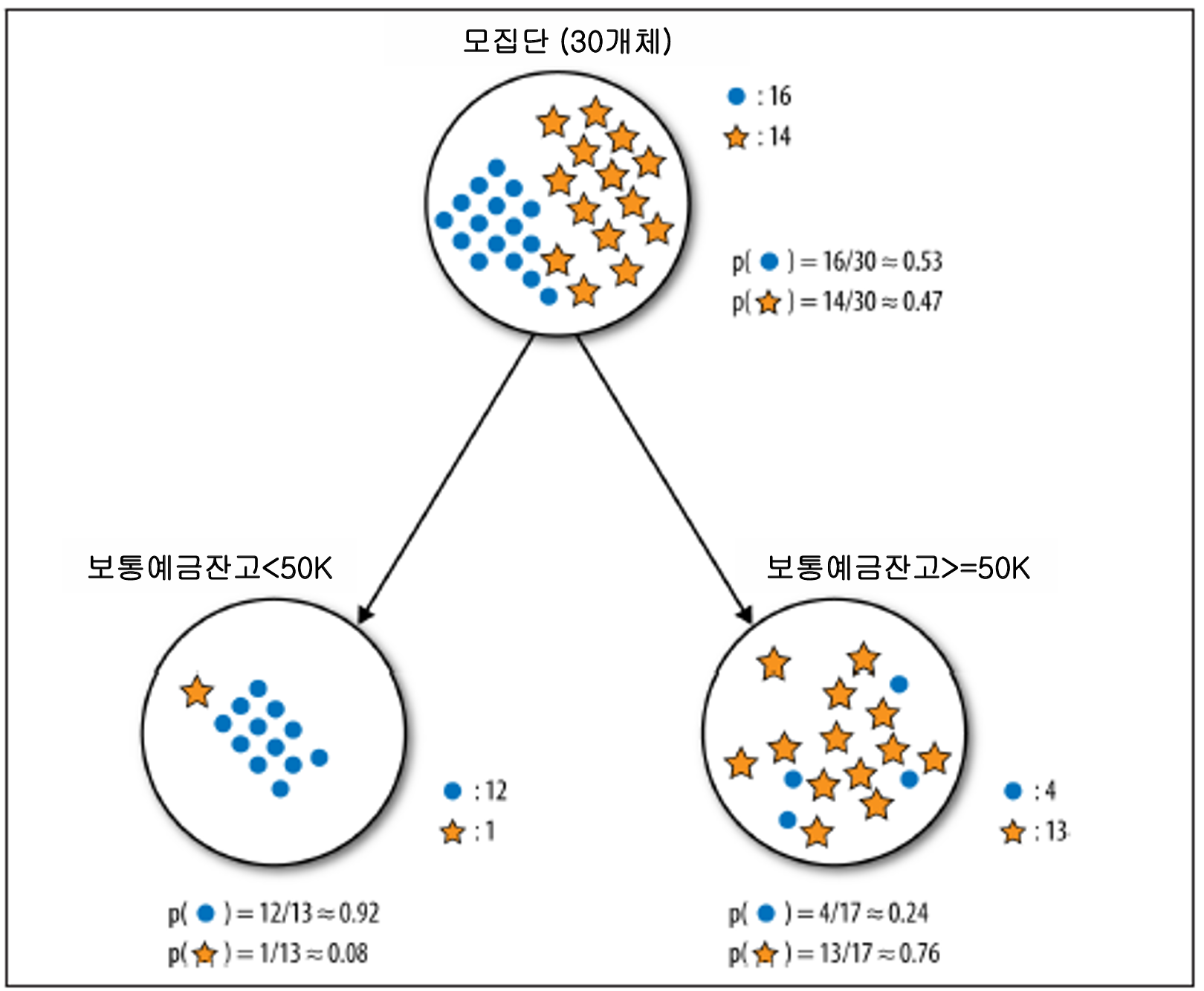

엔트로피(정보의 불순도)를 많이 낮춰야 함

정보이득 사례

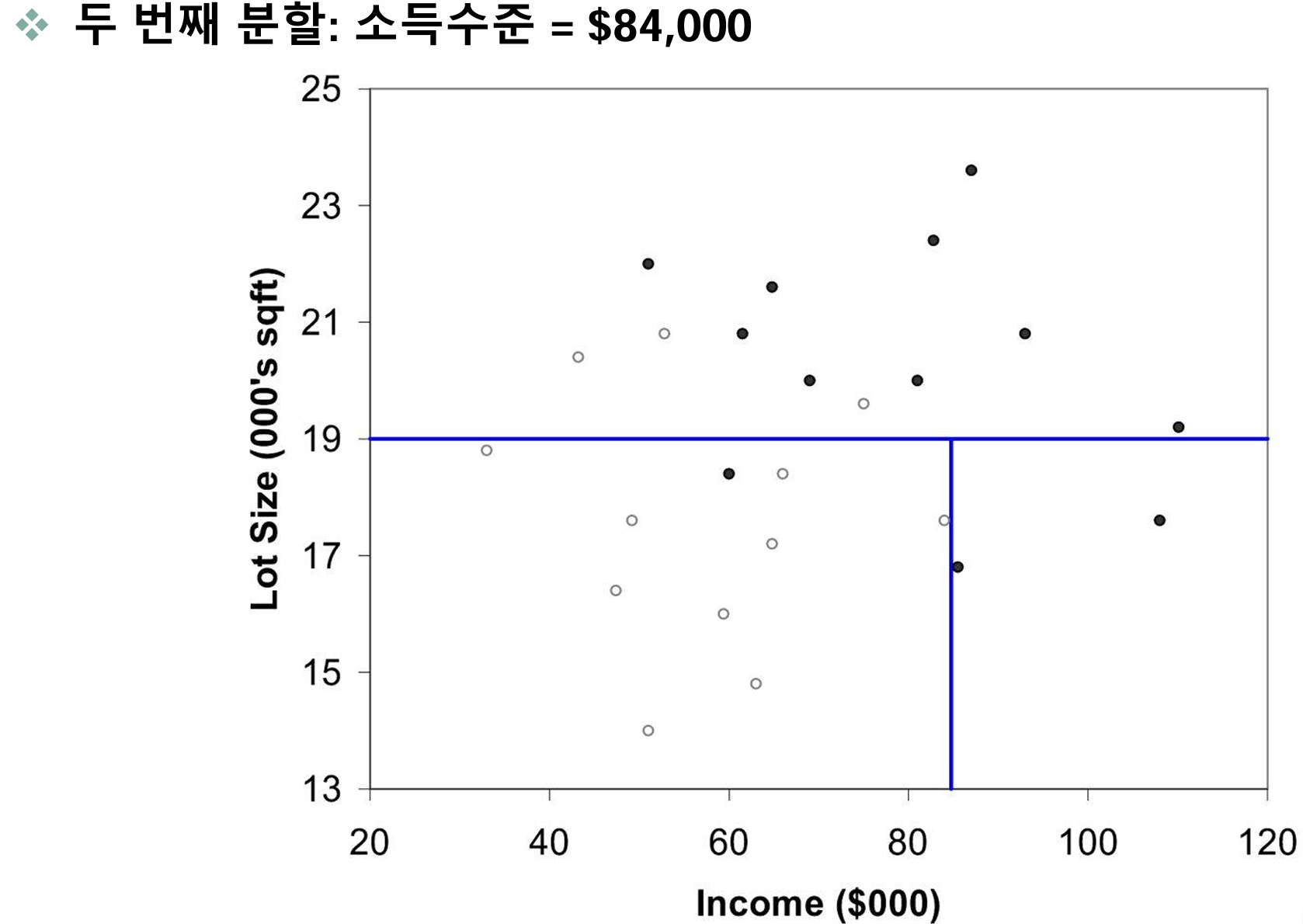

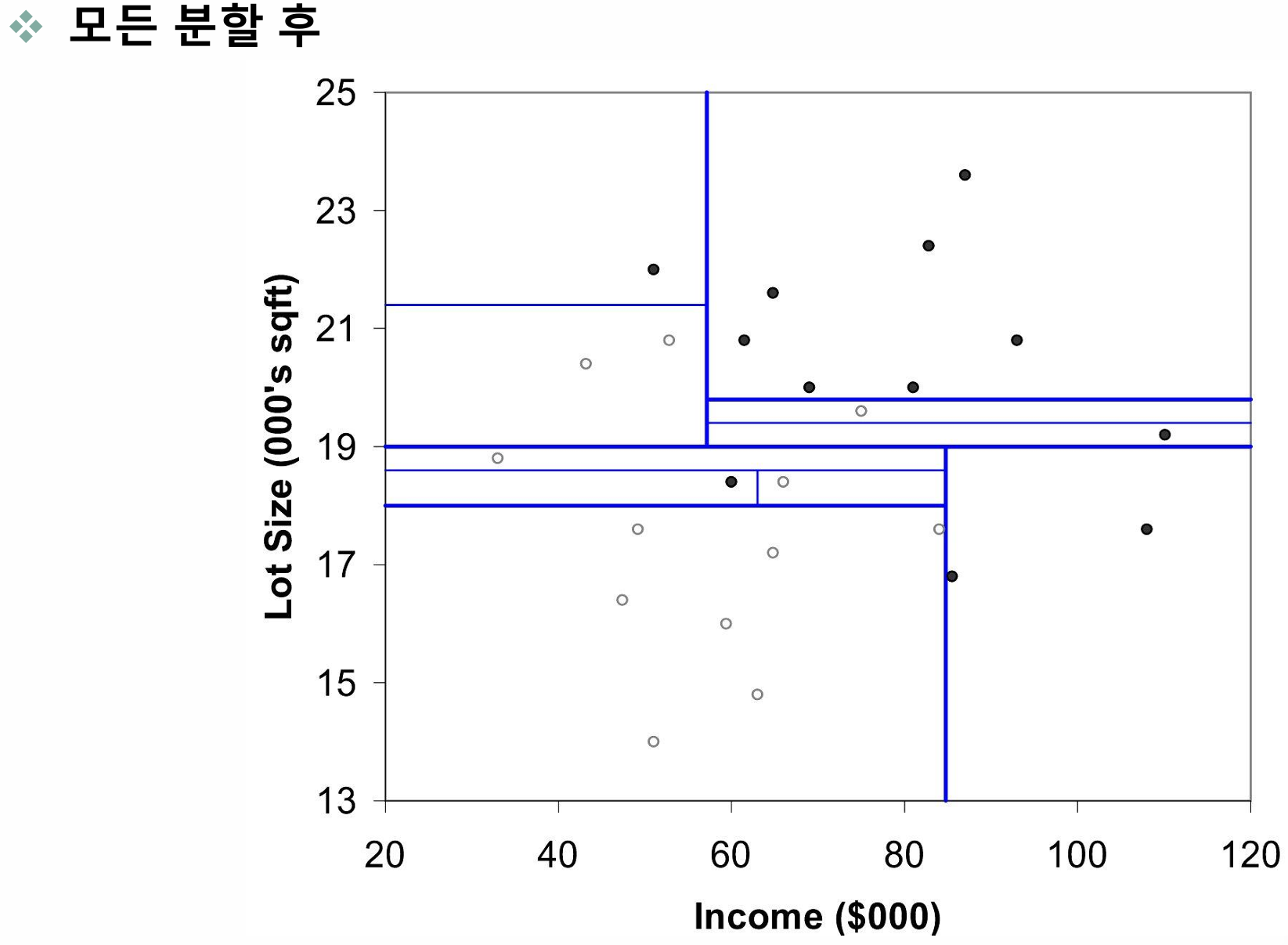

공간분리

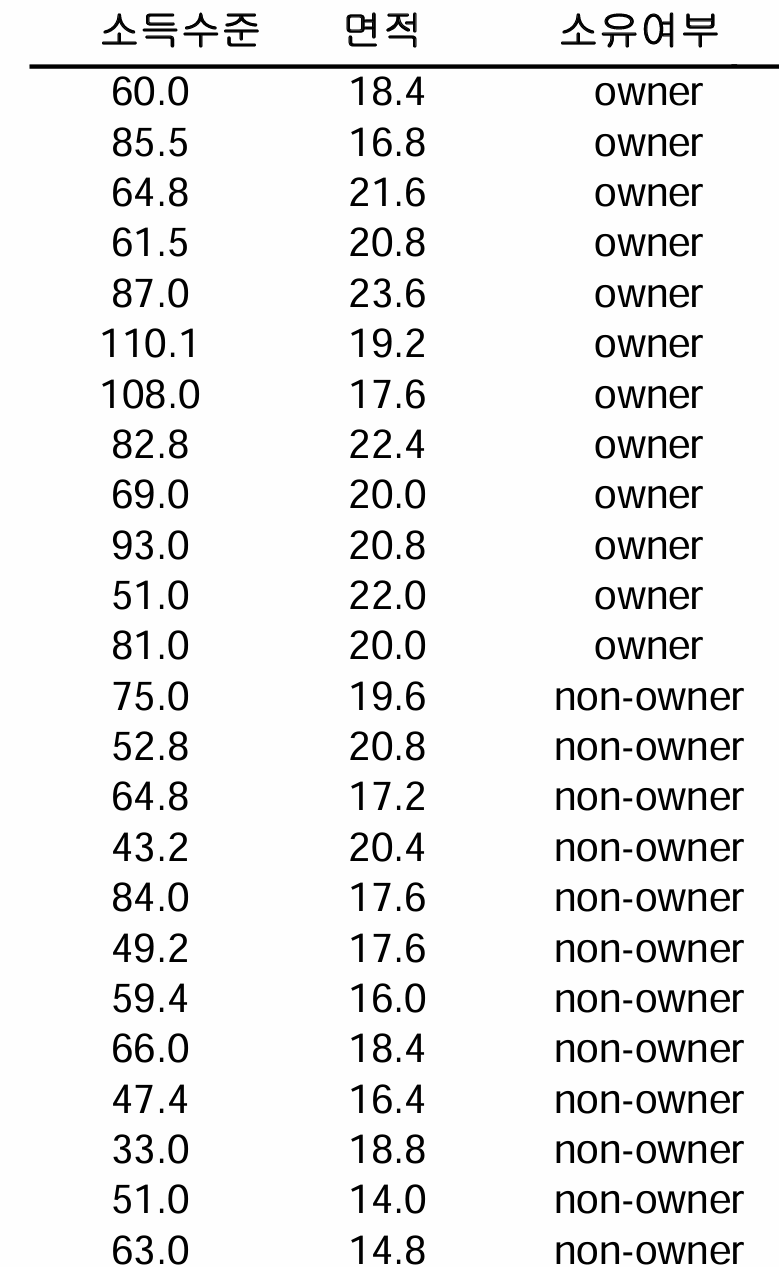

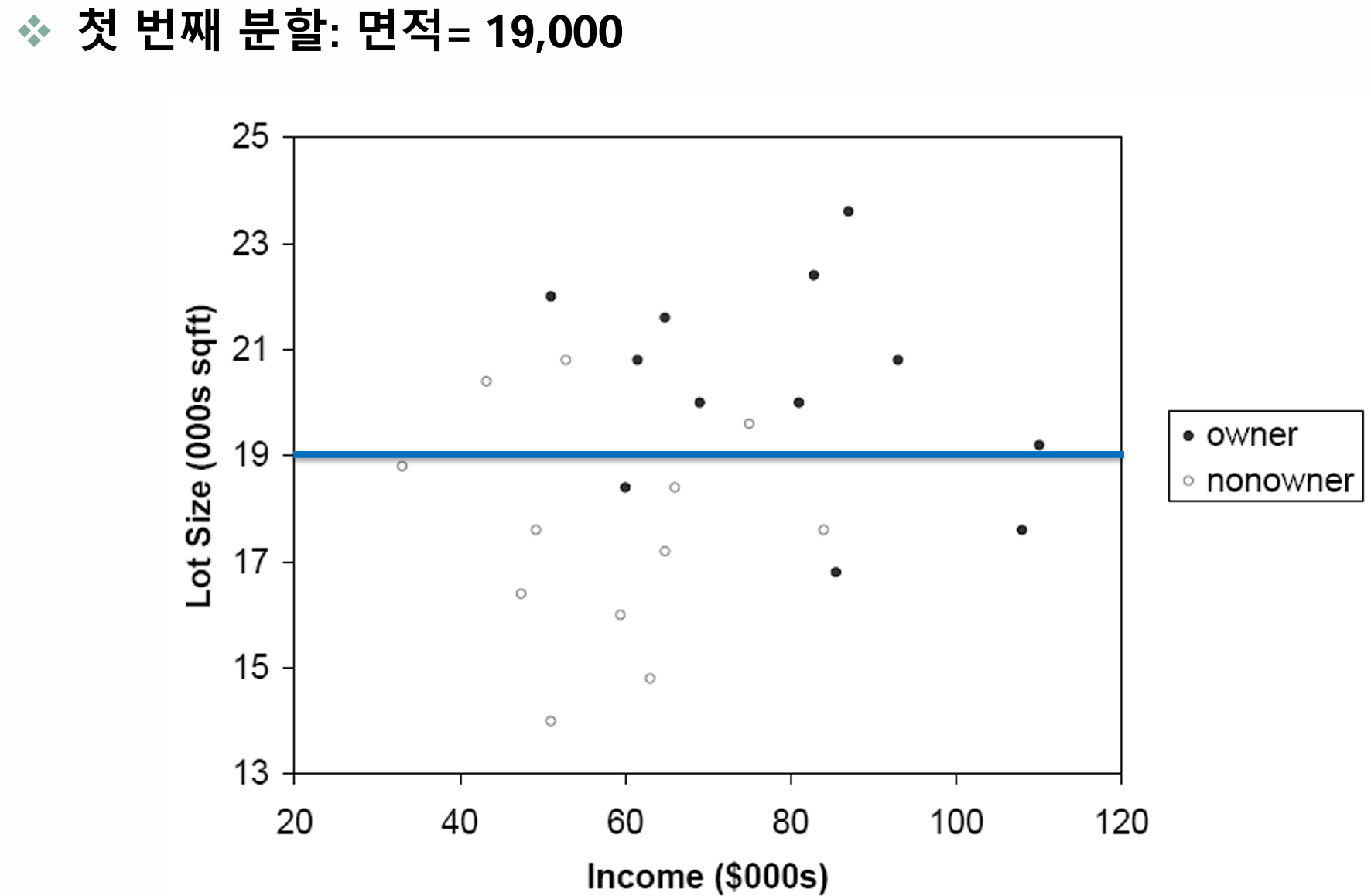

사례 : 잔디깎이 기계

가능한 동질도를 높게 할 수있도록 분리하는 것을 목표로 함

나무분리 기존

-

이진분류 분제

2개의 클래스

우량/불량 등 -

가장좋은분리기준은각각의잎(node)에하나의클래스에해당하는 데이터들이모이도록분류하도록하는것

-

하나의클래스-> “순수하다”

-

순수도(purity), 불순도(impurity)

- 계속 나누면 ...

가지치기(pruning) 필요

가지치기 방법 : 잎 내의 데이터 수, 가지의 깊이

이를 통래 과대적합 문제를 해결할 수 있다.