motivation, 문제 제기

CNN based-detectors(yolo family, RetinaNet, FCOS, FRCN, etc)들은 heterogeneous, homogeneous detectors 간의 knowledge distillation 연구가 활발히 진행되어 왔다.

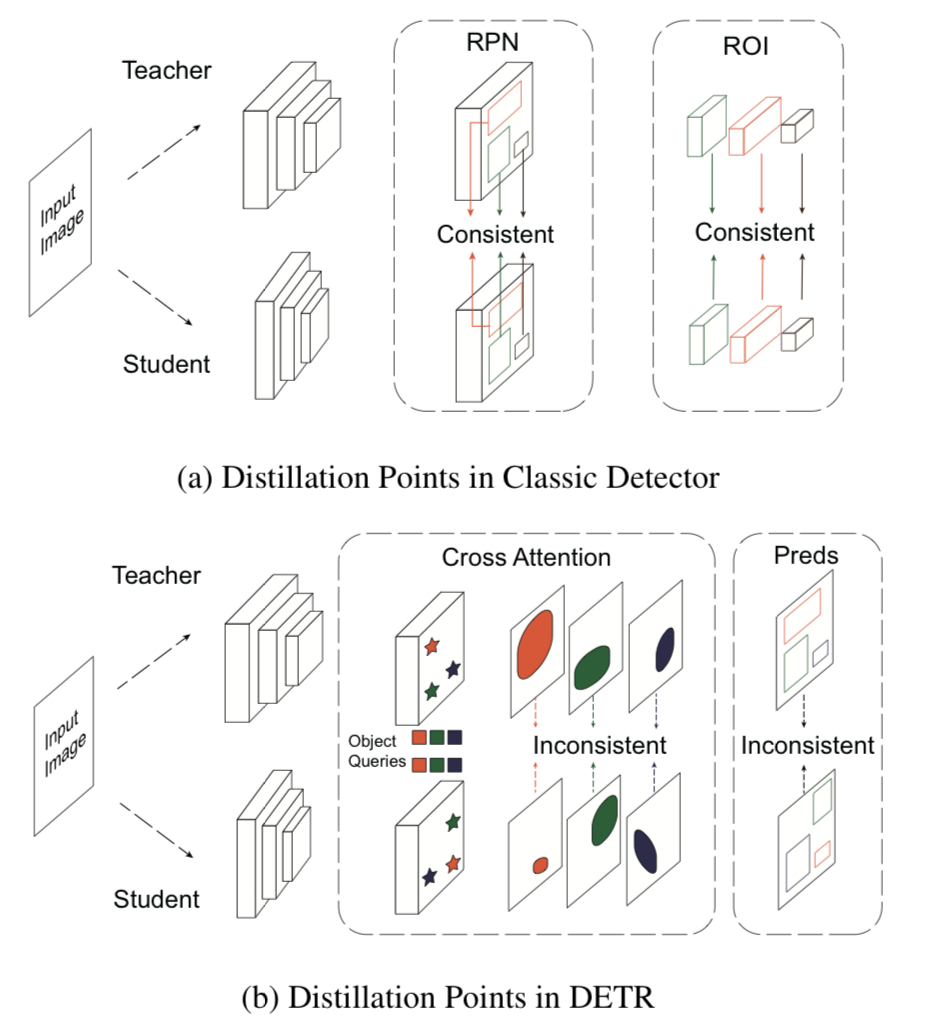

지금까지 진행된 연구들을 DETR variants에 그대로 적용할 수는 없는 이유가 존재한다.

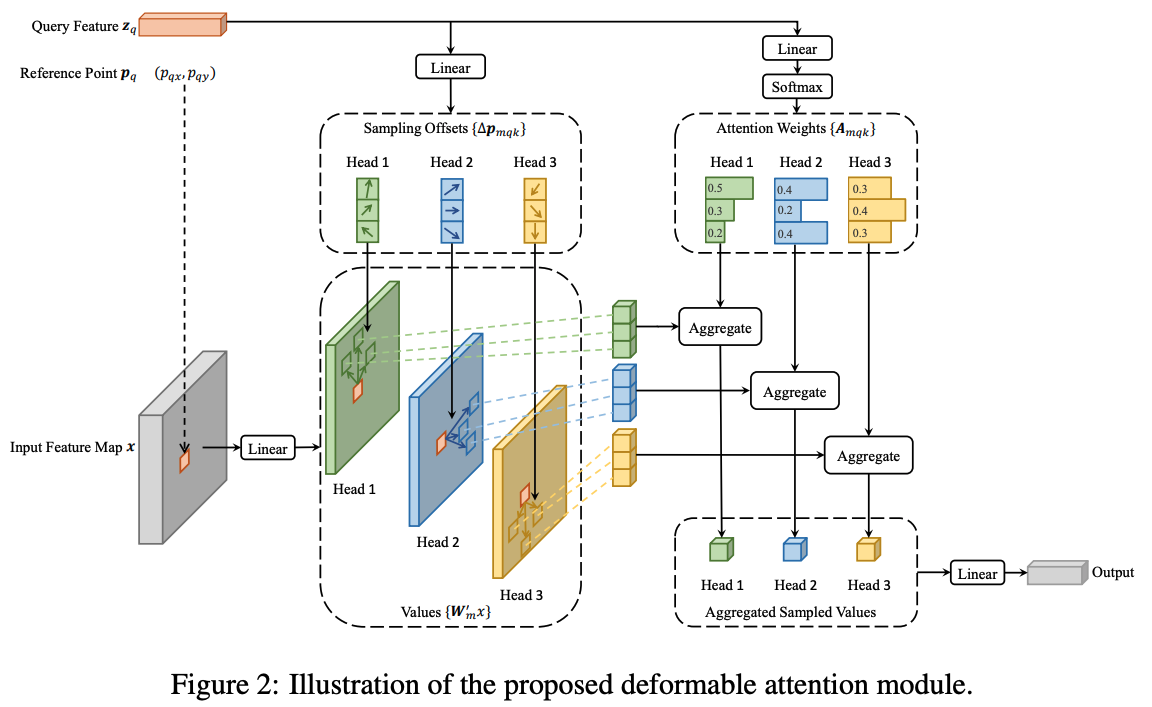

1. CNN based detector들은 convolution 연산으로만 이루어졌지만, DETR variants는 attention 연산이 존재하기 때문에 중간에 만들어지는 feature map이 다르다.

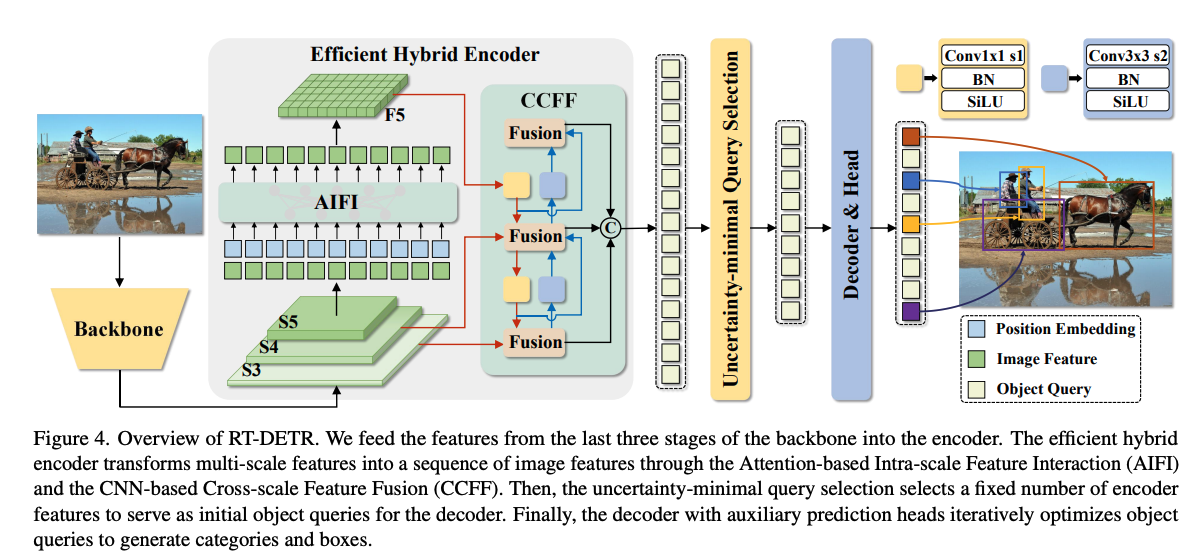

2. 특히나 Deformable-DETR, RT-DETR은 reference points를 기반으로 forwarding되기 때문에

CNN base detector과는 전혀 다른 값들이 forwarding된다.

(사진 출처)

RT-DETR과 CNN based detector들 간의 차이점을 설득력있게 설명할 수 있어야 함..

(추후에 할 일)

DETR Variants

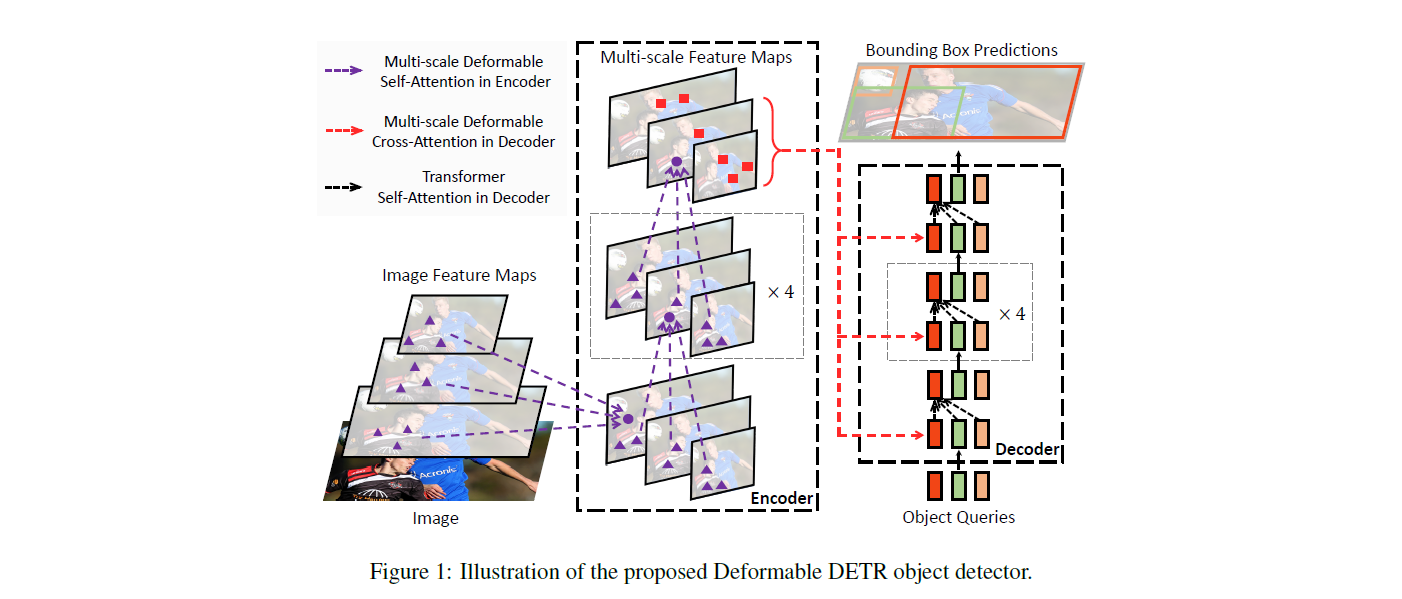

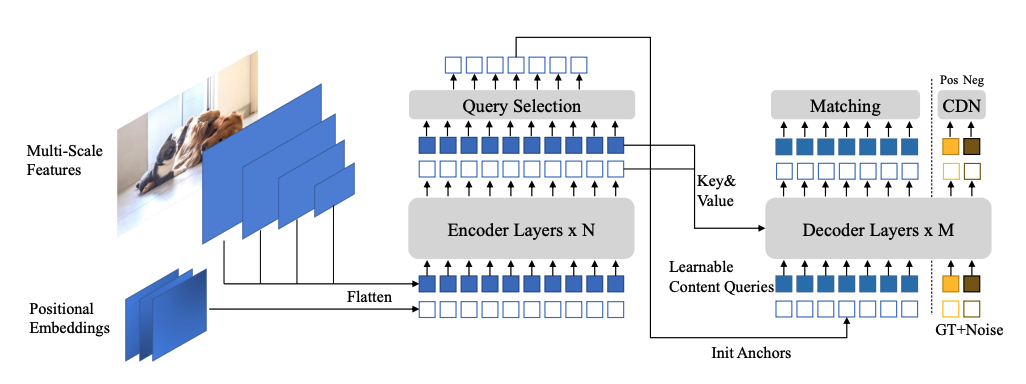

Deformable DETR

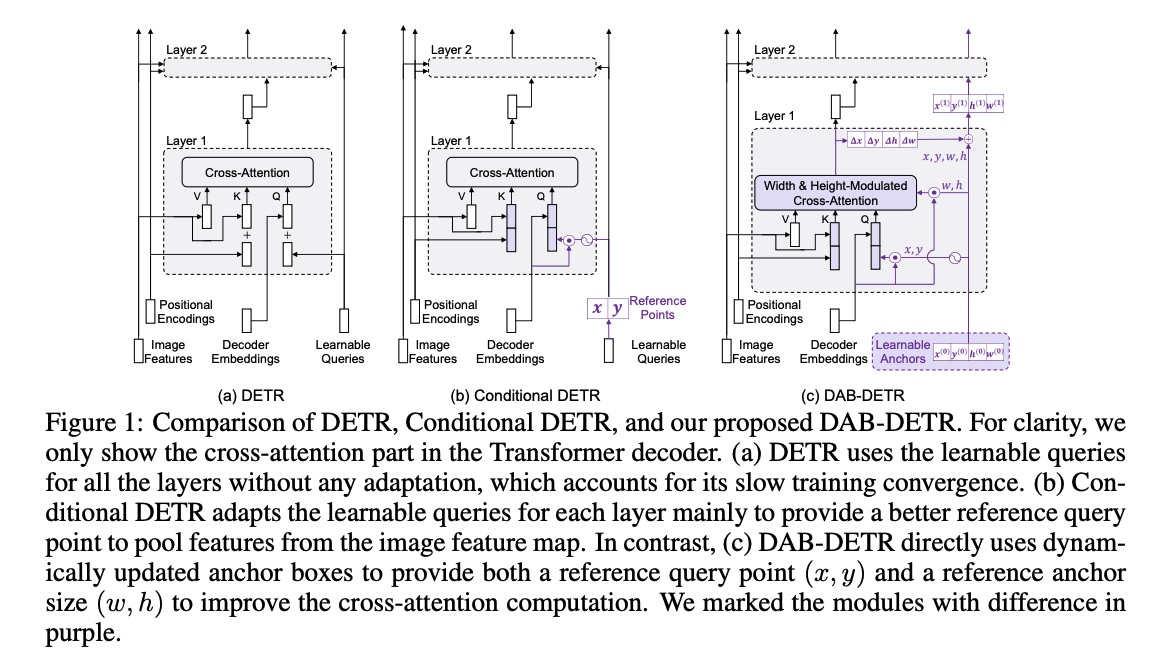

DAB-DETR

DINO DETR

RT-DETR

reference point, object queries, decoder는 공통적으로 갖고 있는 구조임

하고자 하는 것 : DETR variants만을 위한 KD method를 연구해보자

- DETR variants만을 위한 KD에 대한 대표적인 관련 연구들

(새로운 생각을 방해할 수 있기 때문에 아직 관련 연구들을 읽지 않았음.)- Chang, Jiahao, et al. "Detrdistill: A universal knowledge distillation framework for detr-families." Proceedings of the IEEE/CVF International Conference on Computer Vision. 2023.

- review한 글 :

- Wang, Yu, et al. "Knowledge distillation for detection transformer with consistent distillation points sampling." arXiv preprint arXiv:2211.08071 (2022).

- review한 글 :

- Chen, Xiaokang, et al. "D ETR: Decoder Distillation for Detection Transformer." arXiv preprint arXiv:2211.09768 (2022).

- review한 글 :

- Chang, Jiahao, et al. "Detrdistill: A universal knowledge distillation framework for detr-families." Proceedings of the IEEE/CVF International Conference on Computer Vision. 2023.