본 포스팅은 파이토치(PYTORCH) 한국어 튜토리얼을 참고하여 공부하고 정리한 글임을 밝힙니다.

DATASET과 DATALOADER

- 두 가지 기본 요소:

torch.utils.data.DataLoader와torch.utils.data.Dataset Dataset: 샘플과 정답 저장DataLoader: 샘플에 쉽게 접근 가능하도록 순회 가능한 객체로 감쌈

데이터셋 불러오기

예제) TorchVision에서 Fashion-MNIST 데이터셋 이용

-

Zalando의 기사 이미지 데이터셋으로 60,000개의 학습 예제와 10,000개의 테스트 에제로 이루어짐

-

흑백의 28x28 이미지와 10개 분류 중 하나인 정답으로 구성됨

-

FashionMNIST 데이터셋을 불러올 때 사용하는 매개변수

root: 학습/테스트 데이터가 저장되는 경로train: 학습용 또는 테스트용 데이터셋 여부 지정 (Ture/False)download=True:root에 데이터가 없는 경우 인터넷에서 다운로드transform,target_transform: feature와 정답 변형(transform)을 지정

import torch

from torch.utils.data import Dataset

from torchvision import datasets

from torchvision.transforms import ToTensor

import matplotlib.pyplot as plt

training_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor()

)

test_data = datasets.FashionMNIST(

root="data",

train=False,

download=True,

transform=ToTensor()

)데이터셋 순회하고 시각화하기

labels_map = {

0: "T-Shirt",

1: "Trouser",

2: "Pullover",

3: "Dress",

4: "Coat",

5: "Sandal",

6: "Shirt",

7: "Sneaker",

8: "Bag",

9: "Ankle Boot",

}

figure = plt.figure(figsize=(8,8))

cols, rows = 3, 3

for i in range(1, cols*rows+1):

sample_idx = torch.randint(len(training_data), size=(1,)).item() # 1차원 배열로 training_dataset 길이만큼 랜덤 정수 1개 생성

img, label = training_data[sample_idx]

figure.add_subplot(rows, cols, i)

plt.title(labels_map[label])

plt.axis("off")

plt.imshow(img.squeeze(), cmap="gray")

plt.show()

파일에서 사용자 정의 데이터셋 만들기

사용자 정의 Dataset 클래스

__init__, __len__, __getitem__의 3개 함수를 반드시 구현해야 함

아래 구현에서 FashionMNIST 이미지들은 img_dir 디렉토리에 저장, 정답은 annotations_file CSV 파일에 별도로 저장됨

import os

import pandas as pd

from torchvision.io import read_image

class CustomImageDataset(Dataset):

def __init__(self, annotations_file, img_dir, transform=None, target_transform=None):

self.ima_labels = pd.read_csv(annotations_file, names=['file_name', 'label'])

self.img_dir = img_dir

self.transform = transform

self.target_transform = target_transform

def __len__(self):

return len(self.img_labels)

def __getitem__(self, idx):

imgpath = os.path.join(self.img_dir, self.img_labels.iloc[idx, 0])

image = read_image(img_path)

label = self.img_labels.iloc[idx, 1]

if self.transform:

image = self.transform(image)

if self.target_transform:

label = self.target_transform(label)

return image, label

init

Dataset 객체가 생성될 때 한번만 실행되고, 예제에서는 이미지와 주석 파일(annotation_file)이 포함된 디렉터리와 두가지 변형(transform)을 초기화

labels.csv 파일

tshirt1.jpg, 0

tshirt2.jpg, 0

......

ankleboot999.jpg, 9def __init__(self, annotations_file, img_dir, transform=None, target_transform=None):

self.ima_labels = pd.read_csv(annotations_file, names=['file_name', 'label'])

self.img_dir = img_dir

self.transform = transform

self.target_transform = target_transform len

데이터셋의 샘플 개수 반환

def __len__(self):

return len(self.img_labels)getitem

주어진 인덱스 idx에 해당하는 샘플을 데이터셋에서 불러오고 반환함

인덱스로부터 이미지의 위치를 식별하고 read_image를 사용하여 이미지를 텐서로 변환하고, self.img_labels의 csv 데이터로부터 해당되는 정답을 가져오고, (해당하는 경우) 변형(transform) 함수들을 호출한 뒤, 텐서 이미지와 라벨을 python dict형으로 반환

def __getitem__(self, idx):

imgpath = os.path.join(self.img_dir, self.img_labels.iloc[idx, 0])

image = read_image(img_path)

label = self.img_labels.iloc[idx, 1]

if self.transform:

image = self.transform(image)

if self.target_transform:

label = self.target_transform(label)

sample = {'image':image, 'label':label)

return sampleDataLoader로 학습용 데이터 준비하기

Dataset: 데이터셋의 feature(특징)을 가져오고 하나의 샘플에 정답을 지정하는 일을 한 번에 함

모델 학습할 때, 일반적으로 미니배치로 전달하고 매 epoch마다 데이터를 다시 섞어서 과적합을 막고, python의 multiprocessing을 사용하여 데이터 검색 속도를 높임

➡️ 간단한 API로 이러한 복잡한 과정들을 추상화한 순회 가능한 객체(iterable)

from torch.utils.data import DataLoader

train_dataloader = DataLoader(training_data, batch_size=64, shuffle=True)

test_dataloader = DataLoader(test_data, batch_size=64, shuffle=True)DataLoader를 통해 순회하기

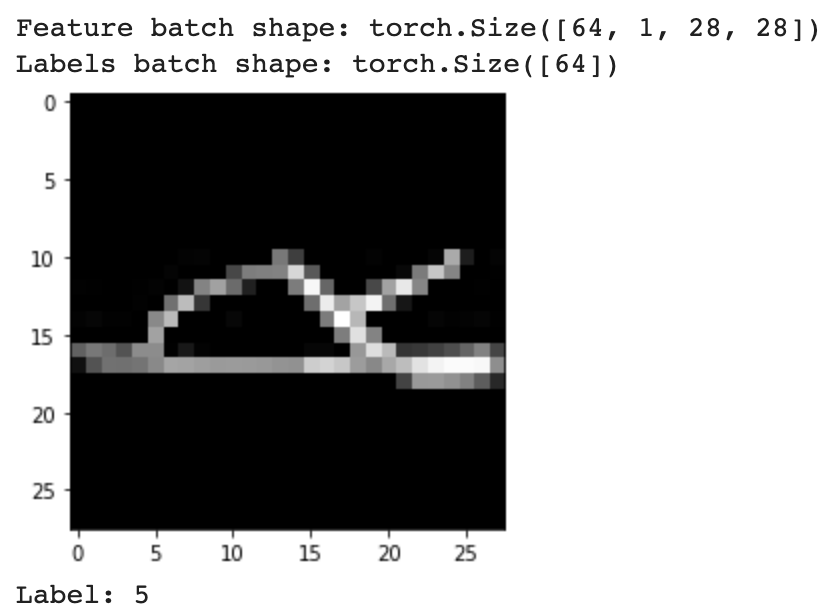

아래 예시는 각각 batch_size=64의 특징과 정답을 포함하는 train_features와 train_labels의 batch를 반환

이때 shuffle=True: 모든 배치를 순회한 뒤 데이터가 섞임

# 이미지와 정답(label) 표시

train_features, train_labels = next(iter(train_dataloader))

print(f"Feature batch shape: {train_features.size()}")

print(f"Labels batch shape: {train_labels.size()}")

img = train_features[0].squeeze()

label = train_labels[0]

plt.imshow(img, cmap="gray")

plt.show()

print(f"Label: {label}")