최근 백엔드 개발을 공부하면서 요즘 기업들이 어떻게 AI 에이전트를

서비스에 적용하고 운영하는지 궁금증이 생겼고 LLMOps를 알게되어

LLMOps에 대해 공부하고 정리하는 시간을 가지게 되었다

최근에 응용 소프트웨어 개발자에게 가장 중요한 이슈 중 하나는

LLM을 어떻게 실제 서비스에서 안정적으로 운영할 것인가라고

생각한다

LLMOps란

LLMOps는 대규모 언어 모델을 실험용 AI가 아닌 실제 서비스 환경에서 운영하기 위한 프로세스를 의미한다.

마치 DevOps가 시스템 협업과 자동화를 위한 운영 방식이라면,

LLMOps는 LLM 기반 서비스를 안정적으로 운영하기 위한 체계적인 방법론이라고 볼 수 있다.

LLMOps의 필요성

기존 MLOps는 머신러닝 모델의 개발 및 배포 자동화를 목적으로 하는 방법론이다.

하지만 이를 LLM에 그대로 적용하면 다음과 같은 문제가 발생한다.

기존 MLOps를 LLM에 적용할 때의 문제

-

평가지표의 한계

- 기존 ML은 정확도 기반 평가

- LLM은 인간 평가가 필수

-

프롬프트 관리 체계 부재

- 기존 ML은 코드, 데이터, 모델만 버전관리

- LLM은 프롬프트 자체가 핵심 자산

-

비용 폭증 문제

- LLM 추론 비용이 매우 큼

- 기존 MLOps는 비용 추적 기능이 약함

-

할루시네이션 문제

- LLM은 사실이 아닌 정보를 생성 가능

- 기존 ML 모니터링으로 탐지 어려움

-

보안 및 개인정보 문제

- LLM 입력 데이터에 민감 정보가 포함될 수 있음

- 기존 ML 보안 체계로는 대응 부족

-

빠른 모델 교체

- LLM은 몇 달 단위로 새로운 모델 등장

- 기존 MLOps 배포 방식은 너무 느림

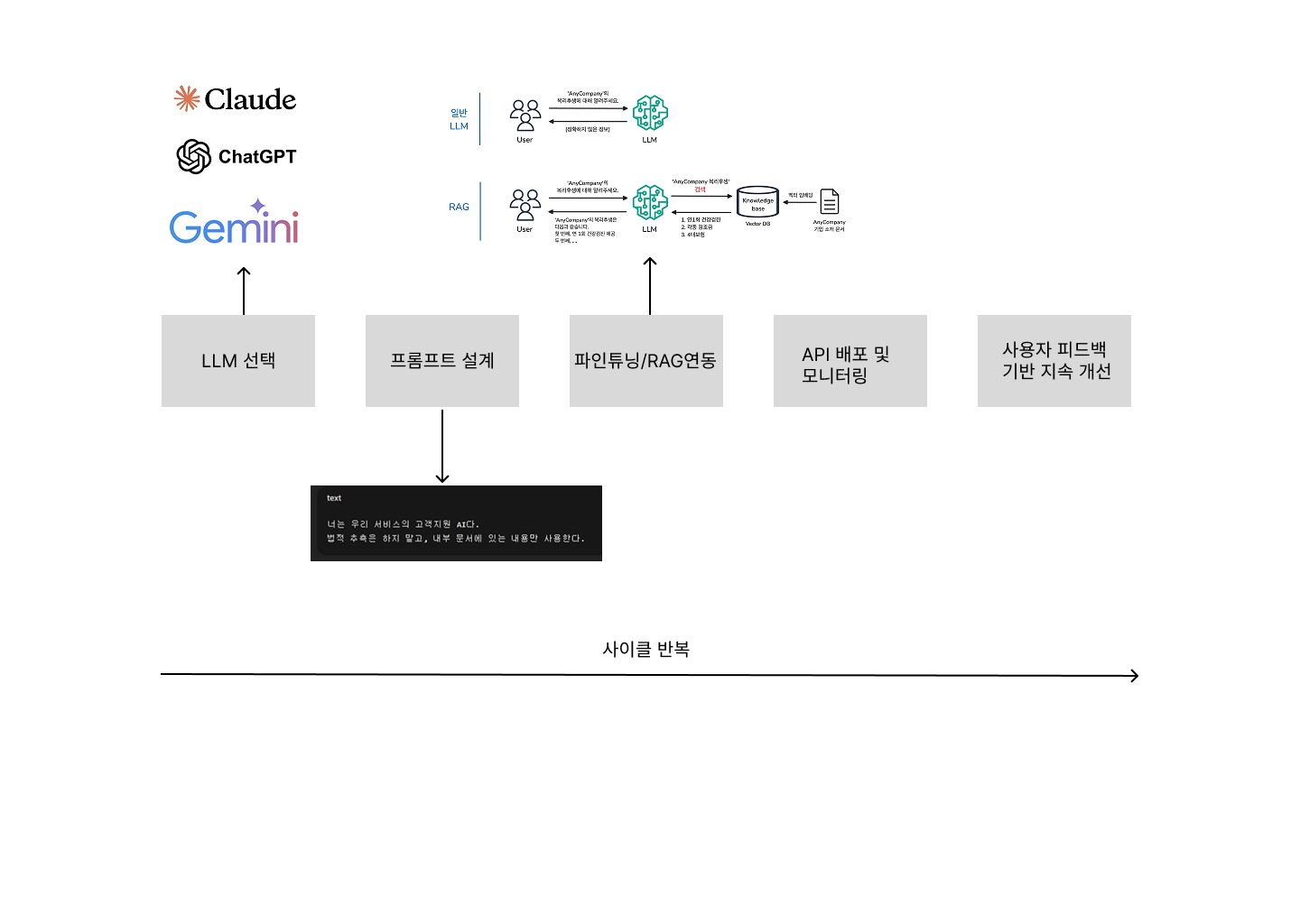

LLMOps의 핵심 범위

LLMOps는 단순히 모델을 API로 연결하는 것 이상을 포함한다.

주요 운영 범위

- 어떤 LLM을 선택할 것인지

- 프롬프트를 어떻게 설계하고 관리할 것인지

- 파인튜닝(Fine-tuning)과 RAG를 어떻게 적용할 것인지

- 배포 후 성능 / 비용 / 보안 모니터링

- 사용자 피드백을 어떻게 개선 루프에 반영할 것인지

즉 LLMOps는 LLM 서비스의 전체 라이프사이클을 관리하는 엔드투엔드 운영 방법론이다.

기존 MLOps와 LLMOps 차이

| 구분 | MLOps | LLMOps |

|---|---|---|

| 문제 유형 | 분류 / 예측 문제 | 생성형 AI |

| 평가 방식 | 정확도, F1 등 수치 중심 | 인간 평가 + 자동 평가 |

| 모델 교체 주기 | 비교적 긴 편 | 매우 빠름 |

| 비용 | 비교적 낮음 | 매우 중요 |

| 핵심 관리 요소 | 데이터, 모델 | 프롬프트, 비용, 보안 |

MLOps 프로세스

데이터 수집 → 학습 → 평가 → 배포 → 모니터링

LLMOps 프로세스

LLM 선택

→ 프롬프트 설계

→ 파인튜닝

→ RAG 연동

→ API 배포 및 모니터링

→ 사용자 피드백 기반 개선

실제 사용 사례

배민 (우아한형제들)

배민은 LLM을 실서비스에 안정적으로 적용하기 위해 LLMOps 체계를 도입하였다.

주요 특징

- 프롬프트 변경 관리

- RAG 변경에 따른 품질 변화 추적

- 도메인 전문가 참여 평가 시스템 구축

효과

- 응답 품질 안정화

- 개발 효율 향상

회고

많은 기업들이 어떻게 자사 서비스 AI 서비스를 적용하고 유지하는지 의문이 들었는데 단순 프롬프트 작업 뿐 만 아니라

체계적인 운영방법론을 사용하여 서비스를 운영하는 것이 매우 흥미로웠다. 나중에 백엔드 프로젝트를 통해 직접 백터DB를

만들고 RAG로 할루시네이션을 방지하는 LLMOps 운영방식으로 AI 에어전트를 운영해보면 좋은 경험이 될 것 같다.

참고 자료

IBM

https://www.ibm.com/kr-ko/think/topics/llmops

배민 적용 사례

https://techblog.woowahan.com/22839/