인공 신경망(ANN)

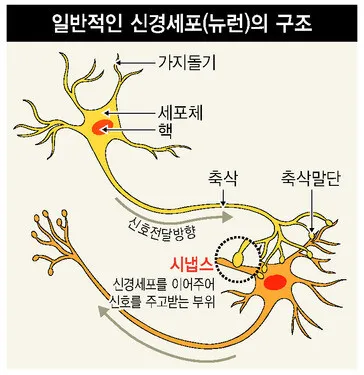

뉴런

신경세포 1개를 의미, 인간의 뇌는 약 1000억 개의 뉴런으로 구성

- 신경세포체: 핵이 있는 세포 부분

- 가지돌기: 다른 세포에서 신호를 받는 부분

- 축삭돌기: 다른 세포에 신호를 주는 부분

- 시냅스: 돌기 사이에서 다른 뉴런에 신호를 전달하는 부분

가지돌기에 자극을 받게 되면, 신경세포체를 통해 축삭돌기에 화학물질이 전달되어, 전이 발생,

전이의 정도가 특정 임계값을 넘으면, 시냅스를 통해 신호를 다음 뉴런에 전달

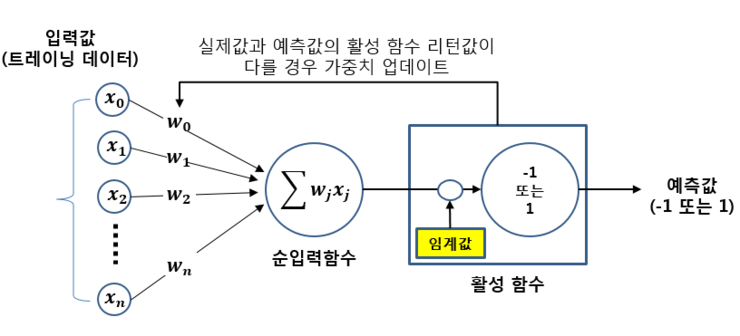

이런 뉴런의 활동을 코딩, 즉 논리회로로 만든것이 퍼셉트론(=ANN)

- 의 각각의 입력값을 받아서(=가지 돌기 자극)

- 각각을 가중치와 곱해서(bias도 더함)

- 이 특정 입계값을 넘으면 1, 아니면 0과 같은 알고리즘으로 구성

- 예: if then 1, else 0

- 실제 결과와 오차가 생기면, 가중치를 업데이트함

- 실제 결과와의 오차를 기반으로 가중치 업데이트를 할 수 있는 구조로 인해, 학습이 가능

- 실제 결과와의 오차를 기반으로 가중치 업데이트를 할 수 있는 구조로 인해, 학습이 가능

여기서 오차에 따라 가중치 업데이트 하는 과정이 앞 포스트의 경사하강법

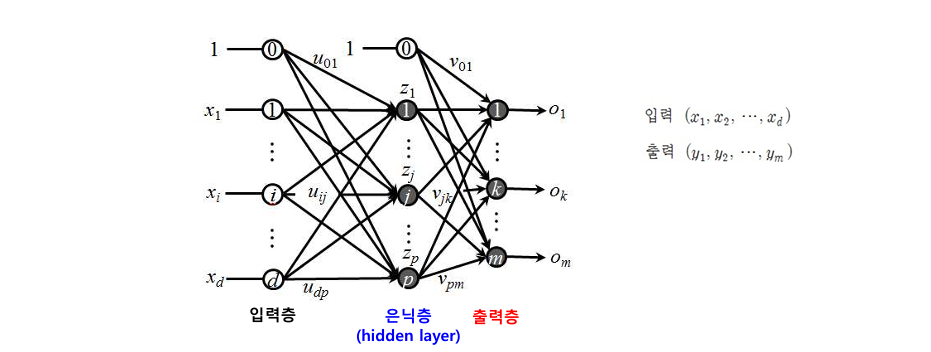

다층 퍼셉트론

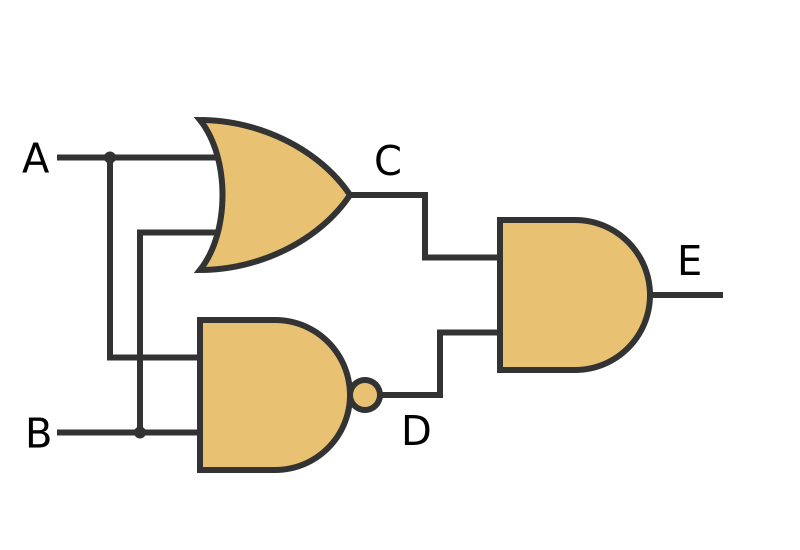

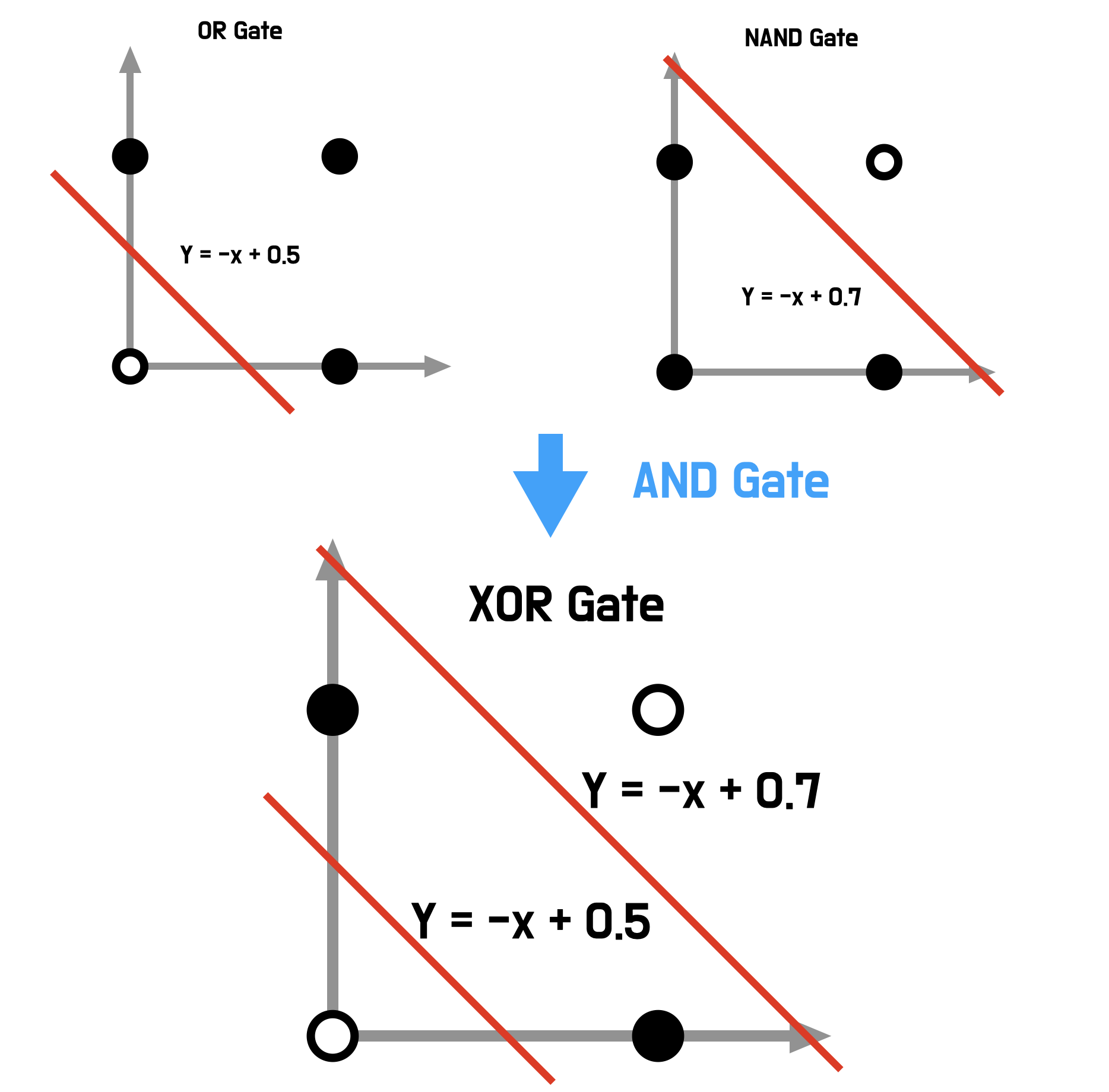

기존 퍼셉트론으론 XOR 게이트 구현이 입력층 만으로는(1개의 직선만으로는) 불가능하다는 한계 직면,

-> OR, NAND, AND 게이트 조합으로 XOR을 구현하듯이 입력과 출력 사이에 은닉층을 두면 XOR 문제 해결 가능하다는 관점

-> 따라서 layer를 여러 층 둘수록(직선이 많아질수록) 더욱 복잡한 문제를 해결할 수 있을 것이다는 결론이 도출됨

- 은닉층이 2개 이상인 신경망을 Deep Neural Network, DNN(=다층 퍼셉트론)이라고 함

Activation function, Non-linear function

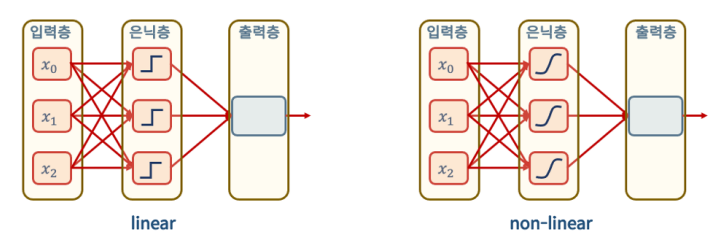

세상의 많은 문제는 linear(선형)보다 non-linear(비선형) 문제가 더 많다.

하지만 퍼셉트론의 연산의 구조가 선형적인 선밖에 표현할 수 없기 때문에 한계에 직면,

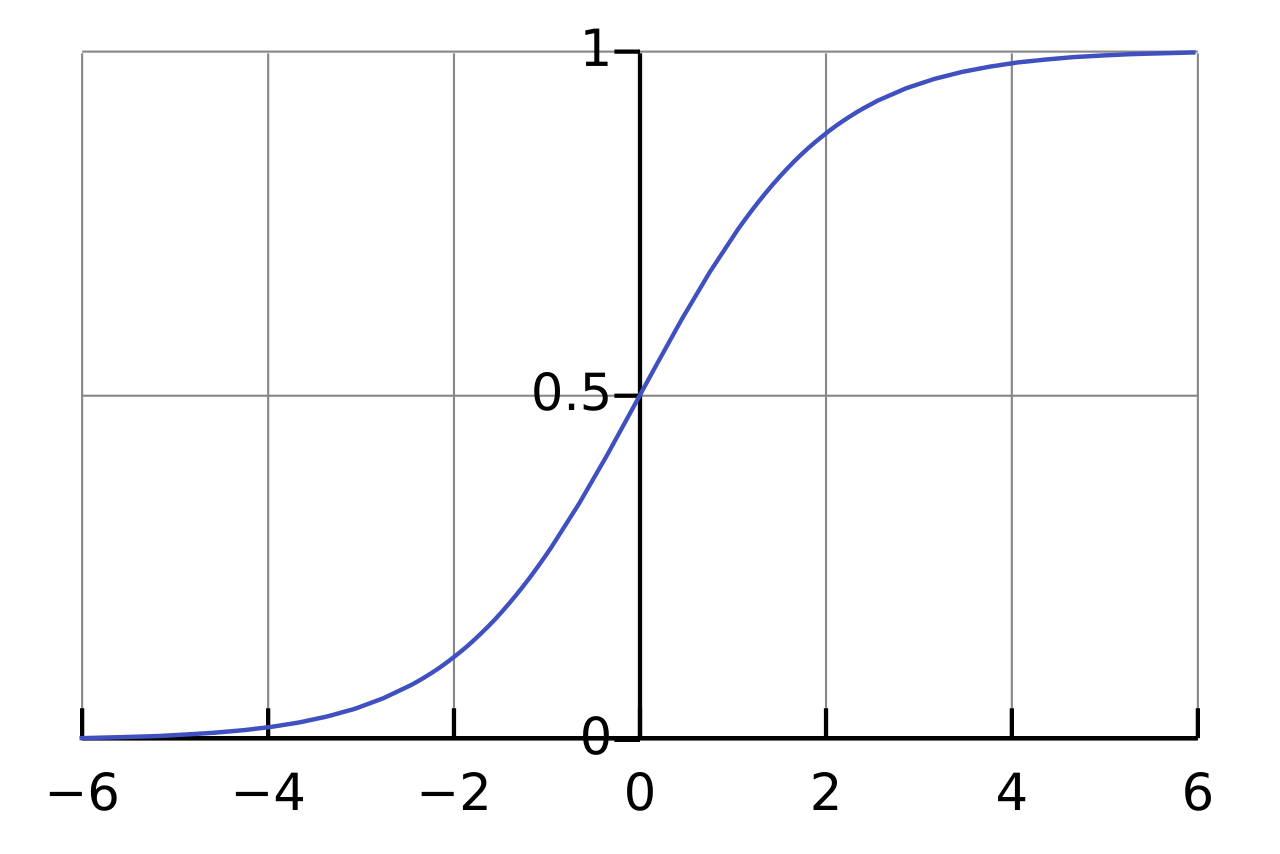

-> 다층 퍼셉트론에서 은닉층 각각의 Activation function으로 non-linear function을 사용하여, 출력층에서 non-linear function이 출력되도록 함.

ex:

-> depth(은닉층의 수)와 width(가중합 계산 노드 수)를 넓게 할수록, 딥러닝은 보다 복잡한 형태의 문제를 모사할 수 있다.

- depth와 width를 통칭, network capacity라고 한다.