ONNX

1.로컬 VRAM 최적화 - ONNX + INT8/Q4 양자화

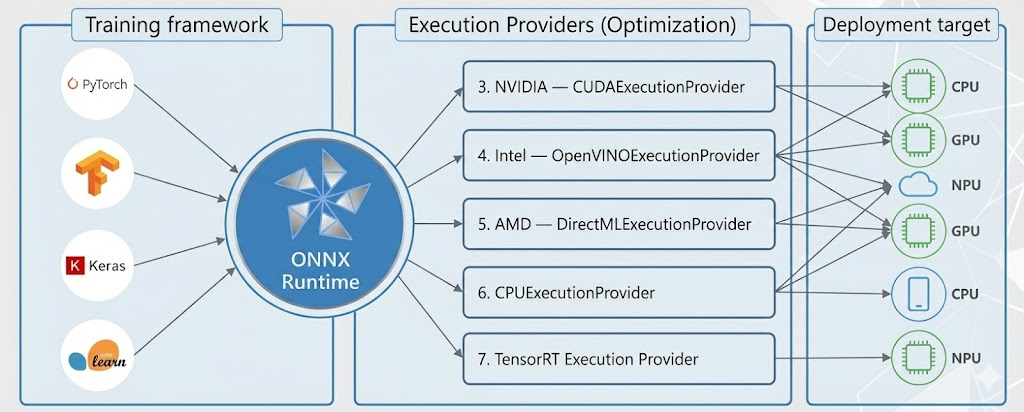

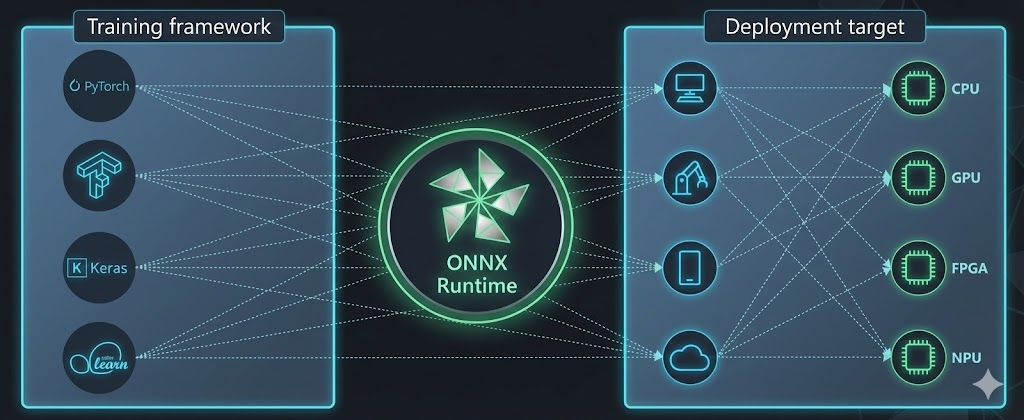

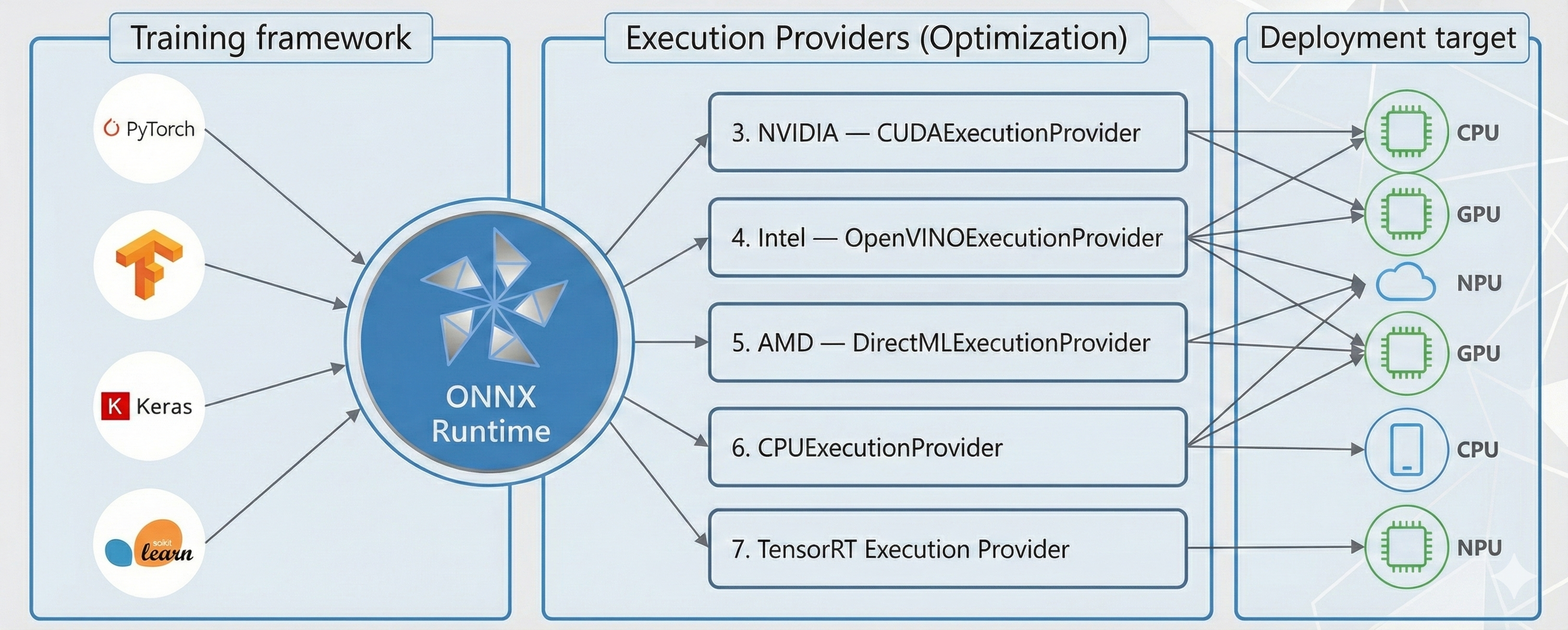

HyperCLOVAX 1.5B를 Colab에서 ONNX로 내보내고, 거기에 INT8 / Q4 양자화를 얹어서 로컬·서버에서 가볍게 돌려보는 것이 목표였다.ONNX Runtime의 경우 Intel, AMD, Nvidia 등 다양한 환경에서 Provider를 통해 최적화

2025년 11월 21일

2.ONNX 기반 HyperCLOVA 모델 변환 및 양자화

Transformer 모델을 ONNX로 HyperCLOVA 모델을 로컬에서 더 효율적으로 돌려보고 싶다는 생각이 들었다. 특히 safetensors 형태로 제공되는 모델을 ONNX로 변환해두면 CPU나 다양한 환경에서 공통적으로 추론을 돌릴 수 있고, 양자화까지 진행

2025년 11월 26일

3.온디바이스 GPU최적화: ONNX Runtime Execution Provider

ONNX Runtime(ORT)은 다양한 하드웨어를 사용해 추론을 가속할 수 있는 강력한 runtime이다.이에 내가 개발하고 있는 Local Agent가 각 사용자의 디바이스에 맞게 GPU사용 및 토큰 생성을 최적화 하고 싶었다.ONNX Runtime은 마침 Prov

2025년 11월 26일