프록시 서버(Proxy Server)

-

Proxy : 대리

-

클라이언트가 서버와 소통할 때, 서버에 바로 접근하지 않고 자신을 통해 서버에 접근할 수 있도록 해주는 일종의 대리 서버

-

보통 일반 사용자는 지역이 제한되어있는 서비스를 이용하기 위해 우회하거나, 캐시를 통해 더 빠른 이용을 하기 위해 사용

프록시 서버 종류

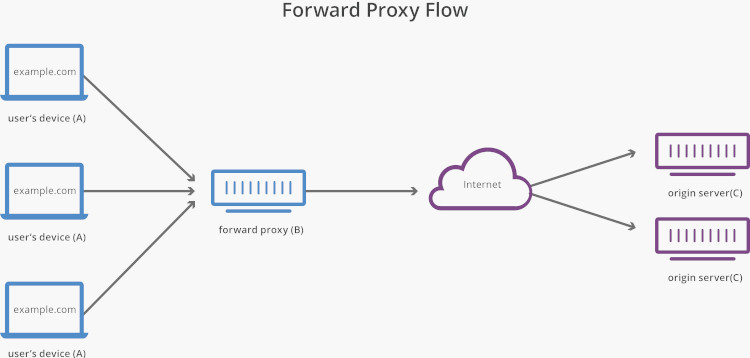

Forward Proxy

-

클라이언트 가까이에 위치한 프록시 서버

-

클라이언트를 대신해 서버에 요청을 전달

- 주로 캐싱을 제공하는 경우가 많아 사용자가 빠른 서비스 이용을 할 수 있도록 도와줌

✅ 장점

-

캐싱을 통해 빠른 서비스 이용 가능

- 클라이언트는 서비스의 서버가 아닌 프록시 서버와 소통함

- 이러한 과정에서 여러 클라이언트가 동일한 요청을 보내는 경우,

첫 응답을 하며 결과 데이터를 캐시에 저장해놓고, 이후 서버에 재 요청을 보내지 않아도 다른 클라이언트에게 빠르게 전달할 수 있음

-

보안

- 클라이언트에서 프록시 서버를 거친 후 서버에 요청이 도착하기 때문에,

서버에서 클라이언트의 IP 추적이 필요한 경우 클라이언트의 IP가 아닌 프록시 서버의 IP가 전달됨 - 서버가 응답받은 IP는 프록시 서버의 IP이기 때문에 서버에게 클라이언트를 숨길 수 있음

- 클라이언트에서 프록시 서버를 거친 후 서버에 요청이 도착하기 때문에,

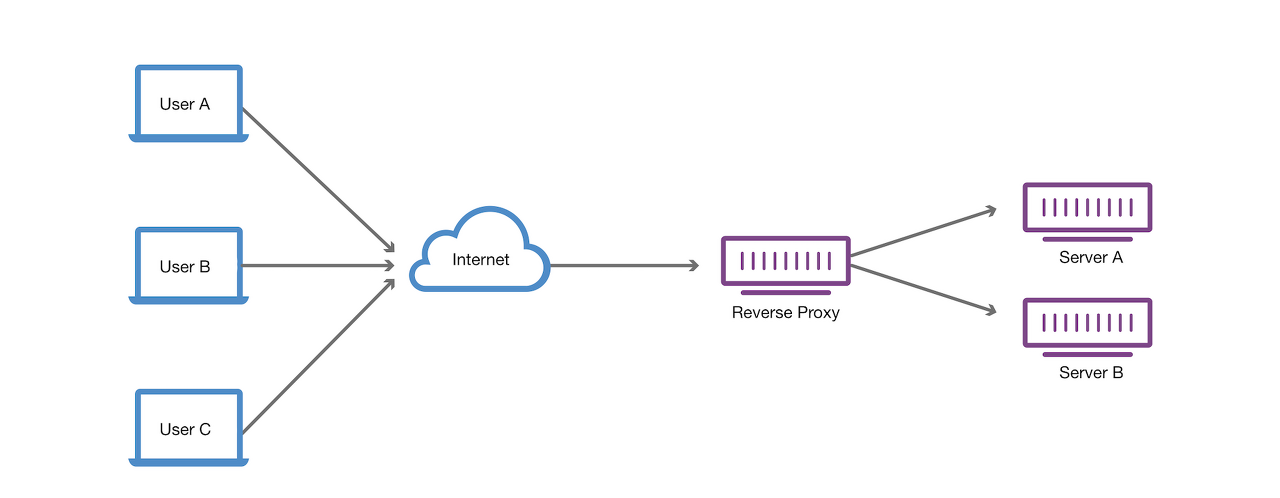

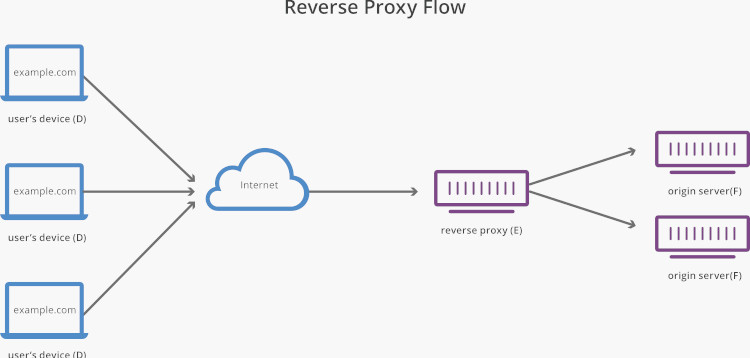

Reverse Proxy

-

서버 가까이에 위치한 프록시 서버

-

서버를 대신해서 클라이언트에 응답을 제공

-

이후 로드밸런서 챕터에서 자세히 배울 분산처리를 목적으로 하거나 보안을 위해 프록시 서버를 이용

✅ 장점

-

분산처리

클라이언트 - 서버구조에서 사용자가 많아져 서버에 과부하가 올 경우를 위해 부하를 분산할 수 있음- 프록시 서버로 요청이 들어오면 여러대의 서버로 요청을 나누어 전달 후 처리

-

보안

- Forward Proxy와 반대로 Reverse Proxy는 클라이언트에게 서버를 숨길 수 있음

- 클라이언트 입장에서의 요청보내는 서버가 프록시 서버가 되므로 실제 서버의 IP주소가 노출되지 않음

수평 확장

로드밸런서

- 하나의 서버에 너무 많거나 너무 잦은 요청을 보내면 서버에 과부화가 오게 됨

- 과부화로 인해 원활한 서비스를 제공하지 못하는 경우, 두 가지 선택을 할 수 있음

- 서버의 하드웨어를 업그레이드하는 방법

- 서버의 갯수를 늘리는 방법

✅ Scale-Up

- 물리적으로 서버의 사양을 높이는 하드웨어적인 방법

ㅤ☑️ 장점

- 서버의 수를 늘리지 않고 프로그램 구현에 있어 변화가 필요 없음

ㅤ

☑️ 단점- 서버의 사양을 높이는 데엔 굉장히 높은 비용이 듬

- 하드웨어 업그레이드엔 한계가 있음

- 사양을 늘린만큼 클라이언트 요청이 더욱 많아지면, 서버에 발생하는 부하는 여전히 해결 X

✅ Scale-Out

- 서버의 갯수를 늘려 하나의 서버에 줄 부하를 분산시키는 방법

ㅤ☑️ 장점

- 서버의 사양을 높이지 않고도 비교적 저렴한 방법으로 부하 처리 가능

🤔 Scale-Out 방법으로 여러 대의 서버로 부하를 처리하는 경우, 클라이언트로부터 온 요청을 어느 서버에 보내서 처리해야할까?

- 요청을 여러 서버에 나눠 처리할 수 있도록 교통정리를 해줄 역할 필요

➡️ 로드 밸런서

ㅤ

❗로드 밸런싱 : 여러 서버에 교통정리를 해주는 기술 혹은 프로그램

로드 밸런서의 종류 로드밸런싱의 기준 L2 데이터 전송 계층에서 Mac 주소를 바탕으로 로드 밸런싱 L3 네트워크 계층에서 IP 주소를 바탕으로 로드 밸런싱 L4 전송 계층에서 IP주소와 Port를 바탕으로 로드 밸런싱 L7 응용 계층에서 클라이언트의 요청을 바탕으로 로드 밸런싱 (Ex. 엔드포인트)

오토스케일링 (AWS 기반)

- Scale-Out 방식으로 서버를 증설할 때 자동으로 서버(리소스)를 관리해주는 기능

- 클라이언트의 요청이 많아져 서버의 처리 요구량이 증가하면 새 리소스를 자동으로 추가하고,

반대로 처리 요구량이 줄어들면 리소스를 감소시켜 적절한 분산 환경을 만들어줌

장점

✅ 동적 스케일링

- 사용자의 요구 수준에 따라 리소스를 동적으로 스케일링 할 수 있음

- 스케일 업 할 수 있는 서버의 수 제한 X

- 필요한 경우, 서버 두 대에서 수백 ~ 수만 대의 서버로 즉시 스케일 아웃 가능

✅ 로드 밸런싱

- 리소스를 동적으로 스케일업 혹은 스케일다운

- 로드밸런서와 함께 사용하면, 다수의 EC2 인스턴스에게 워크로드를 효과적으로 분배할 수 있음

- 사용자가 정의한 규칙에 따라 워크로드를 효과적으로 관리 할 수 있음

✅ 타겟 트래킹

- 사용자는 특정 타겟에 대해서만 Auto Scaling을 할 수 있음

- 사용자가 설정한 타겟에 맞춰 EC2 인스턴스의 수를 조정

✅ 헬스 체크와 서버 플릿 관리

- EC2 인스턴스의 헬스 체크 상태를 모니터링 가능

- 헬스 체크를 하는 과정에서 특정 인스턴스의 문제가 감지되면, 자동으로 다른 인스턴스로 교체함

💡 서버 플릿(Fleet)

- 다수의 EC2 서버에서 애플리케이션을 호스팅 하는 경우, 일련의 EC2 서버 집합

- Auto Scaling은 적정 수준의 서버 플릿 용량을 유지하는 데도 도움을 줌

- 애플리케이션이 6대의 EC2 서버에서 실행 중일 때,

6대 서버에 대한 헬스 체크 상태를 모니터링 하다가 특정 서버에 문제가 생기면 즉시 대응 조치- 한 대 또는 그 이상의 서버가 다운 되면 Auto Scaling은 6대의 서버 인스턴스 처리 용량을 유지하기 위해 부족분 만큼의 서버를 추가로 실행시키는 방식으로 서버 플릿을 유지

EC2 Auto Scaling 활용

✅ 시작 템플릿(Launch Configuration)

-

Auto Scaling으로 인스턴스를 확장 또는 축소하려면 어떤 서버를 사용할지 결정해야 함

➡️ 시작 템플릿을 통해 가능

AMI 상세 정보, 인스턴스 타입, 키 페어, 시큐리티 그룹 등 인스턴스에 대한 모든 정보를 담고 있음 -

만약 시작 템플릿을 사용하고 있지 않고, 시작 템플릿을 생성하지 않으려는 경우에는 대신 시작 구성을 생성할 수 있음

- EC2 Auto Scaling이 사용자를 위해 생성하는 EC2 인스턴스 유형을 지정한다는 점에서 시작 템플릿과 비슷함

- 사용할 AMI의 ID, 인스턴스 유형, 키 페어, 보안 그룹 등의 정보를 포함시켜서 시작 구성을 생성

✅ Auto Scaling 그룹 생성

- 스케일업 및 스케인 다운 규칙의 모음

- EC2 인스턴스 시작부터 삭제까지의 모든 동작에 대한 규칙과 정책을 담고 있음

⚠️ Auto Scaling 그룹을 생성하기 위해서는 스케일링 정책 및 유형에 대해서 잘 숙지하고 있어야 한다.

✅ Scaling 유형

☑️ 인스턴스 레벨 유지

- 기본 스케일링 계획이라고도 함

- 항상 실행 상태를 유지하고자 하는 인스턴스의 수를 지정할 수 있음

- 일정한 수의 인스턴스가 필요한 경우 최소, 최대 및 원하는 용량에 동일한 값을 설정할 수 있음

☑️ 수동 스케일링

- 기존 Auto Scaling 그룹의 크기를 수동으로 변경 가능

- 수동 스케일링을 선택하면 사용자가 직접 콘솔이나 API, CLI 등을 이용해 수동으로 인스턴스를 추가 또는 삭제 해야 함

- ❗해당 방식은 추천하지 않는 방식이다.

☑️ 일정별 스케일링

- 예측 스케일링 트래픽의 변화를 예측할 수 있고, 특정 시간대에 어느 정도의 트래픽이 증가하는지 패턴을 파악하고 있다면 일정별 스케일링을 사용하는 것이 좋음

- 🔅낮 시간대에는 트래픽이 최고치에 이르고, 🌙밤 시간대에는 트래픽이 거의 없다면

낮 시간대에 서버를 증설하고 밤 시간대에 스케일 다운 하는 규칙을 추가

- 🔅낮 시간대에는 트래픽이 최고치에 이르고, 🌙밤 시간대에는 트래픽이 거의 없다면

☑️ 동적 스케일링

- 수요 변화에 대응하여 Auto Scaling 그룹의 용량을 조정하는 방법을 정의

- 이 방식은 CloudWatch가 모니터링 하는 지표를 추적하여 경보 상태일 때 수행할 스케일링 규칙을 정함

- CPU 처리 용량의 80% 수준까지 급등한 상태가 5분 이상 지속될 경우,

Auto Scaling이 작동돼 새 서버를 추가하는 방식

➡️ 이와 같은 스케일링 정책을 정의 할 때는 항상 스케일 업과 스케일 다운 두 가지의 정책을 작성

- CPU 처리 용량의 80% 수준까지 급등한 상태가 5분 이상 지속될 경우,

Web Server

TOMCAT

-

Apache사에서 개발한 서블릿 컨테이너만 있는 오픈소스 웹 애플리케이션 서버

-

자바 애플리케이션을 위한 대표적인 오픈소스 WAS(Web Application Server)

-

오픈소스이기 때문에 라이선스 비용 부담 없이 사용 가능

-

독립적으로도 사용 가능하며 Apache 같은 다른 웹 서버와 연동하여 함께 사용할 수 있음

-

Tomcat은 자바 서블릿 컨테이너에 대한 공식 구현체

➡️ Spring Boot에 내장되어있어 별도의 설치 과정이 필요 X

Jetty

-

이클립스 재단의 HTTP 서버이자 자바 서블릿 컨테이너

-

Tomcat과 같이 자바 서블릿 컨테이너이자 서버로 사용할 수 있기 때문에 개발자는 원하는 서버를 선택하여 프로젝트를 구성할 수 있음

-

2009년 이클립스 재단으로 이전하며 오픈소스 프로젝트로 개발

-

타 웹 애플리케이션 대비 적은 메모리를 사용하여 가볍고 빠름

-

애플리케이션에 내장 가능

-

경량 웹 애플리케이션으로 소형 장비, 소규모 프로그램에 더 적합

💡 Spring Boot 서버 Jetty로 변경하기

- 아무런 설정을 해주지 않는다면 Spring Boot의 기본 내장 서버인 Tomcat으로 실행됨

build.gradle파일에서spring-boot-starter-web의존성이 추가되어있는 부분을 확인하고, Tomcat을 제외시킨 후 프로젝트를 재 빌드함implementation ('org.springframework.boot:spring-boot-starter-web') { exclude module: 'spring-boot-starter-tomcat' }

- Tomcat을 대체할 서버로 Jetty 의존성을 추가하고 프로젝트를 재 빌드함

implementation ('org.springframework.boot:spring-boot-starter-jetty')

NGINX

-

가볍고 높은 성능을 보이는 오픈소스 웹 서버 소프트웨어

-

Nginx는 웹 서버로 클라이언트에게 정적 리소스를 빠르게 응답하기 위한 웹 서버로 사용할 수 있음

🔅 Tomcat과 Jetty는 자바 서블릿 컨테이너 혹은 웹 애플리케이션 서버

-

트래픽이 많은 웹 사이트의 확장성을 위해 개발된 고성능 웹 서버

-

비동기 이벤트 기반으로 적은 자원으로 높은 성능과, 높은 동시성을 위해 개발됨

-

다수의 클라이언트 연결을 효율적으로 처리할 수 있음

-

클라이언트와 서버 사이에 존재하는 리버스 프록시 서버로 사용할 수 있음

-

Nginx를 클라이언트와 서버 사이에 배치하여 무중단 배포를 할 수 있음

VPC

- Virtual Private Cloud 서비스

- 클라우드 내 프라이빗 공간을 제공함으로써, 클라우드를 퍼블릭과 프라이빗 영역으로 논리적으로 분리할 수 있게 함

💡 이전에 VPC가 없었을 때는 클라우드에 있는 리소스를 격리 할 수 있는 방법이 없었다.

따라서 인스턴스들이 서로 거미줄처럼 연결되고, 인터넷과 연결되어 시스템의 복잡도를 엄청나게 끌어올릴 뿐만 아니라, 의존도를 높였다.

➡️ 유지 및 관리에 많은 비용과 노력을 투입해야 하는 단점

VPC를 분리함으로써 확장성을 가질 수 있고, 네트워크에 대한 완전한 통제권을 가질 수 있다.

구성 요소와 주요 용어

IP Address

- IP는 컴퓨터 네트워크에서 장치들이 서로를 인식하고 통신을 하기 위해서 사용하는 특수한 번호

IPv4,IPv6로 나뉘어 있으며 혼용하여 사용

IP Address Class

-

이전에는 IPv4 주소에서 호스트가 연결되어 있는 특정 네트워크를 가리키는 8비트의 네트워크 영역(Network Address)과 해당 네트워크 내에서 호스트의 주소(Host Address)를 가리키는 나머지 영역을 구분하기 위해서 클래스(Class)를 사용했음

-

클래스는 총 5가지(A, B, C, D, E) 클래스로 나누어져 있음

- D와 E 클래스는 멀티캐스트용, 연구 개발을 위한 예약 IP이므로 보통 사용되지 않음

CIDR(Classless inter-domain routing)

-

국제 표준의 IP주소 할당 방법

-

IP 클래스 방식을 대체한 방식

-

기존에는 클래스에 따라 정해진 Network Address와 Host Address를 사용해야 했다면, CIDR은 원하는 블록만큼 Network Address를 지정하여 운용할 수 있음

서브넷(Subnet)

-

서브네트워크(Subnetwork)의 줄임말

-

IP 네트워크의 논리적인 하위 부분을 가리킴

-

서브넷을 통해 하나의 네트워크를 여러 개로 나눌 수 있음

-

VPC를 사용하면 퍼블릭 서브넷, 프라이빗 서브넷, VPN only 서브넷 등, 필요에 따라 다양한 서브넷을 생성 가능

- 퍼블릭 서브넷 : 인터넷을 통해 연결 할 수 있는 서브넷

- 프라이빗 서브넷 : 인터넷을 연결하지 않고, 보안을 유지하는 배타적인 서브넷

- VPN only 서브넷 : 기업 데이터 센터와 VPC를 연결하는 서브넷

-

서브넷은 VPC의 CIDR 블록을 이용해 정의됨

라우팅 테이블(Routing Table)

-

트래픽의 전송 방향을 결정하는 라우트와 관련된 규칙을 담은 테이블

-

목적지를 향한 최적의 경로로 데이터 패킷을 전송하기 위한 모든 정보를 담고 있음

➡️ 하나의 지점에서 또 다른 지점으로 가기 위한 모든 정보를 제공하기 위한 테이블 -

모든 서브넷은 라우팅 테이블을 지님

- 각각의 서브넷은 항상 라우팅 테이블을 가지고 있어야 함

- 하나의 라우팅 테이블 규칙을 여러 개의 서브넷에 연결하는 것도 가능함