졸업작품의 본격적인 시작으로 OpenPose를 사용해보기로 했다.

OpenPose 다운로드

- OpenPose 파일들을 다운받는다. (찾아본 방법 2가지)

- WEB에서는 링크에 들어가서 Code -> Download ZIP

- GitHub Desktop에서는 File -> Clone repository -> URL -> 깃허브 주소와 다운받을 path를 입력 -> Clone

- 다운로드 한 폴더의 models\pose\mpi 경로에 파일 두개를 적절한 위치에 복사해둔다.

1) pose_deploy_linevec_faster_4_stages.prototxt

2) pose_iter_160000.caffemodel

Python, OpenPose로 신체부위 검출해보기

- python 소스코드 입력 : 코칸리's 코오딩 참고

import cv2

BODY_PARTS = { "Head": 0, "Neck": 1, "RShoulder": 2, "RElbow": 3, "RWrist": 4,

"LShoulder": 5, "LElbow": 6, "LWrist": 7, "RHip": 8, "RKnee": 9,

"RAnkle": 10, "LHip": 11, "LKnee": 12, "LAnkle": 13, "Chest": 14,

"Background": 15 }

POSE_PAIRS = [ ["Head", "Neck"], ["Neck", "RShoulder"], ["RShoulder", "RElbow"],

["RElbow", "RWrist"], ["Neck", "LShoulder"], ["LShoulder", "LElbow"],

["LElbow", "LWrist"], ["Neck", "Chest"], ["Chest", "RHip"], ["RHip", "RKnee"],

["RKnee", "RAnkle"], ["Chest", "LHip"], ["LHip", "LKnee"], ["LKnee", "LAnkle"] ]

protoFile = "C:\\Users\\JH\\Documents\\VSCodeSonsuProjects\\openpose\\pose_deploy_linevec_faster_4_stages.prototxt"

weightsFile = "C:\\Users\\JH\\Documents\\VSCodeSonsuProjects\\openpose\\pose_iter_160000.caffemodel"

net = cv2.dnn.readNetFromCaffe(protoFile, weightsFile)

image = cv2.imread("C:\\Users\\JH\\Documents\\VSCodeSonsuProjects\\openpose\\test.png")

imageHeight, imageWidth, _ = image.shape

inpBlob = cv2.dnn.blobFromImage(image, 1.0 / 255, (imageWidth, imageHeight), (0, 0, 0), swapRB=False, crop=False)

net.setInput(inpBlob)

output = net.forward()

H = output.shape[2]

W = output.shape[3]

print("이미지 ID : ", len(output[0]), ", H : ", output.shape[2], ", W : ",output.shape[3])

points = []

for i in range(0,15):

probMap = output[0, i, :, :]

minVal, prob, minLoc, point = cv2.minMaxLoc(probMap)

x = (imageWidth * point[0]) / W

y = (imageHeight * point[1]) / H

if prob > 0.1 :

cv2.circle(image, (int(x), int(y)), 3, (0, 255, 255), thickness=-1, lineType=cv2.FILLED)

cv2.putText(image, "{}".format(i), (int(x), int(y)), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 0, 255), 1, lineType=cv2.LINE_AA)

points.append((int(x), int(y)))

else :

points.append(None)

cv2.imshow("Output-Keypoints",image)

cv2.waitKey(0)

imageCopy = image

for pair in POSE_PAIRS:

partA = pair[0]

partA = BODY_PARTS[partA]

partB = pair[1]

partB = BODY_PARTS[partB]

if points[partA] and points[partB]:

cv2.line(imageCopy, points[partA], points[partB], (0, 255, 0), 2)

cv2.imshow("Output-Keypoints",imageCopy)

cv2.waitKey(0)

cv2.destroyAllWindows()

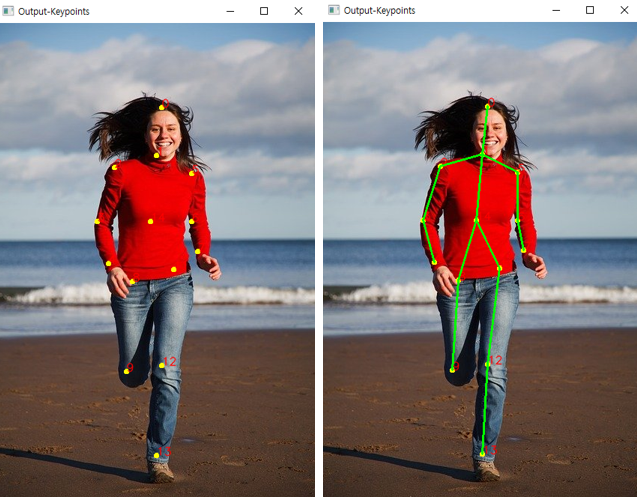

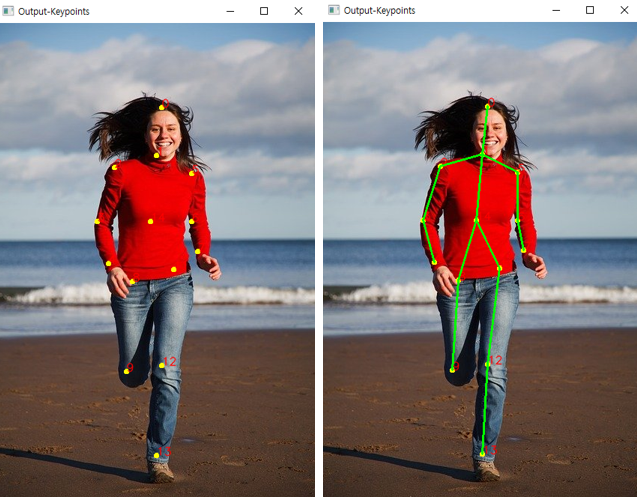

- 결과

배경이 깨끗하고 사람의 동작도 깔끔해야 결과가 잘 나온다

참고