08. 웹스크래핑(크롤링) 기초

웹스크래핑 해보기 (영화 제목)

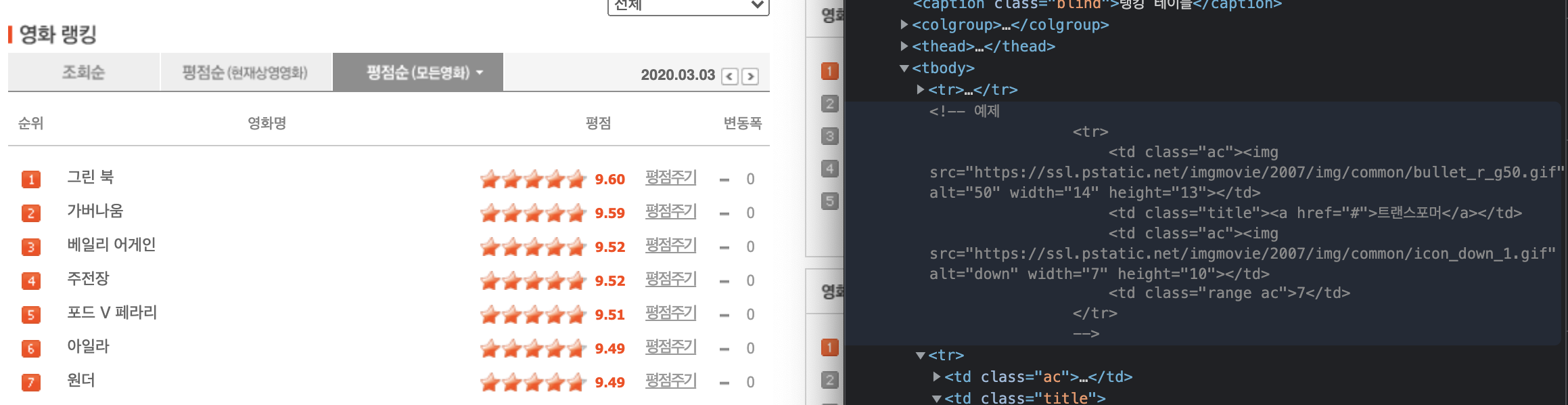

네이버 영화 페이지

https://movie.naver.com/movie/sdb/rank/rmovie.nhn?sel=pnt&date=20200303

패키지 추가설치(beautifulsoup4)

- bs4

크롤링 기본 세팅

import requests

from bs4 import BeautifulSoup

# URL을 읽어서 HTML를 받아옴.

headers = {'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64)AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'}

data = requests.get('https://movie.naver.com/movie/sdb/rank/rmovie.nhn?sel=pnt&date=20200303',headers=headers)

# HTML을 BeautifulSoup이라는 라이브러리를 활용해 검색하기 용이한 상태로 만듦

# soup이라는 변수에 "파싱 용이해진 html"이 담긴 상태가 됨

soup = BeautifulSoup(data.text, 'html.parser')

#############################

# 코딩으로 필요한 부분 추출하기

#############################- request로 요청하고, beautifulsoup으로 필요한 정보만 솎아낸다!

select / select_one 사용법 익히기

- 하나 가져올땐 select_one, 여러개 가져올땐 select

예제: 영화 제목 가져오기

👉 태그 안의 텍스트를 출력하고 싶다 → 태그.text

👉 태그 안의 속성을 출력하고 싶다 → 태그['속성']

크롬 개발자 도구로 선택자 추출하기

추출하고 싶은 글자 오른쪽 마우스 클릭 > 검사 > Copy > Copy selector

- 위 사진의 파란 영역(영화 랭킹 목록)을 선택자로 추출해보면,

#old_content > table > tbody > tr:nth-child(2)#old_content > table > tbody > tr:nth-child(3)... 반복됨.

-

영화 전체 랭킹 목록을 가져오려면, `

#old_content > table > tbody > tr을 통해 가져오면 되겠구나! (tr태그를 가져옴) -

영화 이름 부분을 클릭해 선택자로 추출하면,

#old_content > table > tbody > tr:nth-child(2) > td.title > div > a출력됨. -

가져온 tr 태그 내에서

td.title > div > a로 접근하여 영화 이름을 추출하면 된다!

- a_tag 출력하면 a태그 전체가 나옴

-

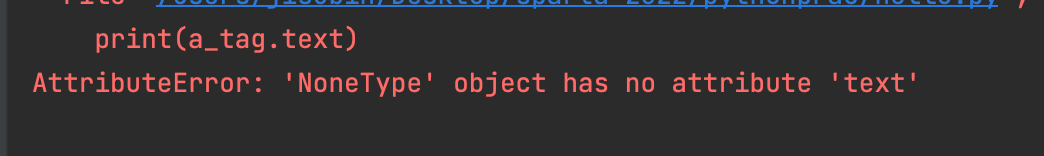

그런데 a태그 중간에 None이 보인다. 이유는?

- 사이트마다 소스코드가 다 다르기 때문에 위와 같은 부분은 None으로 처리되어 보인다.

- 이 상태로 a_tag.text 를 이용해 a태그 내의 text에 접근하려고 하면 당연히 오류가 날 것임.

-

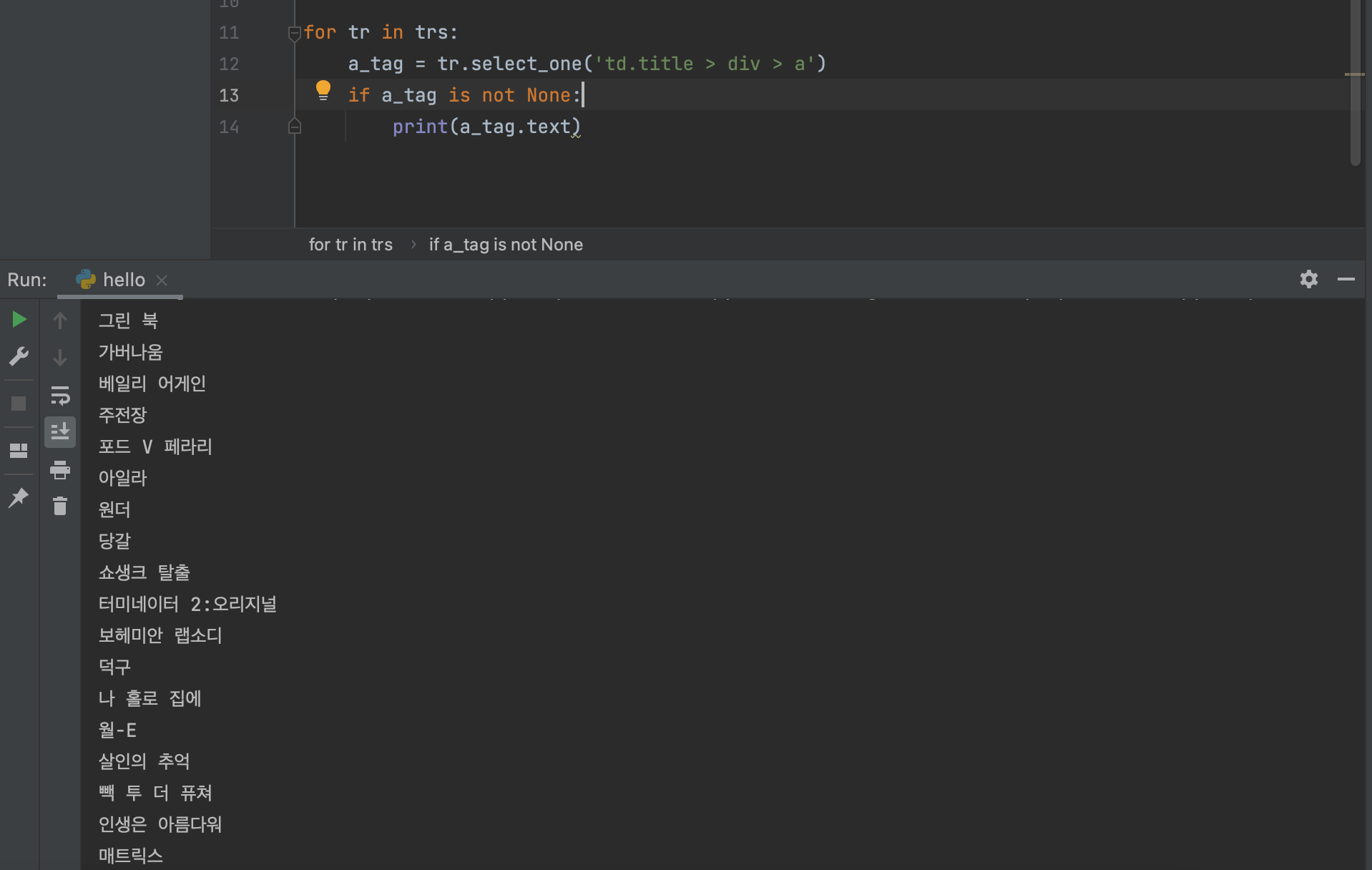

None 처리 해주기

a_tag is not None:조건문을 추가하여 None이 아닐때만 a_tag.text를 출력하도록 한다.

최종 소스코드

import requests

from bs4 import BeautifulSoup

# URL을 읽어서 HTML를 받아옴

headers = {'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64)AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'}

data = requests.get('https://movie.naver.com/movie/sdb/rank/rmovie.nhn?sel=pnt&date=20200303',headers=headers)

# HTML을 BeautifulSoup이라는 라이브러리를 활용해 검색하기 용이한 상태로 만듦

soup = BeautifulSoup(data.text, 'html.parser')

# select를 이용해서, tr들을 불러오기

trs = soup.select('#old_content > table > tbody > tr')

# trs 반복문 돌리기

for tr in trs:

# tr 안에 a 가 있으면,

a_tag = tr.select_one('td.title > div > a')

if a_tag is not None:

# a의 text를 출력

print (a_tag.text)beautifulsoup 내 select에 미리 정의된 다른 방법들

# 선택자를 사용하는 방법 (copy selector)

soup.select('태그명')

soup.select('.클래스명')

soup.select('#아이디명')

soup.select('상위태그명 > 하위태그명 > 하위태그명')

soup.select('상위태그명.클래스명 > 하위태그명.클래스명')

# 태그와 속성값으로 찾는 방법

soup.select('태그명[속성="값"]')

# 한 개만 가져오고 싶은 경우

soup.select_one('위와 동일')09. Quiz_웹스크래핑(크롤링) 연습

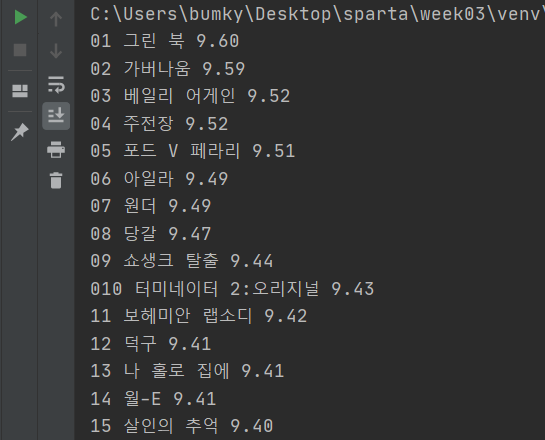

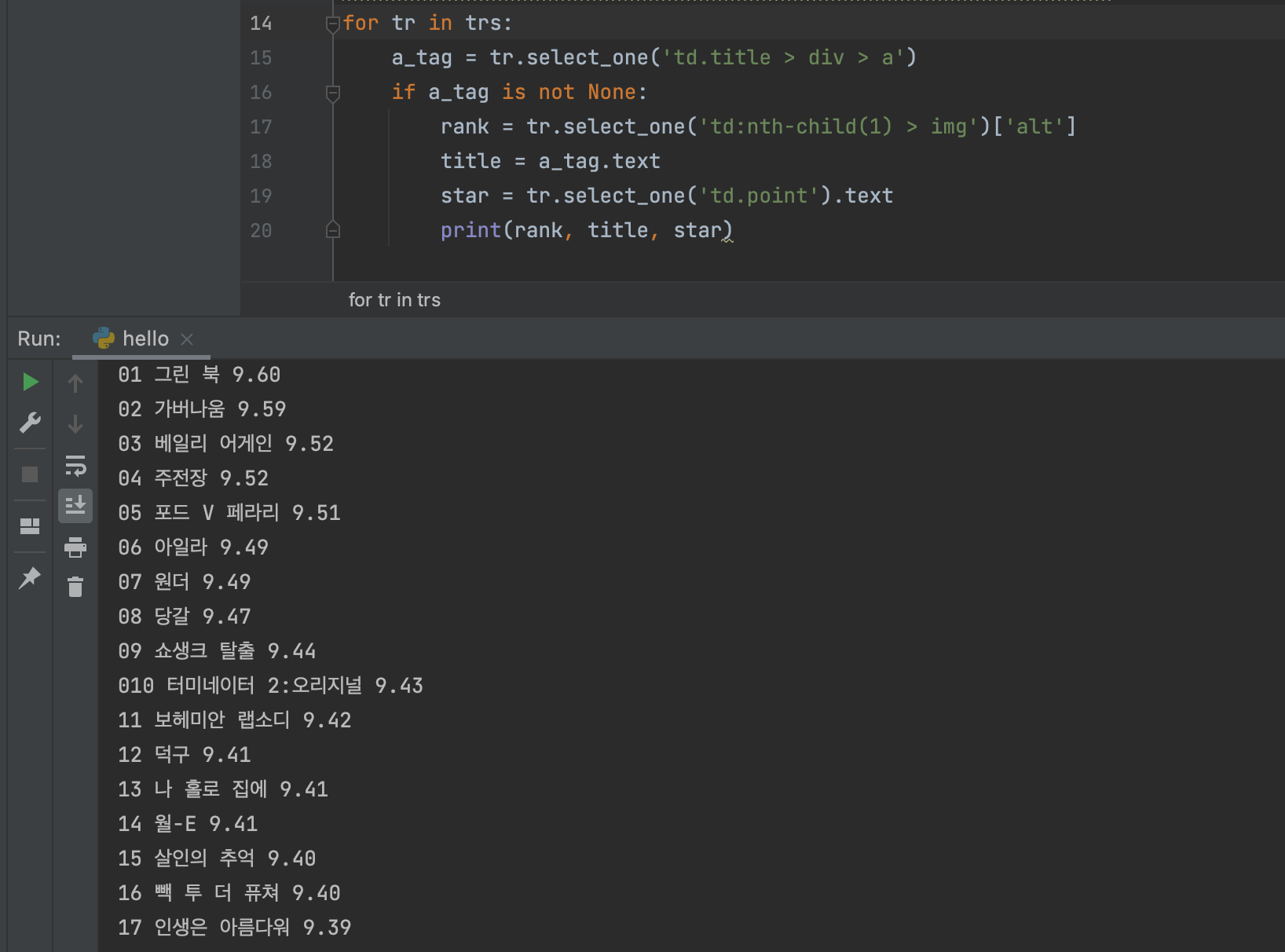

✍웹스크래핑 더 해보기 (순위, 제목, 별점)

출력 예제

소스코드

import requests

from bs4 import BeautifulSoup

# URL을 읽어서 HTML를 받아오고,

headers = {'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64)AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'}

data = requests.get('https://movie.naver.com/movie/sdb/rank/rmovie.nhn?sel=pnt&date=20200303',headers=headers)

# HTML을 BeautifulSoup이라는 라이브러리를 활용해 검색하기 용이한 상태로 만듦

soup = BeautifulSoup(data.text, 'html.parser')

# select를 이용해서, tr들을 불러오기

trs = soup.select('#old_content > table > tbody > tr')

# trs 반복문 돌리기

for tr in trs:

# tr 안에 a 가 있으면,

a_tag = tr.select_one('td.title > div > a')

if a_tag is not None:

# img 태그의 alt 속성값을 가져오기

rank = tr.select_one('td:nth-child(1) > img')['alt']

title = a_tag.text

# td 태그 사이의 텍스트를 가져오기

star = tr.select_one('td.point').text

print(rank,title,star)코드 실행화면

같은 크롤링이라도 사람마다 전략이 다르다!

내가 원하는 정보를 어떻게 뽑아낼지 고민하는 것이 중요함.

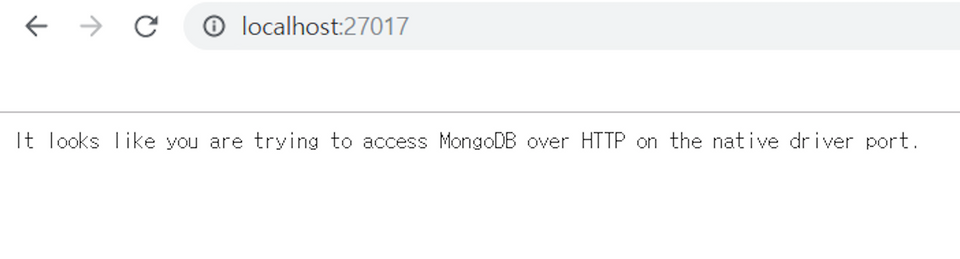

10. DB 설치 확인

mongoDB 작동 확인하기

크롬 창에 localhost:27017 이라고 쳤을 때, 아래와 같은 화면이 나오면 mongoDB가 돌아가고 있는것임.

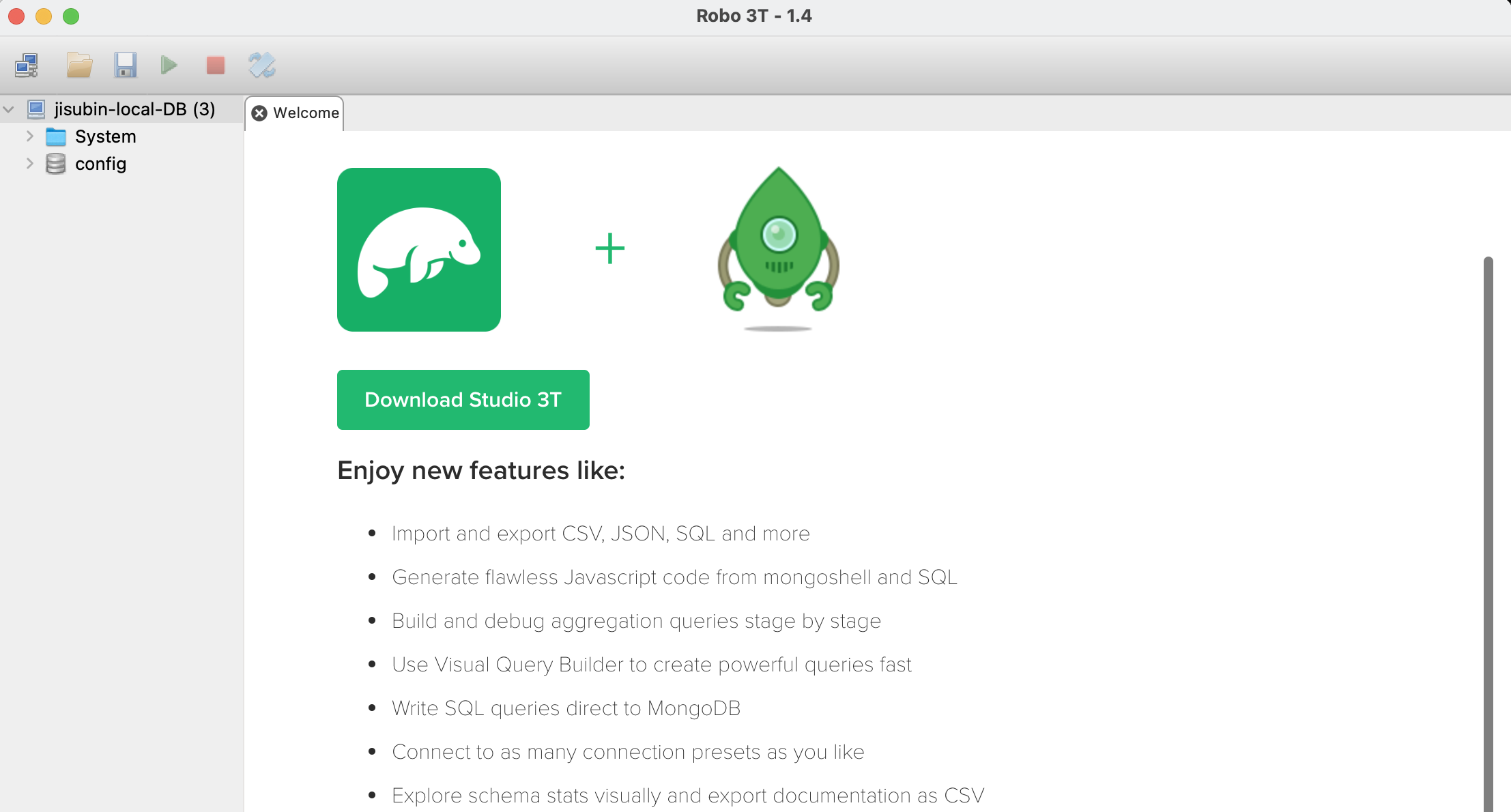

robo 3T 준비하기

robo 3T의 역할

- mongoDB는 GUI(그래픽 인터페이스)를 제공하지 않아 눈에 보이지 않는다.

- 데이터를 저장했는데 눈에 보이지 않으면? 😭

- 그래서 DB 내부를 살펴보기 위한 프로그램인 robo 3T가 필요함

robo 3T 세팅하기

robo 3T > Create > 이름 입력 > Save > Connect

- db, collection, documents 등 확인 가능함.

- 지금은 System, config 외에는 아무것도 없지만 후에 데이터 넣으면 config 아래로 데이터들이 추가될 것임.

11. DB 개괄

- Database 의 사용 목적: 데이터를 잘 찾아서 가져와 쓰기 위함

DB의 2가지 종류

Database에는, 크게 두 종류가 있다.

👉 RDBMS(SQL)

엑셀에 데이터 저장하는 것과 유사하다. (행/열 과 같이 생김새가 정해진 데이터 형태)

엑셀을 예시로, 데이터 50만개가 적재된 상태에서 갑자기 중간에 열 하나 추가하기는 힘들 것이다.

하지만, 정형화 되어있는 만큼 데이터 일관성 / 분석에 용이하다.ex) MS-SQL, My-SQL, 오라클 등

👉 No-SQL

딕셔너리 형태로 데이터를 저장하는 DB.

데이터 하나 하나가 모두 같은 생김새일 필요 없음.

자유로운 형태의 데이터 적재에는 유리하지만, 일관성이 부족할 수 있다.ex) MongoDB

12. pymongo로 DB조작하기

pymongo로 mongoDB 조작하기

pymongo 라이브러리의 역할

- 예를 들어, 엑셀을 파이썬으로 조작하려면 특별한 라이브러리가 필요할 것이다.

- 마찬가지로, mongoDB를 파이썬으로 조작하려면 특별한 라이브러리인 pymongo가 필요하다.

pymongo 패키지 설치

pymongopymongo 기본코드

from pymongo import MongoClient

client = MongoClient('localhost', 27017)

db = client.dbsparta

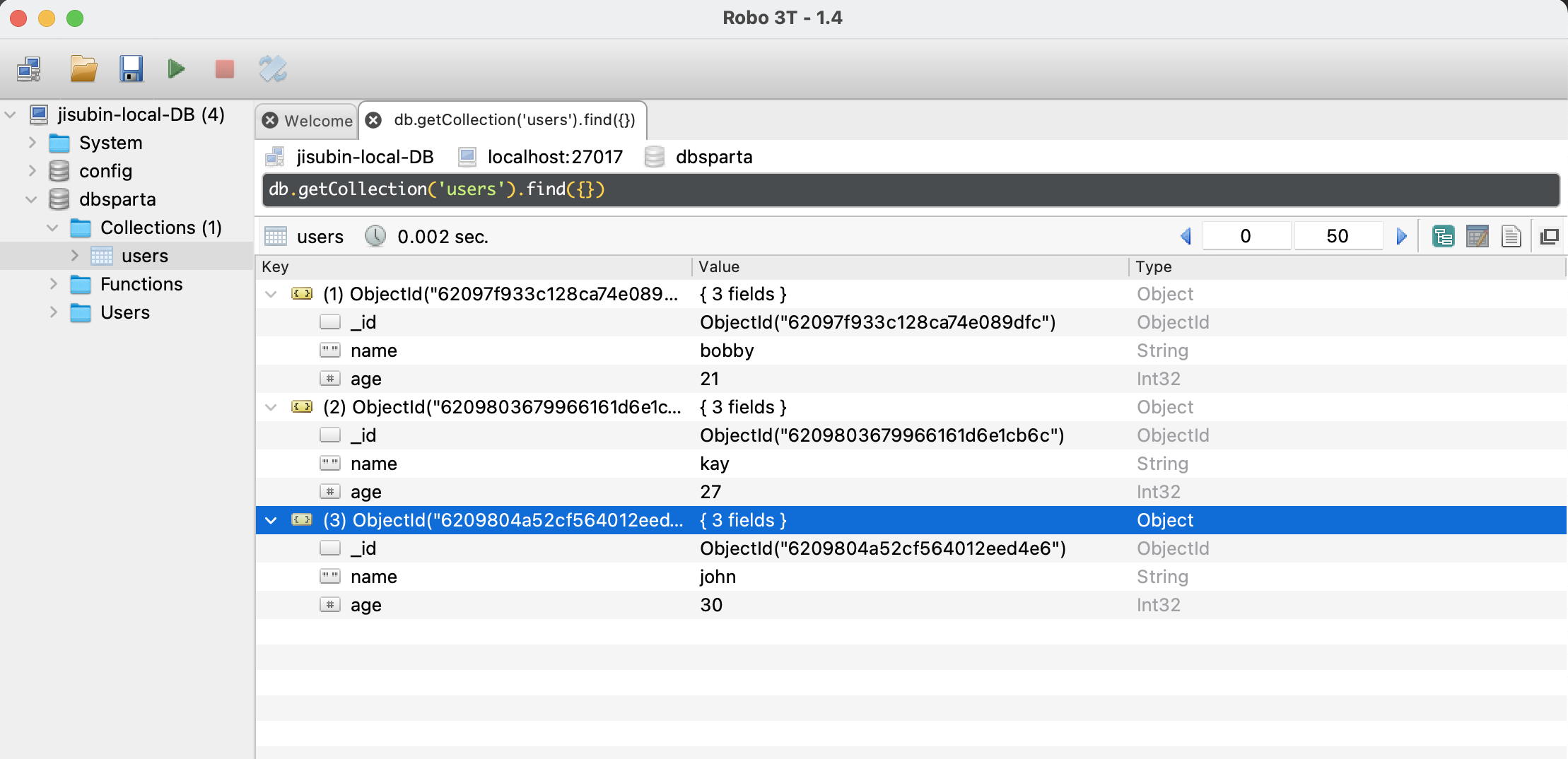

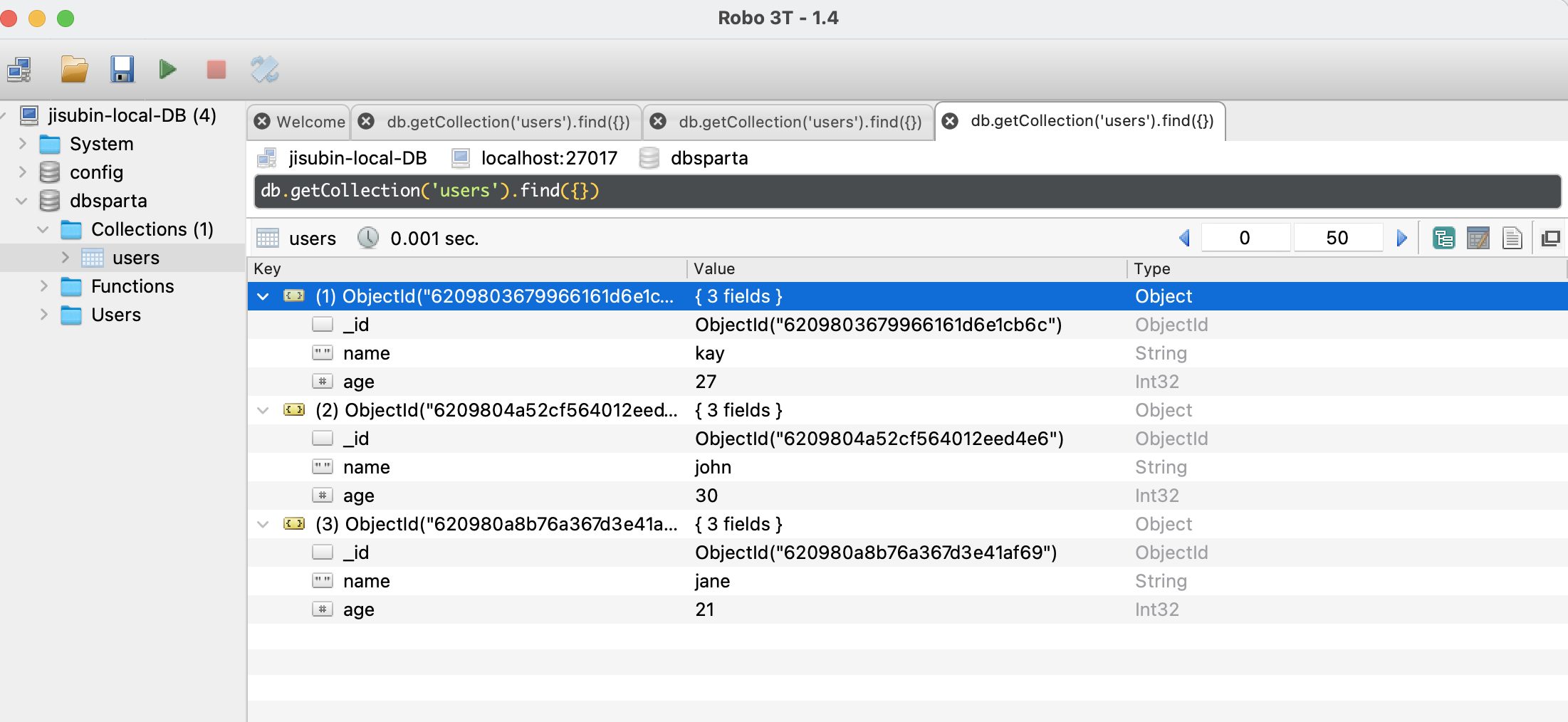

# 코딩 시작DB 연결 & 데이터 넣기: insert_one

# pymongo 임포트

from pymongo import MongoClient

# mongoDB는 27017 포트로 돌아간다.

client = MongoClient('localhost', 27017)

# 'dbsparta'라는 이름의 db 생성

db = client.dbsparta

# MongoDB에 insert 하기

# 'users'라는 collection에 {'name':'bobby','age':21} 넣음

db.users.insert_one({'name':'bobby','age':21})

db.users.insert_one({'name':'kay','age':27})

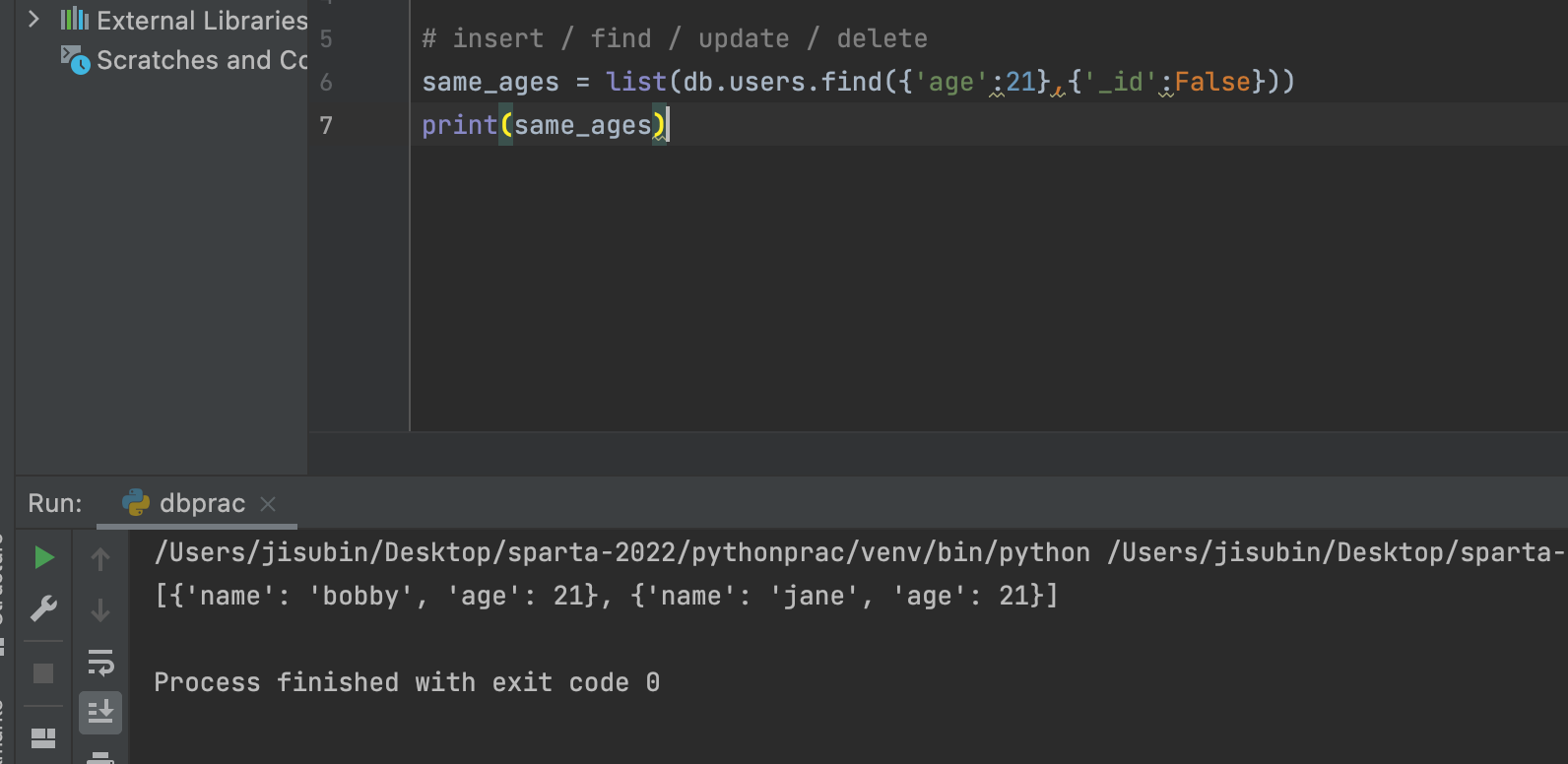

db.users.insert_one({'name':'john','age':30})모든 결과 값 보기: find

특정 조건 데이터 출력

age가 21인 데이터만 출력하고 싶다.

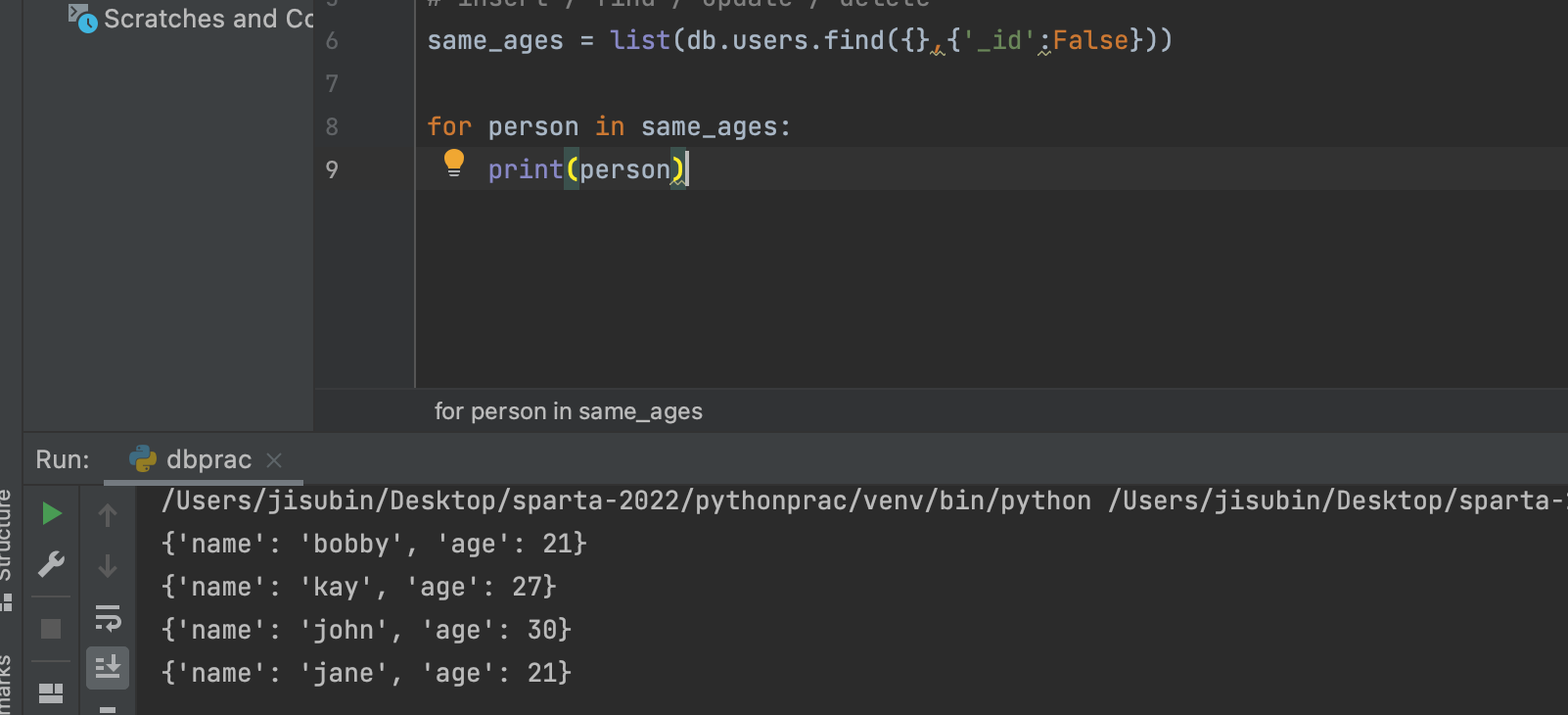

데이터 모두 보기

db의 모든 users 콜렉션의 데이터를 출력하고 싶다.

# pymongo 임포트

from pymongo import MongoClient

# mongoDB는 27017 포트로 돌아간다.

client = MongoClient('localhost', 27017)

# 'dbsparta'라는 이름의 db 생성

db = client.dbsparta

# MongoDB에서 데이터 모두 보기

all_users = list(db.users.find({}))

# 참고) MongoDB에서 특정 조건의 데이터 모두 보기

# '_id': False 는 _id값은 빼고 출력하라는 뜻

same_ages = list(db.users.find({'age':21},{'_id':False}))

# 0번째 결과값 보기

print(all_users[0])

# 0번째 결과값의 'name'을 보기

print(all_users[0]['name'])

# 반복문 돌며 모든 결과값 보기

for user in all_users:

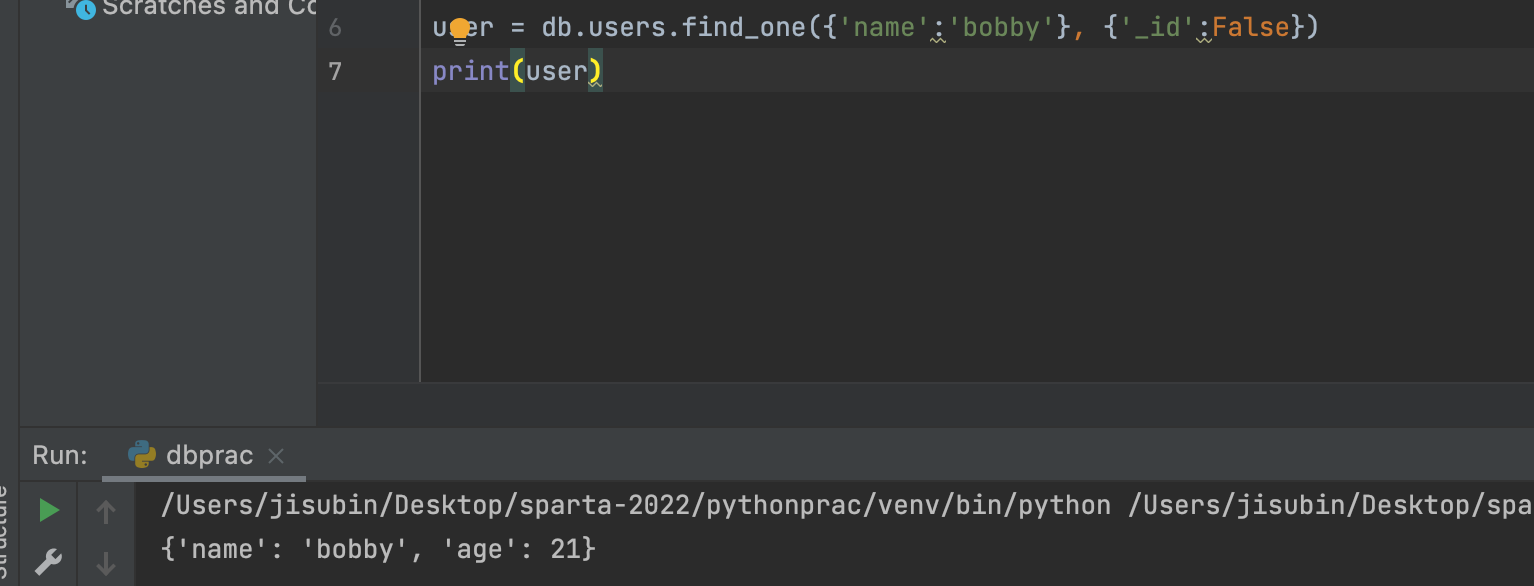

print(user)특정 결과 값 뽑아 보기: find_one

name이 bobby인 데이터 중 첫번째 데이터를 출력하고 싶다.

user = db.users.find_one({'name':'bobby'})

print(user)수정하기: update_one

name이 bobby인 데이터 중 첫번째 데이터를 찾아 age를 19로 바꾸고 싶다.

db.users.update_one({'name':'bobby'},{'$set':{'age':19}})

- age가 19로 바뀐 것을 확인할 수있음.

만약 name이 bobby인 데이터를 모두 찾아 age를 19로 바꾸고 싶다면?

- update_many 를 사용하면 된다.

- 근데.. update_many는 잘 사용하지 않는다.(한번에 다 바꾸는건 위험하니까)

db.users.update_many(찾을조건,{ '$set': 어떻게바꿀지 })

삭제하기: delete_one(거의 안씀)

name이 bobby인 데이터를 삭제하고 싶다.

db.users.delete_one({'name':'bobby'})

- delete_many 도 있지만 위험해서 잘 안쓴다.

pymongo 사용법 요약

저장/찾기/바꾸기/삭제 4가지 기능만 숙지하자.

# 저장 - 예시

doc = {'name':'bobby','age':21}

db.users.insert_one(doc)

# 한 개 찾기 - 예시

user = db.users.find_one({'name':'bobby'})

# 여러개 찾기 - 예시 ( _id 값은 제외하고 출력)

same_ages = list(db.users.find({'age':21},{'_id':False}))

# 바꾸기 - 예시

db.users.update_one({'name':'bobby'},{'$set':{'age':19}})

# 지우기 - 예시

db.users.delete_one({'name':'bobby'})13. 웹스크래핑 결과 저장하기

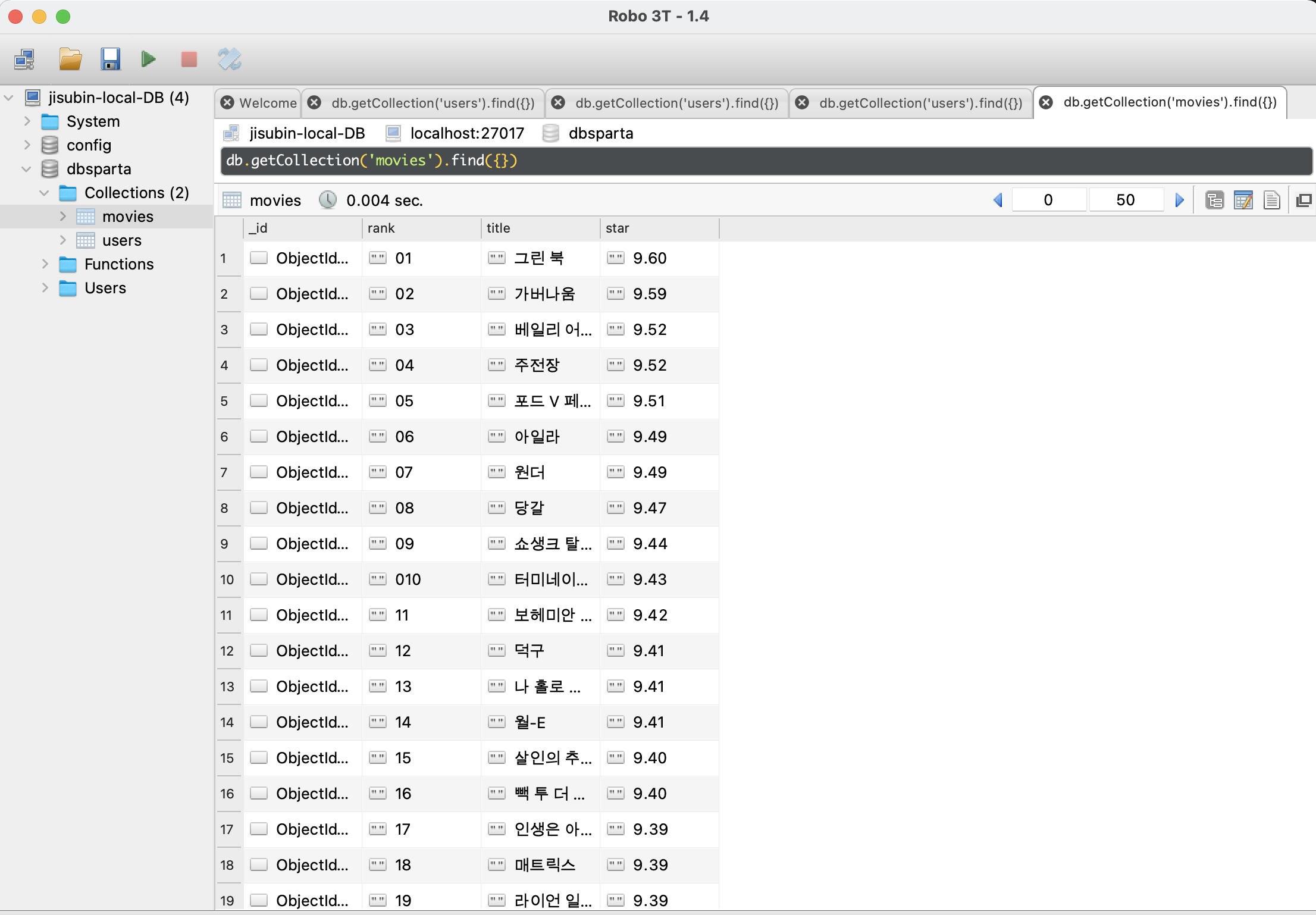

insert 연습하기 - 웹스크래핑 결과를 DB에 저장하기

-

이전 영화 랭킹 웹스크래핑 예제에 pymongo 기본세팅 코드 추가한다.

from pymongo import MongoClient client = MongoClient('localhost', 27017) db = client.dbsparta -

도큐먼트를 만들어 db의 movies 컬렉션에 하나씩 insert 해준다.

doc = { 'rank' : rank, 'title' : title, 'star' : star } db.movies.insert_one(doc)

전체 소스 코드

import requests

from bs4 import BeautifulSoup

# pymongo 임포트

from pymongo import MongoClient

# mongoDB는 27017 포트로 돌아감

client = MongoClient('localhost', 27017)

# 'dbsparta'라는 이름의 db 생성

db = client.dbsparta

# URL을 읽어서 HTML를 받아오고,

headers = {'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64)AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'}

data = requests.get('https://movie.naver.com/movie/sdb/rank/rmovie.nhn?sel=pnt&date=20200303',headers=headers)

# HTML을 BeautifulSoup이라는 라이브러리를 활용해 검색하기 용이한 상태로 만듦

soup = BeautifulSoup(data.text, 'html.parser')

# select를 이용해서, tr들을 불러오기

movies = soup.select('#old_content > table > tbody > tr')

# trs 반복문 돌리기

for trs in movies:

# trs 안에 a 가 있으면,

a_tag = trs.select_one('td.title > div > a')

if a_tag is not None:

# img 태그의 alt 속성값을 가져오기

rank = trs.select_one('td:nth-child(1) > img')['alt']

# a 태그 사이의 텍스트를 가져오기

title = a_tag.text

# td 태그 사이의 텍스트를 가져오기

star = trs.select_one('td.point').text

doc = {

'rank' : rank,

'title' : title,

'star' : star

}

db.movies.insert_one(doc)실행결과

14. Quiz_웹스크래핑 결과 이용하기

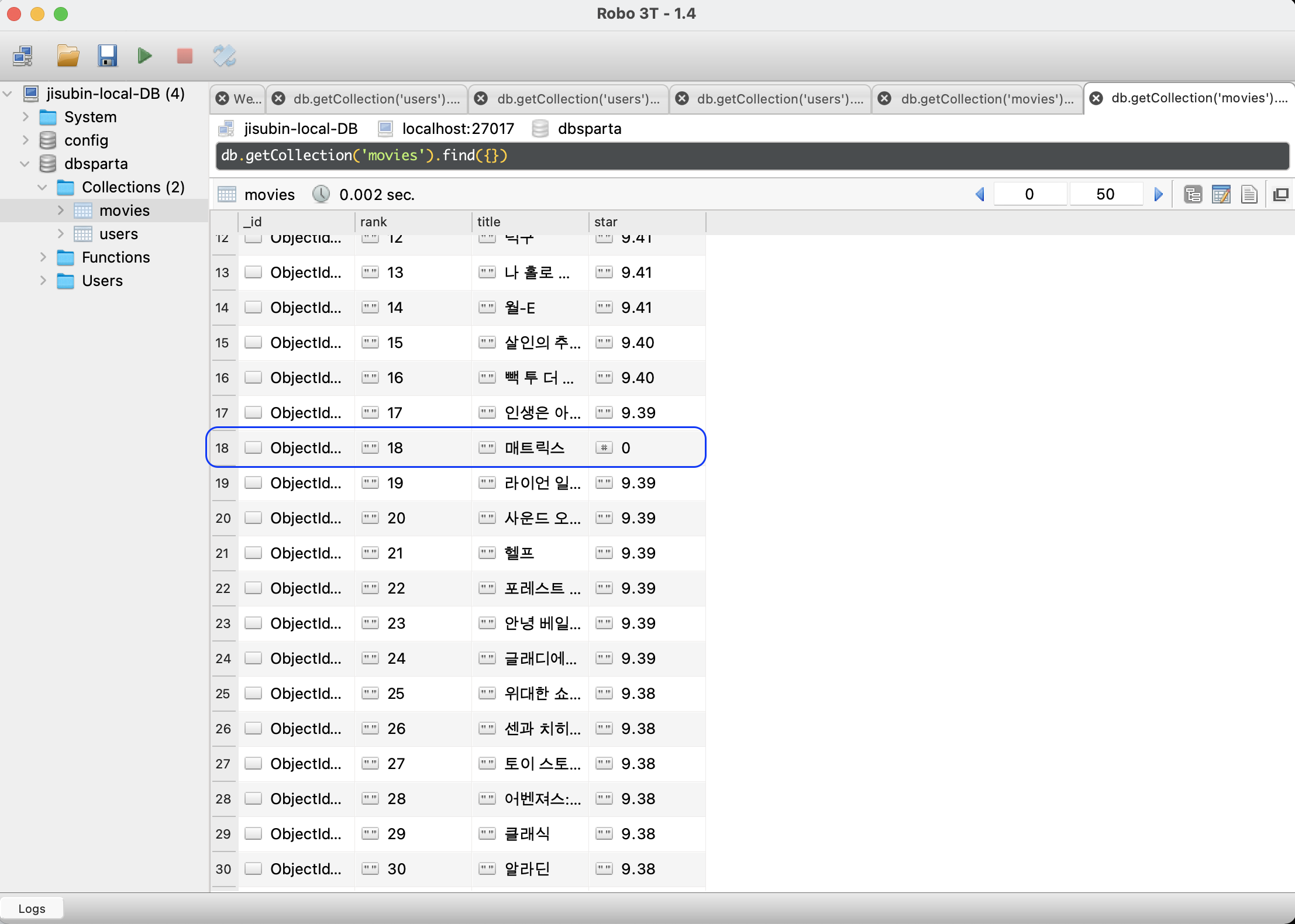

✍find, update 연습하기

1. 영화 제목 '매트릭스'의 평점 가져오기

target_movie = db.movies.find_one({'title':'매트릭스'})

print (target_movie['star'])2. '매트릭스'의 평점과 같은 평점의 영화 제목 가져오기

target_movie = db.movies.find_one({'title':'매트릭스'})

target_star = target_movie['star']

movies = list(db.movies.find({'star':target_star}))

for movie in movies:

print(movie['title'])3. '매트릭스'의 영화 평점을 0으로 만들기

dp.movies.update_one({'title':'매트릭스'},{'$set':{'star':'0'}})- 0 넣어줄때 '0' 문자열로 넣어주어야 관리하기 편함.(다른 수치들이 다 문자열이기 때문에 일관성을 위해서)

15. 3주차 숙제

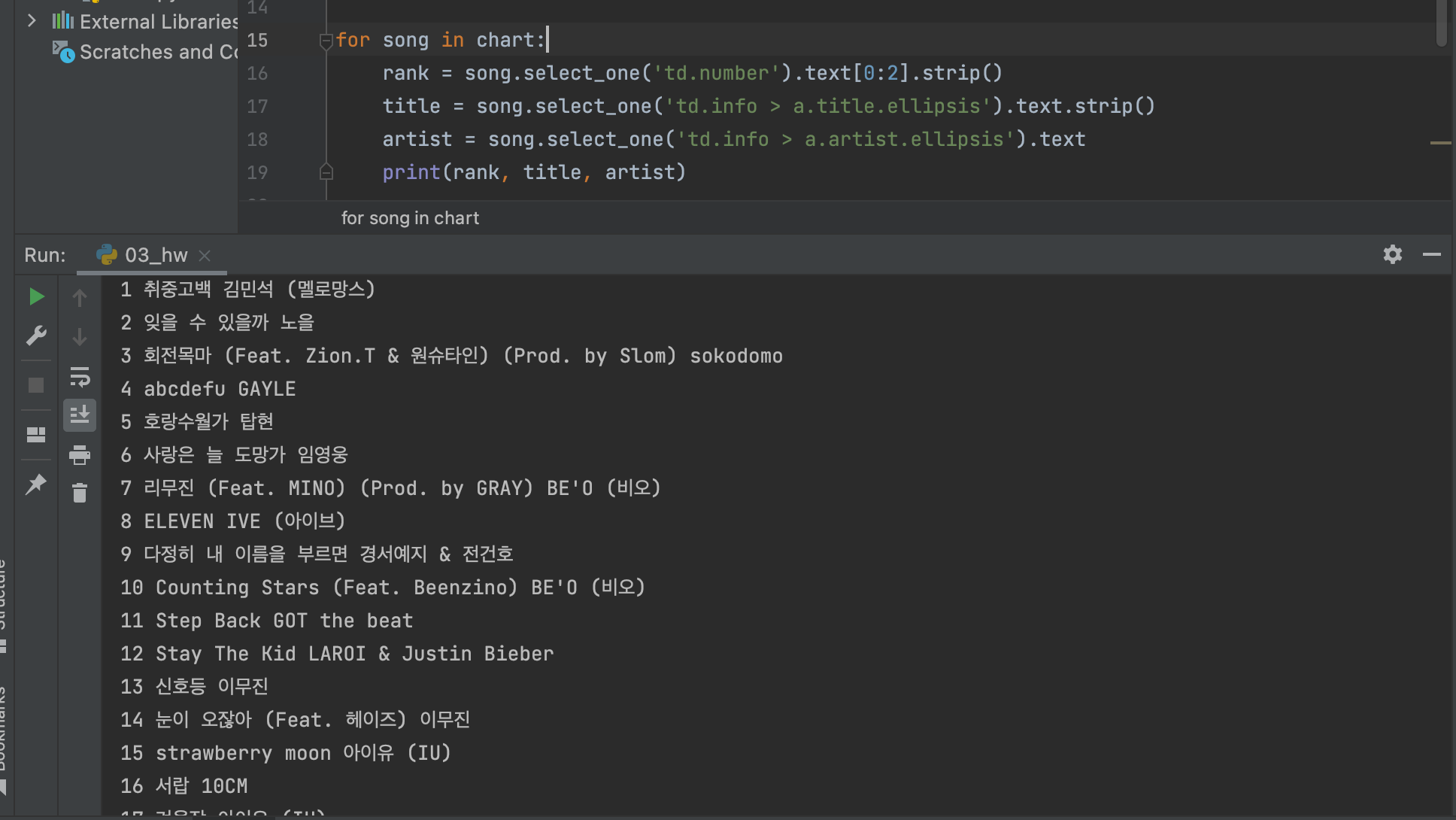

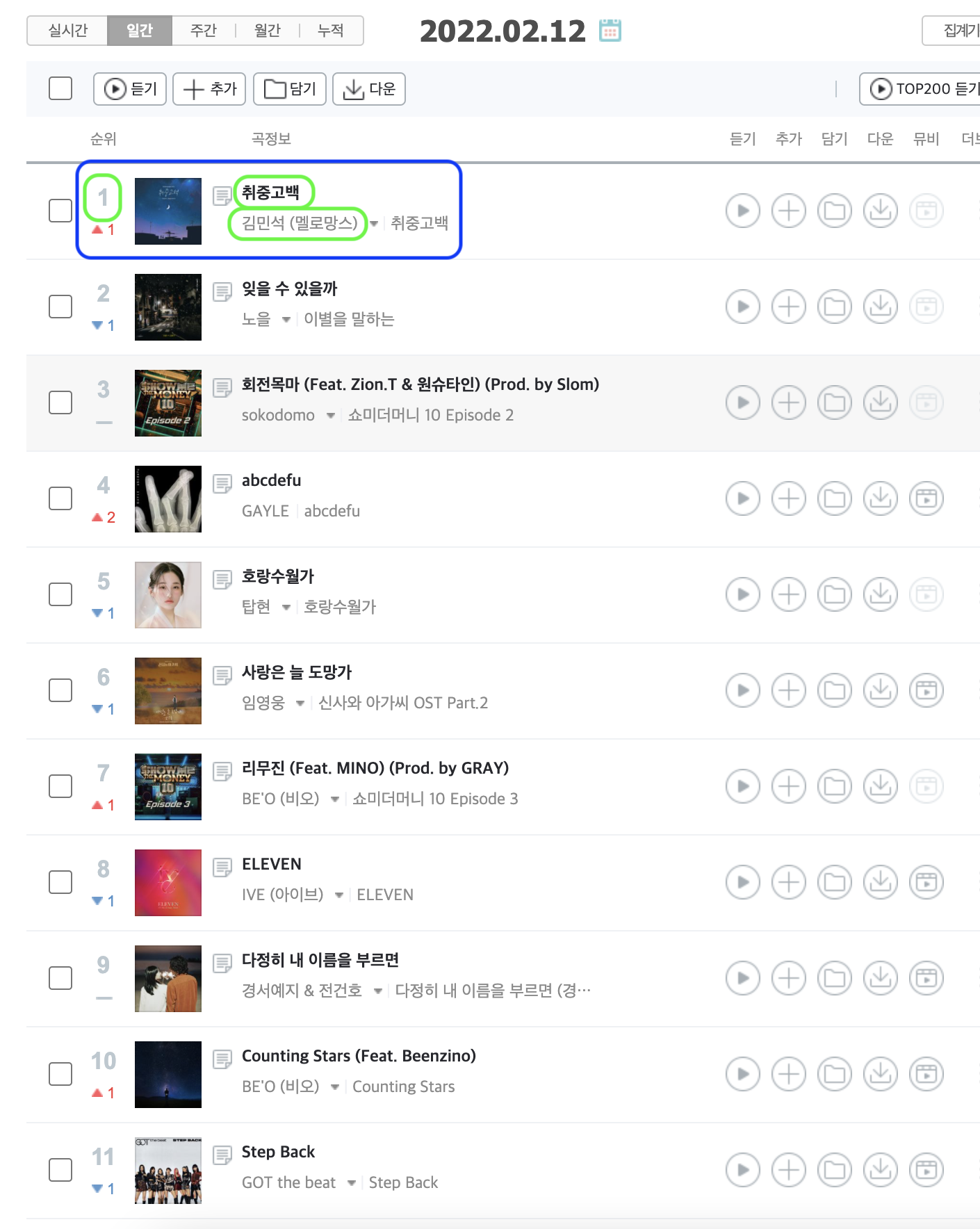

📃 지니뮤직의 1~50위 곡을 스크래핑 해보세요.

: 순위 / 곡 제목 / 가수 스크래핑 하기

출력 예제

👻 힌트:

- 순위, 곡 제목이 깔끔하게 나오지 않을 것이다.(여백이 있다던가, 다른 글씨가 나온다던가)

- 파이썬 내장함수

strip()을 잘 연구해보자!

사이트에서 내가 추출하고 싶은 데이터: 순위 / 곡 제목 / 가수

차트 목록 Copy selector로 추출해보기

위 사진에 표시된 첫번째 목록 추출 결과

#body-content > div.newest-list > div > table > tbody > tr:nth-child(1)#body-content > div.newest-list > div > table > tbody > tr로 전체 목록 tr 태그들을 추출 할 수 있다.

차트 목록에서 순위 추출하기

첫번째 목록에서 순위 추출한 결과

#body-content > div.newest-list > div > table > tbody > tr:nth-child(1) > td.number- 받아온 tr태그의 항목에서

td.number를 가져온 값이 순위가 될 것이다.

- 그냥

rank = song.select_one('td.number').text로 추출해주면 띄어쓰기 때문에 순위가 제대로 출력되지 않기 때문에, 파이썬에서 문자열 슬라이싱 하는 문법을 이용해 0번째부터 1번째 문자까지 잘라낼수 있도록.text[0:2]를 붙여준다.(순위가 1위~50위 까지 표시되어 있기 때문에 2자리니까 0번째부터 1번째 문자만 잘라내는 것) - 마지막으로 1~9번째 순위의 경우 위에서 문자열을 잘라줄때 공백 1자리도 함께 포함하여 출력하기 때문에

.strip()으로 최종 공백을 전부 제거해준다.

차트 목록에서 곡 제목 추출하기

첫번째 목록에서 곡 제목 추출한 결과

#body-content > div.newest-list > div > table > tbody > tr:nth-child(1) > td.info > a.title.ellipsis- 받아온 tr태그 항목에서

td.info > a.title.ellipsis를 가져온 값이 곡 제목이 될 것이다.

- 위와 마찬가지로 그냥 출력하면 띄어쓰기까지 같이 포함되어 있어서

.strip()으로 공백을 제거해줬다.

차트 목록에서 가수 이름 추출하기

첫번째 목록에서 가수 이름 추출한 결과

#body-content > div.newest-list > div > table > tbody > tr:nth-child(2) > td.info > a.artist.ellipsis- 받아온 tr태그 항목에서

td.info > a.artist.ellipsis를 가져온 값이 가수 이름이 될 것이다.

- 가수 이름은 출력했을때 공백없이 잘 출력되어서 따로 함수로 처리해주지 않았다.

3주차 숙제 코드

import requests

from bs4 import BeautifulSoup

from pymongo import MongoClient

client = MongoClient('localhost', 27017)

db = client.dbsparta

headers = {'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64)AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'}

data = requests.get('https://www.genie.co.kr/chart/top200?ditc=D&rtm=N', headers=headers)

soup = BeautifulSoup(data.text, 'html.parser')

chart = soup.select('#body-content > div.newest-list > div > table > tbody > tr')

for song in chart:

rank = song.select_one('td.number').text[0:2].strip()

title = song.select_one('td.info > a.title.ellipsis').text.strip()

artist = song.select_one('td.info > a.artist.ellipsis').text

print(rank, title, artist)출력 결과