【2025년 최신】무제약 LLM 랭킹 Top10|프라이버시 중시 개발자가 선택해야 할 모델은 이것

"이 프롬프트, ChatGPT에서는 거부당하네..."

지난달 개인 프로젝트로 AI 어시스턴트를 만들 때 이런 벽에 여러 번 부딪혔습니다. 나쁜 일을 하려는 것도 아니고, 단지 약간 공격적인 캐릭터의 대사를 생성하고 싶었을 뿐인데 말이죠.

"더 자유롭게 사용할 수 있는 LLM은 없을까?"

그렇게 생각하며 조사하기 시작한 것이 로컬에서 동작하는 무제약 LLM의 세계였습니다.

처음에는 "로컬 LLM은 성능이 떨어지지 않을까?"라고 생각했습니다. 하지만 실제로 사용해보니 2025년의 로컬 LLM은 상상 이상으로 발전해 있었습니다. 게다가 프라이버시도 보호되고 비용도 제로입니다.

이번에는 실제로 테스트해본 무제약 LLM Top10과 실무에서 사용할 수 있는 운용술을 공유하고자 합니다.

무제약 LLM이란? 왜 지금 주목받고 있는가

무제약(Unrestricted) LLM이란 상용 클라우드 서비스와 같은 안전 필터를 최소한으로 억제한 LLM을 말합니다.

OpenAI나 Anthropic의 모델은 윤리적 이유로 다양한 제약이 걸려 있습니다. 그 자체는 나쁜 것이 아니지만, 개발자에게는 불편할 때도 있습니다.

로컬 LLM의 4가지 장점

실제로 사용해보며 느낀 장점은 다음과 같습니다:

1. 프라이버시가 완전히 보호됨

사내 데이터나 개인정보가 포함된 프롬프트도 외부로 전송되지 않습니다. 기업의 기밀정보를 다룰 때는 필수 조건입니다.

2. 비용이 제로

초기 하드웨어 투자는 필요하지만, 한 번 환경을 구축하면 무제한 사용 가능합니다. API 과금을 걱정할 필요가 없습니다.

3. 자유도가 높음

창작 활동, 연구, 프로토타입 개발 등 제약 없이 자유롭게 사용할 수 있습니다.

4. 커스터마이징 가능

파인튜닝이나 LoRA로 자신의 용도에 특화된 모델을 만들 수 있습니다.

왜 2025년에 재주목받고 있는가

2024년 후반부터 로컬 LLM 시장이 급속히 성숙했습니다.

MoE(Mixture of Experts)의 보급

Mixtral, Llama3 MoE 등의 등장으로 소형 GPU에서도 고성능을 낼 수 있게 되었습니다.

커뮤니티 모델의 품질 향상

Hermes, Dolphin, MythoMax 등 독자적으로 튜닝된 모델이 상용 모델에 근접한 성능을 실현하고 있습니다.

개발 워크플로의 변화

LLM을 API화하여 자사 시스템에 통합하는 수요가 급증했습니다. 로컬 LLM의 실용성이 한 번에 높아졌습니다.

로컬 LLM의 리스크와 주의점

장점만 이야기해서는 안 됩니다. 리스크도 제대로 이해해야 합니다.

출력의 안전성은 자기 책임

무제약 모델은 부적절한 내용도 생성할 가능성이 있습니다. 상용 서비스와 같은 안전 필터는 없습니다.

모델 품질에 편차가 있음

커뮤니티 모델은 배포처에 따라 품질이 크게 다릅니다. 신뢰할 수 있는 소스에서 입수하는 것이 중요합니다.

보안 업데이트가 없는 경우도

오픈소스 모델은 취약점이 발견되어도 즉시 수정되지 않을 수 있습니다.

하드웨어 요구사항이 높음

쾌적하게 동작시키려면 상당한 GPU가 필요합니다. 특히 13B 이상의 모델은 VRAM 16GB 이상을 권장합니다.

2025년판: 무제약 LLM 랭킹 Top10

실제로 테스트한 중에서 용도별로 추천하는 모델을 소개합니다.

평가 기준은 다음 4가지입니다:

- 자유도(Unrestricted성)

- 추론 능력(Reasoning / QA / Long Context)

- 창작 능력(스토리・롤플레이)

- 로컬 운용성(API화・양자화의 풍부함)

1위: Dolphin 3.0 (Llama 3.1 베이스・8B)

평가: 코딩・에이전트 용도 최강

Dolphin 3.0은 8B라는 경량성에도 불구하고 코딩과 함수 호출에 특화되어 있습니다.

실제로 사용해보니 함수 호출의 정확도가 높다는 점에 놀랐습니다. API 에이전트를 만든다면 이것이 첫 번째 선택지입니다.

- 특기 분야: Coding / Agent / Function Calling

- 로컬 운용성: 매우 높음 (8GB VRAM으로 동작)

- 참조: Hugging Face / Dolphin 3.0

2위: Nous Hermes 3 (Llama 3.2 베이스・8B)

평가: 장문 대화와 롤플레이에 최적

Hermes 3는 멀티턴 대화의 일관성이 뛰어납니다.

챗봇이나 롤플레이 용도라면 이것이 가장 안정적입니다. 캐릭터의 성격을 유지하면서 긴 대화를 이어갈 수 있습니다.

- 특기 분야: Dialogue / Roleplay / Agent

- 로컬 운용성: 높음

- 참조: Hugging Face Hermes 3

3위: Chronos-Hermes 13B v2

평가: 창작 활동에 특화된 문체 마스터

Chronos계는 문체 생성에 강하고, Hermes계는 지시 정합성이 높습니다. 이 하이브리드 모델은 소설이나 시나리오 생성에서 위력을 발휘합니다.

실제로 단편소설을 써보게 했는데, 문장의 흐름이 자연스럽고 읽기 쉬웠습니다.

- 특기 분야: 창작・스토리・장문 생성

- 로컬 운용성: 높음 (13B로 다루기 쉬움)

- 참조: Hugging Face Chronos-Hermes

4위: MythoMax-L2 13B

평가: RPG・노벨게임 제작자의 동반자

커뮤니티에서 뿌리 깊은 인기를 가진 창작 특화 모델입니다.

RPG의 대화 장면이나 노벨게임의 텍스트 생성에 사용하면 캐릭터의 개성이 확실히 드러납니다. 양자화 버전도 풍부해서 도입하기 쉽습니다.

- 특기 분야: Novel / RPG / Creative Writing

- 로컬 운용성: 높음 (GGUF / GPTQ 대응)

- 참조: Hugging Face MythoMax L2 13B

5위: LLaMA 3 다크 시리즈 (MoE 18.4B)

평가: 추론 능력 중시라면 이것

Llama3계의 비공식 MoE 파생 모델입니다. 추론 능력이 높고 장문 컨텍스트 보유가 강합니다.

다만 하드웨어 요구사항은 다소 높습니다. VRAM 24GB 이상을 권장합니다.

- 특기 분야: Long context / Reasoning

- 로컬 운용성: 중~높음

- 참조: Hugging Face Dark LLaMA

6위: Llama 2 Uncensored (7B~13B)

평가: 저사양 환경의 구세주

2024~2025년에도 꾸준히 사용되는 정번 모델입니다.

구형 GPU나 VRAM이 적은 환경에서도 동작합니다. 프로토타입이나 교육 용도에 최적입니다.

- 특기 분야: General / Prototyping

- 로컬 운용성: 매우 높음

- 참조: Hugging Face Llama2 Uncensored

7위: WizardLM Uncensored (Llama2 13B)

평가: 코드 생성에 강한 만능형

Wizard 계열의 무제약 버전입니다. 코드 생성에 강하고 범용 채팅에서도 안정적입니다.

Python 스크립트 생성이나 코드 리뷰에 사용하면 편리합니다.

- 특기 분야: Coding / General Chat

- 로컬 운용성: 높음

- 참조: Hugging Face WizardLM

8위: Dolphin 2.7 Mixtral 8×7B

평가: 고성능을 원한다면 이것

Dolphin계와 Mixtral MoE의 조합입니다. 추론과 창작 양면에서 강력합니다.

다만 GPU 요구사항과 모델 호환성은 확인이 필요합니다. VRAM 32GB 이상을 권장합니다.

- 특기 분야: Coding / 문서 생성

- 로컬 운용성: 중

- 참조: ollama Dolphin Mixtral

9위: GPT-4All (프레임워크 + 모델군)

평가: 초보자에게 최적인 올인원 환경

오프라인 LLM 환경으로 가장 보급된 프레임워크입니다.

GUI가 사용하기 쉽고 초보자도 바로 시작할 수 있습니다. 모델 자체는 경량으로 다루기 쉽습니다.

- 특기 분야: 일반 채팅 / 초보자용

- 로컬 운용성: 매우 높음

- 참조: GPT4All 공식

10위: Falcon LLM (TII)

평가: 연구용 안정 모델

중동 TII가 개발한 연구용 모델입니다. 로컬 추론이 비교적 안정적입니다.

영어 지시에서의 성능이 높고 학술 연구나 데이터 분석에 적합합니다.

- 특기 분야: QA / Analysis / Research

- 로컬 운용성: 중

- 참조: Falcon LLM 공식

모델 비교표: 한눈에 보는 특징 정리

| 모델 | 파라미터 규모 | 특징 | 특기 분야 | 로컬 운용성 |

|---|---|---|---|---|

| Dolphin 3.0 | 8B | 고속・경량・지시정합 | Coding / Agent | 매우 높음 |

| Nous Hermes 3 | 8B | 장문정합・롤플레이 | Dialogue / RP | 높음 |

| Chronos-Hermes v2 | 13B | 문체 + 지시 | 창작・스토리 | 높음 |

| MythoMax-L2 | 13B | 장문창작 | Novel / RPG | 높음 |

| LLaMA 3 Dark | 18.4B MoE | 추론강 | Long context | 중~높음 |

| Llama2 Uncensored | 7–13B | 경량 | General | 매우 높음 |

| WizardLM Uncensored | 13B | 코드강 | Coding | 높음 |

| Dolphin Mixtral | 8×7B MoE | 고성능 | Coding / 문서생성 | 중 |

| GPT-4All | 3B–7B | 오프라인특화 | 일반채팅 | 매우 높음 |

| Falcon LLM | 7B–40B | 연구용 | QA / Analysis | 중 |

로컬 LLM을 API화하여 실무에서 사용하는 방법

로컬 LLM을 본격적으로 사용하려면 API화는 피할 수 없습니다.

기본적인 워크플로

- Ollama / Llama.cpp로 LLM 서버 호스팅

- REST API로 공개 (예:

/api/generate) - 자사 앱이나 워크플로에 연결

실제로 해본 것: Ollama 구축 예시

# Ollama 설치

curl -fsSL https://ollama.com/install.sh | sh

# 모델 다운로드

ollama pull dolphin3.0

# 서버 시작 (기본값으로 localhost:11434)

ollama serve이것만으로 로컬 LLM API가 구동됩니다.

API 테스트의 중요성

로컬 LLM API를 운용하는 데 가장 중요한 것이 API 동작 테스트와 오류 내구성 확보입니다.

실제로 운용해보며 다음과 같은 문제에 여러 번 직면했습니다:

- 추론 지연이 예상보다 길다

- 타임아웃 오류가 빈발한다

- 모델 전환 시 응답 형식이 바뀐다

이런 것들을 사전에 검증해두지 않으면 운영에서 큰 문제가 됩니다.

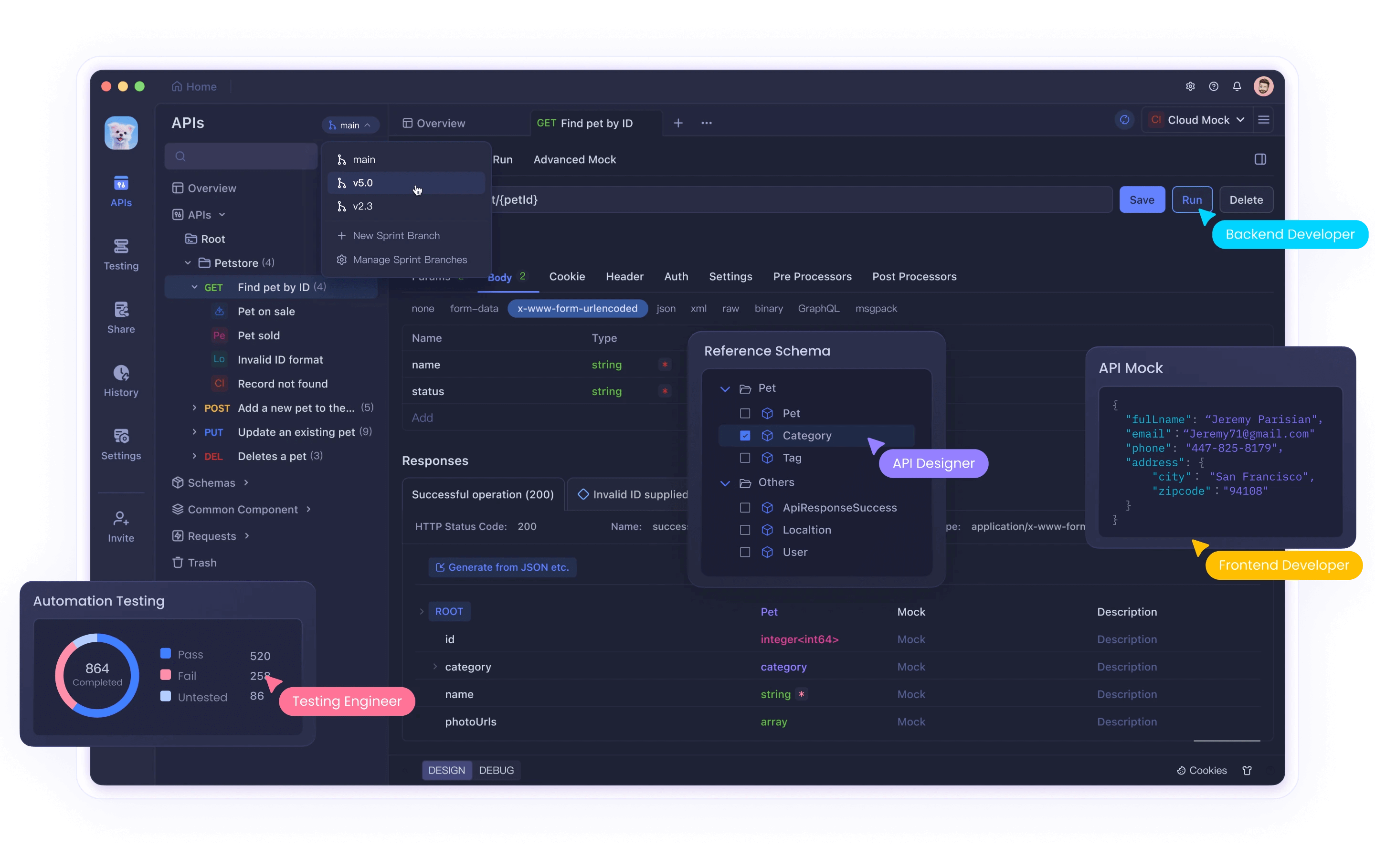

Apidog로 로컬 LLM API 관리하기

수동으로 curl을 실행해서 테스트하는 것은 비효율적입니다.

Apidog를 사용하면 로컬 LLM API의 테스트와 관리가 획기적으로 편해집니다.

실제 사용법:

- 엔드포인트 검증: Ollama / LM Studio / Text Generation WebUI의 API 등록

- 자동 테스트: 추론 지연, 오류 응답, 타임아웃 자동 체크

- 모델 전환 시 차이 확인: 요청 사양 변경 감지

- 외부 API와의 통합 관리: OpenAI / Claude / Gemini API와 일원 관리

특히 편리한 것이 로컬 LLM API, 외부 LLM API, 자사 백엔드 API를 하나의 워크스페이스에서 관리할 수 있다는 점입니다.

이것은 광고가 아니라 실무 플로우로서 자연스러운 선택지라고 생각합니다.

실무에서 사용할 수 있는 운용 베스트 프랙티스

1. 추론 지연 측정과 최적화

로컬 LLM은 클라우드 API보다 느린 경우가 많습니다.

대책:

- 양자화 모델(GGUF Q4_K_M 등) 사용

- 배치 처리로 처리량 향상

- GPU 메모리 최대한 활용

2. 오류 응답의 재시도 제어

타임아웃이나 메모리 부족 오류는 피할 수 없습니다.

대책:

- 재시도 로직 구현

- 폴백 대상(외부 API) 준비

- 오류 로그 상세 기록

3. 모델 전환 시 동작 차이 관리

모델을 변경하면 응답 형식이 바뀔 수 있습니다.

대책:

- API 스키마 명확히 정의

- 테스트 케이스 자동 실행

- 버전 관리 철저히

4. 프론트・백엔드와의 통합

로컬 LLM API를 기존 시스템에 통합할 때는 스키마 정리가 중요합니다.

대책:

- OpenAPI 사양서 작성

- 목 서버로 선행 개발

- 통합 테스트 자동화

무제약 LLM의 향후 트렌드

1. MoE의 소형 최적화

Mixtral, Llama3 MoE의 영향으로 소형 GPU에서도 고성능을 얻을 수 있는 미니 MoE가 주류가 될 것입니다.

2. Agentic / Function Calling의 표준화

Hermes계 등이 API 연계에 강해짐으로써 로컬 LLM도 "에이전트 운용"이 일반화될 것입니다.

3. 로컬 LLM × API 테스트의 중요성 증대

기업 레벨의 운용에서는 API의 안정성(특히 자사 내 추론 API)을 어떻게 만들지가 중요해질 것입니다.

4. 프라이빗 파인튜닝의 보급

클라우드에 데이터를 보내지 않는 요구사항으로 인해 LoRA / QLoRA를 이용한 내부 파인튜닝이 당연해질 것입니다.

정리: 로컬 LLM은 실용 레벨에 도달했다

2025년은 "로컬 LLM의 완성도가 한 번에 클라우드와 나란히 선" 해입니다.

무제약 모델의 선택지는 지금까지 이상으로 넓어지고, 용도별로 최적해가 존재합니다.

용도별 추천 모델:

- 코딩: WizardLM / Dolphin 3.0

- 창작: MythoMax / Chronos-Hermes

- 일반 대화・롤플레이: Nous Hermes 3

- 저사양: Llama2 Uncensored / GPT-4All

그리고 실무자에게는 LLM을 API로 다루고, 테스트하고, 운용성을 확보하는 것이 지금까지 이상으로 중요해집니다.

그를 위한 방법으로 Apidog를 포함한 API 도구군을 활용하는 것은 개발자에게 자연스럽고 실용적인 선택입니다.

로컬 LLM의 세계는 상상 이상으로 흥미롭습니다. 꼭 실제로 시도해보시기 바랍니다.