행정법 LLM 사전학습 및 Instruction Tuning 데이터(Training)는

전체 기준 약 4만 개 정도였다.

이를 GPT-4o mini Batch API 기준으로 처리했을 때, 비용은 대략 1~2만 원 정도였다.

한 사람이 8만개의 데이터를 처리하는것이 불가하다고 판단했고, 따라서 한 사람당 1만개씩 데이터를 처리하기로 했다.

RAG와의 결합을 고려한 설계

최근 RAG에 관련한 회의를 팀원들과 했다.

우리가 사용할 데이터 구조를 보면,

위 그림과 같이 원천데이터와 라벨링 데이터로 나뉘어져 있었다.

처음에는 라벨링 데이터만 사용하여 GPT-4o-mini를 ‘가공 도구’로 사용하여, 전처리를 했었었다. 즉, 데이터 가공 에이전트로 사용했다.

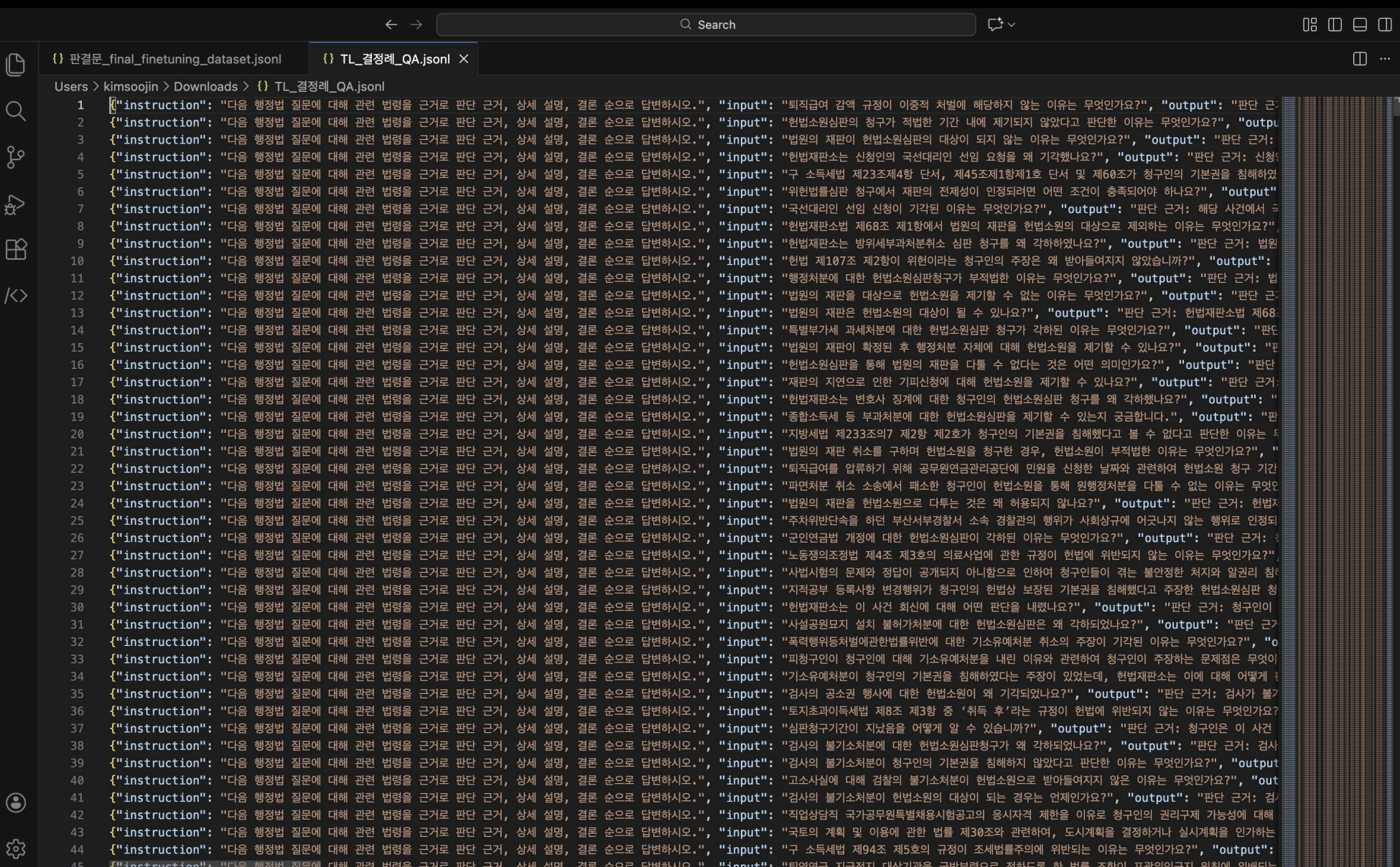

위 그림이 2만개의 데이터를 전처리한 것이다.

2만개의 데이터를 전처리하고 나서 보니, 결론만 있고 왜 그런 결론이 나왔는지가 빠져 있었으며, 어떤 근거를 찾아 어떻게 사고해야 하는지의 '사고의 사슬(Chain of Thought)' 이식 구조에 맞춰져 있지 않았다.

이 데이터를 그대로 학습시키면, AI는 “답을 외우는 모델”이 될 수밖에 없었다고 판단을 하여, 다시 처음으로 돌아갔다.

여기서 GPT-4o-mini를 사용한 이유는 GPT-OSS를 사용하려고 시도해보았었는데, 이 모델을 다운을 받으면 코랩 용량이 부족하여, 데이터 전처리를 코랩환경에서 할 수가 없었다. 따라서 우리는 GPT-4o-mini를 사용했다.

앞으로의 우리 계획은 GPT-4o-mini에게, 원천데이터와 라벨링 데이터를 합쳐놓은 json 파일을 [판단 근거 → 상세 설명 → 최종 결론] 이러한 형태로 데이터를 바꿔놓은 것이다.

모델링 부분은 초기에는 비교적 큰 규모의 모델을 전제로 학습을 설계하고 있었다.

하지만 최근 회의를 거치면서, 모델 크기를 대폭 줄이고 더 작은 모델.. 아마 Qwen_3b 모델을 사용하는 방향으로 계획을 수정했다.