프로그래머스 2021 국민대 여름방학 인공지능 과정 6주차 Day3 TIL

🔍시퀀스 투 시퀀스 모델

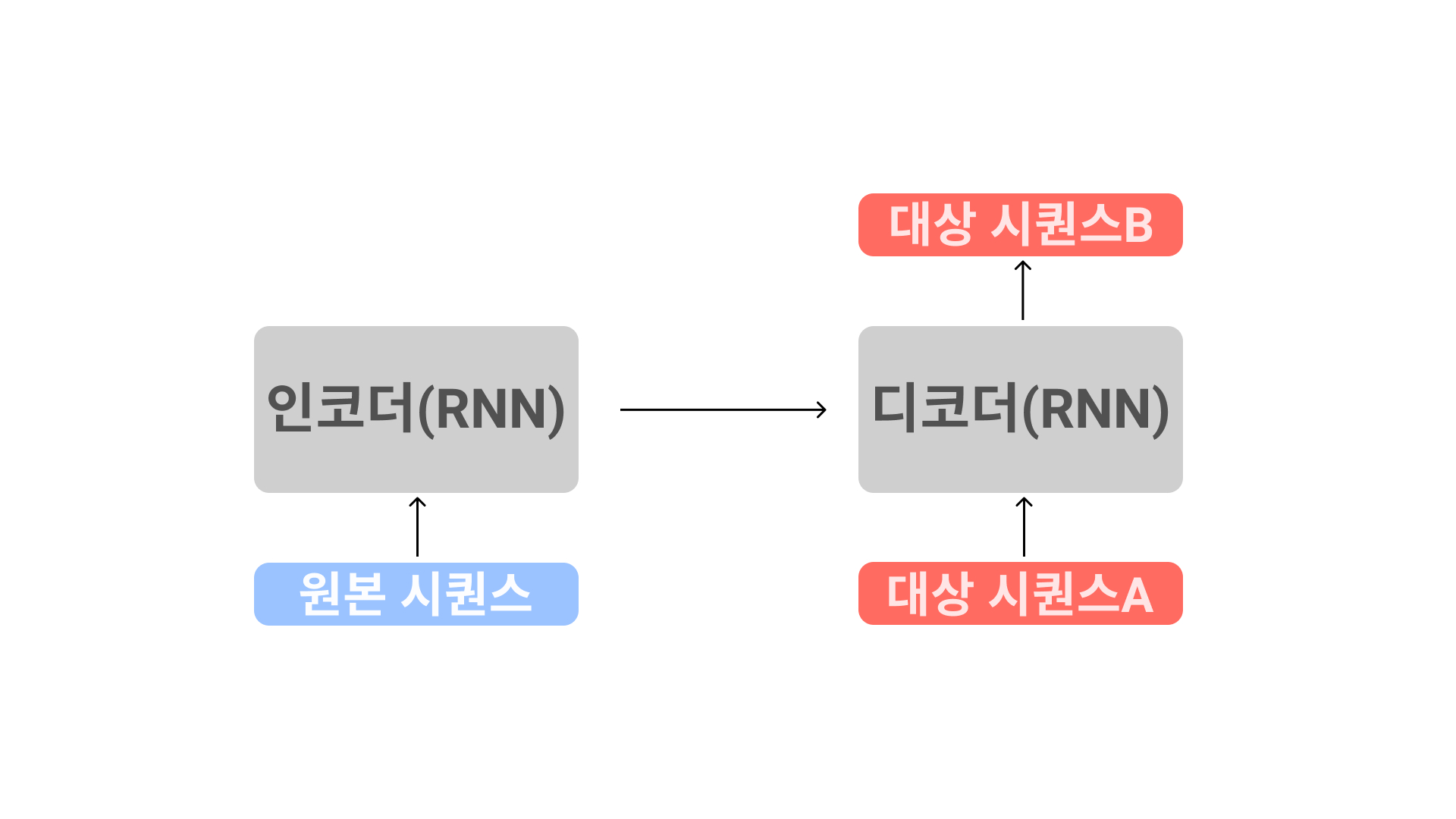

입력된 시퀀스로부터 다른 도메인의 시퀀스를 출력하는 다양한 분야에서 사용되는 모델

순환신경망을 사용하여 문장을 학습

📌모델 구성

인코더

시퀀스를 입력받고 이를 하나의 벡터로 생성 컨텍스트 벡터

컨텍스트 벡터를 디코더로 전송

순환 신경망을 이용해 입력 토큰들을 순차적으로 읽음

stacked LSTM으로 구성

→ 각 레이어의 출력값이 다음 레이어의 입력값

입력 시퀀스를 역전된 순서로 처리함

디코더

전달 받은 컨텍스트 벡터와 입력값을 모두 반영하여 번역된 단어로 하나씩 순차 출력

stacked LSTM으로 구성, hidden state가 인코더에서 생성한 컨텍스트 벡터로 초기화 됨

→ 입력값들의 문맥을 사용해 출력값 생성

- 디코더 초기화 후,

<EOS>토큰을 첫 번째 LSTM 레이어로 입력함 - 여러 레이어를 거친 후 단어 출력

- 이 단어가 또 첫 번째 LSTM 레이어의 입력값이 됨

- 이걸 반복~

모델 입력 원본 시퀀스와 대상 시퀀스A 쌍

모델 출력 대상 시퀀스B

코드 AI factory

참고 https://wikidocs.net/24996

참고 https://needjarvis.tistory.com/214

참고 https://everyday-log.tistory.com/entry/%EC%8B%9C%ED%80%80%EC%8A%A4-%ED%88%AC-%EC%8B%9C%ED%80%80%EC%8A%A4seq2seq-%EB%AA%A8%EB%8D%B8

😵😵😩😵😵😩😵😩😩🥵😵😵😩🥵🥵😵😩😩📧😵😩😩🥵