1. random variable, expectation, standard deviation, variance, covariance, correlation?

Random variable(확률변수)

무작위로 값을 가지는 변수를 말합니다. 예를 들어, 주사위를 굴린 결과나 동전을 던졌을 때 앞면이 나오는지 뒷면이 나오는지와 같은 결과들이 확률변수입니다. 이들 값은 예측이 불가능하고, 어떤 확률분포를 따르며 확률적인 값으로 나타납니다.

Expectation(기대값)

확률변수의 평균값을 말합니다. 이는 해당 확률변수의 모든 값들을 가중평균하여 계산됩니다. 기대값은 해당 확률변수의 특징을 요약하고, 이를 통해 확률분포를 파악하고 예측할 수 있습니다.

Variance(분산)

확률변수의 분포가 얼마나 넓게 퍼져 있는지를 나타내는 지표입니다. 분산은 확률변수와 그 기대값 사이의 차이의 제곱의 평균으로 계산됩니다. 확률변수의 분포가 넓게 퍼져 있을수록 분산 값은 더 크게 됩니다.

Standard deviation(표준편차)

분산의 제곱근 값으로 계산되며, 확률변수의 분포가 평균으로부터 얼마나 떨어져 있는지를 나타내는 지표입니다.

Covariance(공분산)

두 개 이상의 확률변수가 서로 어떤 관계를 가지고 있는지를 나타내는 지표입니다. 공분산은 두 변수 간의 편차의 곱의 평균으로 계산됩니다. 두 변수가 양의 공분산을 가지면 함께 증가하고, 음의 공분산을 가지면 하나가 증가하면 다른 하나는 감소합니다.

Correlation(상관관계)

두 변수 사이의 선형적 관계를 나타내는 지표입니다. 상관계수는 공분산을 각 변수의 표준편차로 나눈 값으로 계산됩니다. 상관계수는 -1에서 1 사이의 값을 가지며, 값이 1에 가까울수록 두 변수는 양의 선형관계를 가지며, 값이 -1에 가까울수록 음의 선형관계를 가집니다. 상관관계는 두 변수 사이의 인과관계를 나타내지 않습니다.

2. probability distribution, Marginal Probability Distribution, Joint Probability Distribution

Probability Distribution(확률 분포)

어떤 확률 변수(random variable)가 갖는 값들에 대해 그 값이 나타날 확률을 나타내는 함수입니다. 이 확률 변수가 취할 수 있는 값들의 집합을 해당 분포의 지원(support)이라고 부릅니다. 이 분포는 이산형(discrete) 또는 연속형(continuous)일 수 있습니다.

Marginal Probability Distribution(주변 확률 분포)

조인트(joint) 분포에서 어떤 하나의 확률 변수의 분포를 구하는 것입니다. 즉, 다른 변수들에 대한 정보를 버리고 하나의 변수만 고려하여 그 변수의 확률 분포를 계산합니다.

Joint Probability Distribution(결합 확률 분포)

두 개 이상의 확률 변수가 함께 가질 수 있는 모든 값들에 대해 그 값이 나타날 확률을 나타내는 함수입니다. 즉, 여러 개의 확률 변수들이 있을 때, 그들이 모두 발생할 확률 분포를 나타냅니다. 이것은 이산형(discrete) 또는 연속형(continuous)일 수 있습니다.

3. 확률밀도함수, 확률분포함수

확률밀도함수와 확률분포함수는 확률론에서 중요한 개념으로, 어떤 확률변수가 특정한 값에서 얼마나 발생할 확률을 나타내는 함수입니다.

확률밀도함수 (Probability Density Function, PDF)

확률밀도함수는 연속확률변수에서 사용되며, 확률밀도함수의 값은 특정 구간에서의 확률밀도를 나타내며, 이 구간의 면적이 확률이 됩니다. 수학적으로는 다음과 같이 정의됩니다.

확률밀도함수 f(x)는 다음과 같은 성질을 만족합니다.

- f(x)는 x축 위에 위치한 곡선입니다.

- 곡선 아래의 면적은 1입니다. 즉, ∫f(x)dx = 1 입니다.

- 구간 [a, b]에서의 확률은 f(x)와 x축 그리고 x = a, x = b로 둘러싸인 영역의 면적입니다.

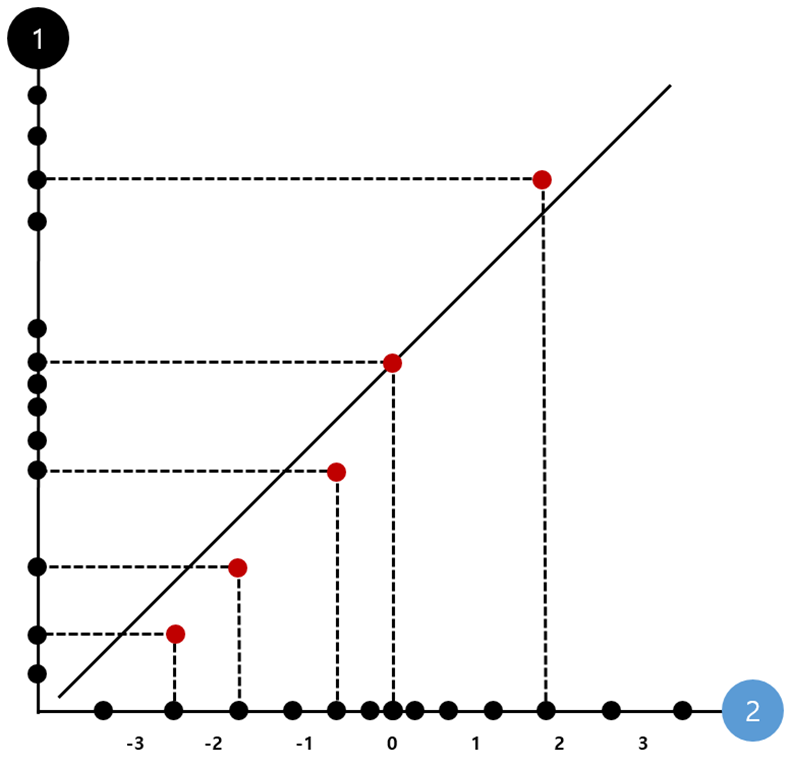

확률분포함수 (Probability Distribution Function, CDF)

확률분포함수는 연속확률변수와 이산확률변수 모두에서 사용됩니다. 확률분포함수는 누적분포함수(Cumulative Distribution Function, CDF)라고도 하며, 확률밀도함수를 적분한 함수입니다. 수학적으로는 다음과 같이 정의됩니다.

- F(x)는 x 이하의 확률을 나타냅니다. 즉, P(X ≤ x) = F(x)입니다.

- F(x)는 단조증가합니다. 즉, x1 ≤ x2이면 F(x1) ≤ F(x2)입니다.

- F(x)는 우극한이 1이고 좌극한이 0입니다. 즉, limx→∞ F(x) = 1, limx→-∞ F(x) = 0입니다.

확률분포함수는 확률밀도함수를 이용하여 계산할 수 있습니다. 즉, F(x) = ∫f(t)dt (-∞ < t ≤ x)입니다. 이때, 확률밀도함수가 정의되지 않는 이산확률변수의 경우, 확률분포함수는 이산확률변수의 누적확률분포함수입니다.

따라서 확률밀도함수와 확률분포함수는 모두 확률론에서

4. bayes' theorem, independaence, conditional independence

베이즈 정리 (Bayes' theorem)

베이즈 정리는 조건부 확률을 이용하여 사건 간의 관계를 설명하는 공식입니다. A와 B를 두 사건이라고 할 때, 다음과 같이 정의됩니다.

P(A|B) = P(B|A) * P(A) / P(B)

위 식에서 P(A)는 사건 A의 사전확률(prior probability), P(B|A)는 사건 A가 일어날 때 B의 조건부확률(conditional probability), P(B)는 사건 B의 주변확률(marginal probability), P(A|B)는 사건 B가 일어났을 때 A의 조건부확률입니다.

이 공식은 관측된 결과를 바탕으로 어떤 가설이 옳을 확률을 업데이트하는데 사용됩니다. 즉, P(A|B)는 B라는 결과가 관측되었을 때, A라는 가설이 옳을 확률을 나타내게 됩니다.

독립성 (Independence)

독립성은 두 사건 A와 B가 서로 영향을 주지 않는 상황을 의미합니다. 수학적으로는 다음과 같이 정의됩니다.

P(A ∩ B) = P(A) * P(B)

위 식에서 P(A ∩ B)는 사건 A와 B가 동시에 일어날 확률, P(A)와 P(B)는 각각 사건 A와 B가 일어날 확률입니다.

만약 P(A|B) = P(A)이면, 즉 B가 주어졌을 때 A의 확률이 B가 없을 때의 확률과 같다면 A와 B는 서로 독립입니다.

조건부 독립성 (Conditional Independence)

조건부 독립성은 어떤 사건 C가 주어졌을 때, 두 사건 A와 B가 서로 독립인 상황을 의미합니다. 수학적으로는 다음과 같이 정의됩니다.

P(A ∩ B | C) = P(A | C) * P(B | C)

위 식에서 P(A ∩ B | C)는 사건 C가 주어졌을 때, A와 B가 동시에 일어날 확률, P(A | C)와 P(B | C)는 각각 사건 C가 주어졌을 때, A와 B가 일어날 확률입니다.

조건부 독립성은 A와 B가 주어졌을 때 독립적이지만, C가 주어졌을 때에는 서로 영향을 끼칠 수 있습니다. 이러한 개념은 베이즈 정리와 관련하여 매우 중요합니다.

예를 들어, 두 확률변수 X와 Y가 있을 때, X와 Y가 독립이지만, Z에 따라 X와 Y가 영향을 끼칠 수 있습니다. 이때 X와 Y는 Z가 주어졌을 때 조건부 독립성을 가집니다.

조건부 독립성은 많은 확률론 문제에서 유용하게 사용됩니다. 예를 들어, 의학적 진단에서는 여러 증상이 함께 나타날 확률을 계산하는데 사용될 수 있습니다. 또한, 자연어 처리 분야에서는 문장 내에서 단어들 간의 독립성과 조건부 독립성을 이용하여 모델을 개발할 수 있습니다.

5. 대상의 probability distribution을 근사한다는 것은?

대상의 확률 분포를 근사한다는 것은, 주어진 데이터를 기반으로 대상의 확률 분포를 추정하는 것을 말합니다. 이를 확률 분포 추정(probability distribution estimation)이라고 합니다.

확률 분포 추정은 통계학, 머신 러닝, 딥 러닝 등 다양한 분야에서 중요한 기술입니다. 대상의 확률 분포를 정확하게 추정하면, 해당 대상에 대한 예측 및 분석을 보다 정확하게 할 수 있습니다.

일반적으로 대상의 확률 분포를 근사하는 방법은 두 가지로 나눌 수 있습니다.

1. 모수적 방법 (Parametric methods)

• 모수적 방법은 데이터를 특정 확률 분포 모델로 가정한 후, 모델의 파라미터(parameter)를 추정하는 방법입니다.

• 대표적으로 가우시안 분포, 베르누이 분포, 포아송 분포 등이 있습니다.

2. 비모수적 방법 (Nonparametric methods)

• 비모수적 방법은 특정 확률 분포 모델을 가정하지 않고, 데이터로부터 분포를 직접 추정하는 방법입니다.

• 대표적으로 커널 밀도 추정(kernel density estimation), 최소 제곱 추정(nonlinear least squares estimation) 등이 있습니다.

또한, 최근에는 딥 러닝 모델을 사용하여 확률 분포를 근사하는 방법도 많이 연구되고 있습니다. 이러한 방법은 대규모 데이터셋에 대해 높은 성능을 보이지만, 모수적 방법과는 달리 학습 데이터가 많이 필요하고, 계산량이 많은 단점이 있습니다.

모수적, 비모수적 방법 종류

-

모수적 방법 (Parametric methods)

• 정규분포(Normal distribution) :

정규분포는 수집된 데이터들의 평균 근처에 값이 모여 있는 연속 확률분포입니다.

정규분포는 가장 잘 알려진 확률분포 중 하나로, 대부분의 경우 데이터가 정규분포를 따른다는 가정 하에 모델링을 합니다. 정규분포의 경우 평균과 분산 두 개의 파라미터로 모델링이 가능합니다.

• 베르누이 분포(Bernoulli distribution) : 베르누이 분포는 이항분포에서 시행횟수가 1인 경우로, 이진 데이터(binary data)를 다룰 때 사용됩니다. 베르누이 분포의 경우 확률 p 하나의 파라미터만 사용하여 모델링합니다.

• 포아송 분포(Poisson distribution) : 포아송 분포는 단위 시간 또는 공간에서 일어날 사건의 개수를 모델링할 때 사용됩니다. 예를 들어, 단위 시간당 도착하는 차량의 수, 단위 면적당 벌레의 수 등을 포아송 분포로 모델링합니다. 포아송 분포의 경우 사건의 발생 빈도를 나타내는 람다(lambda) 하나의 파라미터만 사용하여 모델링합니다. -

비모수적 방법 (Nonparametric methods)

• 커널 밀도 추정(Kernel density estimation) : 커널 밀도 추정은 주어진 데이터의 분포를 추정하는 방법 중 하나입니다. 데이터 포인트들을 중심으로 하는 함수인 커널(kernel)을 이용하여 밀도를 추정합니다. 이 방법은 히스토그램과 유사하지만, 더 부드러운 분포 추정을 가능하게 합니다.

• K-최근접 이웃(K-nearest neighbor) : K-최근접 이웃은 주어진 데이터에서 가장 가까운 K개의 이웃을 찾아 이들의 평균을 구하는 방법입니다. 이 방법은 비모수적 방법 중 가장 간단한 방법 중 하나이며, 주어진 데이터의 분포를 추정하기 위해 사용됩니다.

• 최소 제곱 추정(Nonlinear least squares estimation) : 최소 제곱 추정은 비모수적 방법 중 하나로, 임의의 함수를 사용하여 데이터와의 차이를 최소화하는 파라미터를 찾습니다. 이 방법은 비선형 모델링에 적용될 수 있습니다.

6. p-value, f-value, t-value

p-value, f-value, t-value는 모두 통계학에서 가설 검정(hypothesis testing)을 할 때 사용되는 값입니다.

1. p-value

p-value는 가설 검정에서 사용되는 중요한 개념 중 하나입니다. p-value는 관측된 데이터에서 더 극단적인(extreme) 결과가 나올 확률을 나타내는 값입니다. p-value 값은 0과 1 사이의 값을 가지며, 값이 작을수록 귀무가설(null hypothesis)을 기각하는 증거가 더 강해집니다.

예를 들어, A와 B 두 그룹의 평균값이 같은지 검정하는 경우, 귀무가설은 "A와 B 두 그룹의 평균값이 같다"입니다. 이 경우, p-value가 작으면 귀무가설을 기각할 증거가 더 강해진다는 것을 의미합니다.

2. t-value

t-value는 t-test에서 사용되는 값입니다. t-test는 두 집단의 평균값이 같은지 검정하는 방법입니다. t-value는 두 집단의 평균값 차이가 표준오차(standard error)에 비해 얼마나 큰지를 나타내는 값입니다. t-value는 계산된 t-통계량(t-statistic)으로, t-value가 크면 귀무가설을 기각할 가능성이 더 커집니다.

3. f-value

f-value는 분산분석(analysis of variance, ANOVA)에서 사용되는 값입니다. 분산분석은 여러 그룹 간의 평균값 차이가 있는지를 검정하는 방법입니다. f-value는 분산비(variance ratio)를 나타내는 값으로, 각 그룹 내의 분산과 그룹 간의 분산의 비율을 나타냅니다. f-value가 크면 그룹 간의 평균값 차이가 크다는 것을 의미하며, 귀무가설을 기각할 가능성이 더 커집니다.

집단간 평균 차이 유무를 검정할 때

1. 먼저 shaprio를 통해 정규성 검정을 한다.

-> 정규성 만족하지 않으면 kruskal 테스트 진행한다.

2. 정규성이 만족했다면, 다음으로 levene을 통해 등분산성 검정을 한다.

-> 등분산성 만족하지 않으면 welch_anova 진행한다.

3. 정규성과 등분산성을 모두 충족했으면 oneway anova 로 집단간 평균 차이 유무를 검정한다.

데이터의 특성에 따라 적절한 검정 방법을 선택하는 것이 중요합니다. 이를 위해, 가설 검정 전에 데이터의 분포와 분산 구조를 시각화하여 판단하는 것이 좋습니다.