CS231n 4강 Backpropagation and NN part1

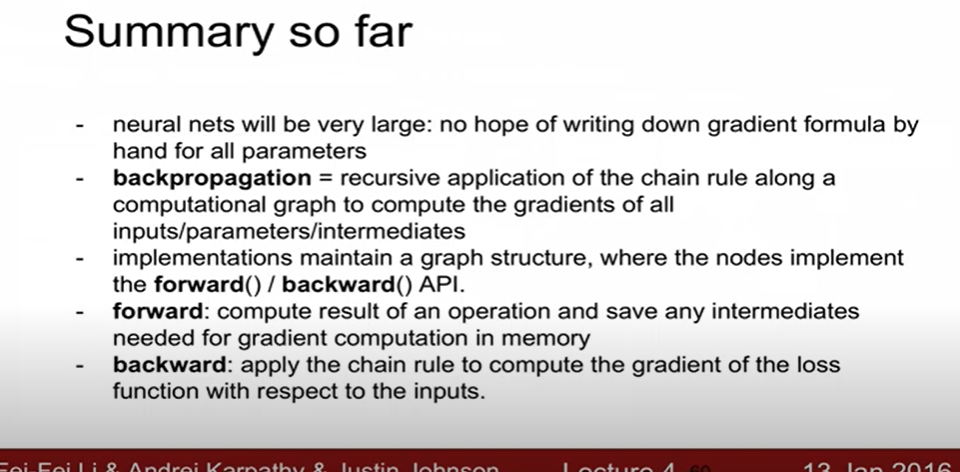

Backpropagation

(chain-rule) 즉, local gradient는 forward할때 global gradient는 backward할때 구한다.

backward 할때 chain이 일어난다.

forward path일때 메모리를 채워놨다가 backward path일때 메모리의 내용을 소진한다고 볼 수 있다.

Q1) what is the size of the jacobian matrix?

4096x4096.

Q2) what dose it look like? 단위행렬과 같은 모습의 형태

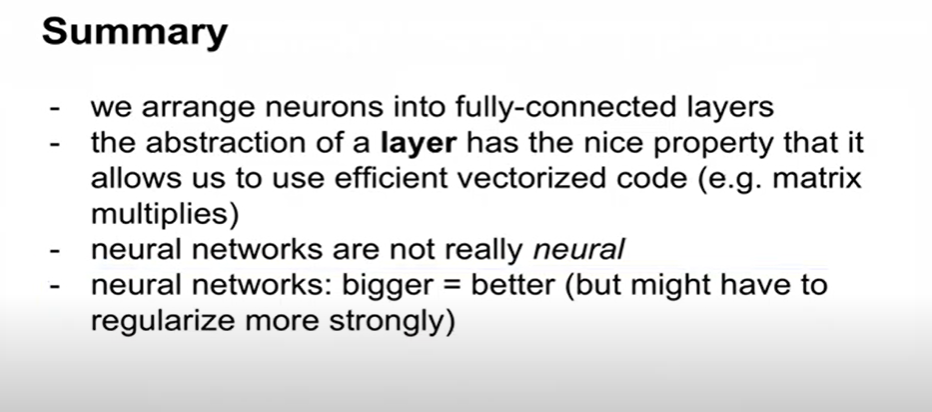

NN

기존의 score function식에서 W와x에 대한 내용 변경.

non-parameter approach의 대표적인 예는 nearest-neighbor

하나의 클래스에 하나의 classifier

parameter approach 예는 NN

하나의 클래스에 대해 여러개의 classifier

activation function 주로 ReLU를 사용

모든 노드들이 연결되는 것은 Fully connected layer.

hidden neurons의 #가 증가할 수록 capacity즉,분류성능이 높아진다.

but 뉴런넷의 사이즈가 regularization의 역할은 아님.

regularization을 위해서는 regularization strenght가 필요하다.

regularization이 잘된다는 전제하에 neural net이 클수록 더 better하다고 정리할 수 있다.