1.10 주요 부등식

Thm 1.10.1

k≤m, E∣x∣m<∞→E∣x∣k<∞

Thm 1.10.2 마르코프 부등식

μ(X): 음수가 아닌 확률변수 X의 함수

E[μ(x)]<∞

=> ∀c>0, P(μ(x)≥c)≤cE[μ(x)]

(pf)

E[μ(x)]=∫−∞∞μ(x)f(x)dx=∫Aμ(x)f(x)dx+∫Acμ(x)f(x)dx

(A={x, μ(x)≥c})

≥∫Acf(x)dx+∫Acμ(x)f(x)dx

≥c ∫Af(x)dx -> P(x∈A)=cP(μ(x)≥c)

위 마르코프 부등식은, 확률번수의 함수가 어떤 양수 이상일 확률에 대한 상한값을 보여주는 부등식이다.

따라서 아래와 같은 예제도 성립한다.

ex) 어떤 은행이 고객이 도착한 후 평균 10분만 기다린다고 홍보하고 있을 대, 이 은행의 어떤 고객이 1시간 이상 기다릴 확률을 구하여라

E(X)=10

P(X≥60)≤6010=0.167

==> 고객이 1시간 이상 기다릴 확률은 16.7%를 넘지 않는다.

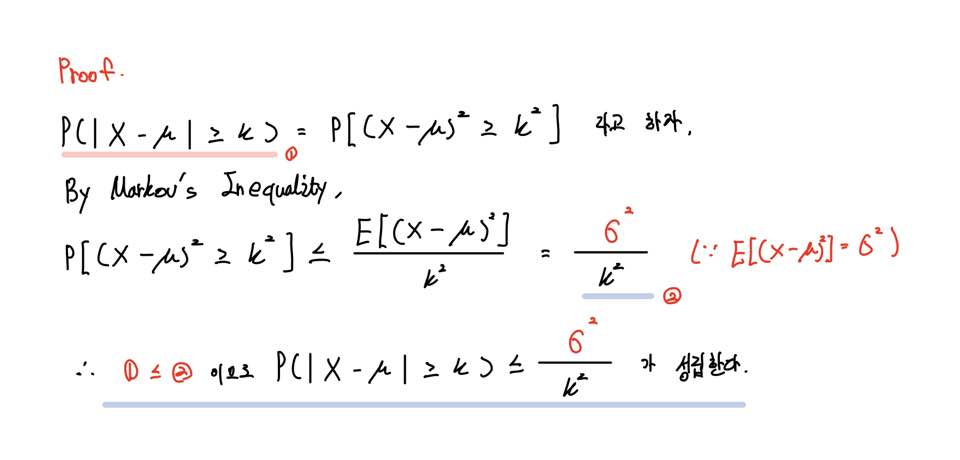

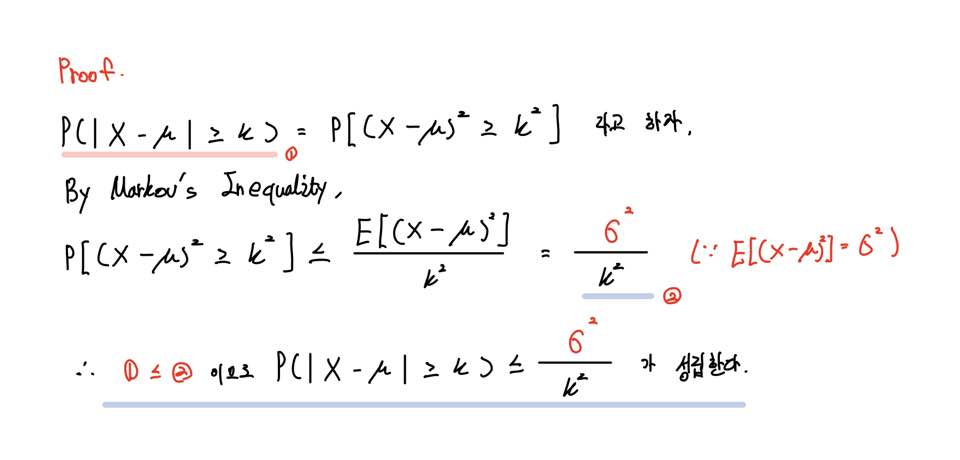

Thm 1.10.3 체비셰프 부등식

P[∣x−μ∣≥kσ]≤k21,∀k>0

증명은 마르코프와 유사하다. 아래와 같이 증명이 가능하다. (마르코프 부등식의 특수한 형태이기 때문)

(출처: https://datalabbit.tistory.com/26)

Def. 1.10.1 볼록함수(아래로 볼록 = convex function)

ϕ: func on (a,b), −∞≤a<b≤infin

=> ϕ: convex if ∀x,y in (a,b), 0<r<1

ϕ[rx+(1−r)y]≤rϕ(x)+(1−r)ϕ(y)

*γx+(1−γ)y: convex combination -> 볼록 결합으로 x와 y 사이의 값을 갖도록 만듦.

위와 반대된 경우를 concave라고 한다.(오목함수)

Thm 1.10.4 convex 함수의 성질

(a) ϕ: convex <=> ϕ′(x)≤ϕ′(y), (∀a<x<y<b)

(b) ϕ: strictly convex <=> ϕ′(x)<ϕ′(y), (∀a<x<y<b)

(c) ϕ: convex <=> ϕ′′(x)>0, (a<x<b)

Thm 1.10.5 Jensen's 부등식(convex function의 성질을 이용)

ϕ: convex on open interval U

X: r.v. with support Sx \in U

E(X) < ∞,

=> ϕ[E(X)]≤E[ϕ(X)]

(pf)

by the Taylor expansion of ϕ(Xx) about x=μ up to the linear term + remainder term

ϕ(x)=ϕ(μ)+ϕ′(μ)(x−μ)+21ϕ′′(ξ)(x−μ)2

그런데 위 식에서 21ϕ′′(ξ)(x−μ)2은 항상 0보다 크므로(convex function의 3번째 성질: 2계도 함수는 항상 양수) 아래와 같은 식이 성립한다.

ϕ(x)≥ϕ(μ)+ϕ′(μ)(X−μ)

=> E[ϕ(x)]≥ϕ[E(x)]

CH2. 다변량분포

2.1 이변량 분포

Def2.1.1.

X1,X2두개의 확률 변수가 동시에 존재한다.

X1(c)=x1

X2(c)=x2

X=(x1x2)T

* cdf of X = (X1,X2)T

FX1,X2(X1,X2)=P(X1≤x1,X2≤x2)

* join pmf of X(discrete)

Px1,x3(x1,x2)=P(X1=x1,X2=x2)

* joint pdf of X

결합확률분포는 결합누적분포를 2번 미분(x1, x2에 대하여)해준 것과 같다.

FX1,X2(x1,x2)=∫−∞x2∫−∞x1fx1,x2(w1,w2)dw1dw2

--> ∂x1∂x2∂2Fx1,x2(x1,x2)=fx1,x2(x1,x2)

* marginal cdf

아래와 같이 한 변수의 누적분포함수에 대해 극한값을 취해주면 나머지 변수의 marginal cdf가 나온다.

FX1(x1)=limx2→∞Fx1,x2(x1,x2) -> marginal cdf of X1

pdf의 경우에도 마찬가지이다.

PX1(x1)=∑x2=−∞∞Px1,x2(x1,x2): marginal pmf of X1

ex.2.1.1

f(x1,x2)=(x1+x2)∗I(0<x2<1,0<x2<1):jpdf

(1) P(X1≤21)

= ∫021fx1(x1)dx2

(이렇게 다른 변수의 적분으로 계산하여도 되고, 모든 범위에 걸친 결합확률분포 적분값으로 보아도 된다.

(2) P(X1+X2≤1)

= ∫01∫01−x2(x1+x2)dx1dx2

=31

E[g(X1,X2)] = {∑x1∑x2g(x1,x2)Px1,x2(x1,x2),∫∫g(x1,x2)fx1,x2(x1,x2)dx1dx2,

Thm 2.1.1

E[k1g1(X1,X2)+k2g2(X1,X2)]=k1E[g1(X1,X2)]+k2E[g2(X1,X2)]

Def 2변수 확률분포함수의 mgf

X=(x1,x2)T

Mx(t):=Mx1,x2(t1,t2) <- t=(t1,t2)T

= E[et1x1+t2x2]=E[etTx]

Mx1,x2(t1,0)=?

Mx1,x2(t1,t2)=∫∫et1x1+t2x2f(x1,x2)dx1dx2

Mx1,x2(t1,0)=∫∫et1x1f(x1,x2)dx1dx2

=etx1(∫f(x1,x2)dx2)dx1

=> ∫et1x1fx1(x1)dx1

=> E[et1x1]=mgf of X1

ex.2.1.3

f(x,y)=e−yI(0<x<y<∞)

MX,Y(t1,t2)=∫0∞∫x∞et1x+t2ye−ydydx

=(1−t1−t2)(1−t2)1

MX,Y(t1,0) = (1−t1)−1 =mgf of X

MX,Y(0,t2) = (1−t2)−1 =mgf of Y