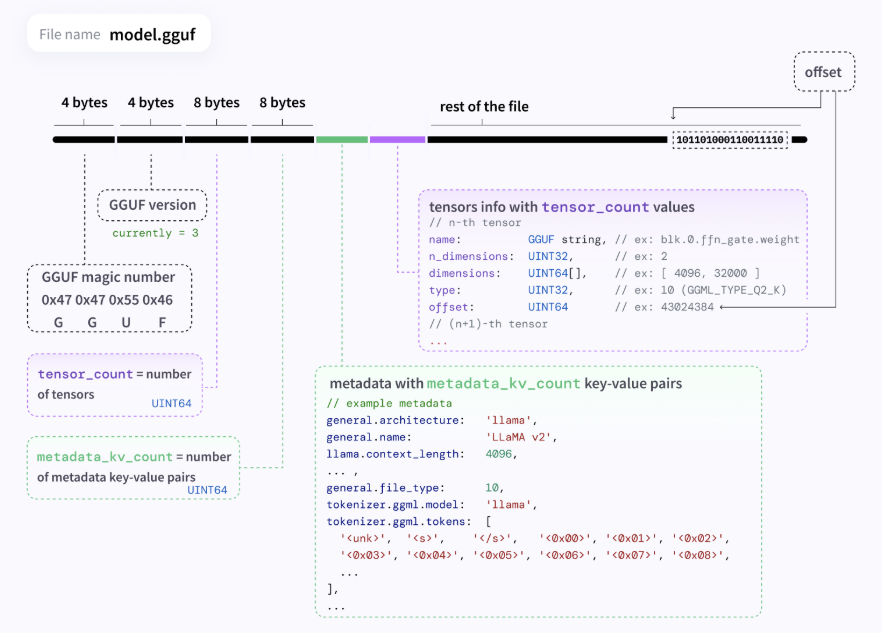

0. gguf(Georgi Gerganov Unified Format)란?

- 딥러닝 모델을 효율적으로 저장하고 배포하기 위한 새로운 파일 형식

(Georgi Gerganov가 만들어 낸 형식이라 gguf) - 특정 프레임워크/라이브러리에 종속되지 않음 (호환성), 효율적으로 저장 및 로드할 수 있음

Ollama는 자체적으로 제공하는 모델 외에도 gguf 파일을 import해서 사용할 수 있음, 따라서 gguf 파일만 있다면 어떤 LLM이던 Ollama로 사용 가능!

1. LLM을 gguf로 만들기

- 허깅페이스에서 제공하는 KISTI의 KONI를 gguf로 만들어 봄!

(1) llama.cpp로 gguf 변환하기

(추후 추가 예정)

(2) 허깅페이스 gguf 변환 repo 활용하기

- 허깅페이스 gguf 변환 repo

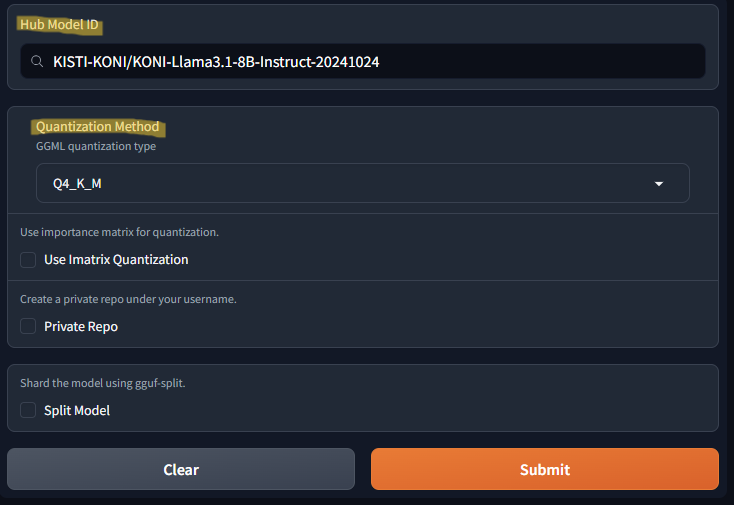

- 변환할 모델 설정

- Hub Model ID에 변환하고 싶은 모델 입력

- Quantization Method로 양자화 타입 설정

(gguf 구조 이미지 클릭시 연결되는 사이트에서 자세하게 설명)

일반적으로 "Q4_K_M"과 "Q5_K_M"의 모델 크기 및 성능이 좋다고 알려짐 - 마지막으로 허깅페이스 계정의 Acess Token 중 write 토큰 입력

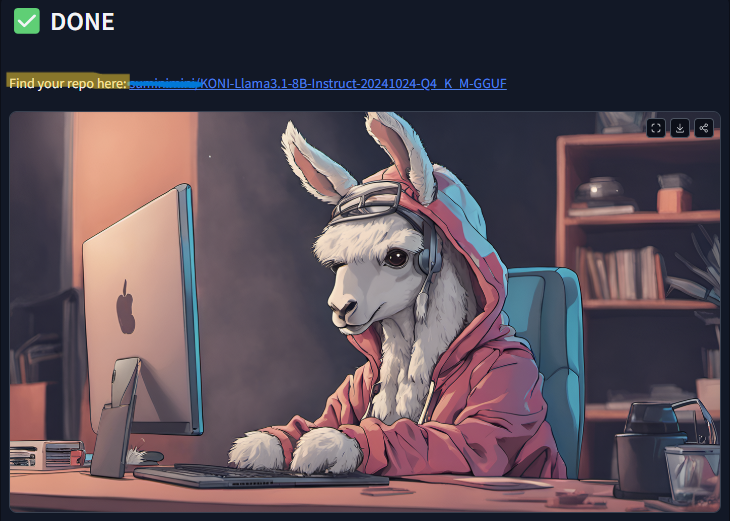

- Submit → gguf로 변환된 파일이 내 계정에 저장됨!

(+) 우측 상단에 있는 "You must be logged in to use GGUF-my-repo"에 로그인 하는 거 잊지 말기

- gguf 변환이 끝나면 우측에 DONE 표시와 함께 repo가 저장된 하이퍼링크를 안내해줌