혼공머신

알고리즘

K-최근접 이웃 회귀 (K-Nearest Neighbor)

- 방법 : 입력 값과 가까운 K개의 훈련 세트의 평균값을 출력한다.

- 한계 : 훈련 세트 범위 밖의 샘플은 예측할 수 없다.

선형 회귀 (Linear Regression)

- 방법 : 훈련 세트와 잘 맞는 직선의 방정식을 찾는다.

- 한계 : 모델이 단순하고, 출력값으로 음수가 나올 수 있다.

다항 회귀 (Polynomial Regression)

- 방법 : 훈련 세트와 잘 맞는 곡선의 방정식을 찾는다. 분석하고자 하는 데이터가 곡선 형태인 경우, n차항으로 만들어 Linear Regression을 수행한다.

특성 공학 (Feature Engineering)

가지고있는 특성 (Feature)들을 이용하여 새로운 특성 값을 만들어내는 방법.

규제 (Regularization)

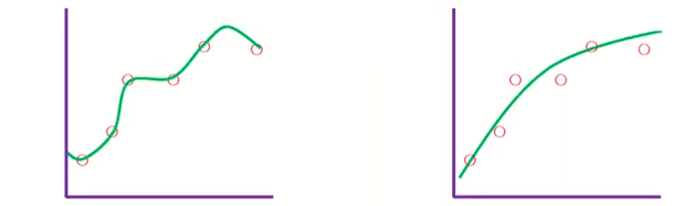

과대적합(overfit)되지 않도록 하기 위해 훼방을 놓는다.

e.g. 선형 회귀 모델의 경우, 특성(Feature)에 곱해지는 계수의 크기를 작게 만든다.

- 왼쪽 : 훈련 세트를 과도하게 학습

- 오른쪽 : 기울기를 줄여 보다 보편적인 패턴을 학습

순서

-

데이터 정규화

규제를 적용할 때, 계수 값의 크기가 서로 많이 다르면 공정하게 제어되지 않을 것이다. -

릿지 (ridge) / 라쏘 (lasso) 모델 적용

계수의 크기를 줄인다.

- 릿지: 계수를 제곱한 값을 기준으로 규제 적용

- 라쏘: 계수의 절댓값을 기준으로 규제 적용

- 계수의 크기를 아예 0으로 만들 수도 있음. 유용한 특성을 골라내는 용도로 사용할 수 있다.

로지스틱 회귀

이름은 회귀이지만 분류 모델임