📌 ch 2 . Machine Learning for Regression_OLS and MLE

Regression and Linear models

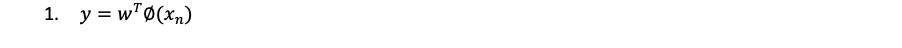

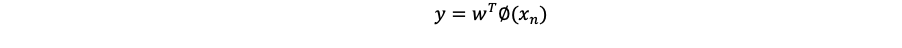

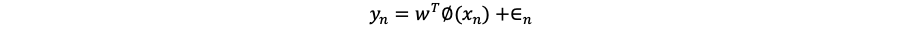

Linear Regression

Batch methods

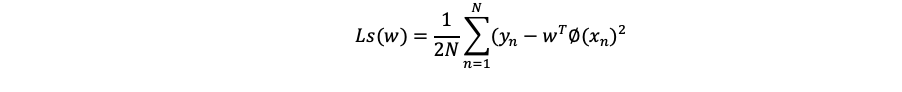

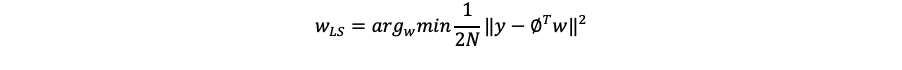

Ordinary least squares(OLS)

여기서

minimize 하는게 목표

y : target bector

∅ : design matrix

Maximum likelihood estimates

Sequential methods

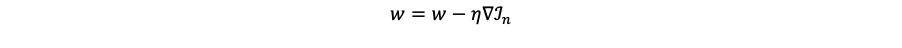

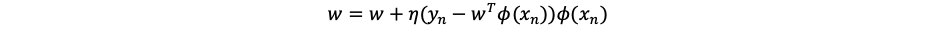

Least mean squares(LMS)

gredient descent method의 하나임

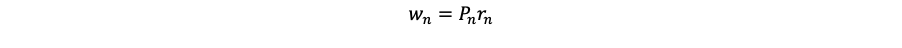

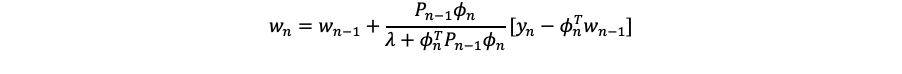

Recursive (sequential) least squares (RLS)

(P(n-1) ϕ_n)/(λ+ϕ_n^T P(n-1) ϕn ) : constant stepsize

[y_n-ϕ_n^T w(n-1)] : error

📌 ch 3 . Linear Models for Regression _ Regularization, Shrinkage, Sparseness

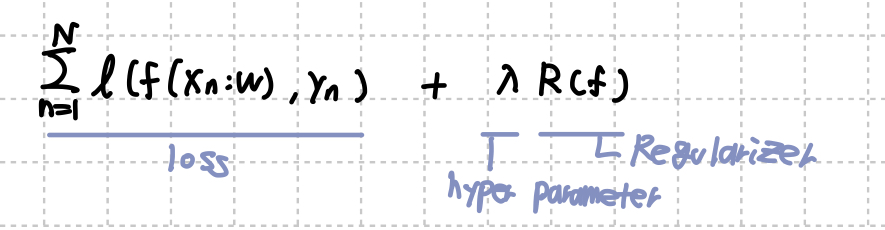

Regularization

Regularization

목적 : improve the generalization of the learned model

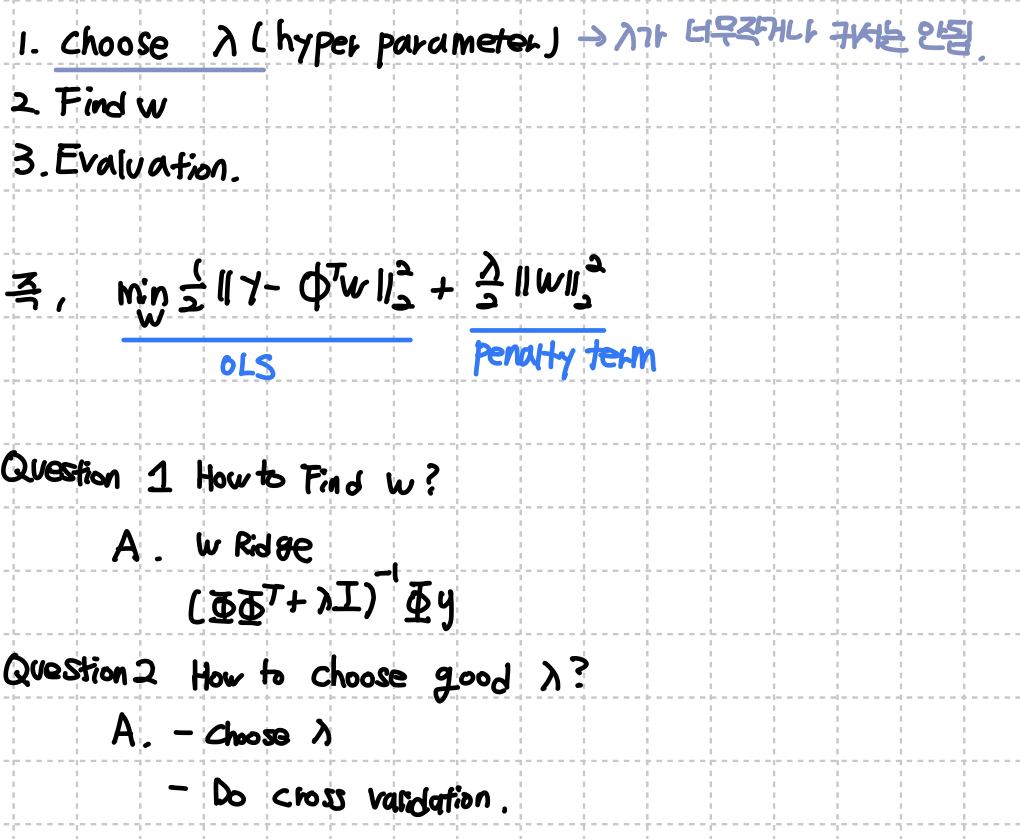

Ridge Regression

추가적인 정리

Batch methods와 Sequential methods 차이

Batch methods는 가능한 모든 데이터를 사용해 모델을 찾지만 Sequential methods는 하나하나 들어올 때마다 모델을 업데이트함

좋은 정보 감사합니다