[논문분석]ReplayCAD: Generative Diffusion Replay for Continual Anomaly Detection (IJCAI 2025)

[ 논문 분석 ]

3줄 요약

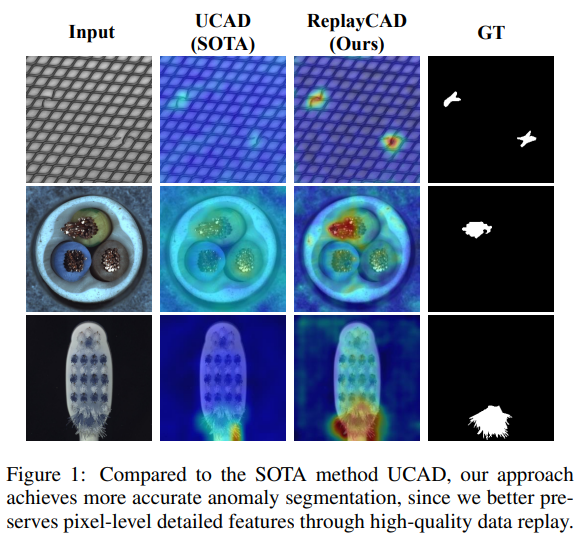

💡 CAD는 치명적인 망각과 미세한 이상 영역 분할의 어려움을 겪는데, ReplayCAD는 diffusion 기반의 generative replay를 통해 고품질의 과거 데이터를 재생하여 픽셀 수준의 상세 특징을 효과적으로 보존한다.

⚙️ 이 방법은 사전 훈련된 diffusion 모델의 조건부 공간에서 클래스 semantic embedding을 찾아 데이터를 압축하고, 샘플의 spatial features를 추가로 활용하여 더 다양하고 실제와 같은 데이터를 생성한다.

📈 실험 결과, ReplayCAD는 기존 SOTA 방법 대비 VisA에서 11.5%, MVTec에서 8.1%의 분할 성능 향상을 포함하여 분류 및 분할 모두에서 뛰어난 성능을 달성하며, 재현된 데이터의 일반화 능력을 입증했다.

요약

ReplayCAD는 Continual Anomaly Detection (CAD)에서 발생하는 catastrophic forgetting과 작은 이상 영역 분할 성능 저하를 해결하기 위해 제안된 확산(diffusion) 기반 생성 리플레이(generative replay) 프레임워크이다. 기존 CAD 방법들은 이미지 분포나 패치 특징을 저장하여 forgetting을 완화하려 했지만, 픽셀 수준의 세밀한 특징을 충분히 보존하지 못해 정교한 분할 성능이 제한되었다. ReplayCAD는 고품질 과거 데이터를 리플레이하여 이러한 한계를 극복한다.

핵심 방법론 개요

ReplayCAD는 두 단계로 구성된다.

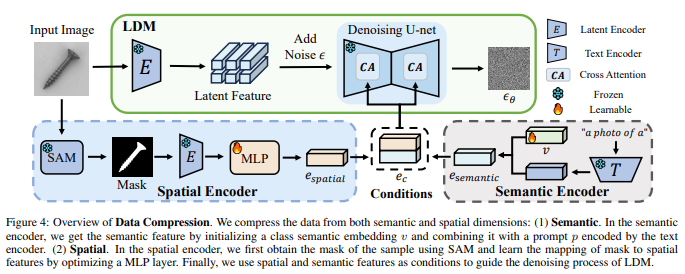

- 데이터 압축(Data Compression): 각 클래스의 과거 데이터를 조건부 특징(conditional features)으로 압축한다.

- 리플레이 강화 이상 탐지 훈련(Replay-enhanced AD Training): 압축된 특징을 사용해 과거 데이터를 생성 리플레이하고, 이를 신규 클래스 데이터와 함께 사용하여 이상 탐지 모델을 학습한다.

이 중 논문의 핵심 기여는 (1) 데이터 압축 단계를 고도화한 것이다.

1.1 시맨틱 인식 생성 리플레이(Semantic-Aware Generative Replay)

LDM은 저차원 잠재 공간에서 노이즈 제거(denoising)를 통해 데이터를 생성하며, 조건 정보(텍스트 설명, 마스크, 클래스 레이블 등)로 생성 과정을 제어한다. 최적화 목적함수는 다음과 같다.

여기서 는 잠재 인코더(latent encoder),는 노이즈, 는 LDM이 예측하는 노이즈, 는 diffusion timestep,는 조건 인코더(conditional encoder)이다.

각 클래스의 시맨틱 특징을 표현하기 위해 학습 가능한 임베딩 를 무작위 초기화하고, “a photo of a” 같은 텍스트 프롬프트 를 고정 텍스트 인코더 로 인코딩한 결과와 결합해 시맨틱 조건을 만든다.

이때 이 노이즈 제거 과정을 안내하도록 를 학습하며, 최적화 문제는 다음과 같다.

학습된 는 클래스별로 저장되며, 이후 신규 클래스가 도입될 때 과거 클래스 데이터 리플레이에 사용된다.

1.2 공간적으로 향상된 다양한 생성(Spatially-Enhanced Diverse Generation)

시맨틱만으로는 다양한 공간적 패턴을 충분히 반영하기 어렵기 때문에, ReplayCAD는 마스크 기반 공간 특징을 조건으로 추가한다.훈련 세트에 마스크 레이블이 없으므로, SAM(Segment Anything Model)의 제로샷 분할로 마스크를 생성한다. LDM이 마스크 이미지를 직접 해석하기 어렵기 때문에, 마스크에서 공간 조건으로의 매핑을 학습하는 MLP를 최적화한다.

입력 이미지 에 대해 SAM으로 마스크를 얻고, 이를 잠재 인코더로 인코딩해 형태로 만든다. 이후 이를 MLP 입력 크기에 맞게 재구성하여 를 얻고, (n, m) 크기의 MLP 가중치 를 적용하여 공간 특징을 계산한다.

마지막으로 이를 시맨틱 특징과 결합 가능한 크기로 재구성하여 를 얻는다. 그리고 시맨틱/공간 조건을 연결해 최종 조건을 구성한다.

각 클래스에 대해 최적의 시맨틱 임베딩과 MLP를 찾는 목표는 다음과 같다.

훈련 완료 후에는 학습된 , , 그리고 무작위로 선택된 개의 마스크 이미지를 저장하여 조건부 특징으로 사용한다.

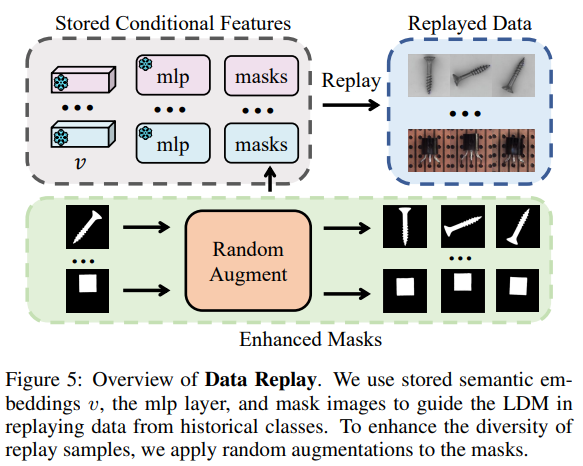

2. 리플레이 강화 이상 탐지 훈련(Replay-enhanced AD Training)

두 번째 단계에서는 저장된 조건부 특징을 이용해 과거 데이터를 생성 리플레이한다.

시맨틱 제어: 저장된 로 생성 샘플 클래스 제어

공간 제어: 저장된 마스크와 MLP 로 공간적 위치 제어

다양성 강화: 마스크에 랜덤 회전/이동을 적용하여 공간 다양성 확보

이렇게 생성한 과거 클래스 리플레이 데이터와 신규 클래스 데이터를 함께 사용하여 이상 탐지 모델을 학습한다. 논문에서는 InvAD를 기본 AD 모델로 사용하며, InvAD는 인코더 와 생성기 로 구성된다. 정상 샘플 에 대해 , 를 생성하고, 손실은 다음과 같다.

비정상 영역은 와 의 차이(재구성 오차)로 산출된다.

평가 및 지표

VisA 및 MVTec 데이터셋에서 실험하며, 분류 성능은 Image-AUROC, 분할 성능은 Pixel-AP로 평가한다. forgetting 평가를 위해 Forgetting Measure(FM)을 사용한다.

여기서 은 총 클래스 수, 는 특정 클래스의 분류/분할 점수이다.

결론

ReplayCAD는 CAD에서 사전학습 확산 모델 기반 생성 리플레이를 적용해, 과거 샘플의 세밀한 정보를 더 잘 보존하고 작은 이상 영역 분할 성능을 크게 개선한다. 특히 시맨틱 조건 와 공간 조건 을 데이터 압축 단계에 통합함으로써, 고품질 리플레이 데이터를 생성하고 다양한 AD 모델로도 잘 전이되는 것을 보인다.