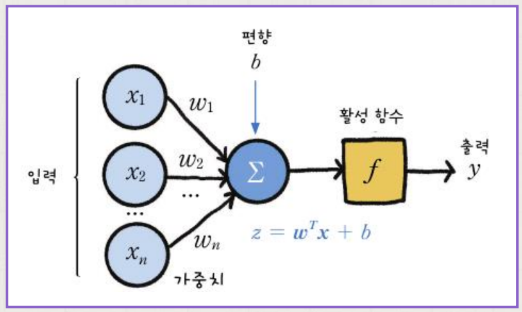

활성 함수란 ?

-

은닉 계층을 설계할 때 적용 가능한 비선형 함수

(선형식으로만 변환하면 특징을 표현하는 데 한계) -

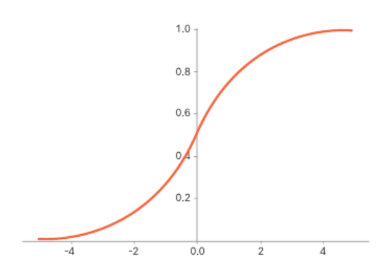

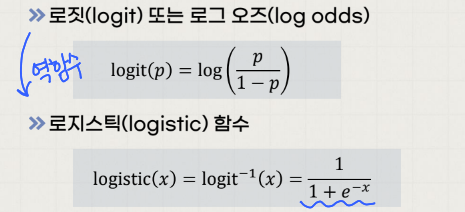

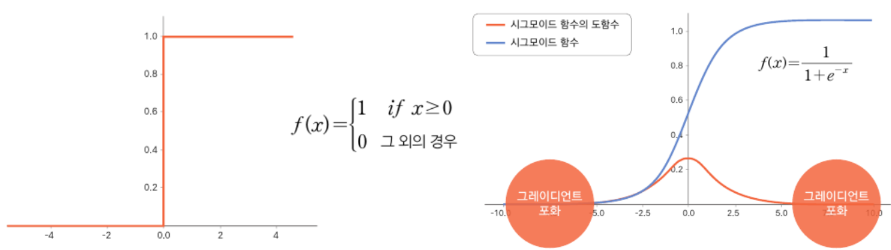

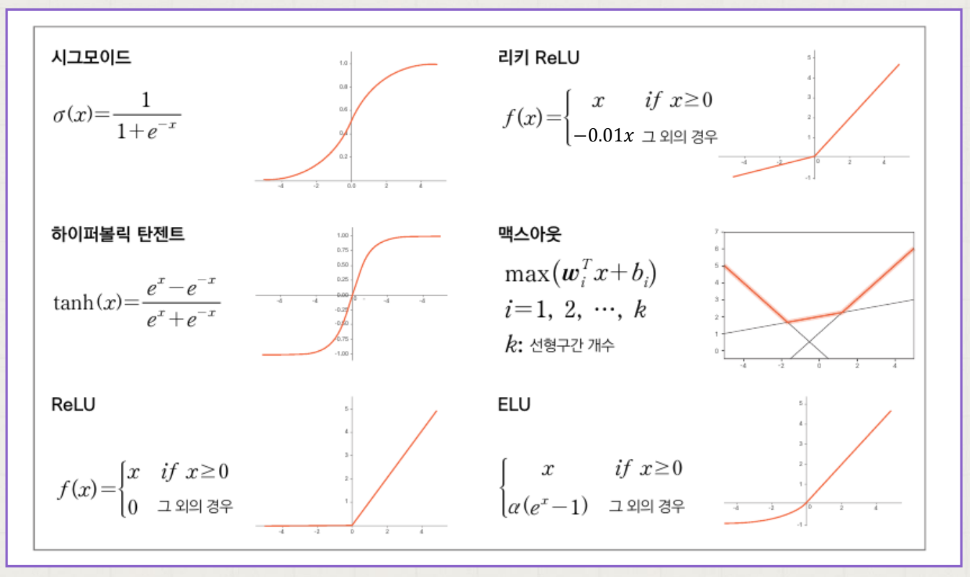

시그모이드(sigmoid) 함수

- S형으로 생긴 함수이며, 로지스틱 함수가 대표적이다.

-

이진 분류에 사용된다. ->

-

결정 경계 (decision boundary) 에 따라 클래스를 분류하게 된다.

-

단점 : 그래디언트 포화 (gradient saturation)

💡 그래디언트 포화란 ?

양 끝에서 미분값이 0에 지나치게 가까워져서 그래디언트 소실로 학습이 진행되지 않는 문제로, 이진 분류의 출력에서는 선호됨.

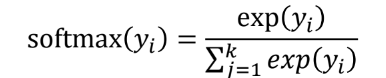

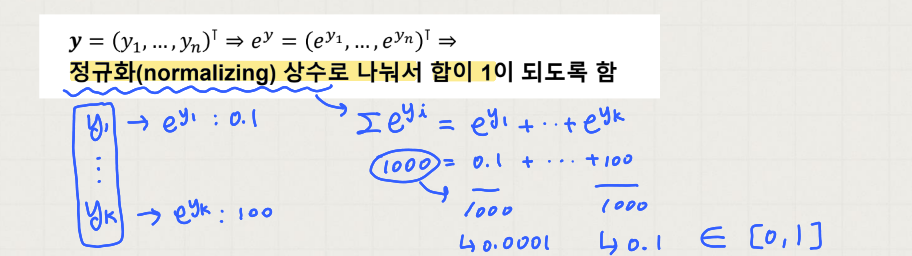

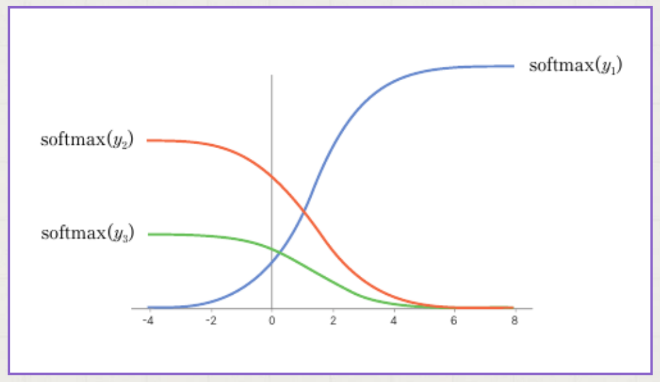

소프트맥스(softmax) 함수

-

로지스틱 함수를 일반화한 함수이다. ->

시그모이드 함수와 비슷해 보이지만 소프트맥스 함수는 출력 노드 값들의 합을 1로 한다. -

신경망의 결과로 각 클래스에 대한 출력층의 노드에 대한 값이 라고 할 때, 정규화(normalizing) 상수로 나눠서 합이 1이 되도록 한다.

-

입력값이 클수록 1에 가깝게, 작을수록 0에 가깝게 -> 총합이 1이 되는 확률 벡터를 만들 수 있다.

-

다중 분류에 사용된다.

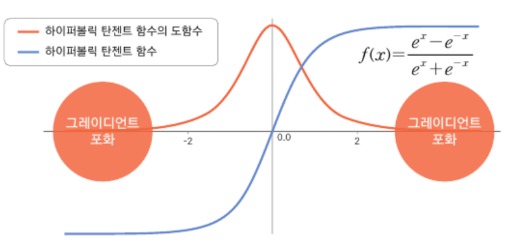

하이퍼볼릭 탄젠트 함수

-

시그모이드 함수의 값의 범위를 대신 로 한 함수이다.

-

단점 : 그래디언트 포화 문제 여전히 발생 ..!

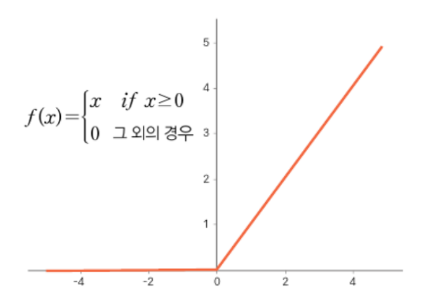

ReLU 함수

-

0보다 크면 통과, 0보다 작으면 0으로 변환하는 함수이다.

-

장점 : 연산량이 적고, 0보다 작은 경우는 고려하지 않아도 된다. 또한, 미분이 항상 1로 고정된다.

-

단점 : 가중치 초기화를 잘못하거나 학습률이 크면 뉴런이 0만 출력할 수 있다.

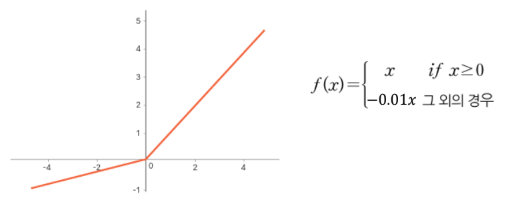

Leaky ReLU 함수

- ReLU의 뉴런 값이 계속해서 0을 출력하는 문제를 해결한다.

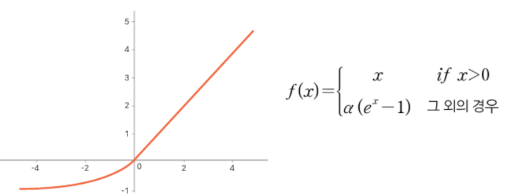

ELU (Exponential Linear Unit)

- 음수 구간을 지수 함수 형태로 정의한 함수이다.

맥스아웃(maxout) 함수

- 활성 함수도 학습을 통해 찾을 수 있도록 한 선형 함수들의 최댓값 함수이다.

- 즉, 선형 함수들의 조합을 통해 구하는 방식으로, ReLU의 일반화된 형태로 성능이 뛰어나다.

요약 정리

활성함수는 많고도 많다 ..

주로 많이 쓰이는 활성 함수를 뽑자면,

1. 시그모이드 - 이진 분류 모델에 활용

2. 소프트맥스 - 다중 분류 모델에 활용

3. ReLU - 기본적인 은닉층에 활용

위의 3개는 기억해보자 ! 😊