Unity Project (Pose tracking)

1.Mediapipe Pose와 Unity를 이용한 포즈 트래킹(pose tracking) 프로그램 만들기

교내 프로젝트로 진행했던 개발 경험 들을 기억하고자 기록하는 게시물입니다. MediaPipe Pose는 Google이 제공하는 AI 프레임 워크 중에서 하나이고, BlazePose 모델을 통하여 고정밀 포즈 추적(Human pose estimation)이 가능하다.

2024년 2월 27일

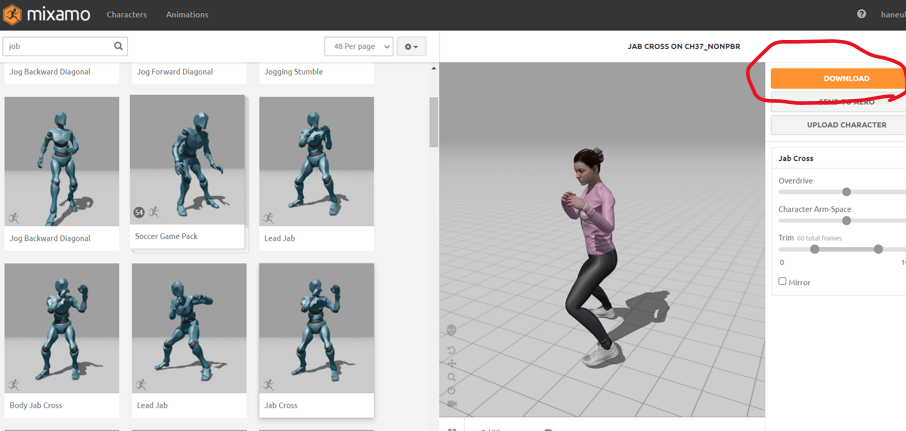

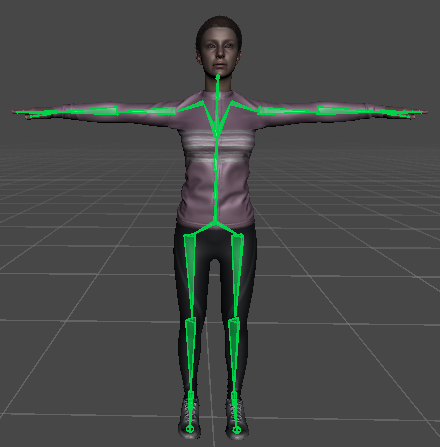

2.Unity 3D 휴머노이드 아바타의 관절 위치를 텍스트 파일에 기록해보자

목표 Unity 3D 휴머노이드 모델을 Mixamo 캐릭터 애니메이션으로 움직이게 한 후, 모델이 움직일 때 관절 위치를 텍스트 파일에 기록 하기

2024년 1월 17일

3.텍스트 파일에서 3차원 좌표값을 읽어와 Vector3 배열에 저장하기

저번 게시물에서 3차원의 좌표값을 텍스트 파일에 기록했다. 텍스트 파일을 열어서 이 값들을 가져와 배열에 저장하고, 이 배열은 3D 캐릭터의 움직임을 구현할 때 사용할 것이다.

2024년 2월 27일

4.Unity 아바타의 관절 움직임을 통해 동작 구현해보기

이전 게시물에서 텍스트파일에 기록되어있는 관절값을 가져와 배열에 저장했다. 3차원 위치값으로 관절의 회전을 만들어 아바타를 움직여보자.

2024년 3월 25일

5.통신하기 전 Unity 아바타 관절 움직이는 코드 최종 수정

통신을 시작하기 전 mediaPipe 모듈을 실행해보았다. 웹캠(webcam)을 키고 몇 초간 어떤 동작을 수행하면서, 필요한 13개의 관절 위치값을 텍스트 파일에 기록했다. 이 값들을 아바타에 적용시켜서 아바타가 동작을 잘 수행하는지 최종적으로 점검 했다.

2024년 5월 2일

6.Unity와 Python의 TCP 소켓 통신을 구현해보자

저번 게시물에서 관절의 위치를 이용해 아바타의 움직임을 구현해 보았다. 이번에는 mediaPipe 모듈로 실시간 감지한 관절의 위치를 유니티에 전송해서 데이터를 잘 받아올 수 있는지 확인해 보겠다.

2024년 5월 2일

7.통신할 때, 유니티 측에서 수신 속도를 조절해보자

이제 전달받은 데이터를 아바타에 실시간 적용하여 웹캠(webcam)으로 찍은 사용자의 동작을 아바타가 트래킹 할 수 있는지 확인해보겠다.

2024년 5월 6일